mlday2

gradient descent梯度下降法

loss等高线的法线方向

学习率

η

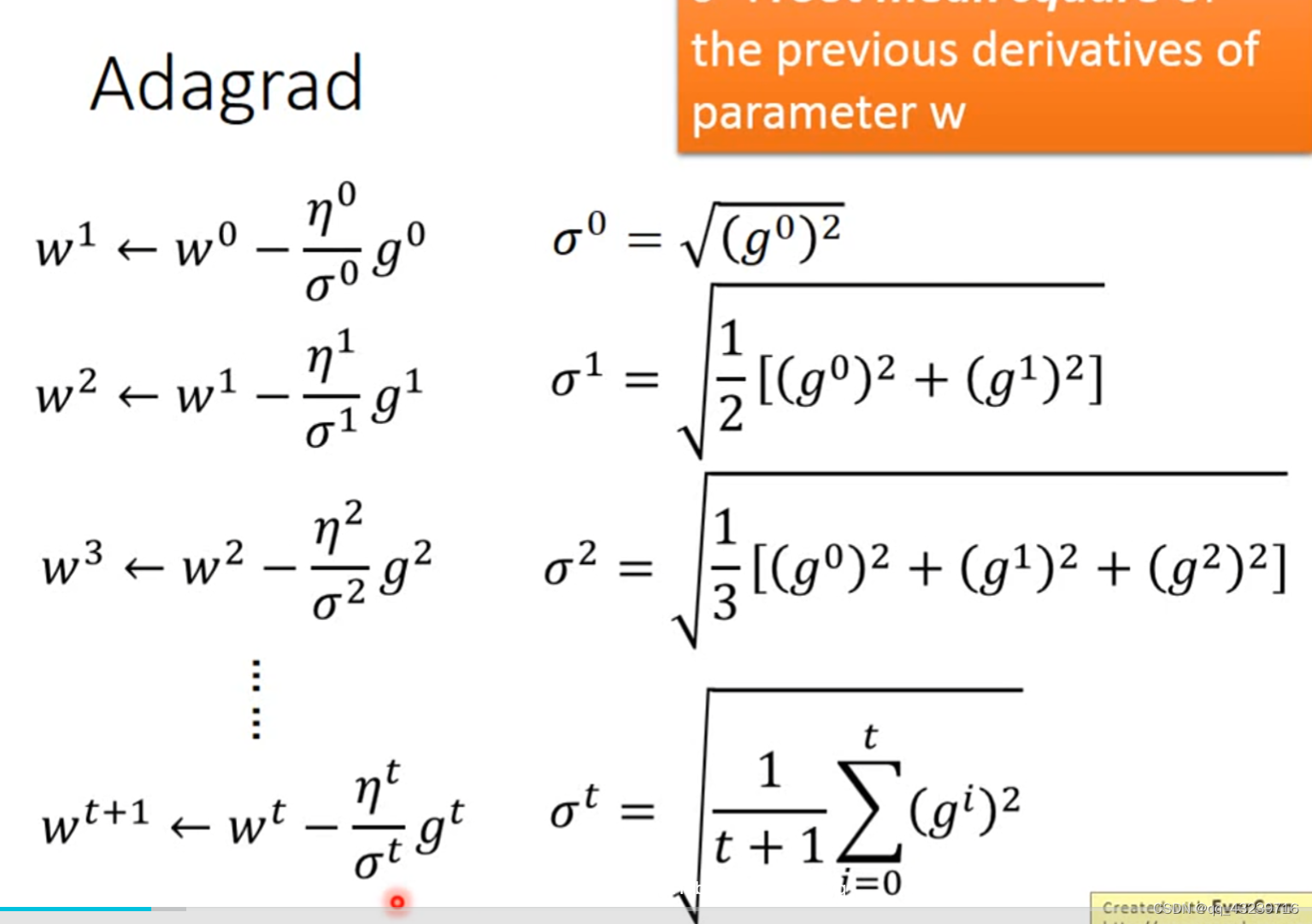

Adagrad优化算法

自适应学习率优化算法

Adagrad 算法的核心想法是:如果一个参数的梯度一直都非常大,那么其对应的学习率就变小一点,防止震荡,而一个参数的梯度一直都非常小,那么这个参数的学习率就变大一点,使得其能够更快地更新,这就是

Adagrad算法加快深层神经网络的训练速度的核心。

5139

5139

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?