1、原理

k-近邻算法(kNN),它的工作原理是:存在一个样本数据集合,也称作训练样本集,并且样本集中每个数据都存在标签,即我们知道样本集中每一数据与所属分类的对应关系。输入没有标签的新数据后,将新数据的每个特征与样本集中数据对应的特征进行比较,然后算法提取样本集中特征最相似数据(最近邻)的分类标签。一般来说,我们只选择样本数据集中前k个最相似的数据,这就是k-近邻算法中k的出处,通常k是不大于20的整数。最后,选择k个最相似数据中出现次数最多的分类,作为新数据的分类。

2、一般流程

1.收集数据:可以使用任何方法。

2. 准备数据:距离计算所需要的数值,最好是结构化的数据格式。

3. 分析数据:可以使用任何方法。

4. 训练算法:此步骤不适用于k近邻算法。

5. 测试算法:计算错误率。

6. 使用算法:首先需要输入样本数据和结构化的输出结果,然后运行k近邻算法判定输入数据分别属于哪个分类,最后应用对计算出的分类执行后续的处理。

3、伪代码

这里首先给出k近邻算法的伪代码。例子函数的功能是使用k近邻算法将每组数据划分到某个类中,其伪代码如下:

对未知类别属性的数据集中的每个点依次执行以下操作:

1.计算已知类别数据集中的点与当前点之间的距离;

2.按照距离递增次序排序;

3.选取与当前点距离最小的k个点;

4.确定前k个点所在类别的出现频率;

5.返回前k个点出现频率最高的类别作为当前点的预测分类。

4、python代码

先建立kNN.py,输入以下代码:

# coding:gbk

from numpy import *

import operator

def createDataSet():

group = array([[1.0,1.1],[1.0,1.0],[0,0],[0,0.1]])

labels = ['A','A','B','B']

return group, labels

def classify0(inX,dataSet,labels,k):

dataSetSize= dataSet.shape[0]

# type: object # shape[0]获取行 shape[1] 获取列

diffMat=tile(inX,(dataSetSize,1))-dataSet

#tile类似于matlab中的repmat,

#1 计算欧式距离

sqDiffMat=diffMat**2

sqDistance=sqDiffMat.sum(axis=1)

distance=sqDistance**0.5

sortedDistance=distance.argsort()

#增序排序

classCount={}

for i in range(k):

#获取类别

voteIlabel=labels[sortedDistance[i]]

# 字典的get方法,查找classCount中是否包含voteIlabel,是则返回该值,不是则返回defValue,这里是0

# 其实这也就是计算K临近点中出现的类别的频率,以次数体现

classCount[voteIlabel]=classCount.get(voteIlabel,0)+1

# 对字典中的类别出现次数进行排序,classCount中存储的事 key-value,其中key就是label,value就是出现的次数

# 所以key=operator.itemgetter(1)选中的事value,也就是对次数进行排序

sortedClassCount=sorted(classCount.items(),key=operator.itemgetter(1),reverse=True)

# sortedClassCount[0][0]也就是排序后的次数最大的那个label

return sortedClassCount[0][0]

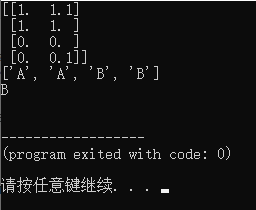

再建立useKNN.py,输入以下代码:

import kNN

group,labels = kNN.createDataSet()

print(group)

print(labels)

print(kNN.classify0([0,0], group, labels, 3))

执行结果:

输出结果是B,大家也可以改变输入[0, 0]为其他值,测试程序的运行结果。

1005

1005

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?