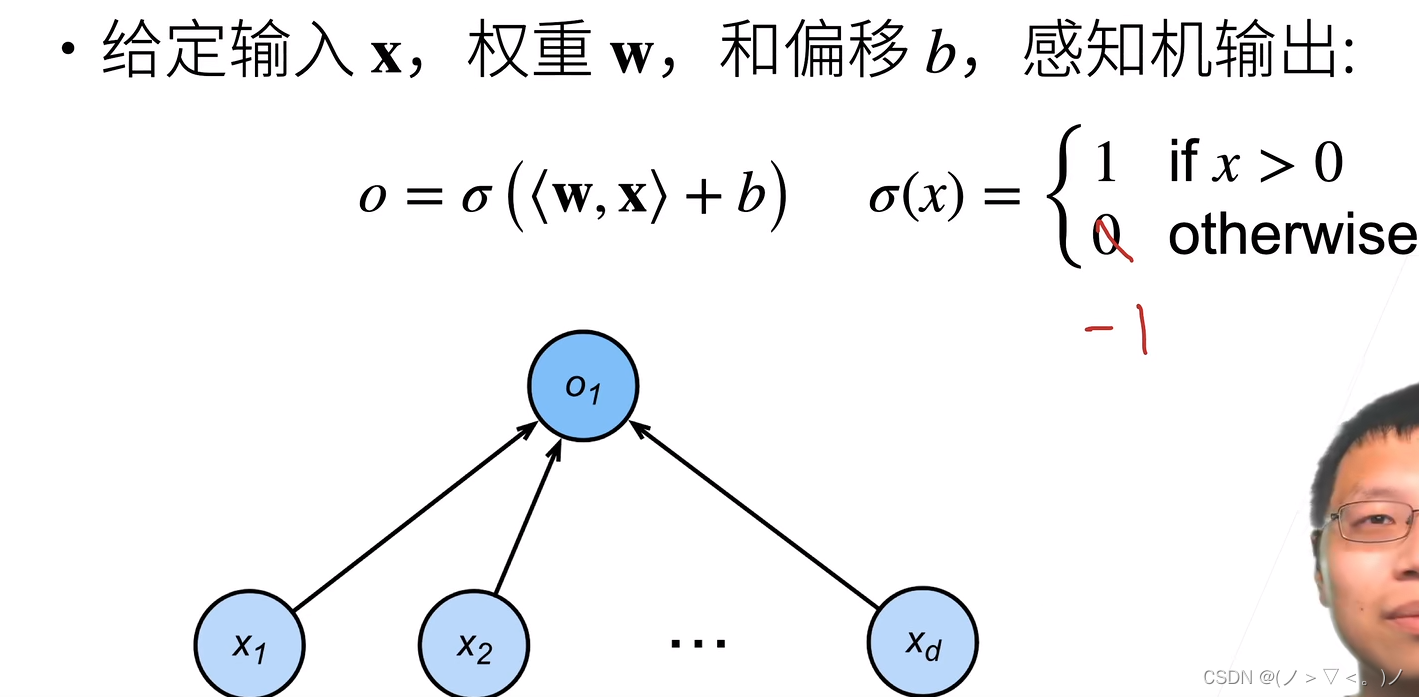

感知机就是一个神经网络模型

单层感知机

二分类(多个输入只能有一个输出)

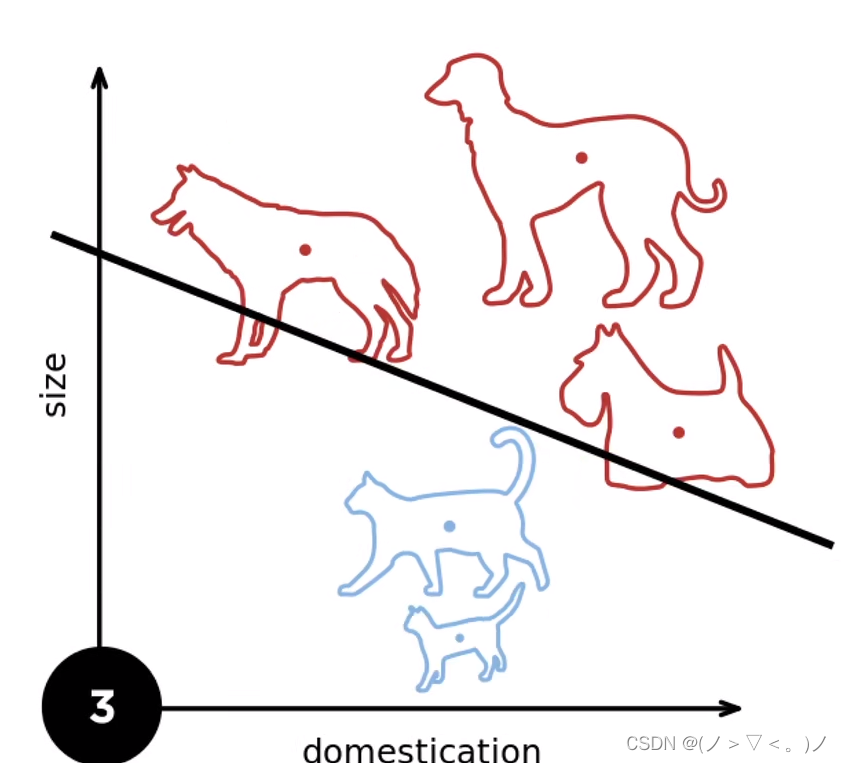

调整权重

我们在识别猫狗的时候有权重,就像是下面那根界限(权重)一样区分了猫狗。下一次识别新的猫狗的时候我们发现我们之前的界限摆歪了,这样的话我们就会重新调整棍子(权重)的摆放,划分猫狗的界限,这样一次一次的调整完全部的样本,越调区分猫狗的界限越精确。

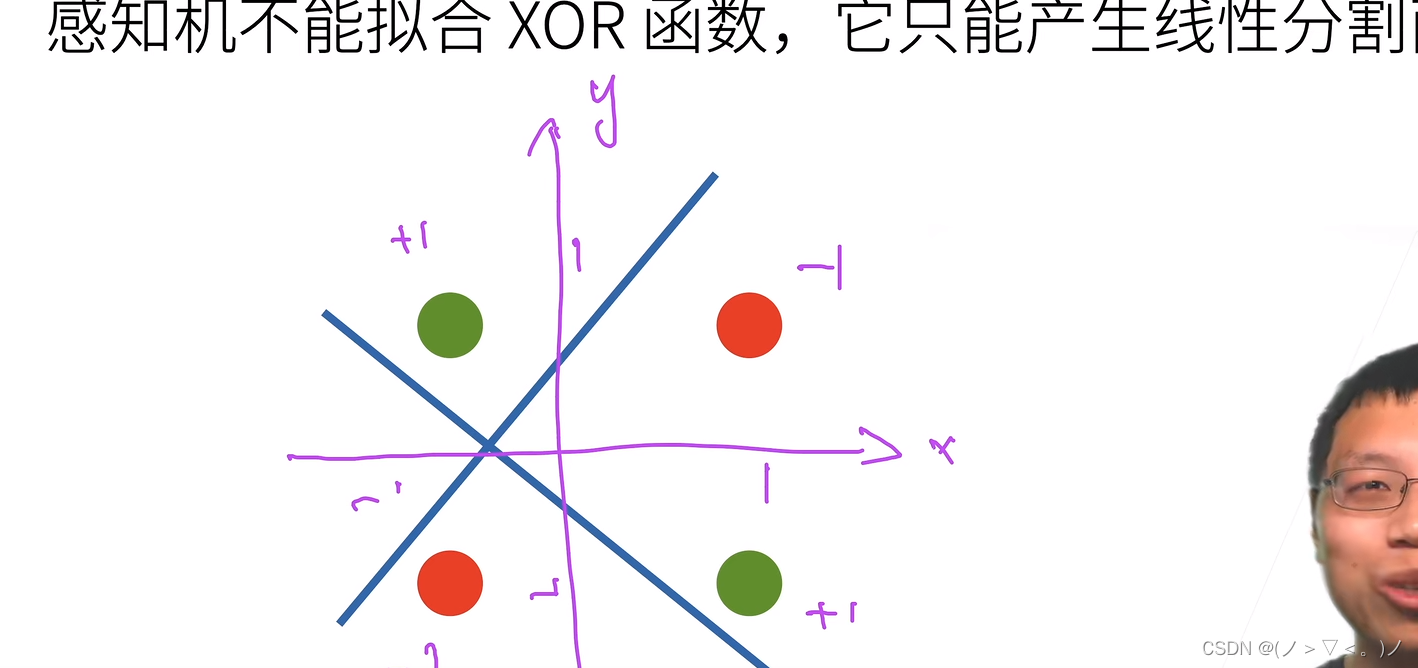

单层的感知机不能拟合X0R函数,因为模型是线性的,只能参生一个根线去切割面

多层感知机

多层二分类可以拟合XOR模型

激活函数是用来加入非线性因素的,解决线性模型所不能解决的问题

我们的模型如果只能解决线性问题的话语,那么久太不好了,我们加入了非线性的激活函数之后,我们的输入就变成非线性得了,这样模型就可以模拟解决任意函数的输入

代码

从零开始

设置批量,将训练集,测试集搞出来

import torch

from torch import nn

from d2l import torch as d2l

batch_size = 256#批量大小为256

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size)#把训练集,测试集搞出来

初始化模型参数

num_inputs, num_outputs, num_hiddens = 784, 10, 256

W1 = nn.Parameter(torch.randn(

num_inputs, num_hiddens, requires_grad=True) * 0.01)#随机randn

b1 = nn.Parameter(torch.zeros(num_hiddens, requires_grad=True))

W2 = nn.Parameter(torch.randn(

num_hiddens, num_outputs, requires_grad=True) * 0.01)

b2 = nn.Parameter(torch.zeros(num_outputs, requires_grad=True))

params = [W1, b1, W2, b2]#两层

激活函数

def relu(X):

a = torch.zeros_like(X)

return torch.max(X, a)模型

def net(X):

X = X.reshape((-1, num_inputs))

H = relu(X@W1 + b1) # 这里“@”代表矩阵乘法

return (H@W2 + b2)损失函数

loss = nn.CrossEntropyLoss(reduction='none')训练

num_epochs, lr = 10, 0.1#训练10圈,学习率为0.1

updater = torch.optim.SGD(params, lr=lr)

d2l.train_ch3(net, train_iter, test_iter, loss, num_epochs, updater)#调用之前的函数来进行训练简洁实现

import torch

from torch import nn

from d2l import torch as d2l模型

net = nn.Sequential(nn.Flatten(),

nn.Linear(784, 256),

nn.ReLU(),

nn.Linear(256, 10))

def init_weights(m):

if type(m) == nn.Linear:

nn.init.normal_(m.weight, std=0.01)

net.apply(init_weights);训练

batch_size, lr, num_epochs = 256, 0.1, 10#设置一些参数

loss = nn.CrossEntropyLoss(reduction='none')#损失函数

trainer = torch.optim.SGD(net.parameters(), lr=lr)#

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size)#把训练集,测试集放在某个位置

d2l.train_ch3(net, train_iter, test_iter, loss, num_epochs, trainer)#调用ch3函数训练

379

379

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?