一. 常用相关公式推导

下面这句话非常重要:

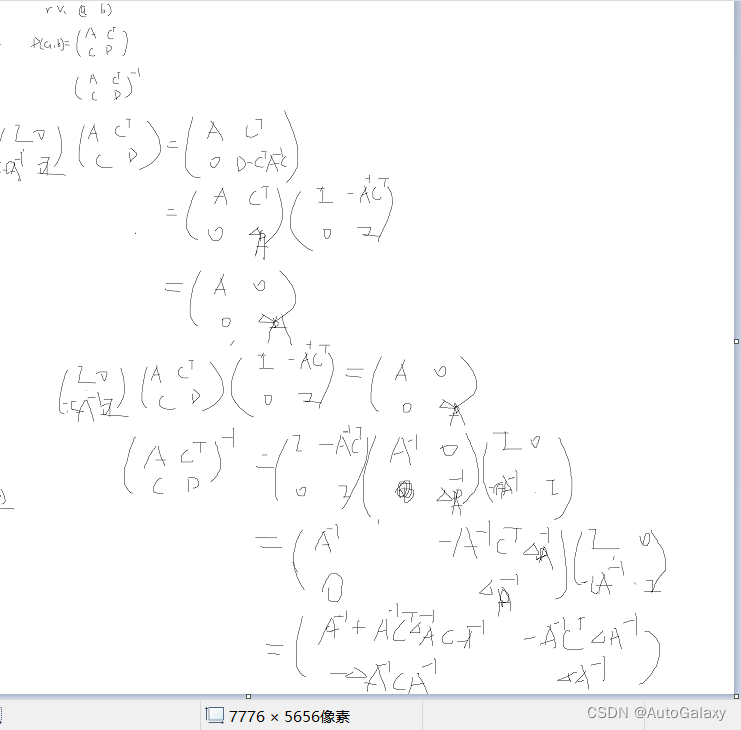

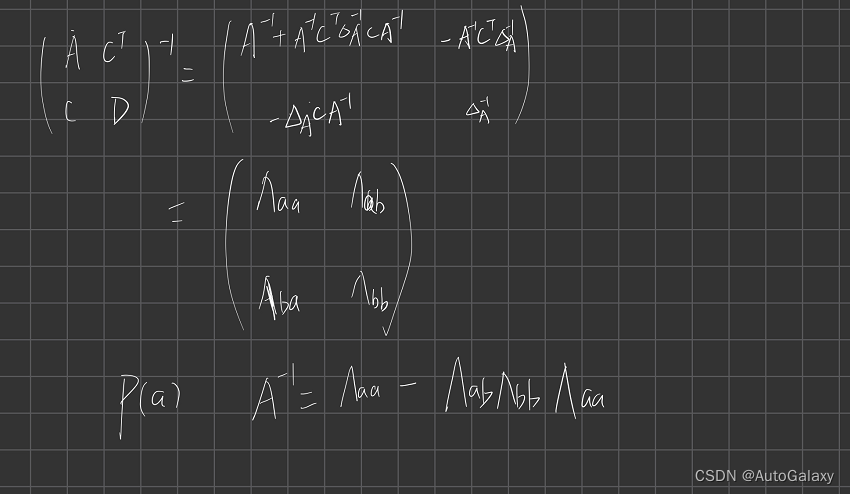

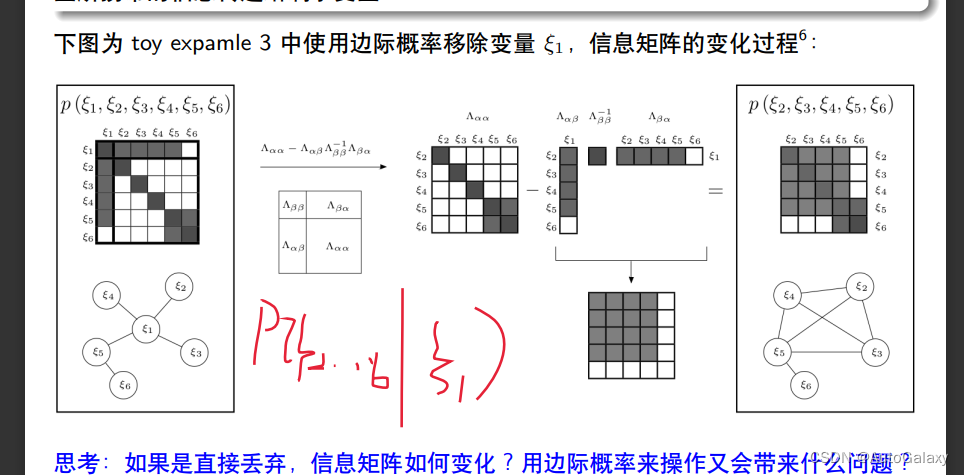

如果要丢弃随机变量 ,那么就要把其余的随机变量组合成的多维随机变量叫做边际随机变量,再求这个边际概率的时候,信息矩阵中

所对应的那一部分矩阵块恰好是随机变量

的信息矩阵,因此,要求边际随机变量的信息矩阵,只需要把多维随机变量对应的信息矩阵的矩阵块 减去 夹逼随机变量

的信息矩阵即可。

这个过程也叫做舒尔补,也叫做marginalization。

一. 预备知识

1.1 信息矩阵(Fisher Information Matrix)

关于上面第一句话的意思:得先了解构建Boundle Adjustment的过程才能有所体会。

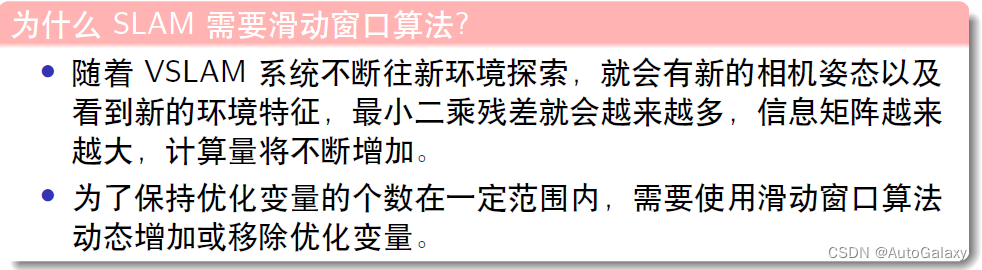

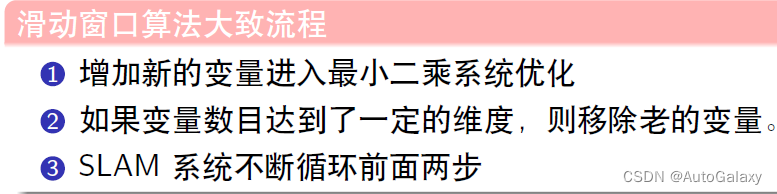

流程里面重点关注移除老的变量,如何移除

二. 利用边际概率移除老的变量

三. 高斯牛顿的信息矩阵 为什么是 优化变量协方差的逆

参考知乎:SLAM的滑动窗口算法中,在边缘化时,高斯牛顿法的信息矩阵为什么是 优化变量协方差的逆? - 知乎 (zhihu.com)

对于分布,

的海森矩阵就是随机变量

的协方差矩阵的逆。

对于分布,信息矩阵就是负对数似然问题海森矩阵的期望。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?