系列文章目录

文章目录

前言

摘录自B站对应课程笔记

不愧是清华大佬!把Python网络爬虫讲得如此简单明了!从入门到精通保姆级教程(建议收藏)

以下是本篇文章正文内容,下面案例可供参考

一、什么是XPath?

xpath(XML Path Language)是一门在XML和HTML文档中查找信息的语言,可用来在XML和HTML文档中对元素和属性进行遍历。

二、XPath开发工具

- Chrome插件XPath Helper。

- Firefox插件Try XPath。

三、XPath语法

XPath 使用路径表达式来选取 XML 文档中的节点或者节点集。这些路径表达式和我们在常规的电脑文件系统中看到的表达式非常相似。

1、选取节点

| 表达式 | 描述 | 示例 | 结果 |

|---|---|---|---|

| nodename | 选取此节点的所有子节点 | bookstore | 选取 bookstore 下所有的子节点 |

| / | 如果是在最前面,代表从根节点选取。否则选择某个节点下的节点 | /bookstore | 选取根元素下所有的 bookstore 节点 |

| // | 从全局节点中选择节点,随便在哪个位置 | //book | 从全局节点中找到所有的 book 节点 |

| @ | 选取带有某个属性的节点 | //book[@price] | 选择所有拥有 price 属性的 book 节点 |

| . | 当前节点 | ./a | 选择当前节点下的a标签 |

2、谓语

谓语用来查找某个特定的节点或者包含某个指定的值的节点,被嵌在方括号中。

在下面的表格中,我们列出了带有谓语的一些路径表达式,以及表达式的结果:

| 路径表达式 | 描述 |

|---|---|

| /bookstore/book[1] | 选取bookstore下的第一个子元素 |

| /bookstore/book[last()] | 选取bookstore下的最后一个book元素。 |

| bookstore/book[position() < 3] | 选取bookstore下前面两个子元素。 |

| //book[@price] | 选取拥有price属性的book元素 |

| //book[@price=10] | 选取所有属性price等于10的book元素 |

3、通配符

*表示通配符。

| 通配符 | 描述 | 示例 | 结果 |

|---|---|---|---|

| * | 匹配任意节点 | /bookstore/* | 选取bookstore下的所有子元素。 |

| @* | 匹配节点中的任何属性 | //book[@*] | 选取所有带有属性的book元素。 |

4、选取多个路径

通过在路径表达式中使用“|”运算符,可以选取若干个路径。示例如下:

//bookstore/book | //book/title

# 选取所有bookstore下的book元素 以及 所有book元素下的title元素

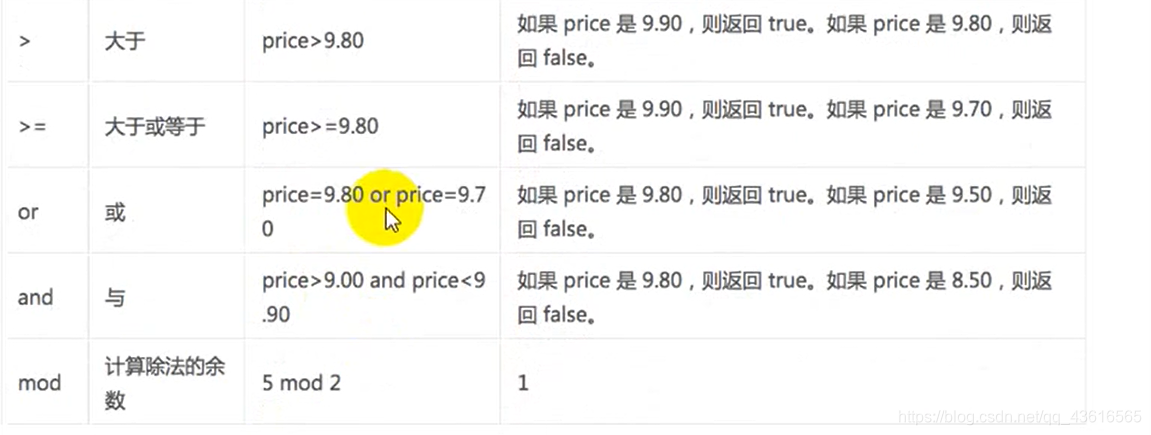

5、运算符

例如: //li[@data-index=“0” and @data-companyid=“142381”]

6、总结

使用方式:

使用 // 获取整个页面当中的元素,然后写标签名,然后写谓词进行提取,比如 //div[@class=“abc”]

需要注意的知识点:

1、/ 和 // 的区别:/ 代表只获取直接子节点。// 获取子孙节点。

2、contains:又是某个属性中包含了多个值,那么可以使用contains函数。

例如: //div[contains(@class, "job_detail")]

3、谓词中的下标是从1开始的,不是从0开始的。

四、lxml库

lxml 是 一个HTML/XML的解析器,主要的功能是如何解析和提取 HTML/XML 数据。

lxml和正则一样,也是用 C 实现的,是一款高性能的 Python HTML/XML 解析器,我们可以利用之前学习的XPath语法,来快速的定位特定元素以及节点信息。

lxml python 官方文档:http://lxml.de/index.html

需要安装C语言库,可使用 pip 安装:`

pip install lxml

1、基本使用

我们可以利用他来解析HTML代码,并且在解析HTML代码的时候,如果HTML代码不规范,他会自动的进行补全。示例代码如下:

from lxml import etree

text = """

<div>

<ul>

<li class="item-0"><a href="link1.html">first item</a></li>

<li class="item-1"><a href="link2.html">second item</a></li>

<li class="item-inactive"><a href="link3.html">third item</a></li>

<li class="item-1"><a href="link4.html">fourth item</a></li>

<li class="item-0"><a href="link5.html">fifth item</a> # 注意,此处缺少一个 </li> 闭合标签

</ul>

</div>

"""

# 利用 etree.HTML 将字符串解析为 HTML 文档

htmlElement = etree.HTML(text)

# etree.tostring(htmlElement, encoding="utf-8") 将字符串序列化为HTML 文档

print(etree.tostring(htmlElement, encoding="utf-8").decode("utf-8"))

"""

<html><body><div>

<ul>

<li class="item-0"><a href="link1.html">first item</a></li>

<li class="item-1"><a href="link2.html">second item</a></li>

<li class="item-inactive"><a href="link3.html">third item</a></li>

<li class="item-1"><a href="link4.html">fourth item</a></li>

<li class="item-0"><a href="link5.html">fifth item</a> # 注意,此处缺少一个 </li> 闭合标签

</ul>

</div>

</body></html>

"""

#可以看到。lxml会自动修改HTML代码。例子中不仅补全了li标签,还添加了body,html标签

2、从文件中读取html代码

除了直接使用字符串进行解析,lxml还支持从文件中读取内容。我们新建一个hello.html文件:

<!--hello.html-->

<div>

<ul>

<li class="item-0"><a href="link1.html">first item</a></li>

<li class="item-1"><a href="link2.html">second item</a></li>

<li class="item-inactive"><a href="link3.html"><span class="bold">third item</span></a></li>

<li class="item-1"><a href="link4.html">fourth item</a></li>

<li class="item-0"><a href="link5.html">fifth item</a></li>

</ul>

</div>

然后利用etree.parse()方法来读取文件。示例代码如下:

parser = etree.HTMLParser(encoding="utf-8") # 获取html 解析器

htmlElement = etree.parse("hello.html", parser=parser) # 默认是xml 解析器

print(etree.tostring(htmlElement, encoding="utf-8").decode("utf-8"))

总结

1、解析html 字符串:使用 lxml.etree.HTML 进行解析。示例代码:

htmlElement = etree.HTML(text)

print(etree.tostring(htmlElement, encoding="utf-8").decode("utf-8"))

2、解析hmtl 文件,使用 lxml.etree.parse 进行解析,示例代码如下:

htmlElement = etree.parse("hello.html") # 默认是xml 解析器

print(etree.tostring(htmlElement, encoding="utf-8").decode("utf-8"))

这个函数默认使用的是 xml 解析器, 所以如果遇到不规范的html 代码就会解析错误,这时候就要自己创建 html解析器

parser = etree.HTMLParser(encoding="utf-8") # 获取html 解析器

htmlElement = etree.parse("hello.html", parser=parser) # 默认是xml 解析器

print(etree.tostring(htmlElement, encoding="utf-8").decode("utf-8"))

3、在lxml中使用XPath语法

1、获取所有li标签:

from lxml import etree

html = etree.parse('hello.html')

print type(html) # 显示etree.parse() 返回类型

result = html.xpath('//li')

print(result) # 打印<li>标签的元素集合

2、获取所有li元素下的所有class属性的值:

from lxml import etree

html = etree.parse('hello.html')

result = html.xpath('//li/@class')

print(result)

3、 获取li标签下href为www.baidu.com的a标签:

from lxml import etree

html = etree.parse('hello.html')

result = html.xpath('//li/a[@href="www.baidu.com"]')

print(result)

4、 获取li标签下所有span标签:

from lxml import etree

html = etree.parse('hello.html')

#result = html.xpath('//li/span')

#注意这么写是不对的:

#因为 / 是用来获取子元素的,而 <span> 并不是 <li> 的子元素,所以,要用双斜杠

result = html.xpath('//li//span')

print(result)

5、 获取li标签下的a标签里的所有class:

from lxml import etree

html = etree.parse('hello.html')

result = html.xpath('//li/a//@class')

print(result)

6、 获取最后一个li的a的href属性对应的值

from lxml import etree

html = etree.parse('hello.html')

result = html.xpath('//li[last()]/a/@href')

# 谓语 [last()] 可以找到最后一个元素

print(result)

7、获取倒数第二个li元素的内容:

from lxml import etree

html = etree.parse('hello.html')

result = html.xpath('//li[last()-1]')

# text 方法可以获取元素内容

print(result[0].text)

8、获取倒数第二个li元素的内容的第二种方式:

from lxml import etree

html = etree.parse('hello.html')

result = html.xpath('//li[last()-1]/text()')

print(result)

总结

1、使用 xpath 语法,应该使用 Element.xpath 方法来执行 xpath 的选择。示例代码如下:

divs = html.xpath("//div[@class='recruit-list']")

xpath 函数返回的永远是一个列表

2、获取某个标签的属性:

hrefs = html.xpath("//a[@href]")

# 获得 a 标签的 href 属性对应的值

3、获取文本,是通过 xpath 中的 text() 函数, 示例代码如下:

address = tr.xpath("./td[4]/text()")[0]

4、如果想要某个标签下,再执行 xpath 函数, 获得这个标签下的子孙元素,

应该在斜杆之前加一个点,代表是在当前元素下获取。示例代码如下:

address = tr.xpath("./td[4]/text()")[0]

五、爬取豆瓣网最新上映电影信息

import requests

from lxml import etree

# 1、将目标网站上的页面抓取下来

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/92.0.4515.159 Safari/537.36",

"Referer": "https://movie.douban.com/cinema/nowplaying/guangzhou/"

}

url = "https://movie.douban.com/cinema/nowplaying/guangzhou/"

resp = requests.get(url=url, headers=headers)

text = resp.content

# 解码方式根据html 设置的编码:<meta http-equiv="Content-Type" content="text/html; charset=utf-8">

# print(text.decode("utf-8"))

# 2、将抓取下来的数据根据一定的规则进行提取

html = etree.HTML(text)

ul = html.xpath("//ul[@class='lists']")[0] # 有两个:1.正在上映,2.即将上映

lis = ul.xpath("./li")

movies = []

for li in lis:

title = li.xpath("@data-title")[0]

score = li.xpath("@data-score")[0]

duration = li.xpath("@data-duration")[0]

address = li.xpath("@data-region")[0]

director = li.xpath("@data-director")[0]

actors = li.xpath("@data-actors")[0]

img_src = li.xpath(".//img/@src")[0]

movie = {

"title": title, # 电影名

"score": score, # 评分

"duration": duration, # 时长

"address": address, # 国家

"director": director, # 导演

"actors": actors, # 主演

"img_scr": img_src # 图片

}

movies.append(movie)

print(movies)

六、使用requests和xpath爬取电影天堂

"""

需求:爬取 电影天堂 最新电影信息

链接:https://dytt8.net/html/gndy/dyzz/index.html

网页手动保存到当前目录:04_dytt.html

"""

import requests

from lxml import etree

HEADERS = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/72.0.3626.119 Safari/537.36",

"Referer": "https://dytt8.net/html/gndy/dyzz/index.html"

}

BASE_URL = "https://dytt8.net"

def get_detail_urls(url):

"""

根据url获取电影的详情链接

:param url: 请求的url

:return: 电影详情信息的url 列表

"""

resp = requests.get(url=url, headers=HEADERS)

text = resp.text

html = etree.HTML(text)

# 用最快速的方法找到电影详情的链接,通过 table 的 class=tbspan 快速定位

detail_urls = html.xpath("//table[@class='tbspan']//a/@href")

detail_urls = list(map(lambda url: BASE_URL + url, detail_urls)) # 将map对象转换成list

return detail_urls

def get_detail_page(url):

movie = {} # 保存电影信息

resp = requests.get(url=url, headers=HEADERS)

try:

text = resp.content.decode("gb2312") # 有无法解析的字符

except UnicodeDecodeError as e:

print("出现无法解析的符号,直接跳过")

return None

# text = resp.text

html = etree.HTML(text)

# 查询电影名称

title = html.xpath("//div[@class='title_all']//font[@color='#07519a']/text()")[0]

movie["title"] = title

# 其他信息在 id="Zoom" 的div里面

zoomEle = html.xpath("//div[@id='Zoom']")[0]

imgs = zoomEle.xpath("//img/@src")

cover = imgs[0]

screenshot = imgs[1]

movie["cover"] = cover # 电影图片链接

movie["screenshot"] = screenshot

def parse_info(rule, info):

return info.replace(rule, "").strip()

infos = zoomEle.xpath(".//text()")

for index,info in enumerate(infos):

if info.startswith("◎片 名"):

name = parse_info("◎片 名", info)

movie["name"] = name

elif info.startswith("◎年 代"):

year = parse_info("◎年 代", info)

movie["year"] = year

elif info.startswith("◎产 地"):

address = parse_info("◎产 地", info)

movie["address"] = address

elif info.startswith("◎类 别"):

category = parse_info("◎类 别", info)

movie["category"] = category

elif info.startswith("◎语 言"):

language = parse_info("◎语 言", info)

movie["language"] = language

elif info.startswith("◎豆瓣评分"):

rating = parse_info("◎豆瓣评分", info)

movie["rating"] = rating

elif info.startswith("◎片 长"):

duration = parse_info("◎片 长", info)

movie["duration"] = duration

elif info.startswith("◎导 演"):

movie["director"] = parse_info("◎导 演", info)

elif info.startswith("◎主 演"):

actor = parse_info("◎主 演", info)

actors = [actor]

for i in range(index+1, len(infos)):

if infos[i].startswith("◎标 签"):

break

actors.append(infos[i].strip())

movie["actors"] = actors

elif info.startswith("◎标 签"):

movie["director"] = parse_info("◎标 签", info)

elif info.startswith("◎简 介"):

profile = ""

for i in range(index+1, len(infos)):

if infos[i].startswith("磁力链"):break

profile += infos[i].strip()

movie['profile'] = profile

link = zoomEle.xpath(".//a/@href")[0]

movie['link'] = link

return movie

def spider():

movies = []

url = "https://dytt8.net/html/gndy/dyzz/list_23_{}.html"

# 获取7页的电影信息

for i in range(1, 8): # 循环获取所有电影详情链接

url = url.format(i)

detail_urls = get_detail_urls(url)

print(detail_urls)

for detail_url in detail_urls: # 循环获取电影信息

movie = get_detail_page(detail_url)

movies.append(movie)

print(movie)

# # 先用第一页测试

# url = "https://dytt8.net/html/gndy/dyzz/list_23_1.html"

# detail_urls = get_detail_urls(url)

# for detail_url in detail_urls:

# movie = get_detail_page(detail_url)

# movies.append(movie)

# # print(movie)

# break

if __name__ == '__main__':

spider()

927

927

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?