权重衰退

权重衰减(weight decay)是最广泛使用的正则化的技术之一, 它通常也被称为 𝐿2 正则化。

一种简单的方法是通过线性函数

f

(

x

)

=

w

⊤

x

f(\mathbf{x}) = \mathbf{w}^\top \mathbf{x}

f(x)=w⊤x中的权重向量的某个范数来度量其复杂性,例如

∥

w

∥

2

\| \mathbf{w} \|^2

∥w∥2。要保证权重向量比较小,最常用方法是将其范数作为惩罚项加到最小化损失的问题中。将原来的训练目标最小化训练标签上的预测损失,

调整为最小化预测损失和惩罚项之和。现在,如果权重向量增长的太大,学习算法可能会更集中于最小化权重范数

∥

w

∥

2

\| \mathbf{w} \|^2

∥w∥2。

线性回归的损失由下式给出:

L ( w , b ) = 1 n ∑ i = 1 n 1 2 ( w ⊤ x ( i ) + b − y ( i ) ) 2 . L(\mathbf{w}, b) = \frac{1}{n}\sum_{i=1}^n \frac{1}{2}\left(\mathbf{w}^\top \mathbf{x}^{(i)} + b - y^{(i)}\right)^2. L(w,b)=n1i=1∑n21(w⊤x(i)+b−y(i))2.

x

(

i

)

\mathbf{x}^{(i)}

x(i)是样本

i

i

i的特征,

y

(

i

)

y^{(i)}

y(i)是样本

i

i

i的标签,

(

w

,

b

)

(\mathbf{w}, b)

(w,b)是权重和偏置参数。为了惩罚权重向量的大小,必须以某种方式在损失函数中添加

∥

w

∥

2

\| \mathbf{w} \|^2

∥w∥2,

但是模型应该如何平衡这个新的额外惩罚的损失?实际上,我们正则化常数

λ

\lambda

λ来描述这种权衡,这是一个非负超参数,使用验证数据拟合:

L

(

w

,

b

)

+

λ

2

∥

w

∥

2

,

L(\mathbf{w}, b) + \frac{\lambda}{2} \|\mathbf{w}\|^2,

L(w,b)+2λ∥w∥2,

对于

λ

=

0

\lambda = 0

λ=0,恢复了原来的损失函数。对于

λ

>

0

\lambda > 0

λ>0,限制

∥

w

∥

\| \mathbf{w} \|

∥w∥的大小。这里仍然除以

2

2

2:当取一个二次函数的导数时,

2

2

2和

1

/

2

1/2

1/2会抵消,以确保更新表达式看起来既漂亮又简单。

使用平方范数而不是标准范数(即欧几里得距离)这样做是为了便于计算。通过平方

L

2

L_2

L2范数,去掉平方根,留下权重向量每个分量的平方和。这使得惩罚的导数很容易计算:导数的和等于和的导数。

L

2

L_2

L2正则化回归的小批量随机梯度下降更新如下式:

w ← ( 1 − η λ ) w − η ∣ B ∣ ∑ i ∈ B x ( i ) ( w ⊤ x ( i ) + b − y ( i ) ) . \begin{aligned} \mathbf{w} & \leftarrow \left(1- \eta\lambda \right) \mathbf{w} - \frac{\eta}{|\mathcal{B}|} \sum_{i \in \mathcal{B}} \mathbf{x}^{(i)} \left(\mathbf{w}^\top \mathbf{x}^{(i)} + b - y^{(i)}\right). \end{aligned} w←(1−ηλ)w−∣B∣ηi∈B∑x(i)(w⊤x(i)+b−y(i)).

线性回归权重衰减代码实现

%matplotlib inline

import torch

from torch import nn

from d2l import torch as d2l

生成一些数据生成公式如下:

y = 0.05 + ∑ i = 1 d 0.01 x i + ϵ where ϵ ∼ N ( 0 , 0.0 1 2 ) . y = 0.05 + \sum_{i = 1}^d 0.01 x_i + \epsilon \text{ where } \epsilon \sim \mathcal{N}(0, 0.01^2). y=0.05+i=1∑d0.01xi+ϵ where ϵ∼N(0,0.012).

标签是关于输入的线性函数。标签同时被均值为0,标准差为0.01高斯噪声破坏。为了使过拟合的效果更加明显,将问题的维数增加到 d = 200 d = 200 d=200,并使用一个只包含20个样本的小训练集。

n_train, n_test, num_inputs, batch_size = 20, 100, 200, 5

true_w, true_b = torch.ones((num_inputs, 1)) * 0.01, 0.05 #真实w,b

train_data = d2l.synthetic_data(true_w, true_b, n_train) # 生成训练集

train_iter = d2l.load_array(train_data, batch_size) # 读取训练集

test_data = d2l.synthetic_data(true_w, true_b, n_test) #生成测试集

test_iter = d2l.load_array(test_data, batch_size, is_train=False) #读取测试集

初始化模型参数

def init_params():

w = torch.normal(0, 1, size=(num_inputs, 1), requires_grad=True) # w均值为0,方差为1,长度200的张量

b = torch.zeros(1, requires_grad=True)

return [w, b]

定义 𝐿 2 𝐿_2 L2 范数惩罚

def l2_penalty(w):

return torch.sum(w.pow(2)) / 2

训练

def train(lambd): # 输出超参数lambd

w, b = init_params()

net, loss = lambda X: d2l.linreg(X, w, b), d2l.squared_loss # 线性回归,平方损失函数

num_epochs, lr = 500, 0.003

animator = d2l.Animator(xlabel='epochs', ylabel='loss', yscale='log',

xlim=[5, num_epochs], legend=['train', 'test'])

for epoch in range(num_epochs):

for X, y in train_iter:

# 增加了L2范数惩罚项,

# 广播机制使l2_penalty(w)成为一个长度为batch_size的向量

l = loss(net(X), y) + lambd * l2_penalty(w) # 加上惩罚项的损失

l.sum().backward()

d2l.sgd([w, b], lr, batch_size)

if (epoch + 1) % 5 == 0:

animator.add(epoch + 1, (d2l.evaluate_loss(net, train_iter, loss),

d2l.evaluate_loss(net, test_iter, loss)))

print('w的L2范数是:', torch.norm(w).item())

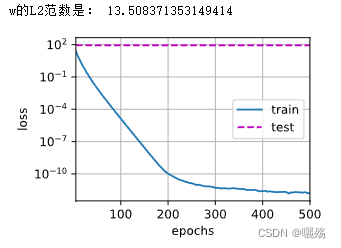

忽略正则化直接训练

train(lambd=0)

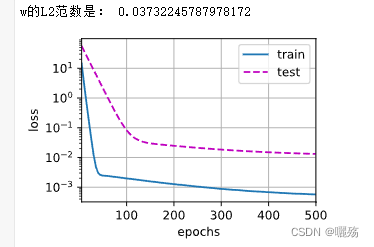

使用权重衰减

train(lambd=3)

简洁实现

def train_concise(wd):

net = nn.Sequential(nn.Linear(num_inputs, 1))

for param in net.parameters():

param.data.normal_()

loss = nn.MSELoss(reduction='none')

num_epochs, lr = 100, 0.003

# 偏置参数没有衰减

trainer = torch.optim.SGD([

{"params":net[0].weight,'weight_decay': wd},

{"params":net[0].bias}], lr=lr)

animator = d2l.Animator(xlabel='epochs', ylabel='loss', yscale='log',

xlim=[5, num_epochs], legend=['train', 'test'])

for epoch in range(num_epochs):

for X, y in train_iter:

trainer.zero_grad()

l = loss(net(X), y)

l.mean().backward()

trainer.step()

if (epoch + 1) % 5 == 0:

animator.add(epoch + 1,

(d2l.evaluate_loss(net, train_iter, loss),

d2l.evaluate_loss(net, test_iter, loss)))

print('w的L2范数:', net[0].weight.norm().item())

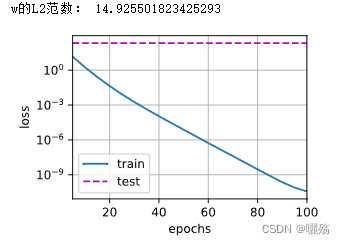

没使用权重衰减

train_concise(0)

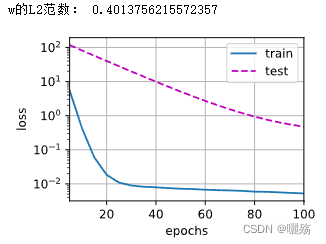

使用权重衰减

train_concise(3)

398

398

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?