问题描述

hdfs格式化命令第一次启动的时候进行格式化即可,后续如果重复格式化会出现datanode启动失败的问题

原因分析

在hadfs-site.xml配置中指定了hdfs运行时产生的存储目录

<property>

<name>hadoop.data.dir</name>

<value>/opt/module/hadoop-3.1.3/data<value>

</property>

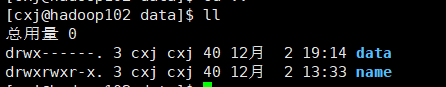

对于配置了namenode的节点上,会在该目录产生上述配置的节点目录,本次配置的是name目录进行,并且对于其他节点上配置datanode就会产生本次配置的data目录,如下:

其下current目录下的文件VERSION,该文件存储相应的版本信息

storageID=DS-8a712acb-de88-4736-ad39-b5f9ac94bbfa

clusterID=CID-622407ad-be8b-47e6-b07d-853c89884476

cTime=0

datanodeUuid=6b59207c-1dcd-49f4-ba05-b4453e2293a5

storageType=DATA_NODE

layoutVersion=-57

其中clusterID字段就是集群的id,namenode管理的dataname对应的data目录下也是存在clusterID字段,跟管理他的namenode是一致的,重复格式化就是会datanode找不到管理他的namenode从而导致启动失败

问题解决

只要删除配置的hdfs对应的存储目录就可以了,上述就是删除/opt/module/hadoop-3.1.3/data

扩展

配置参考:Hadoop学习4:集群配置与测试

4253

4253

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?