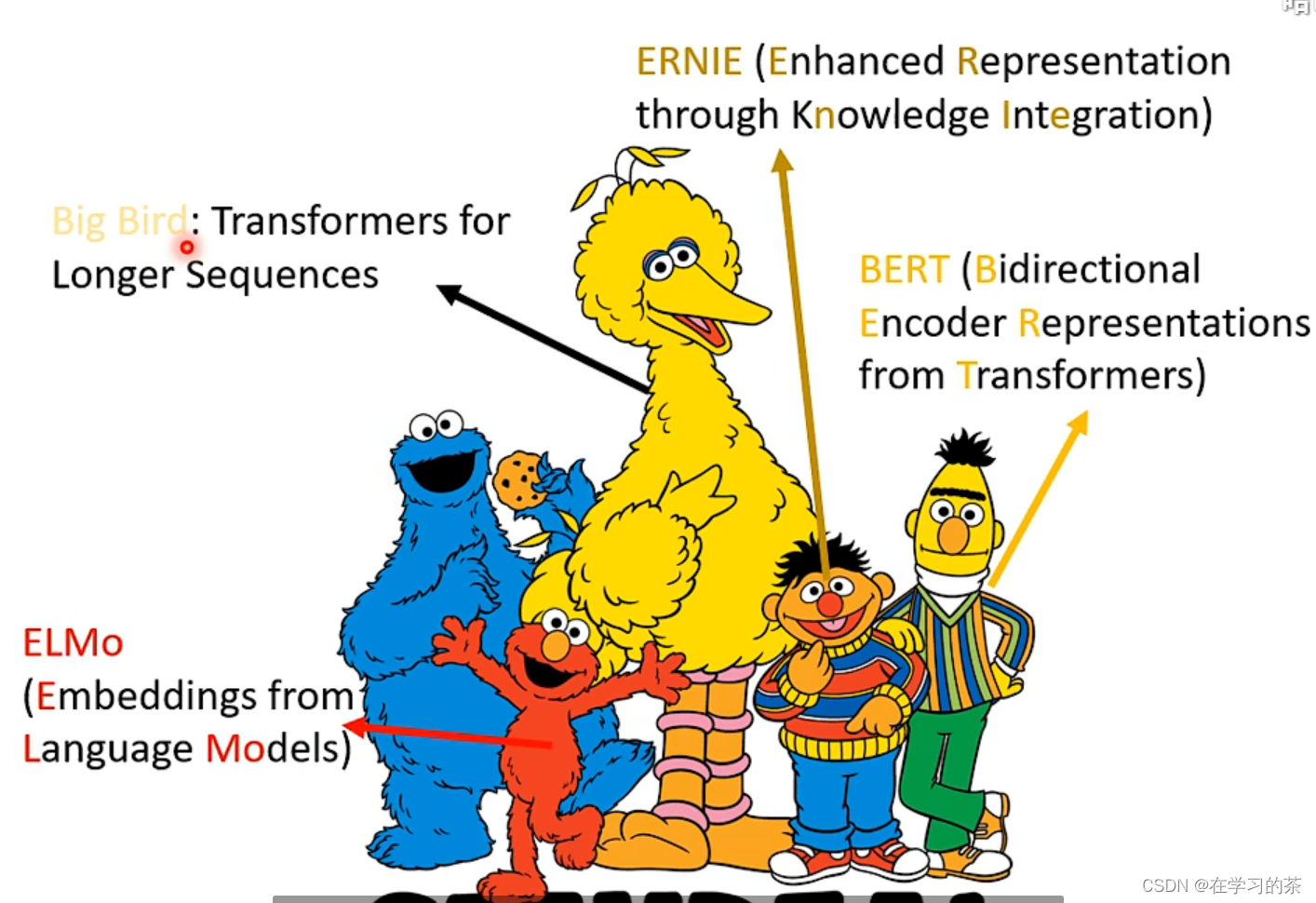

BERT

Self-supervised Model

dan

dan

芝麻街模型呜呜呜

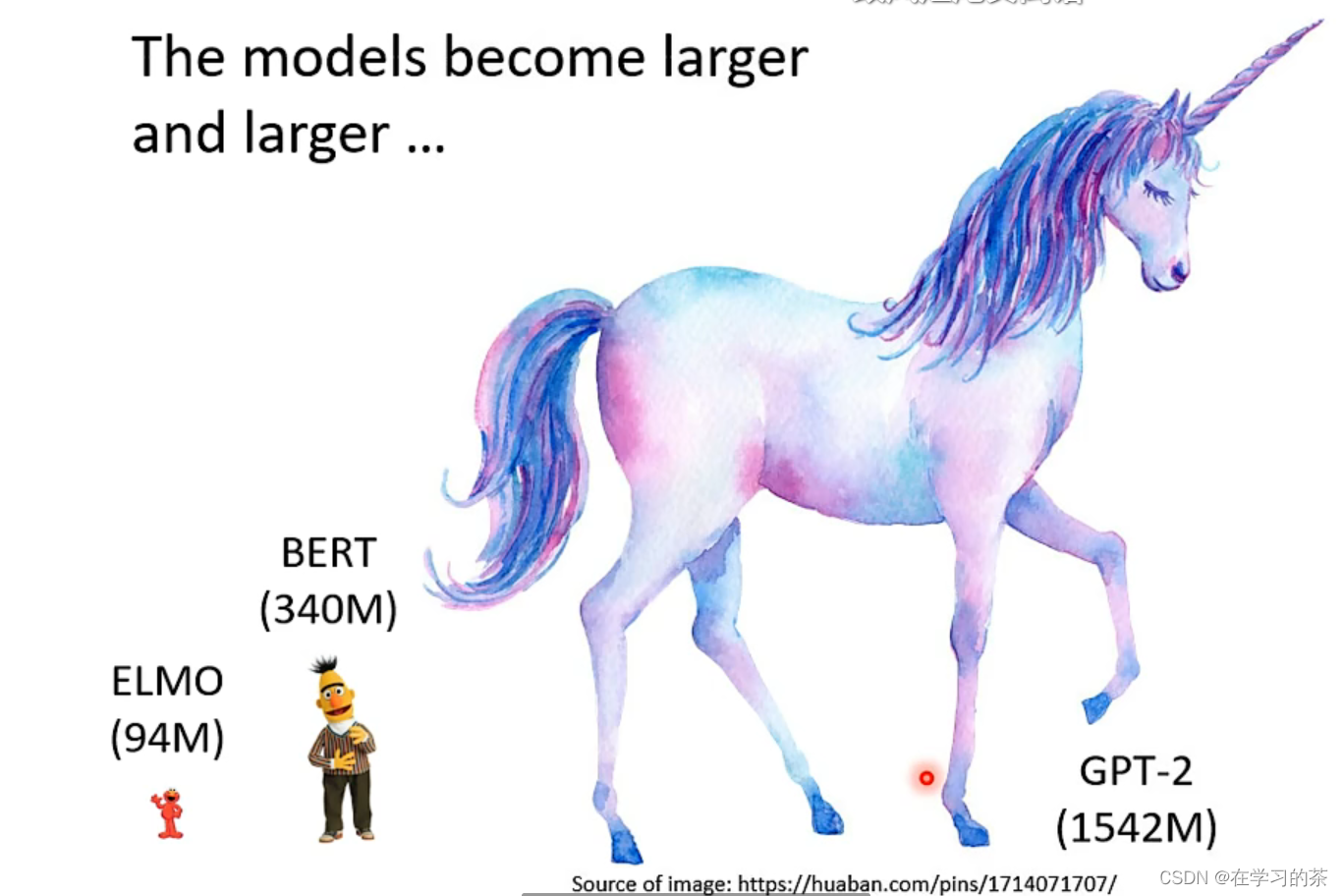

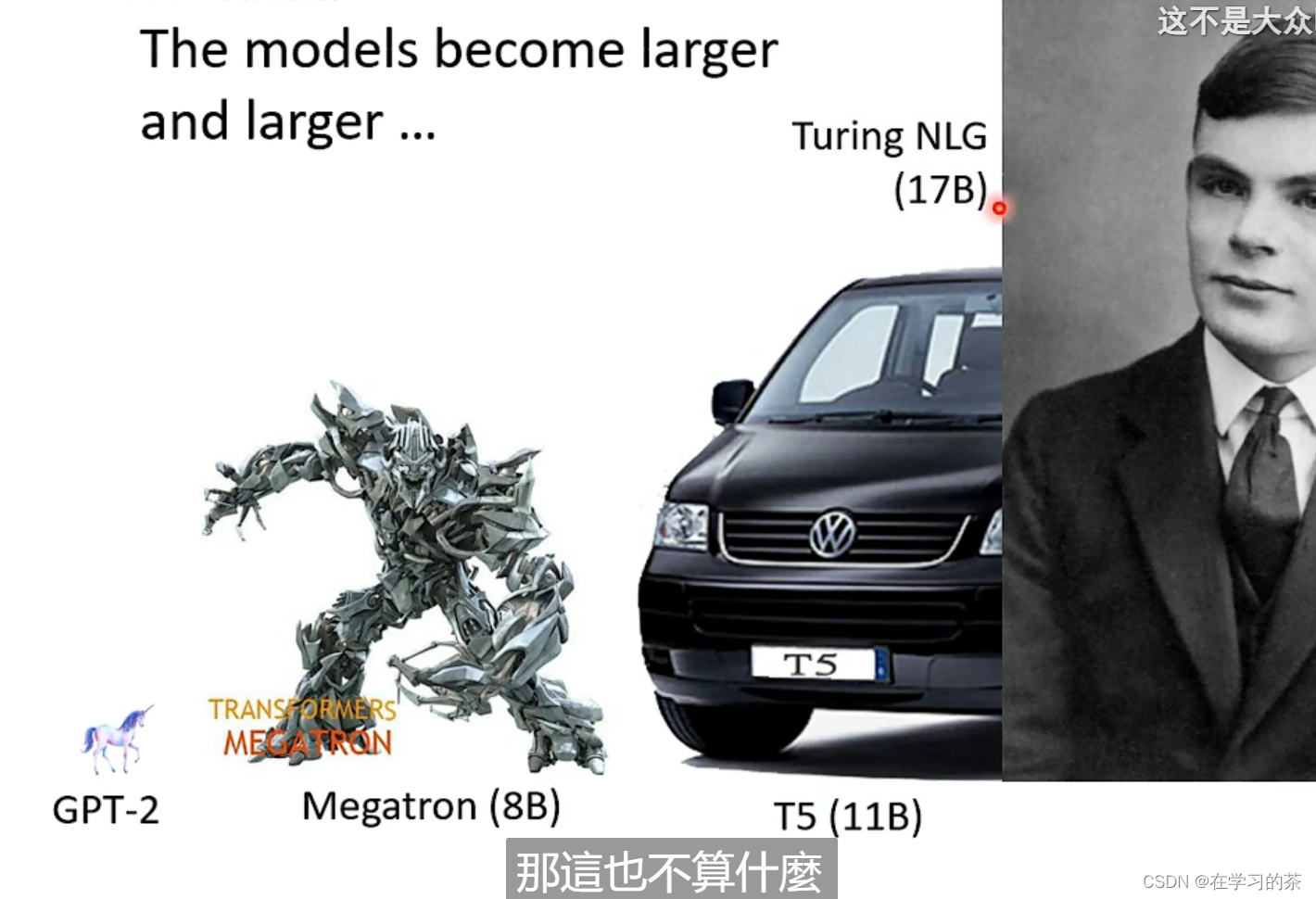

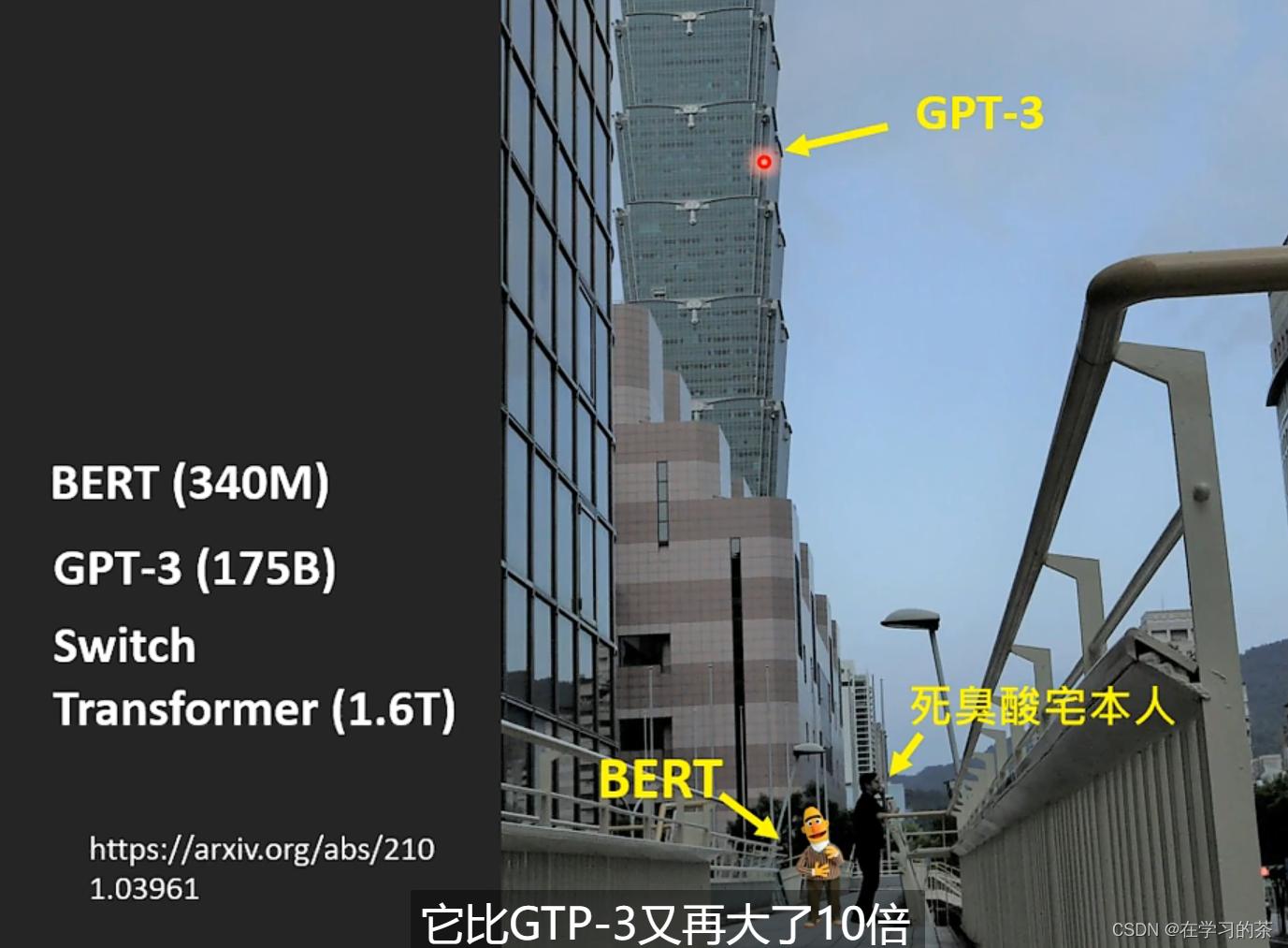

BERT有3.4亿个参数,非常大

但是!

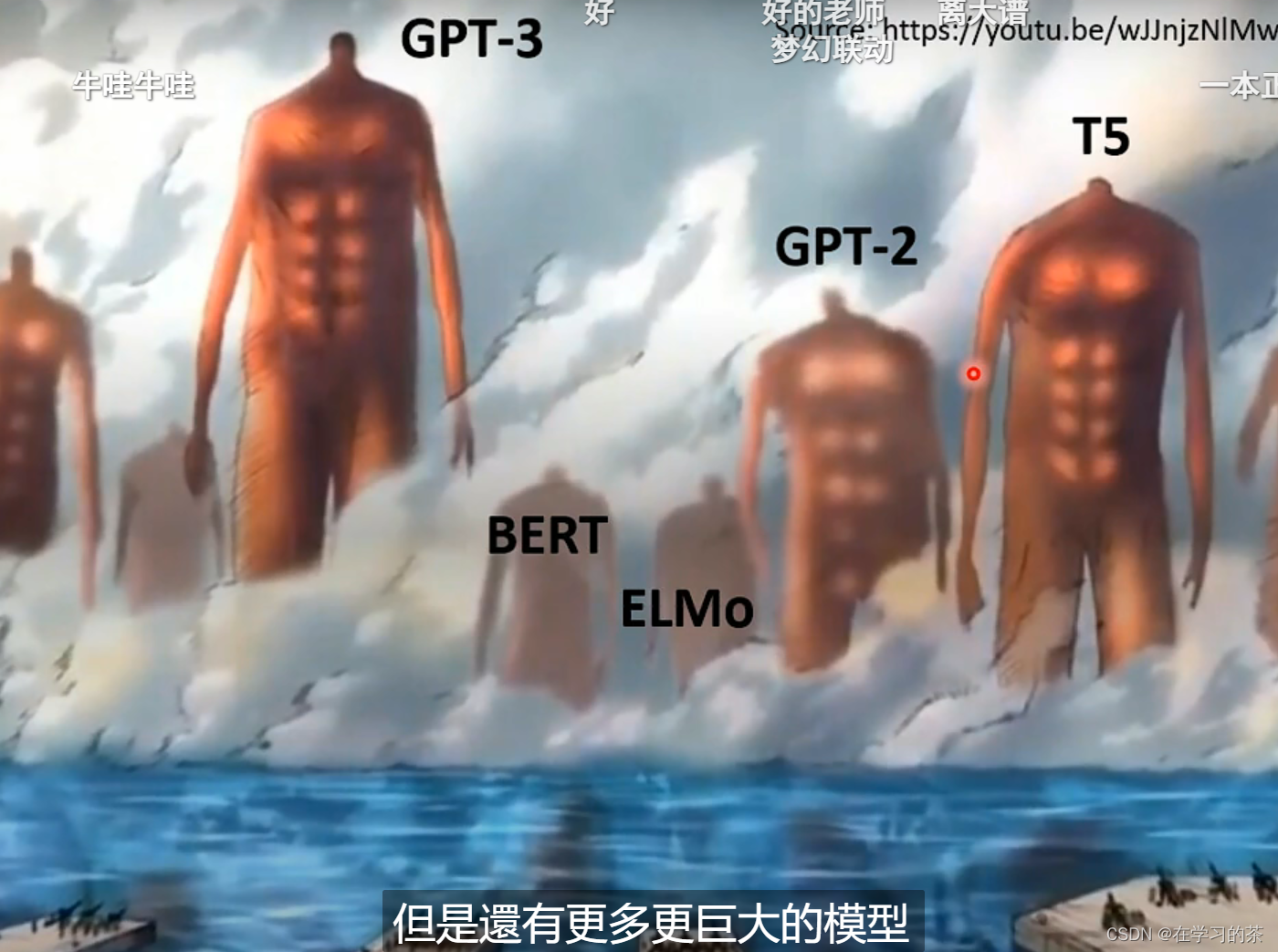

太大了卧槽

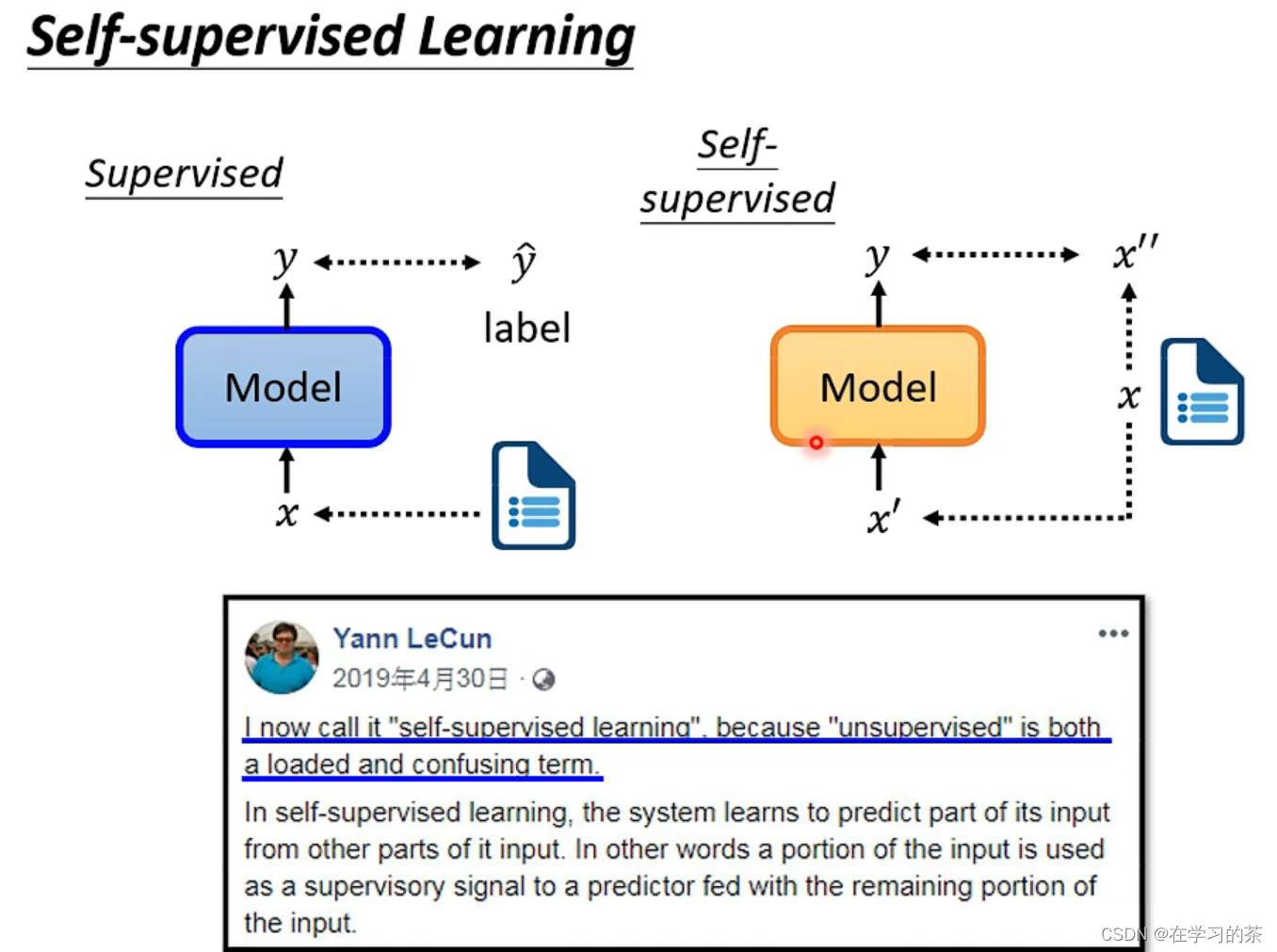

Supervised-Learning & Self-Supervised Learning

自监督学习核心思想是,把样本分成两份,一份作为label,一份作为training data

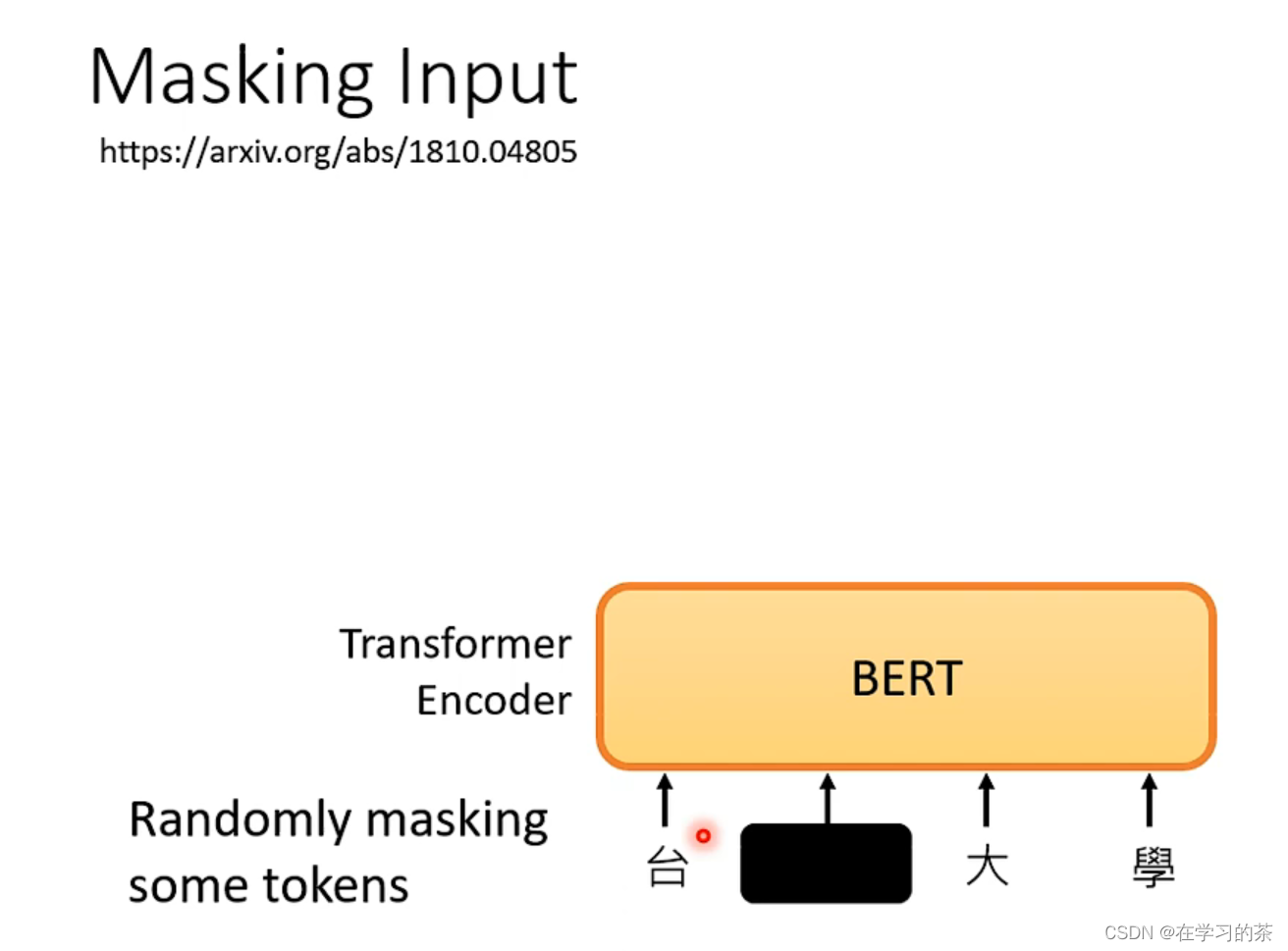

BERT就是Transformer的Encoder,输入一个Vector,输出一个Vector,一般用于NLP,但是语音、图片仍然可以用,在研究阶段

牛逼的是我们在输入时,会随机的盖住一些Input

当然这个盖的操作有如下两种

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?