目录

循环神经网络

到目前为止,我们遇到过两种类型的数据:表格数据和图像数据。 对于图像数据,我们设计了专门的卷积神经网络架构来为这类特殊的数据结构建模。如果说卷积神经网络可以有效地处理空间信息, 那么本章的循环神经网络(recurrent neural network,RNN)则可以更好地处理序列信息。 循环神经网络通过引入状态变量存储过去的信息和当前的输入,从而可以确定当前的输出。

序列模型

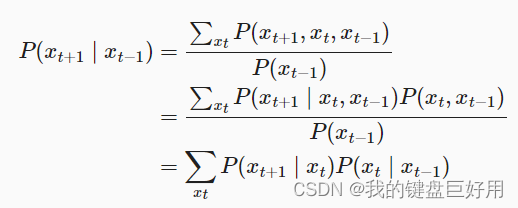

统计工具

自回归模型

隐变量自回归模型

马尔科夫模型

因果关系

训练

预测

- 内插法(在现有观测值之间进行估计)和外推法(对超出已知观测范围进行预测)在实践的难度上差别很大。因此,对于所拥有的序列数据,在训练时始终要尊重其时间顺序,即最好不要基于未来的数据进行训练。

- 序列模型的估计需要专门的统计工具,两种较流行的选择是自回归模型和隐变量自回归模型。

- 对于时间是向前推进的因果模型,正向估计通常比反向估计更容易。

- 对于直到时间步t的观测序列,其在时间步t+k的预测输出是“k步预测”。随着我们对预测时间k值的增加,会造成误差的快速累积和预测质量的极速下降。

文本预处理

解析文本的常见预处理步骤。 这些步骤通常包括:

- 将文本作为字符串加载到内存中。

- 将字符串拆分为词元(如单词和字符)。

- 建立一个词表,将拆分的词元映射到数字索引。

- 将文本转换为数字索引序列,方便模型操作。

读取数据集

词元化

个文本序列又被拆分成一个词元列表,词元(token)是文本的基本单位。

词表

整合所有功能

- 文本是序列数据的一种最常见的形式之一。

- 为了对文本进行预处理,我们通常将文本拆分为词元,构建词表将词元字符串映射为数字索引,并将文本数据转换为词元索引以供模型操作。

语言模型和数据集

学习语言模型

马尔可夫模型与n元语法

自然语言统计

读取长序列数据

当序列变得太长而不能被模型一次性全部处理时, 我们可能希望拆分这样的序列方便模型读取。

随机采样

顺序分区

- 语言模型是自然语言处理的关键。

- n元语法通过截断相关性,为处理长序列提供了一种实用的模型。

- 长序列存在一个问题:它们很少出现或者从不出现。

- 齐普夫定律支配着单词的分布,这个分布不仅适用于一元语法,还适用于其他n元语法。

- 通过拉普拉斯平滑法可以有效地处理结构丰富而频率不足的低频词词组。

- 读取长序列的主要方式是随机采样和顺序分区。在迭代过程中,后者可以保证来自两个相邻的小批量中的子序列在原始序列上也是相邻的。

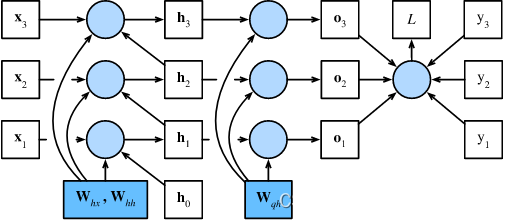

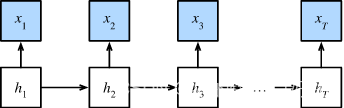

循环神经网络

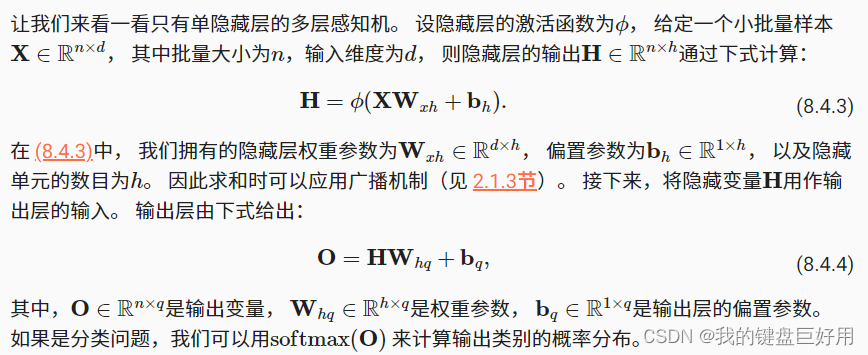

无隐状态的神经网络

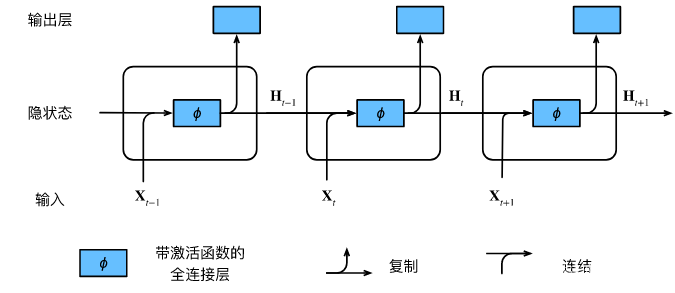

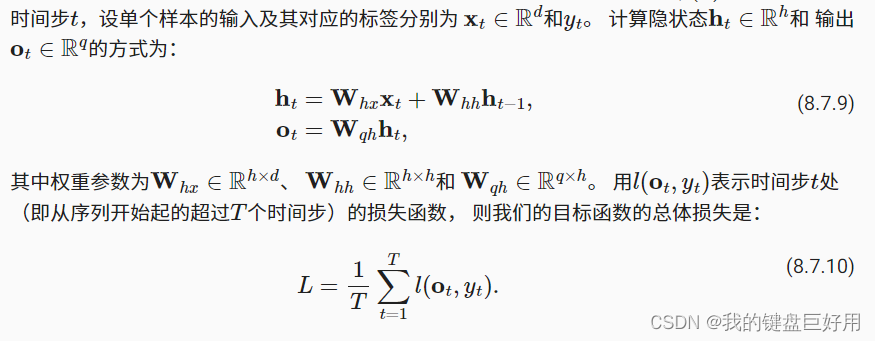

有隐状态的循环神经网络

具有隐状态的循环神经网络

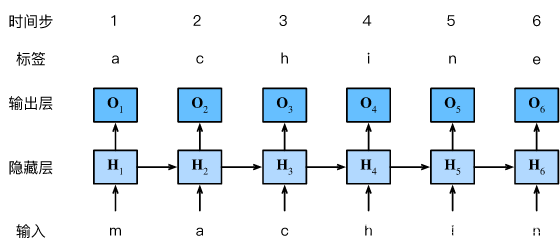

基于循环神经网络的字符级语言模型

基于循环神经网络的字符级语言模型:输入序列和标签序列分别为“machin”和“achine”

困惑度(Perplexity)

- 在最好的情况下,模型总是完美地估计标签词元的概率为1。 在这种情况下,模型的困惑度为1。

- 在最坏的情况下,模型总是预测标签词元的概率为0。 在这种情况下,困惑度是正无穷大。

- 在基线上,该模型的预测是词表的所有可用词元上的均匀分布。 在这种情况下,困惑度等于词表中唯一词元的数量。 事实上,如果我们在没有任何压缩的情况下存储序列, 这将是我们能做的最好的编码方式。 因此,这种方式提供了一个重要的上限, 而任何实际模型都必须超越这个上限。

小结

- 对隐状态使用循环计算的神经网络称为循环神经网络(RNN)。

- 循环神经网络的隐状态可以捕获直到当前时间步序列的历史信息。

- 循环神经网络模型的参数数量不会随着时间步的增加而增加。

- 我们可以使用循环神经网络创建字符级语言模型。

- 我们可以使用困惑度来评价语言模型的质量。

循环神经网络的从零开始实现

独热编码

我们通常将每个词元表示为更具表现力的特征向量。 最简单的表示称为独热编码(one-hot encoding)。

初始化模型参数

循环神经网络模型

预测

梯度裁剪

训练

- 序列数据的不同采样方法(随机采样和顺序分区)将导致隐状态初始化的差异。

- 我们在更新模型参数之前裁剪梯度。 这样的操作的目的是,即使训练过程中某个点上发生了梯度爆炸,也能保证模型不会发散。

- 我们用困惑度来评价模型, 这样的度量确保了不同长度的序列具有可比性。

小结

- 我们可以训练一个基于循环神经网络的字符级语言模型,根据用户提供的文本的前缀生成后续文本。

- 一个简单的循环神经网络语言模型包括输入编码、循环神经网络模型和输出生成。

- 循环神经网络模型在训练以前需要初始化状态,不过随机抽样和顺序划分使用初始化方法不同。

- 当使用顺序划分时,我们需要分离梯度以减少计算量。

- 在进行任何预测之前,模型通过预热期进行自我更新(例如,获得比初始值更好的隐状态)。

- 梯度裁剪可以防止梯度爆炸,但不能应对梯度消失。

循环神经网络的简洁实现

定义模型

训练与预测

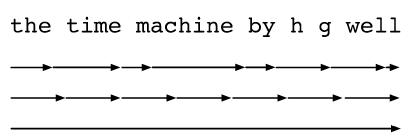

通过时间反向传播

循环神经网络的梯度分析

完全计算

这样的计算非常缓慢,并且可能会发生梯度爆炸, 因为初始条件的微小变化就可能会对结果产生巨大的影响。 也就是说,我们可以观察到类似于蝴蝶效应的现象, 即初始条件的很小变化就会导致结果发生不成比例的变化。

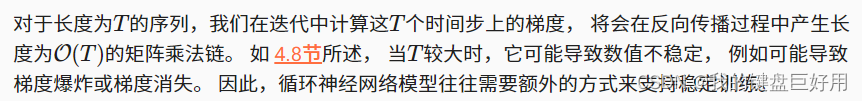

截断时间步

这样做导致该模型主要侧重于短期影响,而不是长期影响。 这在现实中是可取的,因为它会将估计值偏向更简单和更稳定的模型。

随机截断

比较策略

比较RNN中计算梯度的策略,3行自上而下分别为:随机截断、常规截断、完整计算

- 第一行采用随机截断,方法是将文本划分为不同长度的片断;

- 第二行采用常规截断,方法是将文本分解为相同长度的子序列。 这也是我们在循环神经网络实验中一直在做的;

- 第三行采用通过时间的完全反向传播,结果是产生了在计算上不可行的表达式。

通过时间反向传播的细节

上图表示具有三个时间步的循环神经网络模型依赖关系的计算图。未着色的方框表示变量,着色的方框表示参数,圆表示运算符

小结

- “通过时间反向传播”仅仅适用于反向传播在具有隐状态的序列模型。

- 截断是计算方便性和数值稳定性的需要。截断包括:规则截断和随机截断。

- 矩阵的高次幂可能导致神经网络特征值的发散或消失,将以梯度爆炸或梯度消失的形式表现。

- 为了计算的效率,“通过时间反向传播”在计算期间会缓存中间值。

现代循环神经网络

循环神经网络在实践中一个常见问题是数值不稳定性。

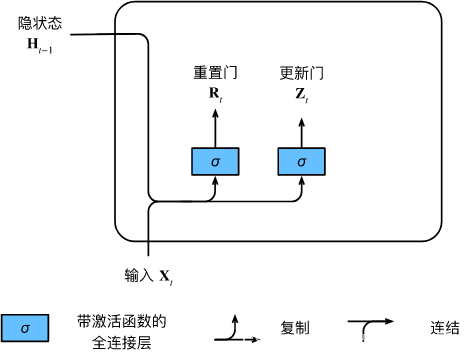

门控循环单元(GRU)

门控循环单元与普通的循环神经网络之间的关键区别在于: 前者支持隐状态的门控。 这意味着模型有专门的机制来确定应该何时更新隐状态, 以及应该何时重置隐状态。

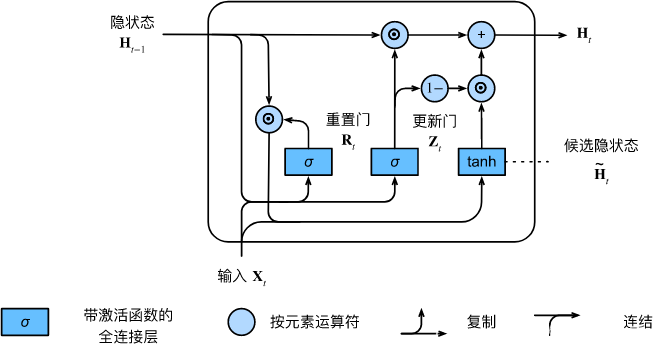

重置门和更新门

在门控循环单元模型中计算重置门和更新门

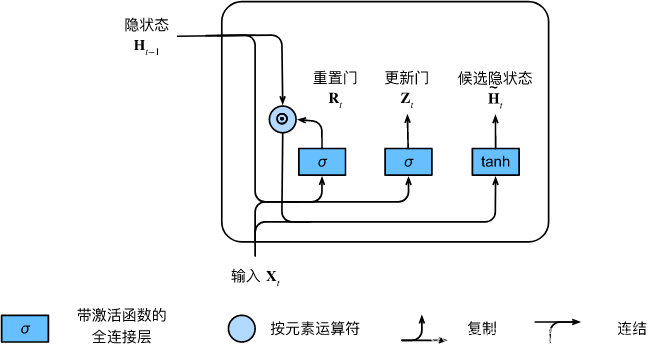

候选隐状态

在门控循环单元模型中计算候选隐状态

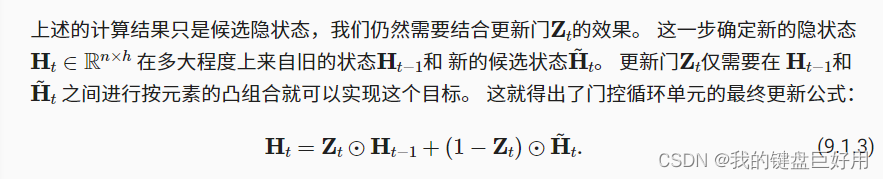

隐状态

计算门控循环单元模型中的隐状态

门控循环单元具有以下两个显著特征:

-

重置门有助于捕获序列中的短期依赖关系;

-

更新门有助于捕获序列中的长期依赖关系。

从零开始实现

初始化模型参数

定义模型

训练与预测

简洁实现

小结

- 门控循环神经网络可以更好地捕获时间步距离很长的序列上的依赖关系。

- 重置门有助于捕获序列中的短期依赖关系。

- 更新门有助于捕获序列中的长期依赖关系。

- 重置门打开时,门控循环单元包含基本循环神经网络;更新门打开时,门控循环单元可以跳过子序列。

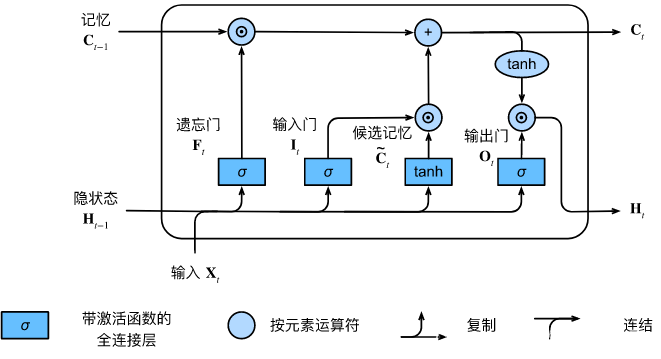

长短期记忆网络(LSTM)

隐变量模型存在着长期信息保存和短期输入缺失的问题。 解决这一问题的最早方法之一是长短期存储器(long short-term memory,LSTM)

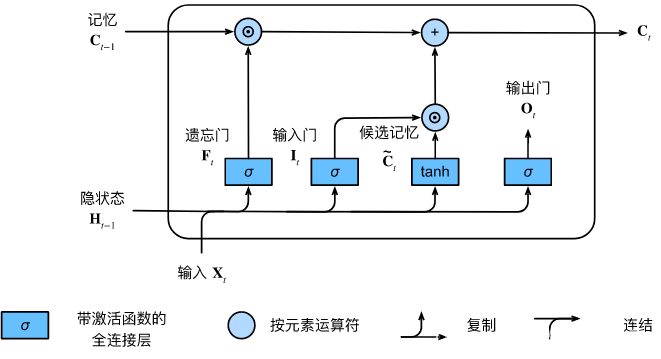

门控记忆元

记忆元,输出门,输入门,遗忘门。

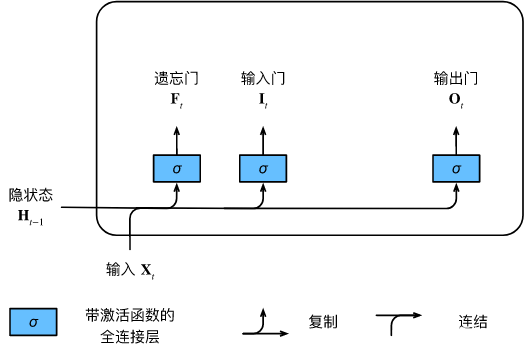

输入门、忘记门和输出门

长短期记忆模型中的输入门、遗忘门和输出门

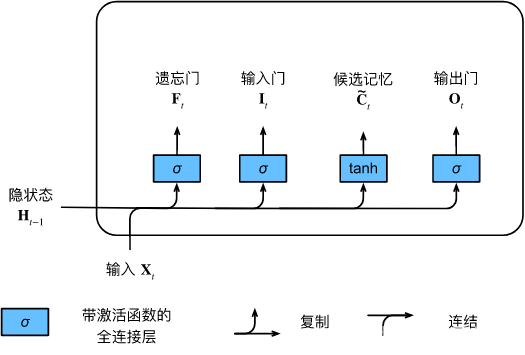

候选记忆元

长短期记忆模型中的候选记忆元

记忆元

在长短期记忆网络模型中计算记忆元

隐状态

在长短期记忆模型中计算隐状态

从零开始实现

初始化模型参数

定义模型

训练和预测

简洁实现

小结

- 长短期记忆网络有三种类型的门:输入门、遗忘门和输出门。

- 长短期记忆网络的隐藏层输出包括“隐状态”和“记忆元”。只有隐状态会传递到输出层,而记忆元完全属于内部信息。

- 长短期记忆网络可以缓解梯度消失和梯度爆炸。

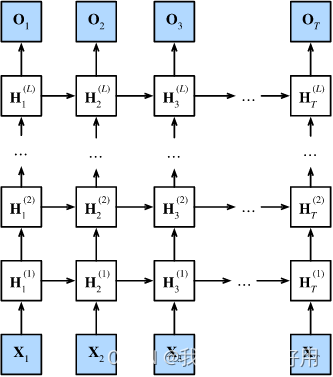

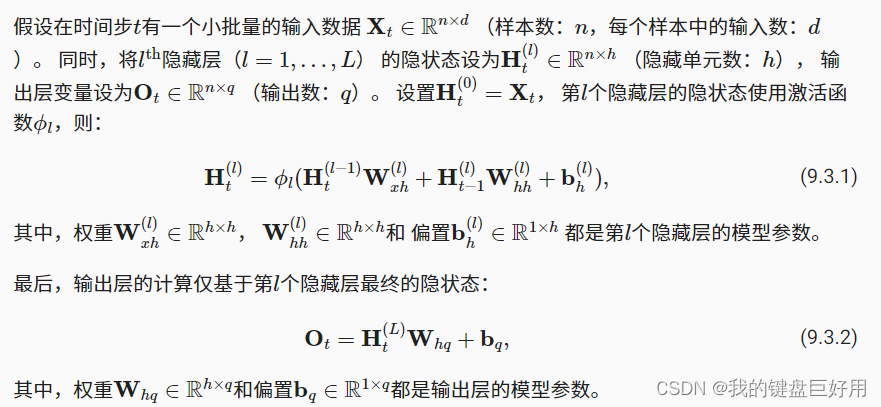

深度循环神经网络

深度循环神经网络结构

函数依赖关系

简洁实现

训练与预测

小结

- 在深度循环神经网络中,隐状态的信息被传递到当前层的下一时间步和下一层的当前时间步。

- 有许多不同风格的深度循环神经网络, 如长短期记忆网络、门控循环单元、或经典循环神经网络。 这些模型在深度学习框架的高级API中都有涵盖。

- 总体而言,深度循环神经网络需要大量的调参(如学习率和修剪) 来确保合适的收敛,模型的初始化也需要谨慎。

双向循环神经网络

隐马尔科夫模型中的动态规划

隐马尔可夫模型

双向模型

双向循环神经网络架构

定义

模型的计算代价及其应用

双向循环神经网络的一个关键特性是:使用来自序列两端的信息来估计输出。 也就是说,我们使用来自过去和未来的观测信息来预测当前的观测。

双向循环神经网络的计算速度非常慢。 其主要原因是网络的前向传播需要在双向层中进行前向和后向递归, 并且网络的反向传播还依赖于前向传播的结果。 因此,梯度求解将有一个非常长的链。

双向层的使用在实践中非常少,并且仅仅应用于部分场合。

双向循环神经网络的错误应用

小结

- 在双向循环神经网络中,每个时间步的隐状态由当前时间步的前后数据同时决定。

- 双向循环神经网络与概率图模型中的“前向-后向”算法具有相似性。

- 双向循环神经网络主要用于序列编码和给定双向上下文的观测估计。

- 由于梯度链更长,因此双向循环神经网络的训练代价非常高。

机器翻译与数据集

下载和预处理数据集

词元化

词表

加载数据集

训练模型

小结

- 机器翻译指的是将文本序列从一种语言自动翻译成另一种语言。

- 使用单词级词元化时的词表大小,将明显大于使用字符级词元化时的词表大小。为了缓解这一问题,我们可以将低频词元视为相同的未知词元。

- 通过截断和填充文本序列,可以保证所有的文本序列都具有相同的长度,以便以小批量的方式加载。

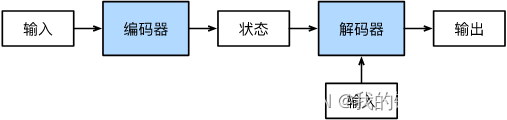

编码器-解码器架构

编码器

解码器

合并编码器和解码器

小结

- “编码器-解码器”架构可以将长度可变的序列作为输入和输出,因此适用于机器翻译等序列转换问题。

- 编码器将长度可变的序列作为输入,并将其转换为具有固定形状的编码状态。

- 解码器将具有固定形状的编码状态映射为长度可变的序列。

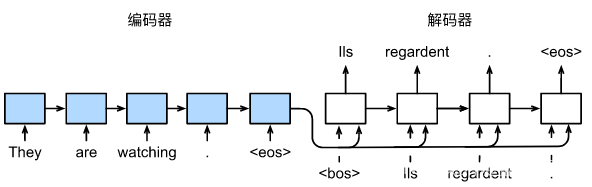

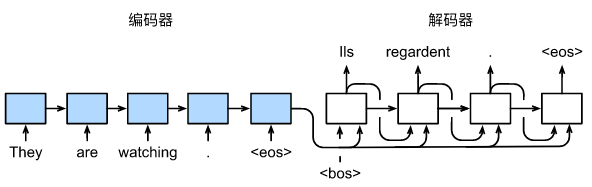

序列到序列学习(seq2seq)

使用循环神经网络编码器和循环神经网络解码器的序列到序列学习

编码器

解码器

循环神经网络编码器-解码器模型中的层

损失函数

训练

预测

使用循环神经网络编码器-解码器逐词元地预测输出序列。

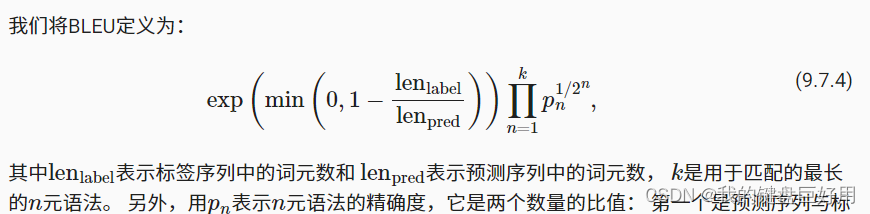

预测序列的评估

小结

- 根据“编码器-解码器”架构的设计, 我们可以使用两个循环神经网络来设计一个序列到序列学习的模型。

- 在实现编码器和解码器时,我们可以使用多层循环神经网络。

- 我们可以使用遮蔽来过滤不相关的计算,例如在计算损失时。

- 在“编码器-解码器”训练中,强制教学方法将原始输出序列(而非预测结果)输入解码器。

- BLEU是一种常用的评估方法,它通过测量预测序列和标签序列之间的元语法的匹配度来评估预测。

束搜索

贪心搜索

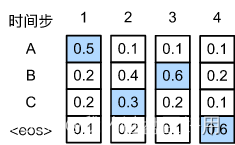

在每个时间步,贪心搜索选择具有最高条件概率的词元

在时间步2,选择具有第二高条件概率的词元“C”(而非最高条件概率的词元)

穷举搜索

如果目标是获得最优序列, 我们可以考虑使用穷举搜索(exhaustive search): 穷举地列举所有可能的输出序列及其条件概率, 然后计算输出条件概率最高的一个。

束搜索

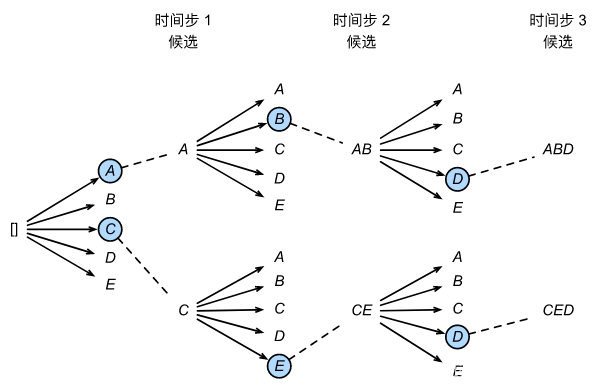

束搜索过程(束宽:2,输出序列的最大长度:3)。候选输出序列是A、C、AB、CE、ABD和CED

小结

- 序列搜索策略包括贪心搜索、穷举搜索和束搜索。

- 贪心搜索所选取序列的计算量最小,但精度相对较低。

- 穷举搜索所选取序列的精度最高,但计算量最大。

- 束搜索通过灵活选择束宽,在正确率和计算代价之间进行权衡

注意力机制

课后补充

3047

3047

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?