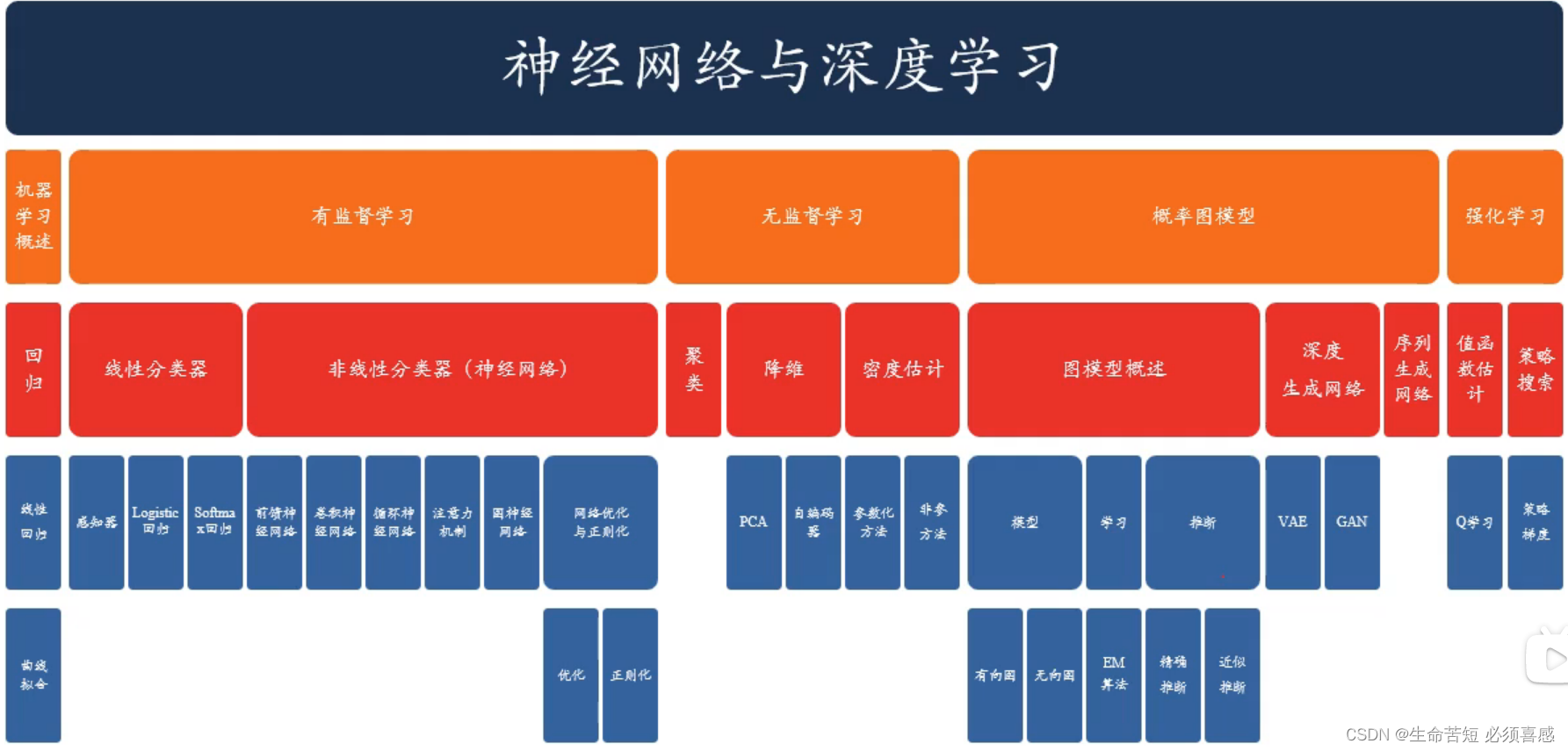

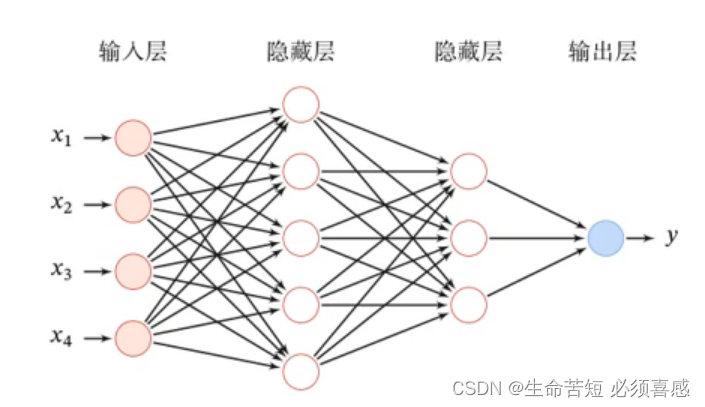

整体架构图:

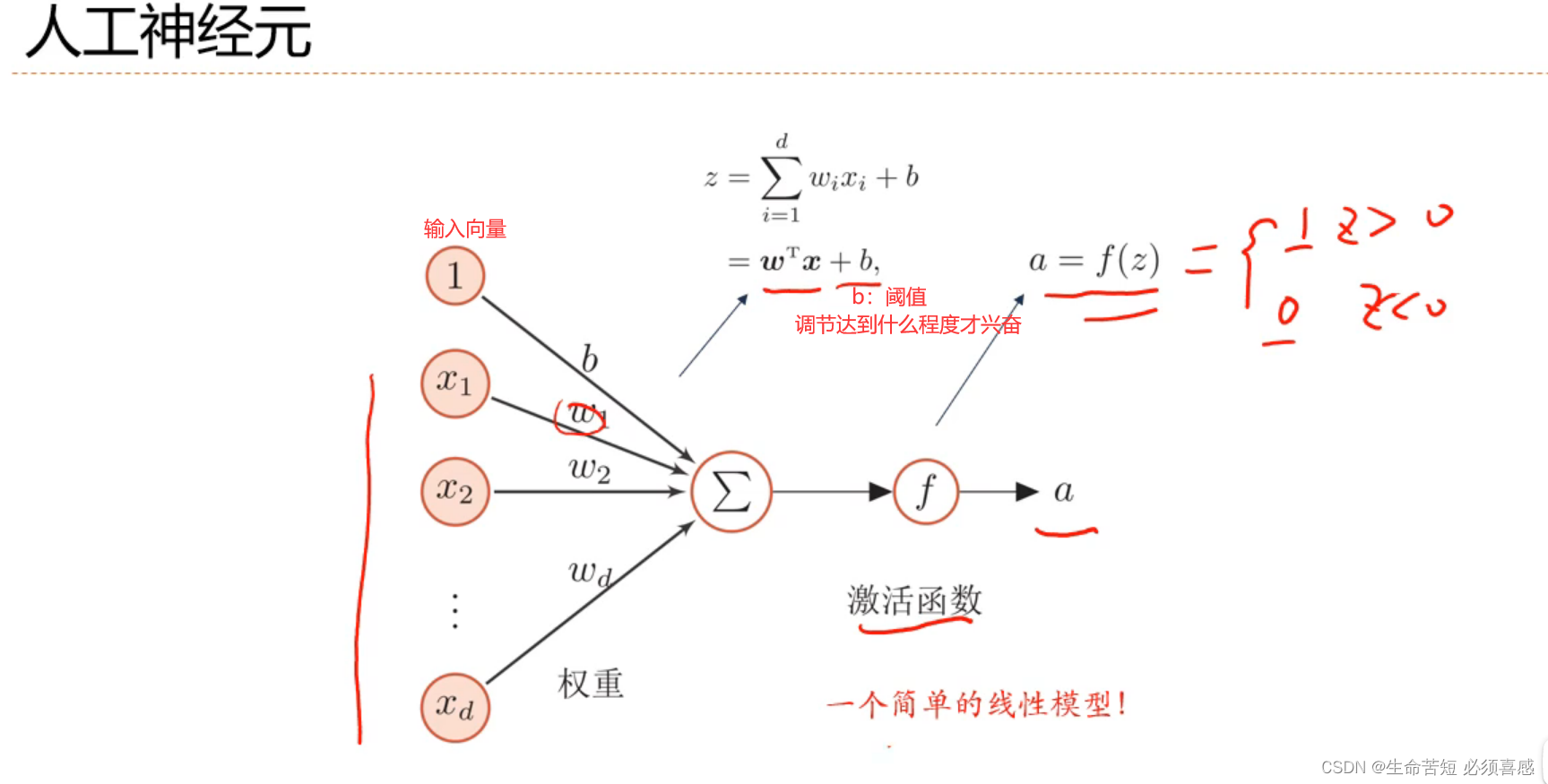

神经元:

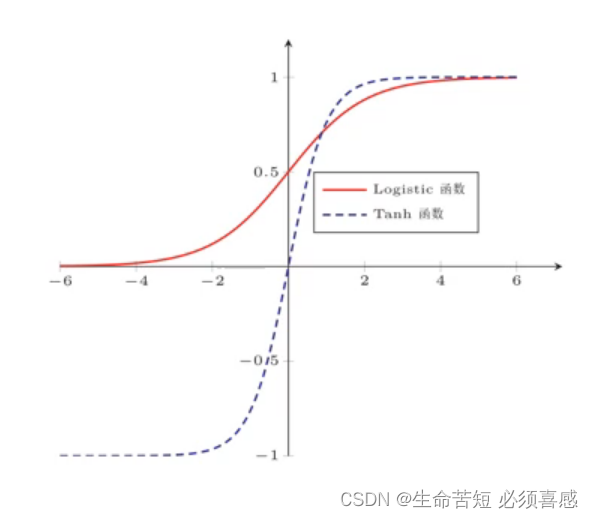

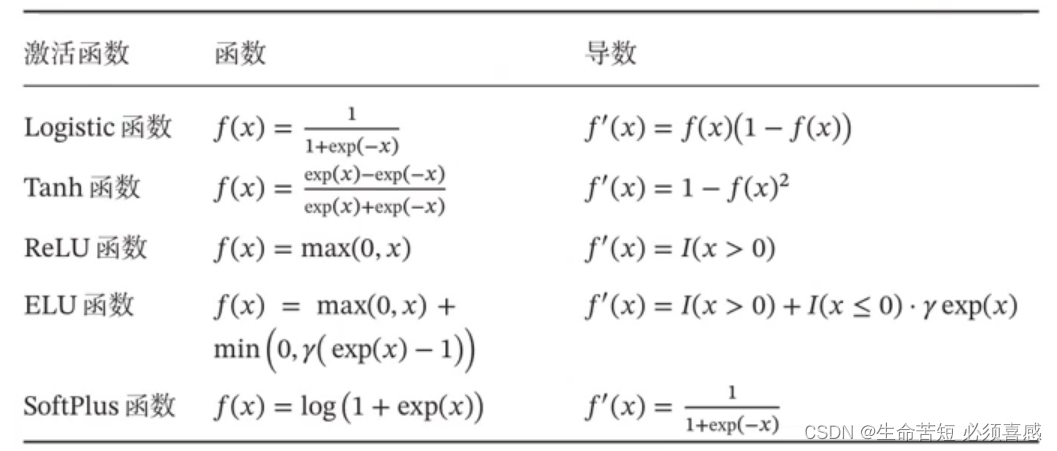

常见的激活函数: S型函数–Sigmoid Function

Tanh函数是零中心化的,而logistic函数的输出恒大于0。

非零中心化的输出会使得其后一层的神经元的输入发生偏置偏移(bias shift),并进一步使得梯度下降的收敛速度变慢。

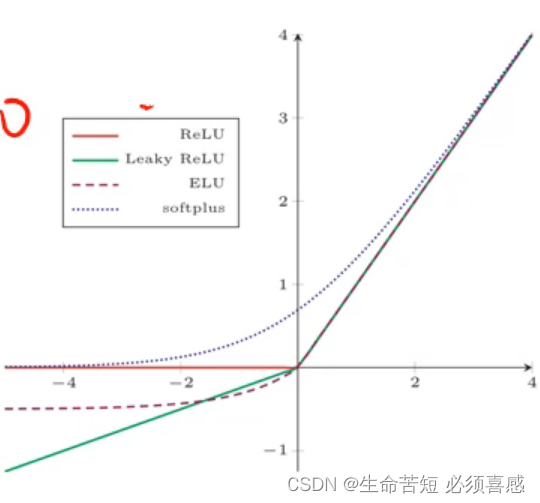

斜坡函数–Ramp Function

计算上更加高效。生物学合理性:单侧抑制,宽兴奋边界。在一定程度上缓解梯度消失问题。

复合函数–Compound Function

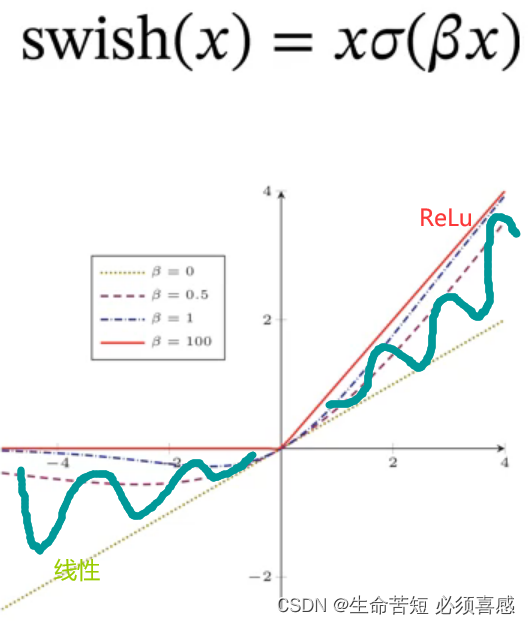

Swish函数:一种自门控(Self-Gated)激活函数

Logistic函数的定义:sigma(x)=1/(1+exp{-x})

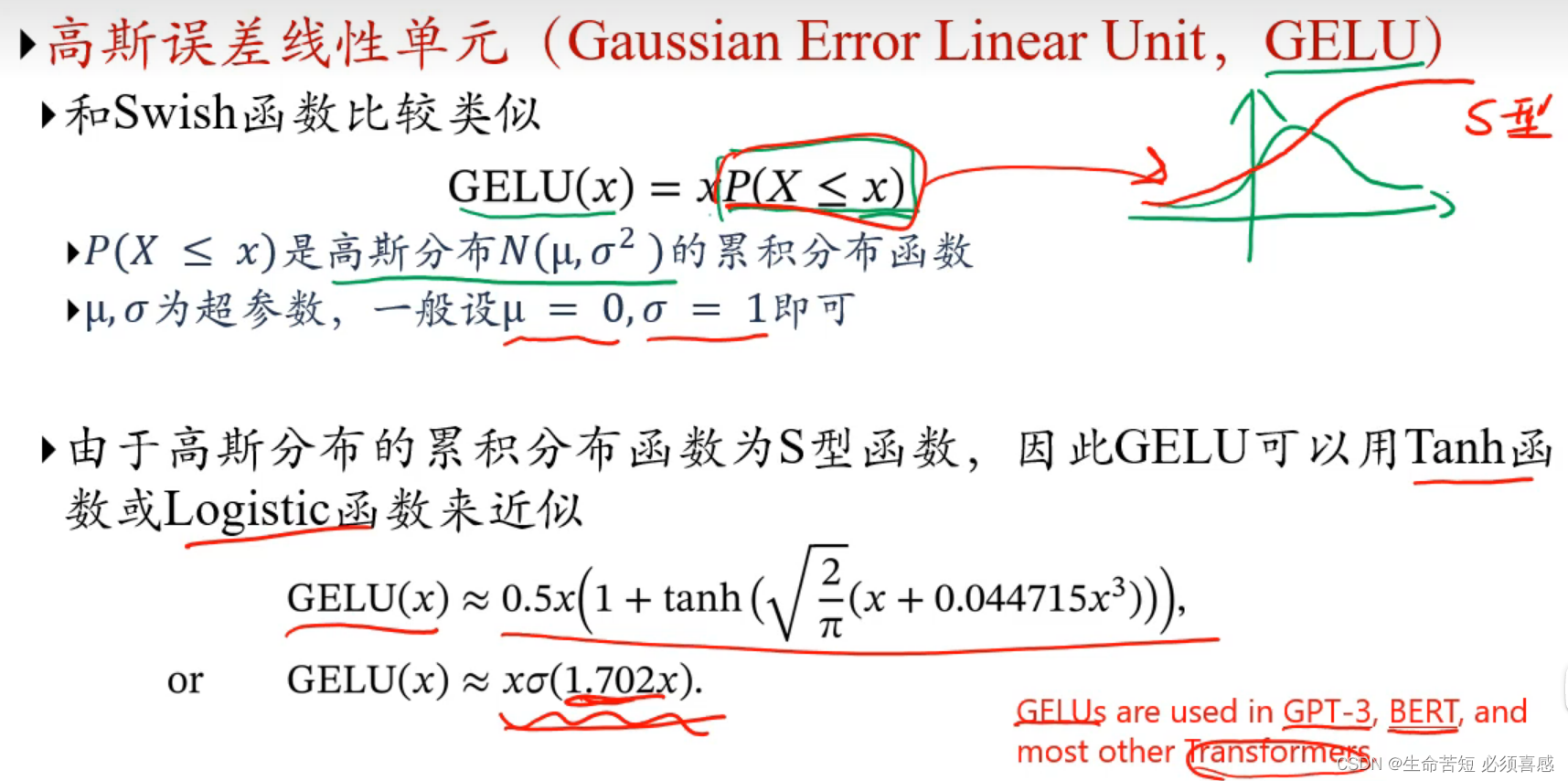

高斯误差线性单元(GELU)

激活函数小结:

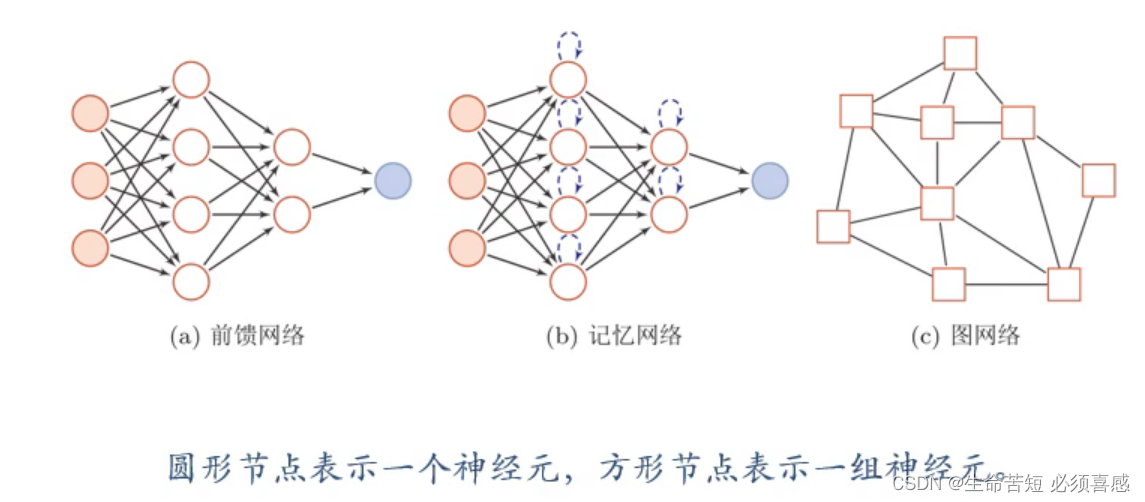

几种网络结构:

在前馈网络中,信息是由前往后单向传递,无循环边。

在记忆网络中,有循环边,对神经元来讲就会有历史状态的概念,也就意味着他有记忆能力。所以称为记忆网络。

在图网络中,定义的基本单位为一组神经元。

在以后的使用中,通常是这几种网络的复合体。

前馈神经网络(全连接神经网络、多层感知器)

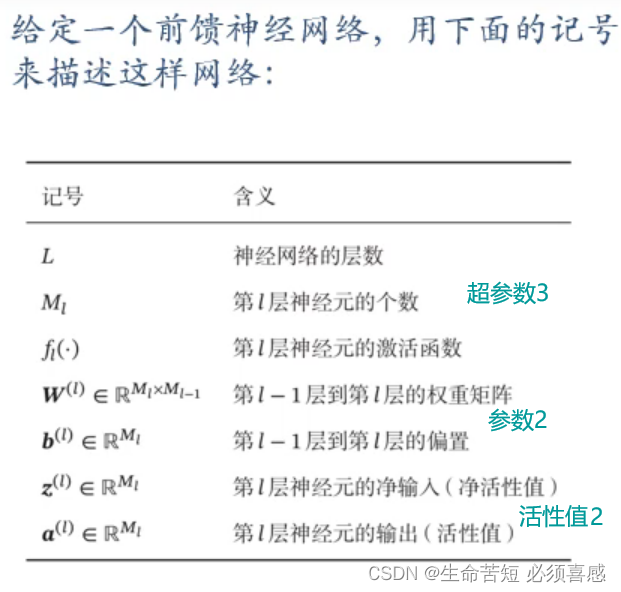

图示及符号定义

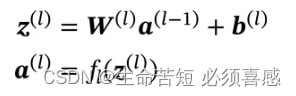

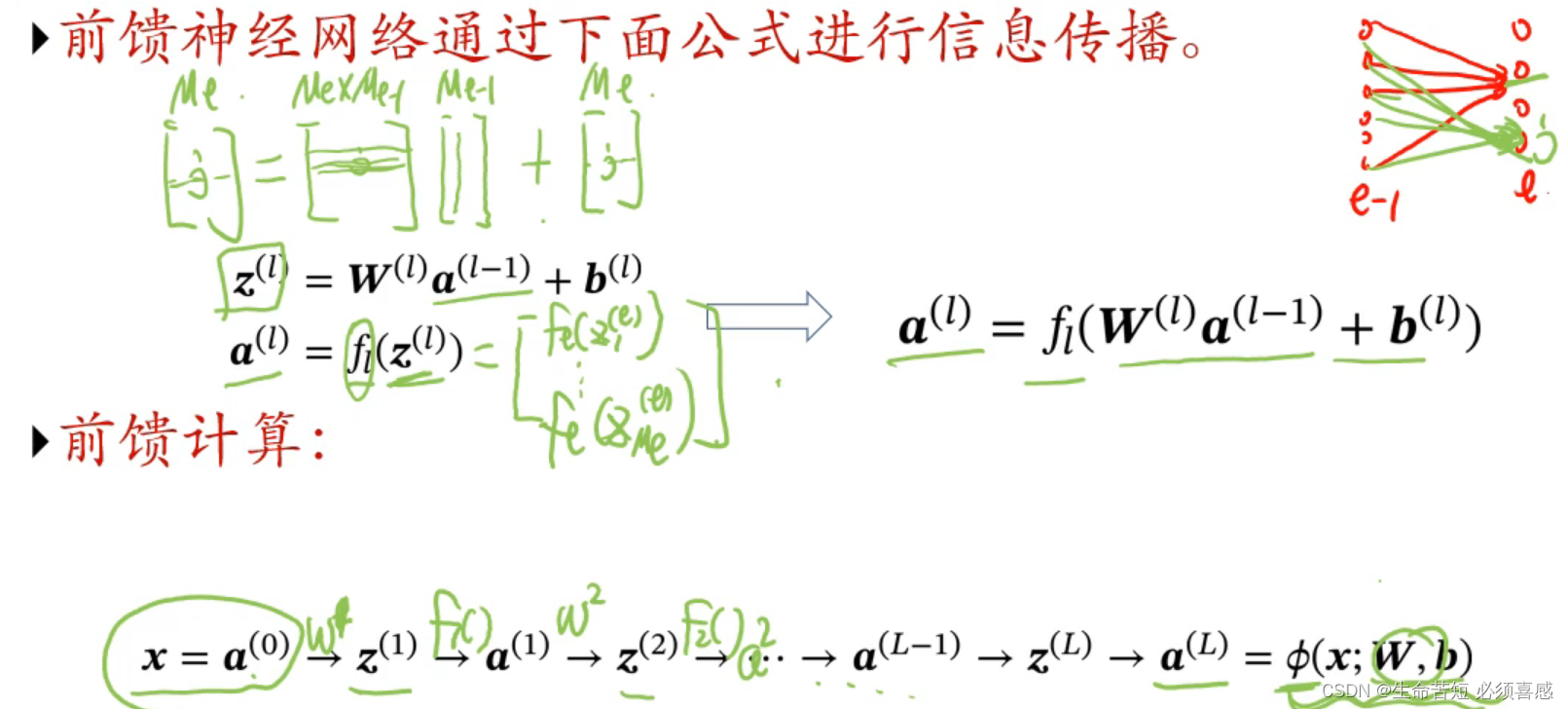

前馈神经网络通过下面的公式进行信息传播:

前馈计算:

神经网络可以作为一个“万能”函数来使用,可以用来进行复杂的特征转换,或逼近一个复杂的条件分布。

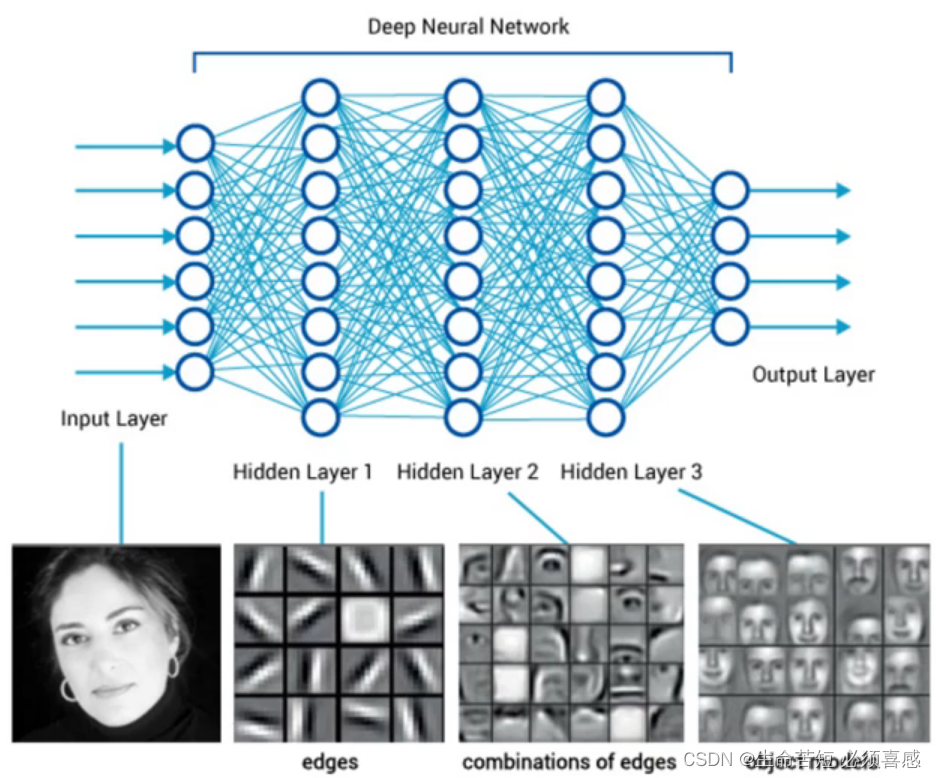

深层前馈神经网络例子(图像分类):

计算梯度:

计算梯度:

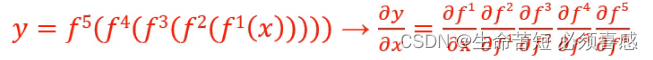

1.神经网络为一个复杂的复合函数

链式法则

2.反向传播算法

根据前馈神经网络的特点而设计的高效方法

3.一个更加通用的计算方法

自动微分(Automatic Differentiation,AD)

4903

4903

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?