在用AI生成图像时,控制风格往往像“抽卡”一样运气成分很大,很多时候我们也难以精准地描述参考的风格。

如果你希望在保持图片主体不变的同时,精确控制风格,那么ComfyUI的风格转换工作流就是你所需要的工具。

获取工作流请网盘自取:

链接:https://pan.baidu.com/s/1_cSFJKuRDCW_RFqXup6OHw?pwd=YBL1

提取码:YBL1

--来自百度网盘超级会员V2的分享

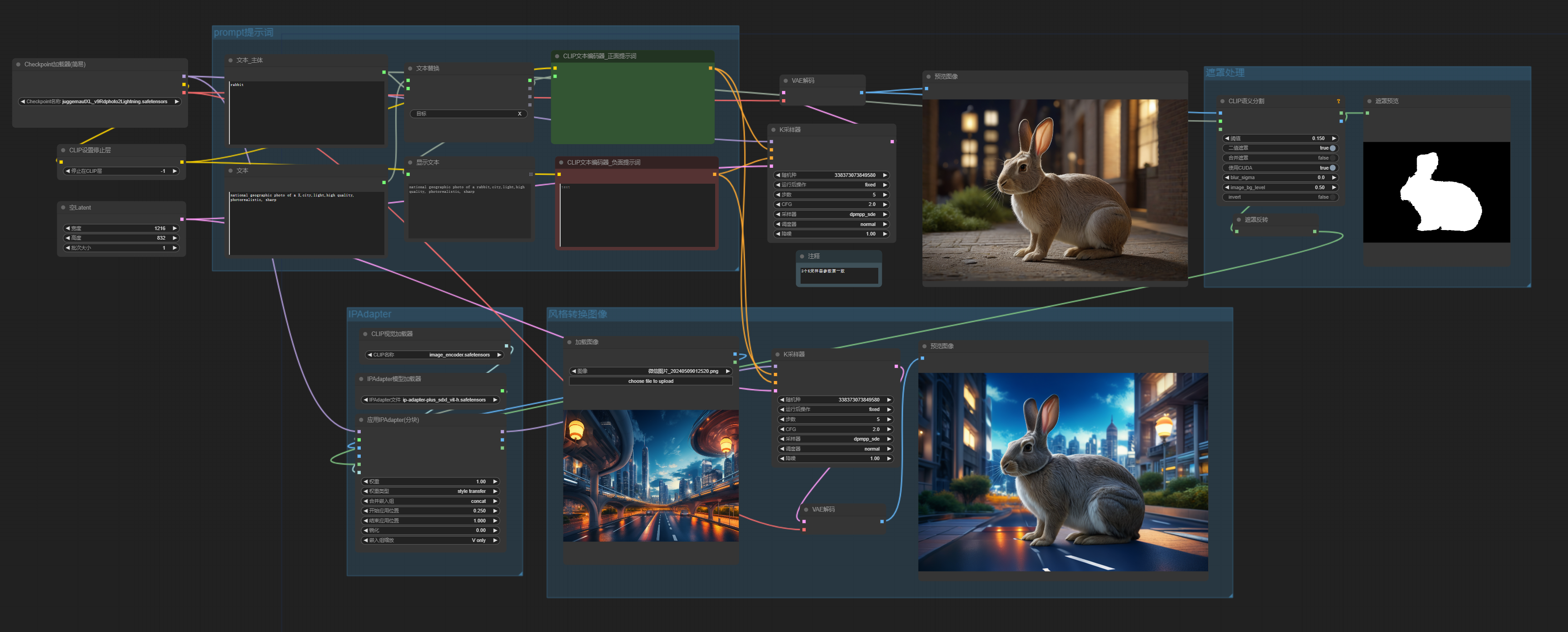

这个工作流是基于SDXL模型,出图效果非常好,通过这个工作流,你可以将参考图的风格无缝地迁移到生成的图片上。

这个工作流是基于SDXL模型,出图效果非常好,通过这个工作流,你可以将参考图的风格无缝地迁移到生成的图片上。

在这篇文章中,我将详细介绍如何使用这个工具,帮助你实现图片风格的精准控制。只需几步操作,你就能获得令人惊叹的视觉效果。准备好了吗?让我们开始吧!

1 节点介绍 Node introduction

首先介绍一下这个工作流使用到的节点。我会分为两个部分,第一部分是一些所有工作流通用的基础节点,有基础的小伙伴可以跳过。第二部分是这个风格转换工作流用到的,实现特殊作用的节点。

· 基础 Nodes ·

K采样器:

图像采样和生成最主要的节点。

CLIP文本编码器:

编码输入的文本,将文本转换为向量表示,生成精准的符合要求的图像

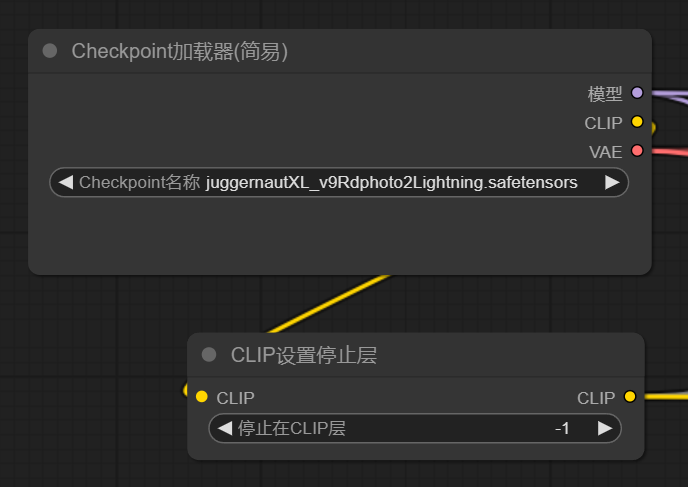

Checkpoint加载器:

加载checkpoint大模型

空lantent:

自定义生成图像分辨率大小

Vae解码:

变分自编码器解码器。从潜在空间中生成图像,保证图像的多样性和创新性

Clip设置停止层:

设置clip模型的最后一层,优化文本与图像的匹配度,确保生成的图像更符合文本

加载图像、预览图像

· 特殊 Nodes ·

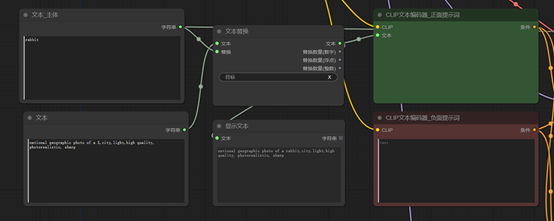

文本替换:

设置一个变量,替换文本编码器中的指定词

Clip语义分割:

通过文本提示词添加遮罩,这里就可以很方便地直接引用前面的【文本替换】

应用IPAdapter(分块):

根据加载的素材图片,参考图片的配色、色调、画风等,使创建出的新图片具有和原图的相似性

2 工作流&参数 Workflow&Parameters

1. 选择大模型和Clip设置停止层参数

直接获取我的工作流的小伙伴可以使用默认值。

2. 输入文本

分别设置背景和主体,将主体设置在【替换文本】栏,便于后续的更改,且将用于后面自动获取遮罩。

如果是自己手把手搭建工作流,需要把正向提示词部分的CLIP文本编码器改为加载文本而不是手动输入(与负面提示词不同)。

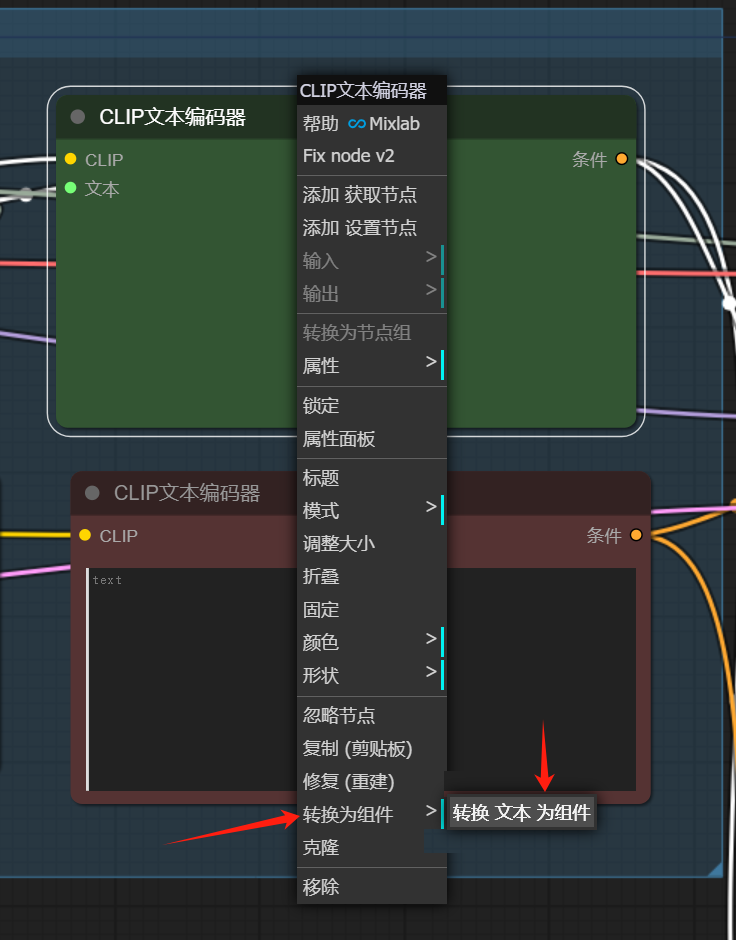

如图,右键CLIP文本编码器,选择【转换为输入】>【转换文本为输入】。

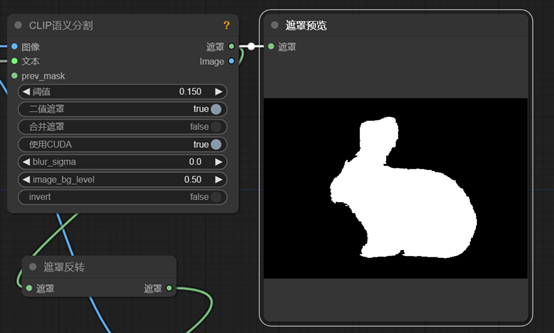

3.【遮罩处理】组

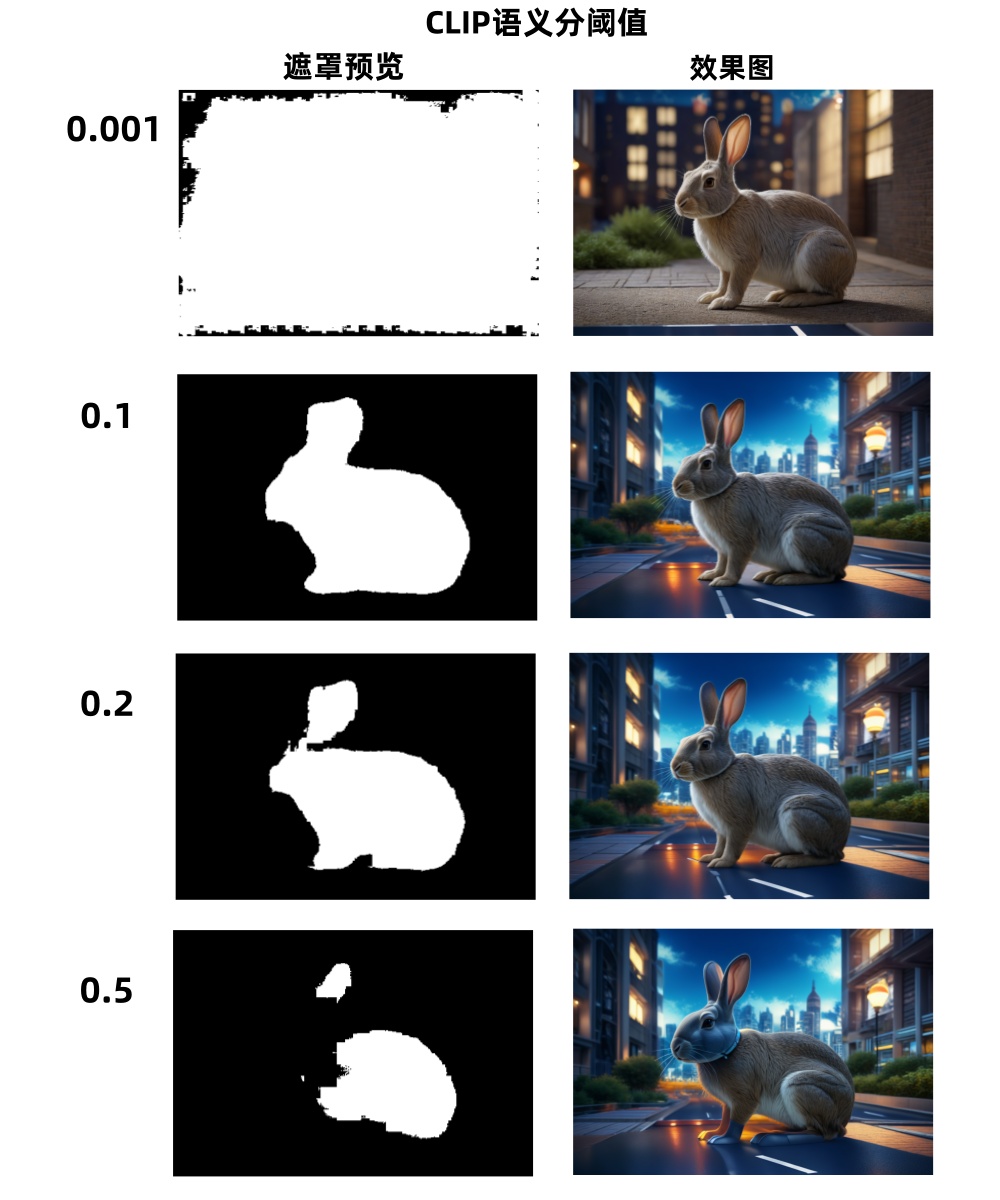

主要设置的是CLIP语义分割部分的【阈值】,阈值越低,遮罩选取的主体的部分越大(精细),如果你想要保证主体没有变化,就要设置比较低的阈值,当阈值为1时,则相当于没有增加遮罩,可以改变迁移整个图片的风格。

以下是取不同阈值得到的效果对比:

4. IPAdapter权重设置

权重越高,风格化程度越高(如下图),因为添加了遮罩,权重设为最大值1也不会破坏画面。

5. 添加参考图、点击生成~

这里需要注意的是,为了保证图片一致性,前后两次生成图像的K采样器参数要完全一致。

以上就是整个基于SDXL模型的风格转换模型工作流了,对这个模型去修改可以适应很多场景,减少抽卡次数和对描述词的研究。

大家可以尝试自己跟着我的教程搭建和改进工作流。如果我的内容对你有帮助,请点点赞鼓励一下。有什么问题或者建议欢迎留言~谢谢~

2195

2195

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?