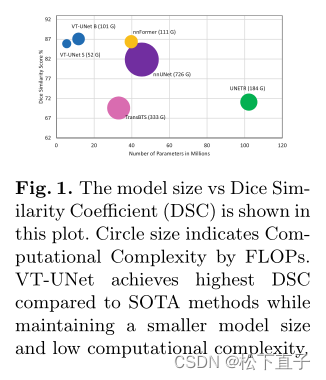

A Robust Volumetric Transformer for Accurate 3D Tumor Segmentation

摘要

提出了一种用于体积分割的Transformer架构,这是一项具有挑战性的任务,需要在编码局部和全局空间线索时保持复杂的平衡,并沿体积的所有轴保留信息。所提出的设计的编码器得益于自注意机制,可以同时对局部和全局线索进行编码,而解码器则采用并行的自注意和交叉注意公式来捕捉精细细节以进行边界细化。

代码地址

本文方法

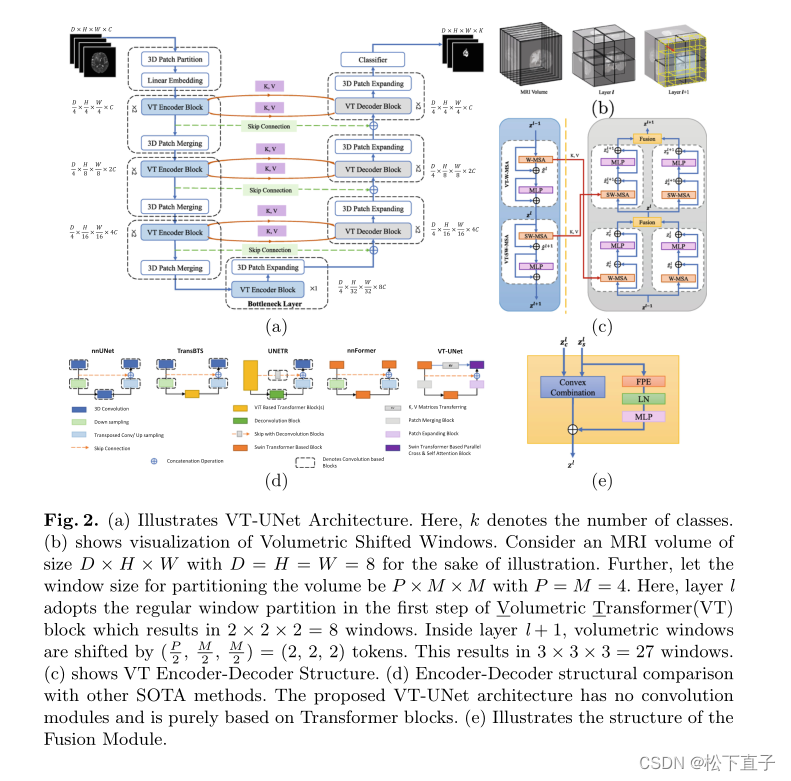

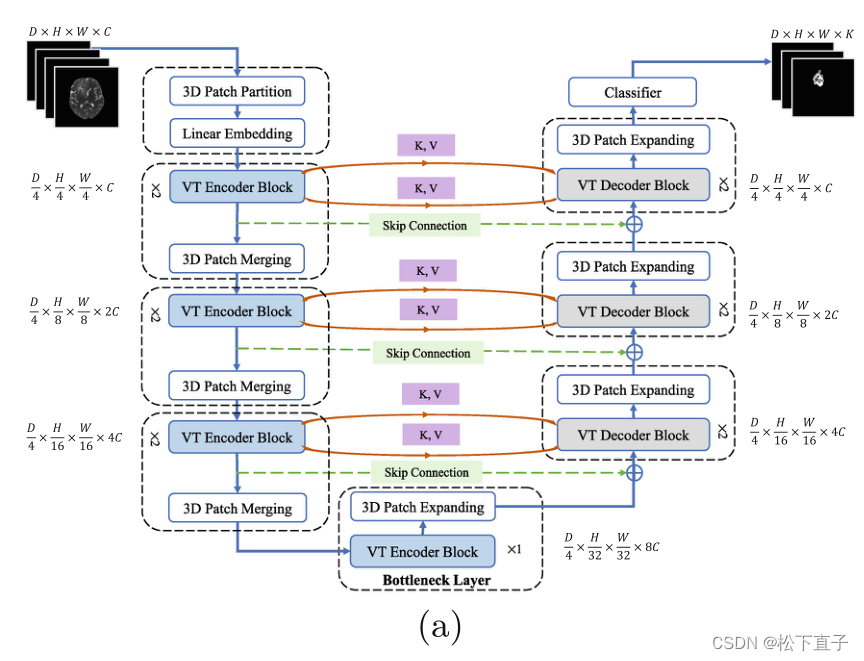

(a) 说明VT UNet架构。这里,k表示类的数量

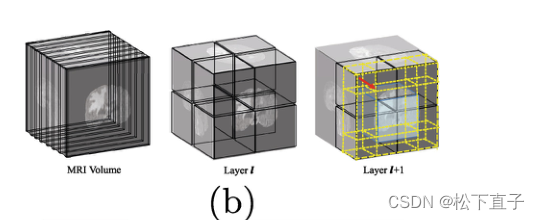

(b) 显示了体积移位窗口的可视化。为了便于说明,考虑尺寸为D×H×W的MRI体积,其中D=H=W=8。此外,设用于划分卷的窗口大小为P×M×M,其中P=M=4。这里,层l在体积变换器(VT)块的第一步中采用了规则窗口分区,这导致了2×2×2=8个窗口。在层l+1内,体积窗口偏移(P2,M2,M2)=(2,2,2)个标记。这将导致3×3×3=27个窗口。

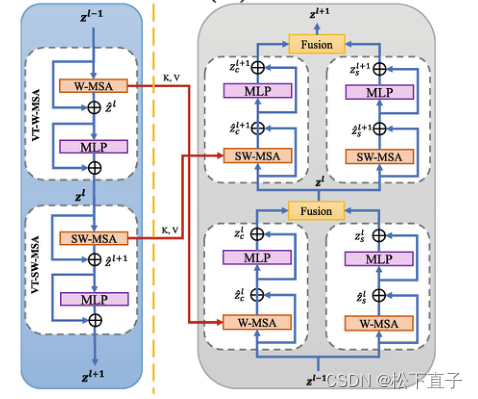

(c) 显示了VT编码器-解码器结构

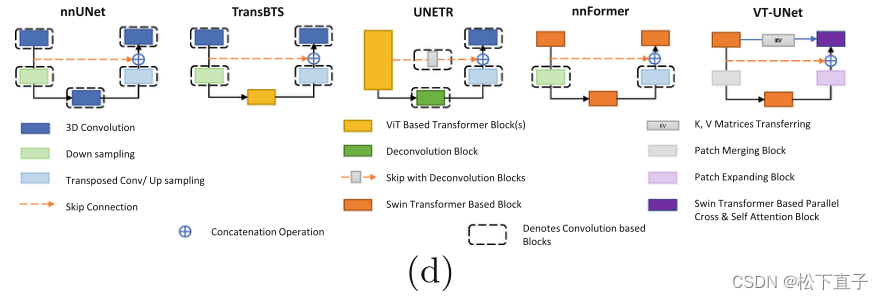

(d) 编码器-解码器结构与其他SOTA方法的比较。所提出的VT-UNet架构没有卷积模块,并且完全基于Transformer块

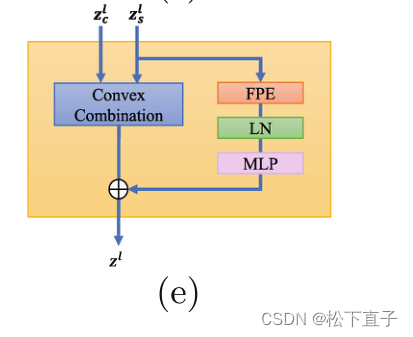

(e) 说明了融合模块的结构。

图像还是比较清晰的,最好结合代码,内容不作具体描述

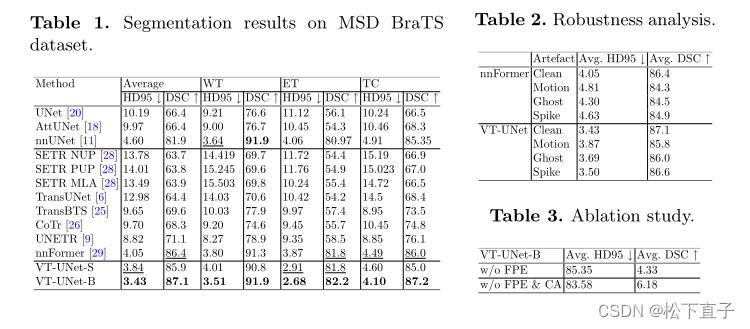

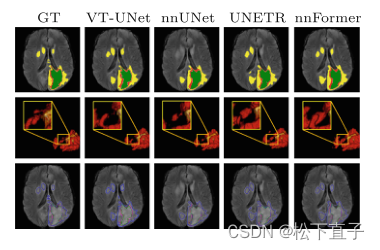

实验结果

1333

1333

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?