文章目录

Towards Graph Neural Networks with Domain-Generalizable Explainability for fMRI-Based Brain Disorder Diagnosis

摘要

背景: 图神经网络(GNNs)已成为基于功能磁共振成像(fMRI)数据诊断脑部疾病的前沿方法。然而,考虑到功能性脑网络的高复杂性以及不同临床中心fMRI数据的强变异性,GNNs 在可解释性和泛化性方面仍面临挑战。尽管已有许多研究分别探讨了GNNs的可解释性和泛化性,但很少有方法能够同时兼顾这两个方面。

目的: 统一GNNs的可解释性与泛化性问题,并从可解释性的角度重新审视fMRI数据在脑疾病诊断中的领域泛化(DG)问题。目标是学习领域泛化的解释因子,以增强跨中心的图表示学习,从而提高脑疾病诊断的稳定性与准确性。

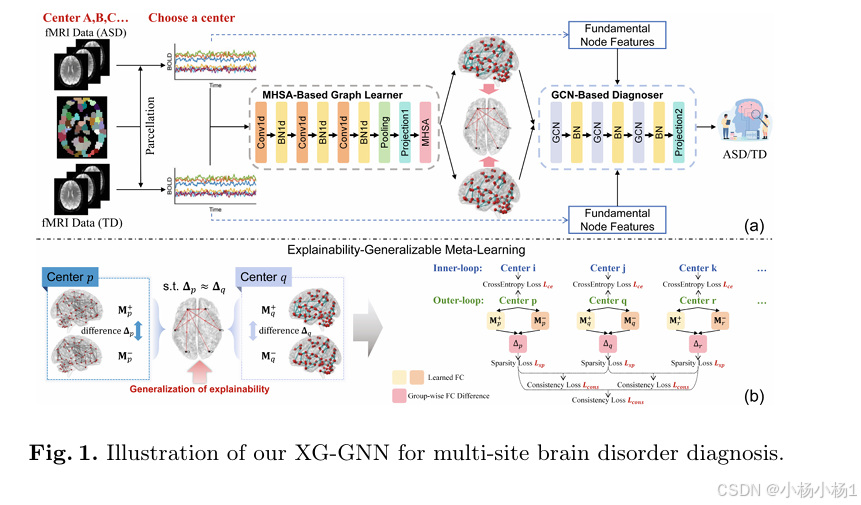

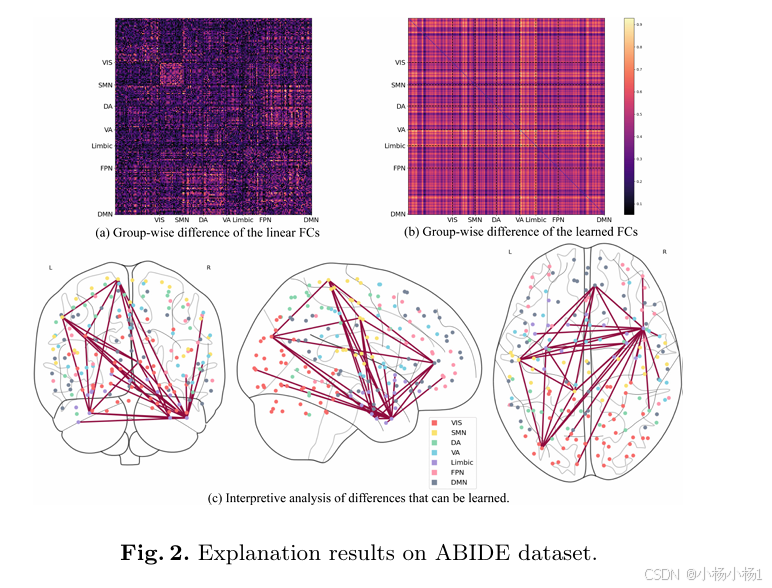

方法: 提出一种专门的元学习框架,并结合可解释性-泛化性(XG)正则化策略,以学习适用于fMRI BOLD信号的诊断GNN模型(XG-GNN)。XG-GNN能够以任务导向的方式构建非线性功能网络,并确保所学习的个体网络的组间差异能够稳定地迁移至未见的fMRI中心,从而同步提升诊断的可解释性和泛化能力。

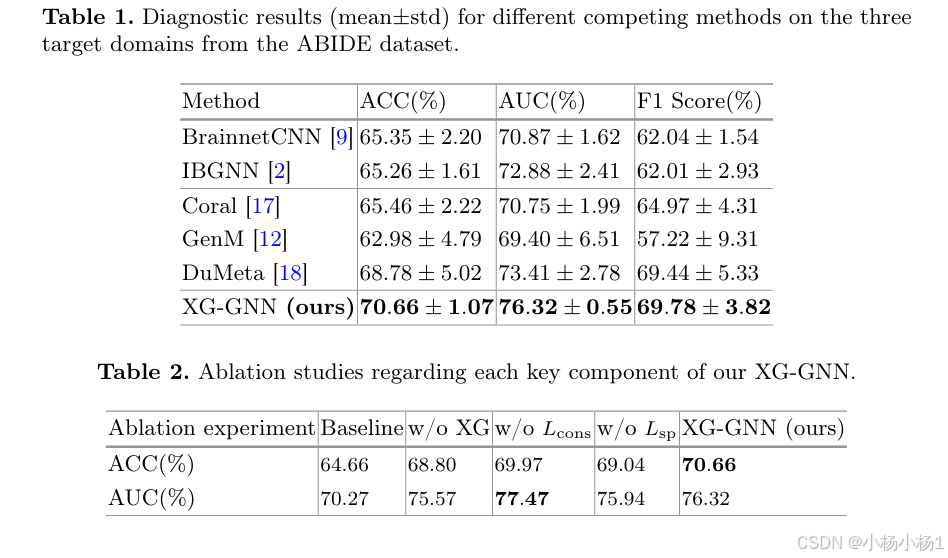

结果: 在ABIDE数据集上的实验结果验证了XG-GNN的有效性。源码将公开于 https://github.com/ladderlab-xjtu/XG-GNN。

方法

实验结果

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?