梯度下降算法

算法存在的问题

穷举思路

存在的问题:当权重较多时,数据量会非常大

分治思路

分成四份,找16个点,找出其中比较小的块,再分成四分……

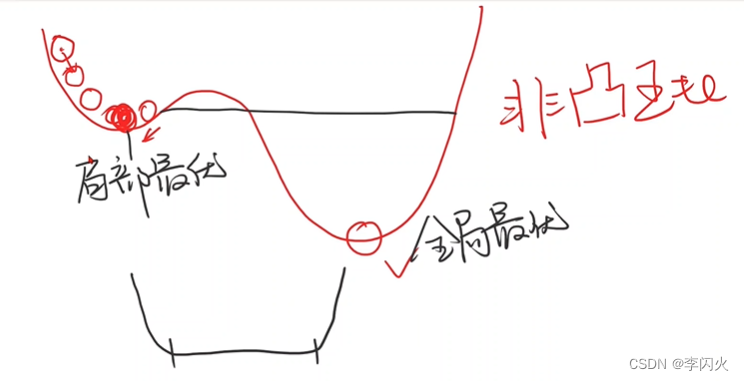

存在的问题:如果是非凸函数可能会错过最优点

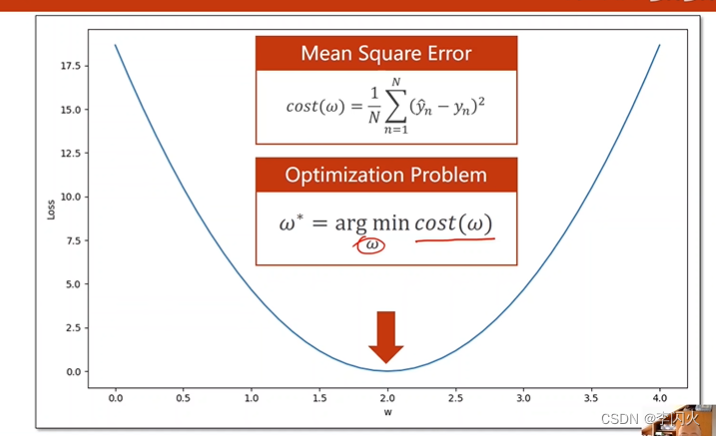

优化问题:使目标函数最小的权重组合我们称之为优化问题

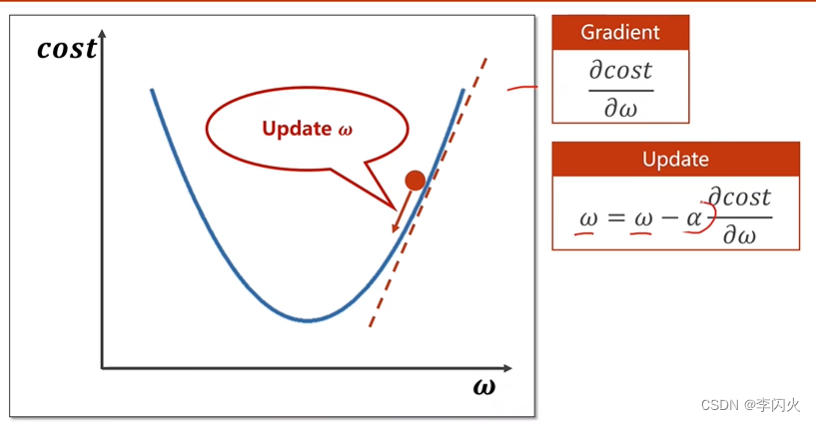

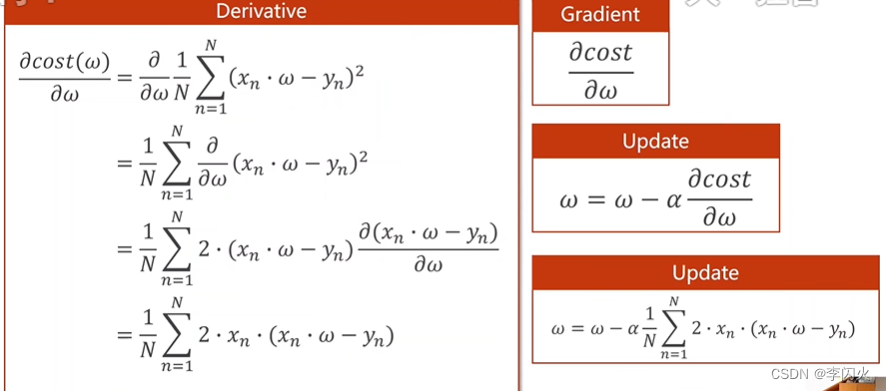

梯度下降算法: 原来的权重 - cost对权重的导数乘以学习率

梯度下降算法类似于贪心算法,用梯度下降算法可以得到局部最优点,但是没办法保证找到全局最优点

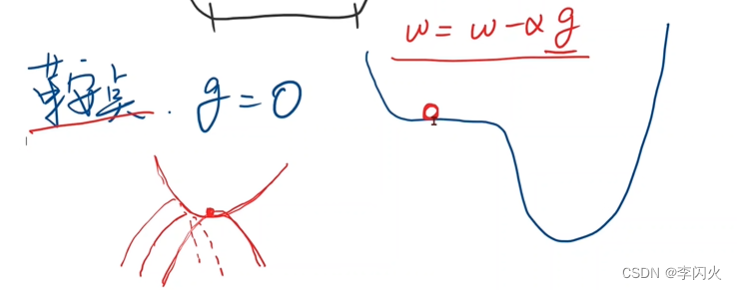

目前梯度下降算法使用的很多,因为在实际应用过程中很难陷入局部最优点。但是鞍点成了最大的问题,即梯度为0,会导致算法无法继续迭代。

梯度下降算法推导过程

梯度下降算法代码实现

import matplotlib.pyplot as plt

# 模型

def forward(x):

return x * w

# 计算loss

def cost(xs, ys):

cost = 0

for x, y in zip(xs, ys):

y_pre = forward(x)

cost += (y_pre - y) ** 2

return cost / len(xs)

# 计算梯度

def gradient(xs, ys):

grad = 0

for x, y in zip(xs, ys):

grad += 2 * x * (x * w - y)

return grad/len(xs)

# 数据集

x_data = [1.0, 2.0, 3.0]

y_data = [2.0, 4.0, 6.0]

# 权重

w = 1.0

r = 0.01

print('Predict (before training)', 4, forward(4))

epoch_list = []

cost_list = []

for epoch in range(100):

cost_val = cost(x_data, y_data)

grad_val = gradient(x_data, y_data)

w = w - r * grad_val

print('Epoch:', epoch, ' w=', w, ' cost=',round(cost_val, 3))

epoch_list.append(epoch)

cost_list.append(cost_val)

print('Predict (after training)', 4, forward(4))

figure = plt.figure(num='this is a fugure')

axes = figure.add_subplot()

axes.plot(epoch_list, cost_list)

plt.show()

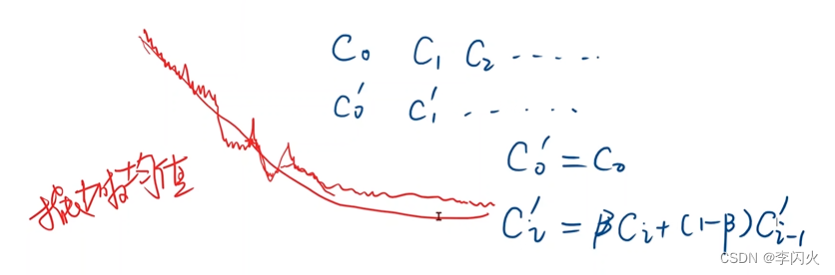

如果绘图不是很光滑,可以使用指数加权均值来绘图

训练失败可能是因为学习率设置太大了

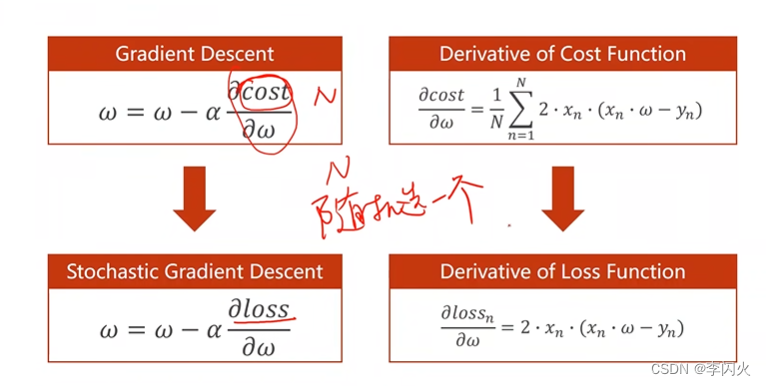

随机梯度下降算法推导过程

梯度下降的训练时间较长,因为每次迭代都需要对整个数据集进行计算和更新,而使用较多的是随机梯度下降:随机选一个样本损失对权重求导然后进行更新。

随机梯度下降算法代码实现

import matplotlib.pyplot as plt

# 模型

def forward(x):

return x * w

# 计算loss

def loss(x, y):

return (forward(x) - y) ** 2

# 计算梯度

def gradient(x, y):

return 2 * x * (x * w - y)

# 数据集

x_data = [1.0, 2.0, 3.0]

y_data = [2.0, 4.0, 6.0]

# 权重

w = 1.0

r = 0.01

print('Predict (before training)', 4, forward(4))

epoch_list = []

loss_list = []

for epoch in range(100):

for x, y in zip(x_data, y_data):

loss_val = loss(x, y)

grad_val = gradient(x, y)

w = w - r * grad_val

print('Epoch:', epoch, ' w=', w, ' loss=',round(loss_val, 3))

epoch_list.append(epoch)

loss_list.append(loss_val)

print('Predict (after training)', 4, forward(4))

figure = plt.figure(num='this is a fugure')

axes = figure.add_subplot()

axes.plot(epoch_list, loss_list)

plt.show()

存在的问题:

梯度下降:计算梯度可以并行,学习器的性能较低。

随机梯度下降:计算梯度不可以并行,学习器的性能较好,但时间复杂度较高。

解决方法:

折中:Batch/Mini - batch 批量的随机梯度下降。

233

233

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?