- torchvision包提供一些常用网络数据集的下载

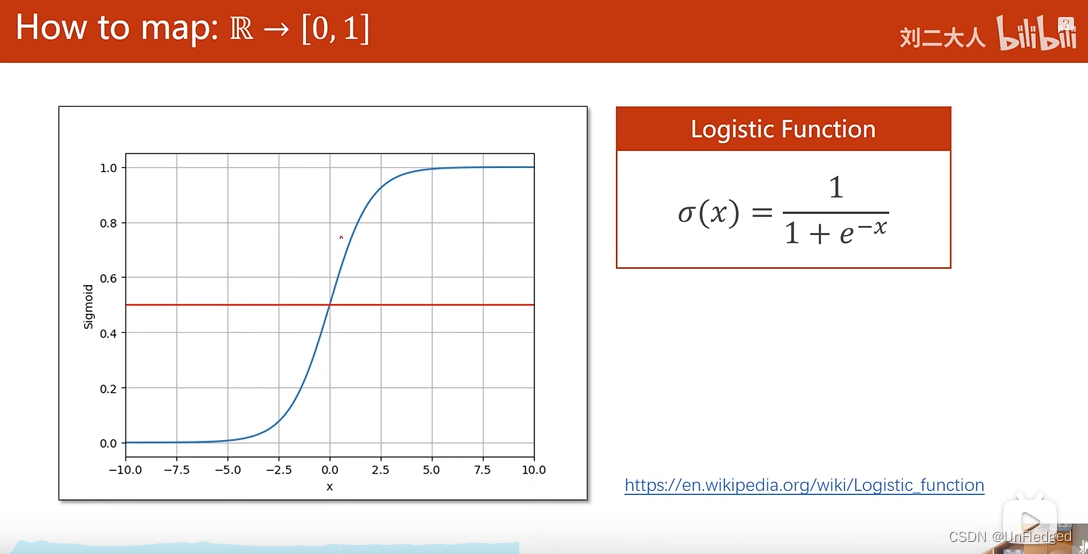

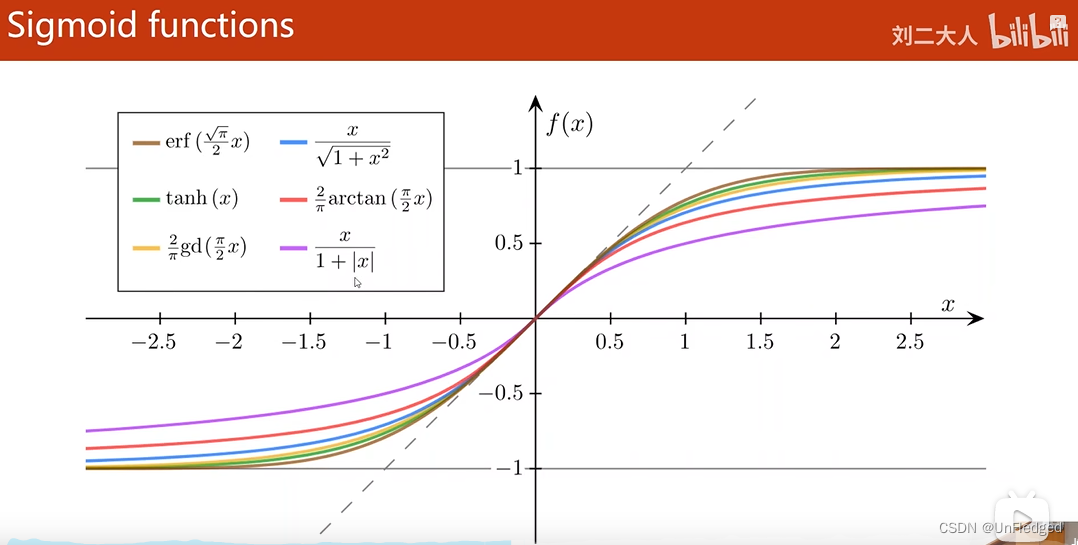

- 在所有的sigmoid函数中,最出名的是Logistic Function,所以也将其成为sigmoid函数

- sigmoid函数目的:将实数域映射到[0, 1],方便表示概率

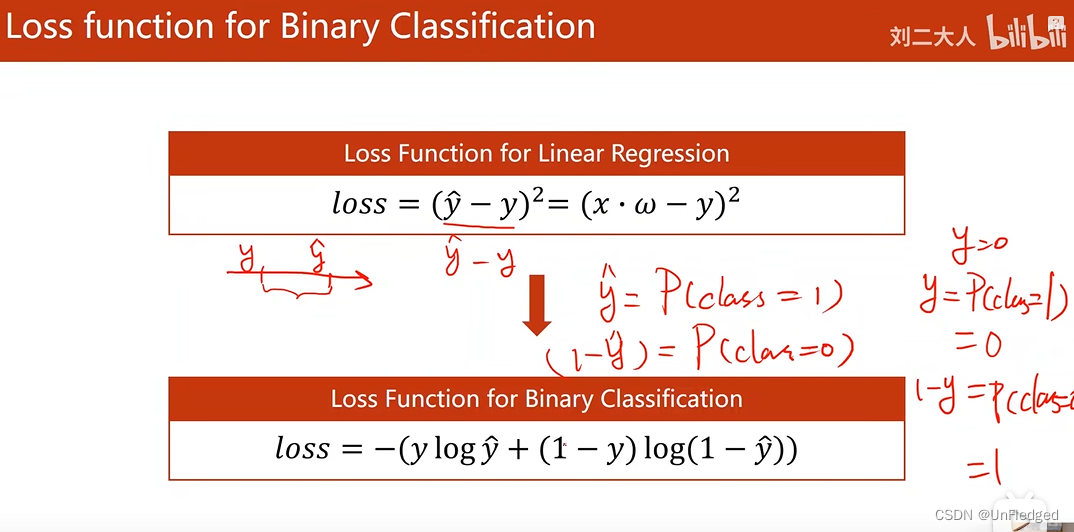

- Loss函数的变化:变为cross-entropy损失,并且希望P1(x)ln(P2(x))越大越好(表示两个分布差异性小),加上-号即可转化为将loss越小越好

- 二分类的交叉熵损失函数:BCEloss (Binary Cross-Entropy)

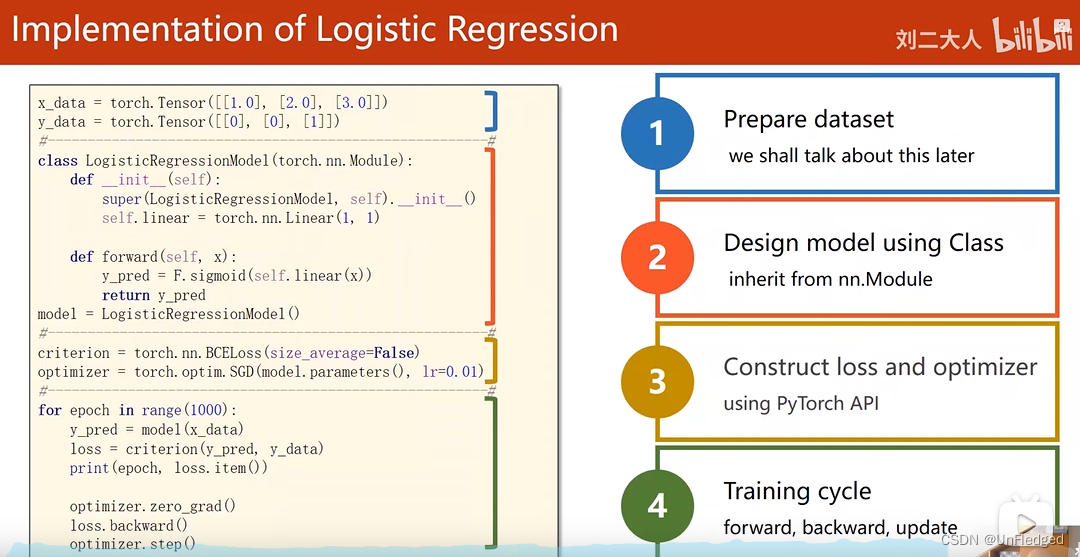

- 模型编写四步:

课上代码:

import matplotlib.pyplot as plt

import torch

import torch.nn as nn

import torch.nn.functional as F

import torch.optim as optim

import matplotlib.pyplot as plt

import numpy as np

x_data = torch.Tensor([[1.0], [2.0], [3.0]]) # tensor和Tensor不同?

y_data = torch.Tensor([[0], [0], [1]])

class LogisticRegressionModel(nn.Module):

def __init__(self):

super(LogisticRegressionModel, self).__init__()

self.linear = nn.Linear(1, 1)

def forward(self, x):

y_pred = F.sigmoid(self.linear(x))

return y_pred

model = LogisticRegressionModel()

criterion = nn.BCELoss(size_average=False)

optimizer = optim.SGD(model.parameters(), lr=0.01)

for epoch in range(1000):

y_pred = model(x_data)

loss = criterion(y_pred, y_data)

optimizer.zero_grad()

loss.backward()

optimizer.step()

x = np.linspace(0, 10, 200)

x_t = torch.Tensor(x).view(200, 1)

y_t = model(x_t)

y = y_t.data.numpy()

plt.plot(x, y)

plt.plot([0, 10], [0.5, 0.5], c='r')

plt.xlabel("Hours")

plt.ylabel("Prob of Pass")

plt.grid()

plt.show()

补充:

torch.Tensor和torch.tensor的区别:

torch.Tensor()是python类,更明确地说,是默认张量类型torch.FloatTensor()的别名,torch.Tensor([1,2])会调用Tensor类的构造函数__init__,生成单精度浮点类型的张量。

torch.tensor会从data中的数据部分做拷贝(而不是直接引用),根据原始数据类型生成相应的torch.LongTensor、torch.FloatTensor和torch.DoubleTensor。

由于torch.Tensor()只能指定数据类型为torch.float,所以torch.Tensor()可以看做torch.tensor()的一个特殊情况。

91

91

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?