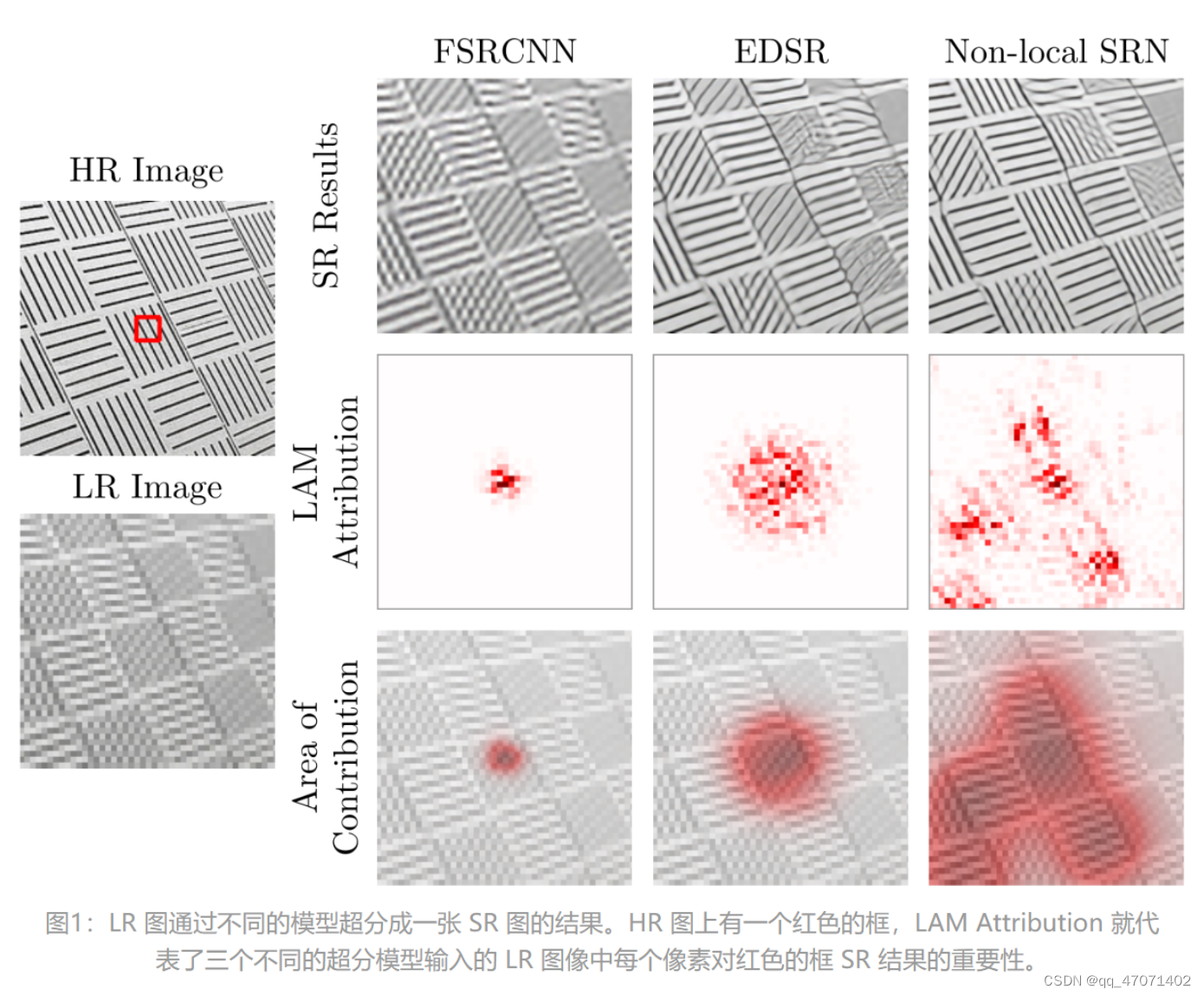

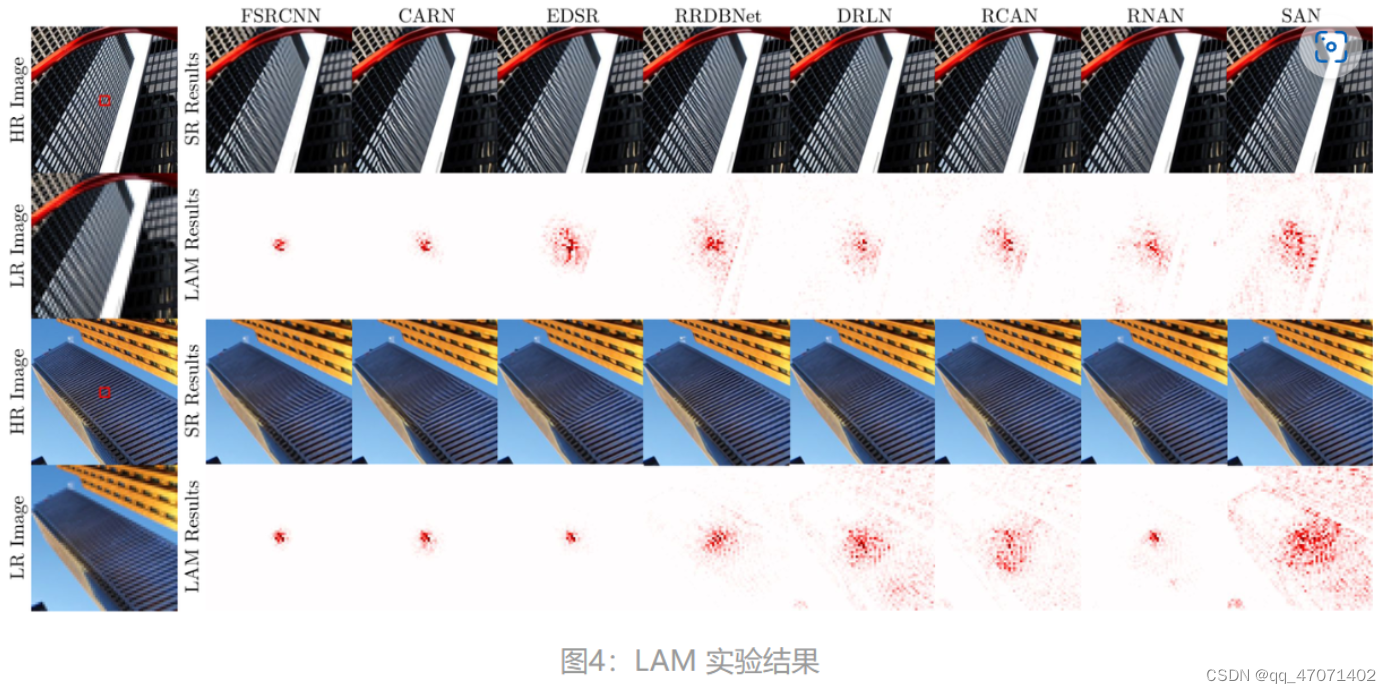

LAM:使用局部归因图理解和可视化超分网络

Interpreting Super-Resolution Networks with Local Attribution Maps (CVPR 2021)

School of Electrical and Information Engineering, The University of Sydney. Shenzhen Institutes of Advanced Technology, Chinese Academy of Sciences.

-

是不是只要加大感受野就能获得更好的性能呢?更大的感受野,或者多尺度的特征是否对于 SR 模型有效?

-

为什么 Attention 或者 Non-local 的操作可以帮助提升 SR 性能?

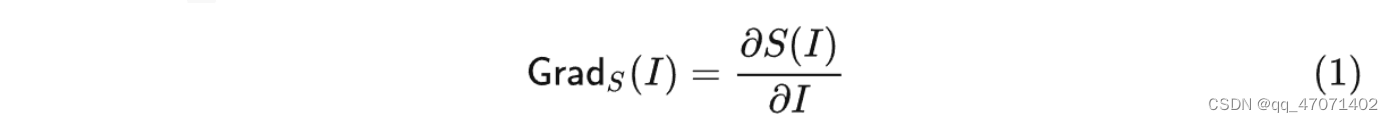

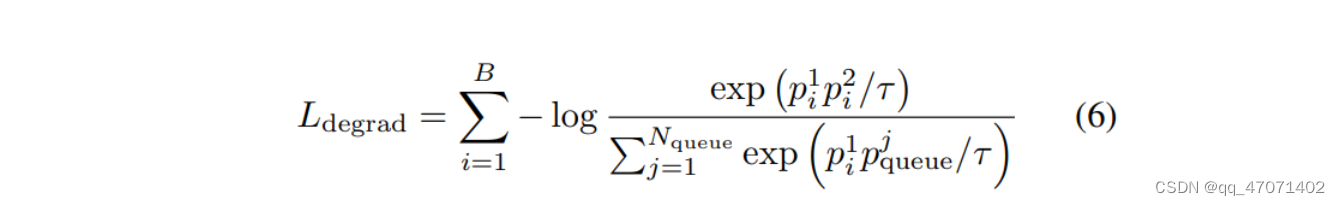

预测概率对输入I的梯度

采用预测概率对输入I的梯度作为归因图

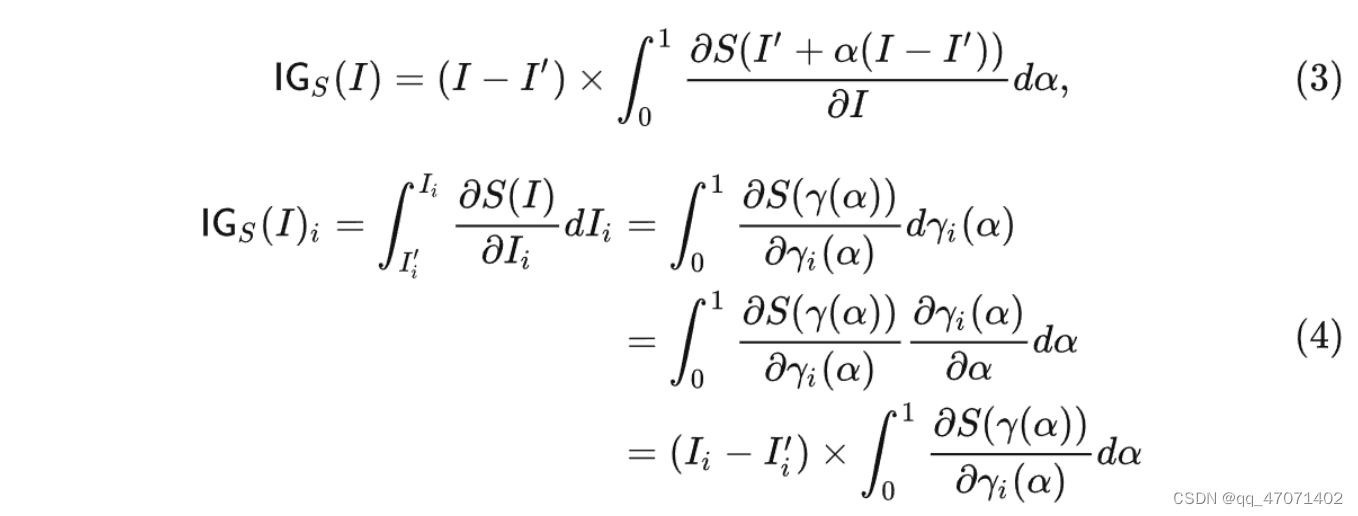

使用积分梯度 (Integrated Gradients)来做归因

所谓归因,简单来说就是对于给定的输入图片I 和模型S ,我们想办法指出I 的哪些分量对模型的决策有重要影响,或者说对 I 的各个分量的重要性做个排序,用专业的话术来说那就是 "归因"。

-

假设输入的是

I,还有一个基线图像I',模型是S,假设是SR模型,表示是一种插值参数,则I'+

(I-I')表示了从基线图片

I'到原始输入图片I的变化过程

-

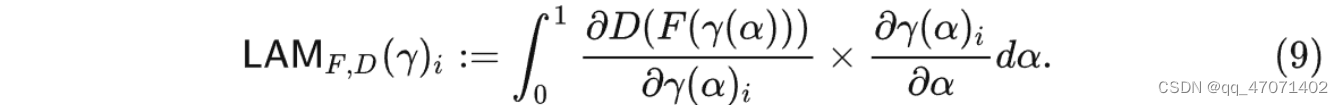

在LAM中,超分模型

F再加上后面的检测器D就相当于了一个分类模型,输出 LR 图片的某个 patch 里面是否有特定的特征。就可以计算这个标量对于 LR 图片的积分梯度了,这也就是 LAM 的核心思想。 -

-

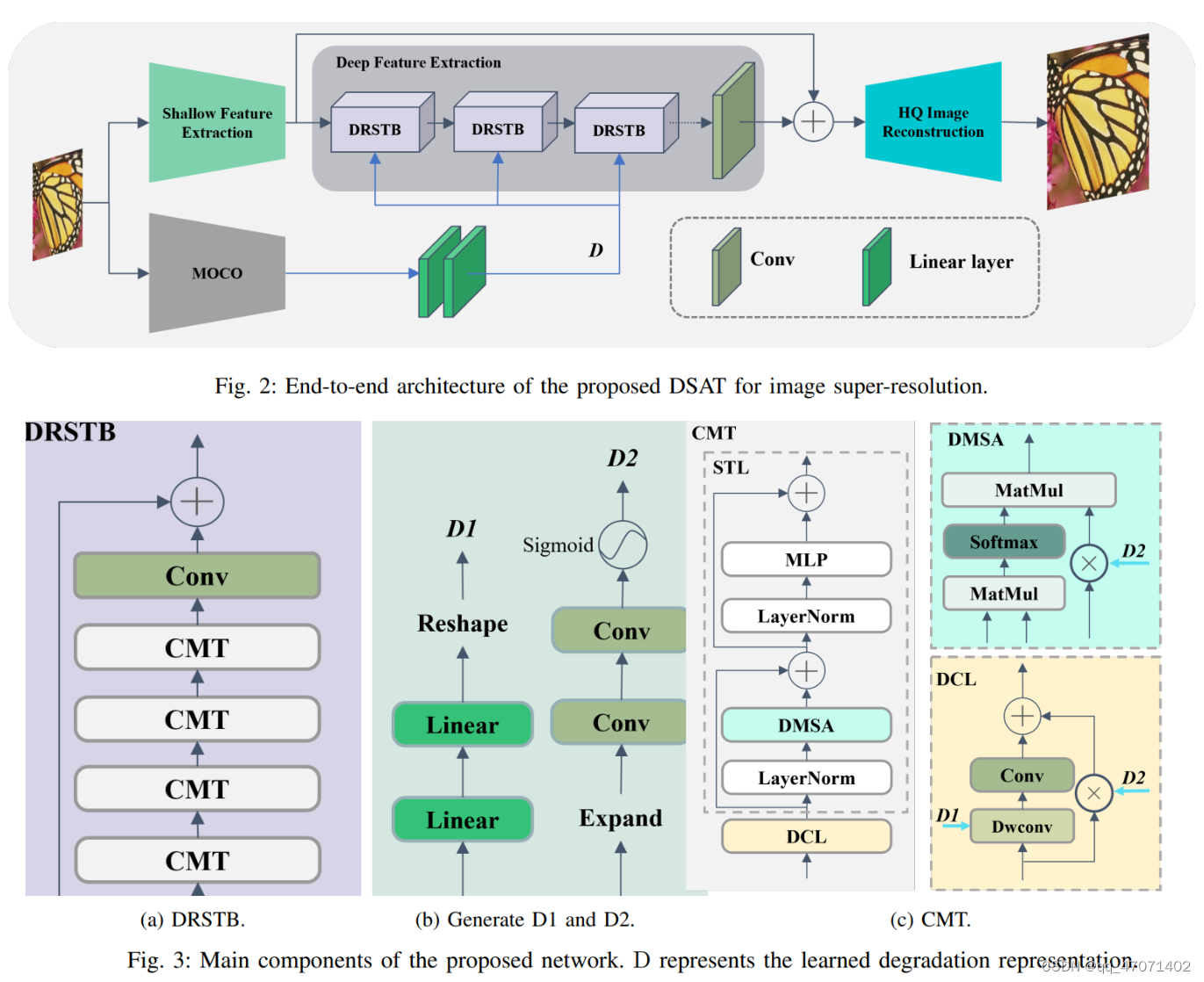

2、Degradation-Aware Self-Attention Based Transformer for Blind Image Super-Resolution(arxiv2023)

Immersive and Interactive Multimedia Lab, Nanjing University of Aeronautics and Astronautics, Nanjing

-

MOCO学习一个退化特征

-

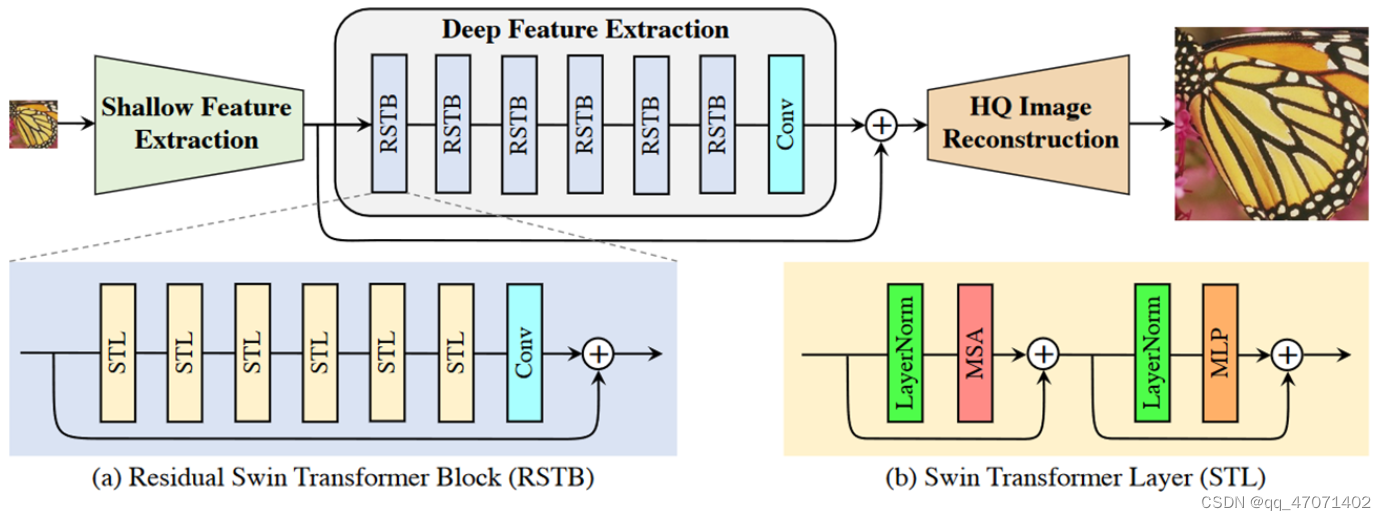

将这个退化特征用到了Swin transformer里面

-

不同之处就是把D应用到了每一个RSTB模块里面

-

SwinIR

效果

-

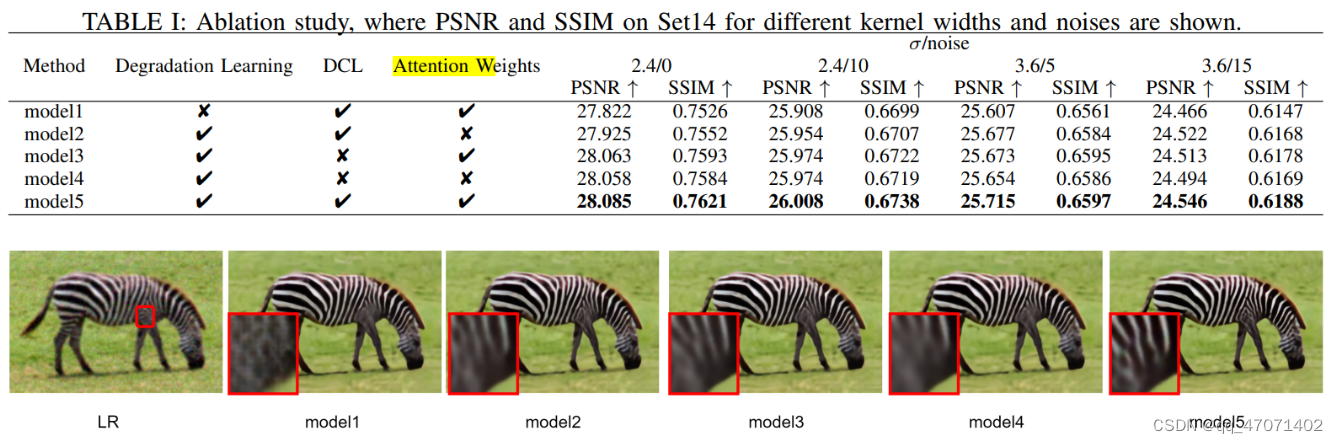

消融

-

实验

-

可视化

本文探讨了如何通过LAM(LocalAttributionMaps)理解超分辨率网络的工作原理,关注感受野大小、多尺度特征以及注意力机制对性能的影响。研究者提出了一种结合预测概率梯度的归因方法,同时分析了基于自注意力的SwinTransformer在盲图像超分辨率中的应用及其效果。

本文探讨了如何通过LAM(LocalAttributionMaps)理解超分辨率网络的工作原理,关注感受野大小、多尺度特征以及注意力机制对性能的影响。研究者提出了一种结合预测概率梯度的归因方法,同时分析了基于自注意力的SwinTransformer在盲图像超分辨率中的应用及其效果。

5062

5062

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?