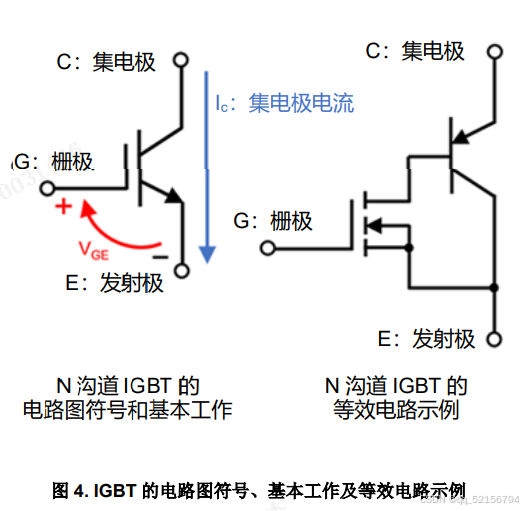

1.IGBT的结构

IGBT具有栅极、集电极、发射极

N沟道:通过电压控制元件给栅极施加相对于发射极的正电压,集电极-发射极之间导通,流过集电极电流

特点:输入阻抗高、开关速度快(速度比MOS管慢,但比双极晶体管快)

在高压时使用IGBT,在低压时使用MOS

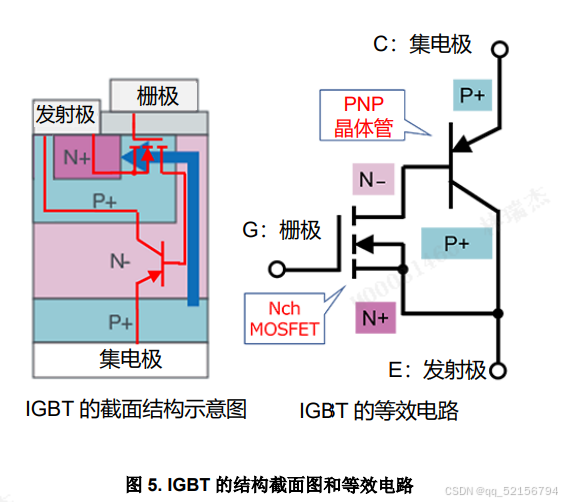

2. IGBT工作原理

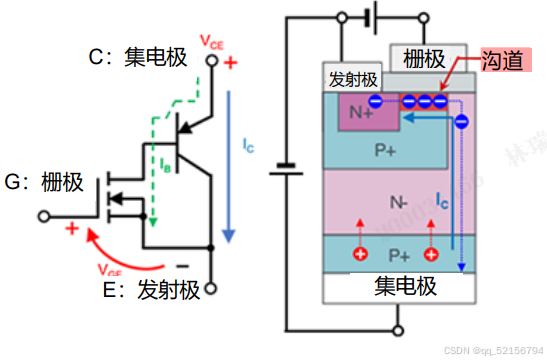

当向发射极施加正的集电极电压VCE,同时向发射极施加正的栅极电压VGE时,IGBT变为导通状态,集电极和发射极之间导通,流过集电极电流Ic

当施加正VGE时,电子-聚集在栅极电极正下方的P+层中并形成沟道,因此从IGBT的发射极供给的电子沿N+层===沟道===N-漂移层===P+集电极层的方向移动。

而空穴+则由P+集电极层注入N-漂移层。该层之所以被称为“漂移层”是因为电子和空穴两者的载流子都会移动。

也就是说电子从发射极向集电极的移动意味着电流(Ic)从集电极流向发射极

3.IGBT的特点

IGBT的输入部分为MOS管结构,输出部分为双极结构的复合型器件,同时具备MOS管和双极晶体管两者的优点。其输入阻抗高,可以用小功率驱动,并且可以将电流放大为大电流。此外,即使在高电压条件下,导通电阻也保持在较低水平。

优点:耐压高、损耗低、速度快

4.IGBT的短路耐受时间

在功率元器件处于短路状态时,会流过大电流并在短时间内造成元器件损坏,但短路耐受时间意味着在发生短路时,可以承受而不至于损坏的时间,也称为“允许的短路时间”

功率器件短路比如IGBT,是指在集电极和发射极之间施加了高电压(Vcc)的状态下IGBT导通,并且在已导通的IGBT中流过很大的集电极电流IC的状态,这可能是由控制电路故障或某种误动作引起的

如果在短路过程中IGBT损坏,基本上初期会发生短路故障,所以电流会几乎没有限制的持续流过IGBT,集电极电压=Vcc将下降到几乎接地水平,即使向栅极发送关断信号,也不会关断IGBT并切断集电极电流。

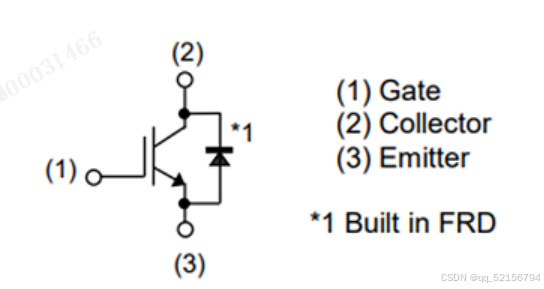

5.内置快恢复二极管(FRD)的IGBT

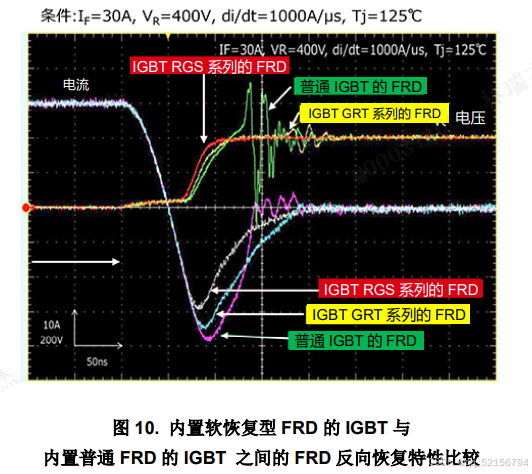

在逆变器和电机驱动应用中,续流二极管需要具备的重要特性之一是高速,即反向恢复时间trr短。开关时的开通损耗受反向恢复电流的影响很大,因此需要使用具有高速trr特性的FRD来降低损耗。

另一个关键要点是内置FRD的振铃问题。对于FRD而言,trr速度快意味着反向恢复电流急剧收敛,所以会发生振铃(噪声),而这从EMC的角度看就成了问题。因此要求FRD的反向恢复特性需要具有trr短且可柔和地收敛的特点。称为“软恢复型”FRD

838

838

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?