环境:ubuntu18.04

前提:Hadoop已经搭建好

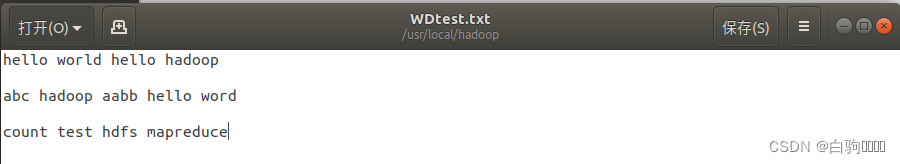

1.新建WDtest.txt文件,自定义执行样例

抄作业记得改标题

cd /usr/local/hadoop

vim WDtest.txt输入内容(可以自定义,抄作业别写一样的)

2.开启hadoop

cd /usr/local/hadoop

./sbin/start-all.sh3.修改yarn-site.xml文件的配置

cd /usr/local/hadoop/etc/hadoop

vim yarn-site.xmlyarn-site.xml内容如下,注意第一个<property>要改:

·输入hadoop classpath(任意路径下均可),将返回的内容复制在第一个<property>的<value>中

<?xml version="1.0"?>

<configuration>

<property>

<name>yarn.application.classpath</name>

<value>*这个要改-输入hadoop classpath(任意路径下均可),将返回的内容复制在这个标签中*</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.vmem-pmem-ratio</name>

<value>3.0</value>

</property>

</configuration>*修改配置文件之后要重启hadoop(关了又开)

4.新建输入文件夹

hadoop fs -mkdir -p /input/wordcount 如果报错Command ‘hadoop‘ not found, did you mean

参考这篇博文:(37条消息) hdfs报错Command ‘hdfs‘ not found, did you mean_hdfs not found_码农阿益的博客-CSDN博客

5.新建输出文件夹

hadoop fs -mkdir -p /output6.上传WDtest.txt到输入文件夹中

hadoop fs -put /usr/WDtest /input/wordcount

7.运行自带的wordcount程序

注意版本号是否一样,不一样去到沿着路径查看后修改

cd /usr/local/hadoop/share/hadoop/mapreduce

hadoop jar hadoop-mapreduce-examples-3.1.3.jar wordcount /input/wordcount /output/wordcountresult8.生成执行结果

hadoop fs -text /output/wordcountresult/part-r-000009.关闭hadoop

cd /usr/local/hadoop

./sbin/stop-all.sh

1385

1385

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?