1 安装pycharm,配置python开发环境

Pycharm下载和配置环境参照PyCharm 安装教程(Windows) | 菜鸟教程 (runoob.com)

环境配置后可以在cmd输入python,出现Python版本就说明已有Python环境

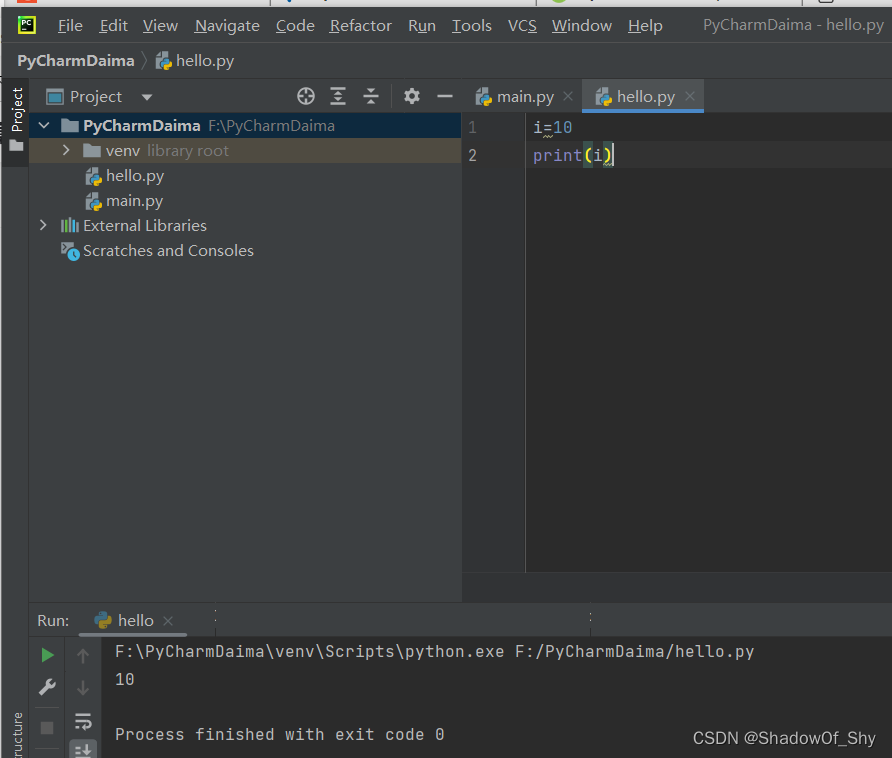

安装和配置完毕后运行一个简单的py程序验证一下:

2 安装pytorch

安装pytorch之前需要先安装Anaconda(建议去这里下载,官网太慢了Index of /anaconda/archive/ | 清华大学开源软件镜像站 | Tsinghua Open Source Mirror)

安装好Anaconda后,进入PyTorch,选择要下载的PyTorch版本

使用Anaconda输入下图划线的代码来安装Pytorch(CUDA是用显卡来进行学习,最后一个是用CPU进行学习)

(输入下载的代码之前可以先依次输入以下几行代码来使用清华镜像,不然下载速度太慢或者下载进度卡住不动)

conda config --add channels https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/free/

conda config –-add channels https://mirrors.ustc.edu.cn/anaconda/pkgs/free/

conda config --add channels https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud/conda-forge/

conda config --set show_channel_urls yes

安装完成后可以先输入python,再输入import torch,若没有报错则说明配置完毕

3 使用pytorch实现反向传播

import torch

import numpy as np

x_data=[1.0,2.0,3.0]

y_data = [2.0, 4.0,6.0]

w = torch. Tensor([1.0]) #权重初始值

w.requires_grad = True #是否需要计算梯度,Tensor创建之 后默认不计算梯度

# y_predict=x*w

def forward(x) :

return x * w

def loss(x,y): #损失函数

y_pred = forward(x)

return (y_pred - y) ** 2

#训练过程

#第一步:先算损失Loss

#第二步: backward, 反向传播

#第三步:梯度下降

for epoch in range(100):

for x,y in zip(x_data,y_data):

l = loss(x, y) #前向传播,求Loss, 构建计算图

l.backward() #反向传播,求出计算图中所有梯度存入w中

print("\tgrad:",x, y, w.grad.item())

w.data = w.data - 0.01 * w.grad.data # w.. grad. data:获取梯度,用data计算, 不会建立计算图

w. grad. data. zero_() #注意:将w中所有梯度清零

print("pregress:",epoch,l.item())

运行结果:

下面输出还有很多,不一一列举

4.Autograd自动求导

PyTorch中,所有神经网络的核心是autograd包。先简单介绍一下这个包,然后训练我们的第一个的神经网络。 autograd包为张量上的所有操作提供了自动求导机制。它是一个在运行时定义(define-by-run)的框架,这意味着反向传播是根据代码如何运行来决定的,并且每次迭代可以是不同的。

①张量

先导入包

import torch创建一个张量并设置requires_grad=True用来追踪其计算历史

x = torch.ones(2, 2, requires_grad=True)

print(x)输出:

对这个张量做一次运算:

y = x + 2

print(y)输出:

y是计算的结果,所以它有grad_fn属性

print(y.grad_fn)输出:

对y进行更多操作:

z = y * y * 3

out = z.mean()

print(z, out)输出:

.requires_grad_(...) 原地改变了现有张量的 requires_grad 标志。如果没有指定的话,默认输入的这个标志是False

a = torch.randn(2, 2)

a = ((a * 3) / (a - 1))

print(a.requires_grad)

a.requires_grad_(True)

print(a.requires_grad)

b = (a * a).sum()

print(b.grad_fn)输出:

②梯度

因为out是一个标量。所以让我们直接进行反向传播,out.backward()和out.backward(torch.tensor(1.))等价

out.backward()输出导数d(out)/dx

print(x.grad)输出:

计算过程实质就是一个标量函数对于各个分量求偏导数

数学上,若有向量值函数y=f(x),那么y相对于x的梯度是一个雅各比矩阵:

通常来说,torch.autograd是计算雅各比向量积的一个“引擎”。也就是说,给定任意向量V=

计算乘积J.v。如果v恰好是一个标量函数L=g(y)的导数即V=

根据链式法则,雅克比向量积应该是l对x的导数

雅可比向量积的这一特性使得将外部梯度输入到具有非标量输出的模型中变得非常方便。 现在来看一个雅可比向量积的例子:

x = torch.randn(3, requires_grad=True)

y = x * 2

while y.data.norm() < 1000:

y = y * 2

print(y)输出:

在这种情况下,y不再是标量。torch.autograd不能直接计算完整的雅可比矩阵,但是如果我们只想要雅可比向量积,只需将这个向量作为参数传给backward:

v = torch.tensor([0.1, 1.0, 0.0001], dtype=torch.float)

y.backward(v)

print(x.grad)输出:

为了防止跟踪历史记录(和使用内存),可以将代码块包装在with torch.no_grad():中。在评估模型时特别有用,因为模型可能具有requires_grad = True的可训练的参数,但是我们不需要在此过程中对他们进行梯度计算。 也可以通过将代码块包装在 with torch.no_grad(): 中,来阻止autograd跟踪设置了 .requires_grad=True 的张量的历史记录。

print(x.requires_grad)

print((x ** 2).requires_grad)

with torch.no_grad():

print((x ** 2).requires_grad)输出:

参考链接:

(1条消息) 06 Pytorch实现反向传播_蓝子娃娃的博客-CSDN博客_pytorch反向传播

PyTorch Autograd自动求导_w3cschool

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?