这里写目录标题

1.机器学习基本介绍

机器学习就是给定一定的输入,通过施加一定的算法,得到输出,然后通过学到的知识,输入新的数据,获得新的输出。它们的关系如下图:

而逻辑回归是机器学习中比较常用的一种算法。

2.逻辑回归算法思想

逻辑回归一般运用于两种问题,一种是估计某事物的可能性,另一种是适用于流行病学资料的危险因素分析。逻辑回归是线性回归的一种,它是被logistic方程归一化后的线性回归。在许多实际问题中,比如流行病学常研究的二分类因变量(患病与未患病,阳性与阴性等)与一组(X1,X2,X3…,Xn)自变量的关系这类问题时,我们需要回归产生一个类似概率值(0-1)之间的数值来进行预测。这种情况下这个数值必须是0-1之间,而线性回归就显得无能为力了,因此人们引入了Logistic方程来做归一化。使因变量的取值框定在0-1之间,这种变换方法称之为逻辑回归。因此通俗的说,逻辑回归是一个线性回归经过阶跃函数的处理,变成一个二项分类器,输出结果只能是0,1的条件概率的大小,是一种概率模型。逻辑回归本质上是线性回归,只是在特征到结果的映射中加入了一层函数映射,即先把特征线性求和,然后使用函数g(z)将结果作为假设函数来预测。

3.逻辑回归公式(sigmoid函数)

3.1sigmoid函数

3.2逻辑函数图像

该函数有一个很好的特性就是在实轴域上y的取值在(0,1),且有很好的对称性,对极大值和极小值不敏感(因为在取向无论是正无穷还是负无穷的时候函数的y几乎很稳定)。sigmoid函数值域在(0,1)之间,正好可以表示成一个概率值。

3.3逻辑函数的导数

3.4逻辑函数的概率表达式

g(z)可以将连续值映射到0到1之间。线性回归模型的表达式带入g(z),就得到逻辑回归的表达式:

θTx=θ0+θ1x1+θ2x2+…+θnxn(多元变量线性函数)

如果是一元线性函数,则θTx=θ0+θ1x

输出结果为1和0(分别代表两种输出情况)的概率分别是:

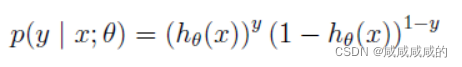

将(1)合并成

4.求解θ

求解θ有两种方法:最大似然估计法和损失函数法。

4.1损失函数法

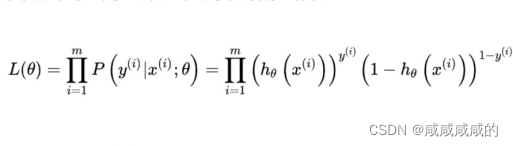

我们用极大似然函数建立损失函数:

利用梯度下降法求θ

4.2最大似然估计法

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?