背景:1、生成性对抗性网络(GAN)在生成出色图像方面取得了普遍成功,但是,由于计算成本和庞大的内存使用,它们在资源受限的设备上部署起来很麻烦。

2、尽管最近压缩GAN的努力取得了显著的成果,但它们仍然存在潜在的模型冗余,可以进一步压缩。

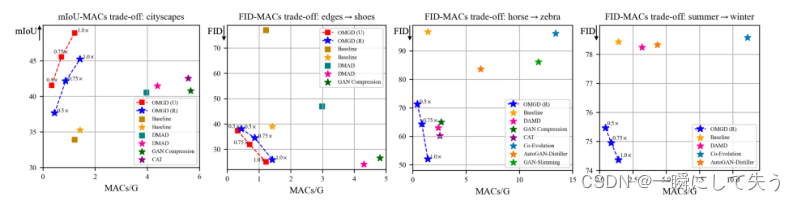

方法简介:1、提出了一种新的在线多粒度蒸馏(OMGD)方案来获得轻量级的GAN,这有助于以低计算需求生成高保真图像。

2、首次尝试推广面向GAN压缩的单级在线蒸馏,其中逐步提升的教师生成器有助于改进无鉴别器的学生生成器。

3、互补的教师生成器和网络层提供了全面和多粒度的概念,以从不同维度增强视觉逼真度。

1、模型方法

1.1在线GAN蒸馏

提出了一种面向GAN的在线蒸馏算法来解决离线蒸馏中的三个关键问题。

a、传统离线蒸馏方法中的学生生成器应保持一定容量,以保持与鉴别器的动态平衡,以避免模型崩溃和梯度消失。

b、学生生成器不再与鉴别器深度绑定,它可以更灵活地训练并获得进一步压缩。

c、由于评估指标是主观的,因此选择合适的预培训教师生成器并非易事,但该方法不需要预先训练的模型。

1.1.1教师生成器

遵循损失函数和训练设置来训练教师生成器

和鉴别器D。

旨在学习一个函数,将数据从源域X映射到目标域Y。我们以Pix2Pix为例,它使用配对数据(

,其中

和

)优化网络。

训练生成器

将

映射到

,而训练鉴别器D将

生成的假图像与真实图像区分开来。

此外,引入重建损失以将

输出的输出值推到接近真实标签y:

GAN设置中的整体目标损失定义为:

1.1.2学生生成器

在所提出的面向GAN的在线蒸馏方案中,学生生成器

仅利用教师网络

进行优化,并且可以在无鉴别器设置中进行训练。

的优化不需要同时使用真实标签y。

ps:即

仅学习具有类似结构(

)的较大容量的输出,这大大降低了直接拟合y的难度。

将

的输出表示为

,我们使用结构相似性(SSIM)损失和感知损失来测量

和

之间的差异。给定

、

、SSIM损失,通过以下公式计算两幅图像的相似性:

:亮度估计的平均值;

:对比度的标准差;

:结构相似性估计的协方差;

:避免零分母的常数。

感知损失包括特征重建损失和风格重建损失。特征损失鼓励pt和ps具有相似的特征表示,这些特征表示由预训练的VGG网络

测量。

特征形式化为:

其中

是输入x的

的第j层的激活。

是

的维数。

用于惩罚风格特征的差异,如颜色、纹理、常见图案等。

可计算为:

其中

是VGG网络中第j层激活的Gram矩阵。

此外,引入了总变化损失

,以促进生成图像的空间平滑。我们使用四个超参数

、

、

、

来实现上述损失之间的平衡,因此总在线KD损失

计算如下:

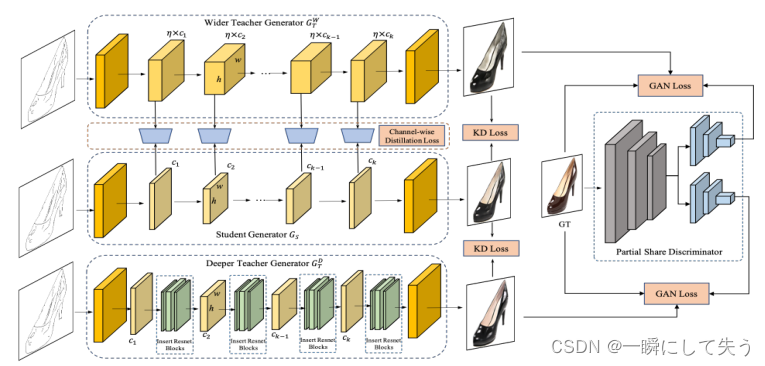

1.2多粒度知识蒸馏框架

OMGD框架 基于新的在线GAN蒸馏技术,进一步从两个角度将我们的方法扩展为多粒度方案:

a、教师生成器的互补结构和来自不同层的知识。在线多粒度蒸馏(OMGD)框架的整个流程如上图所示。

b、使用更广泛的教师生成器

和更深入的教师生成器

来形式化

的多目标优化任务。除了教师生成器的输出层,我们还通过通道蒸馏损失从中间层挖掘知识概念。

1.2.1多教师知识蒸馏

基于不同结构的教师生成器有助于从真实标签捕获更多互补图像线索,并从不同角度提高图像翻译性能。此外,多教师蒸馏设置可以进一步缓解过度拟合的问题。从两个互补的维度,即深度和宽度,将学生模型扩展为教师模型。

a、给定学生生成器

,我们扩展

的通道以获得更宽的教师生成器

,卷积层的每个通道乘以通道扩展因子η。

b、在每个下采样层和上采样层之后插入几个resnet块到

中,以构建更深层的教师生成器

,其容量与

相当。

部分共享鉴别器设计用于共享前几层,并分离两个分支,以分别获得

和

的鉴别器输出。

ps:这种共享设计不仅提供了鉴别器的高度灵活性,还利用了输入图像的相似特性来改进生成器的训练。

我们直接将互补教师发生器提供的两个蒸馏损失合并为多教师设置中的KD损失:

其中

和

分别是

和

的输出层的激活。

1.2.2中间层知识蒸馏

输出层的概念没有考虑教师网络的更多中间细节,因此我们进一步将信道粒度信息作为附加的监督信号传输,以促进

。具体地说,我们计算通道关注权重,以测量特征图中每个通道的重要性。关注权重

定义为:

其中

表示特征图的第c个通道。然后将1×1卷积层连接到

的中间层,以扩展通道数量,通道蒸馏(CD)损失计算如下:

其中n是要采样的特征图的数量,c是特征图的通道数。

是第i个特征图的第j个通道的关注权重。

总之,整个在线多粒度蒸馏目标形式化为:

2、总结

1、提出了一种在线多粒度蒸馏(OMGD)技术来学习轻量级GAN。引入面向GAN的在线方案,交替促进教师和学生生成器,教师帮助学生热身,逐步引导优化方向。

2、OMGD还充分利用了来自互补教师生成器和来自不同层的辅助监督信号的多粒度概念。

771

771

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?