声明:本笔记全部图片均来自B站UP主二次元的Datawhale,视频链接:【【吃瓜教程】《机器学习公式详解》(南瓜书)与西瓜书公式推导直播合集】https://www.bilibili.com/video/BV1Mh411e7VU?p=3&vd_source=75bd1e93279e61f02a4580ce77d01f4b

本次我们主要研究神经网络模并以前馈神经网络为例。西瓜书和对应章节5.1 5.2 5.3

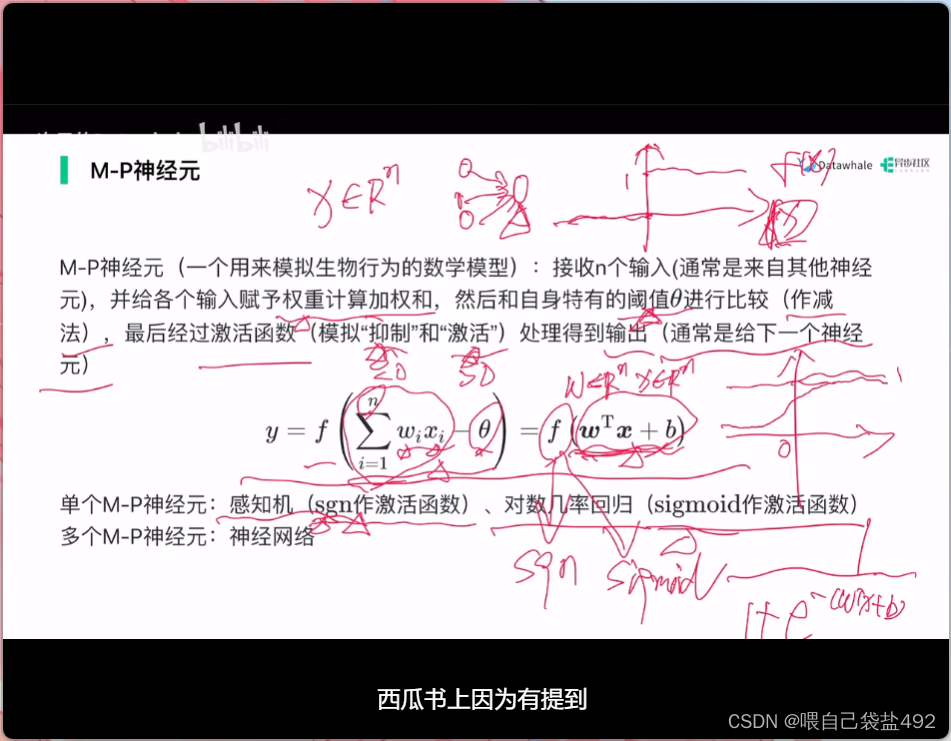

一、M-P神经元

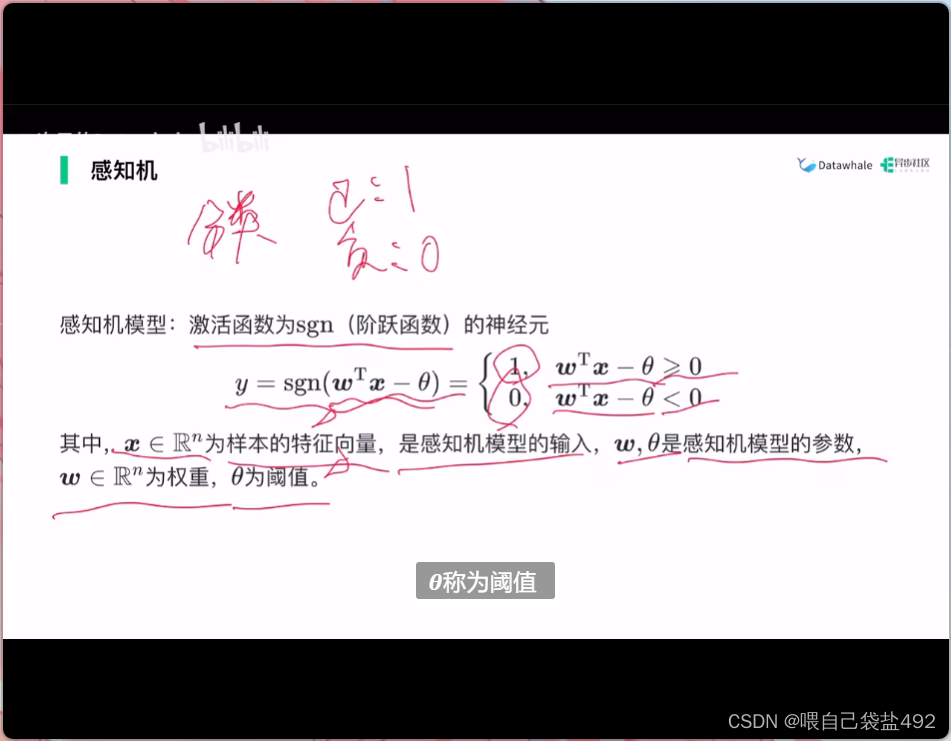

二、感知机(分类模型)

数学角度定义

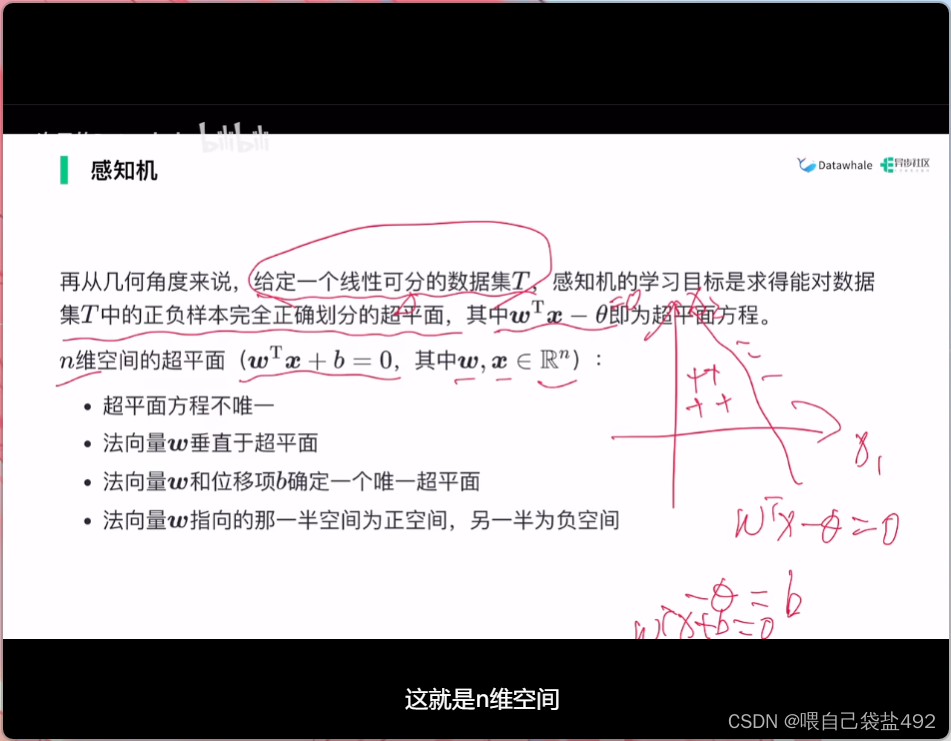

从几何角度定义

首先要求数据集线性可分,其中线性算式即为超平面方程

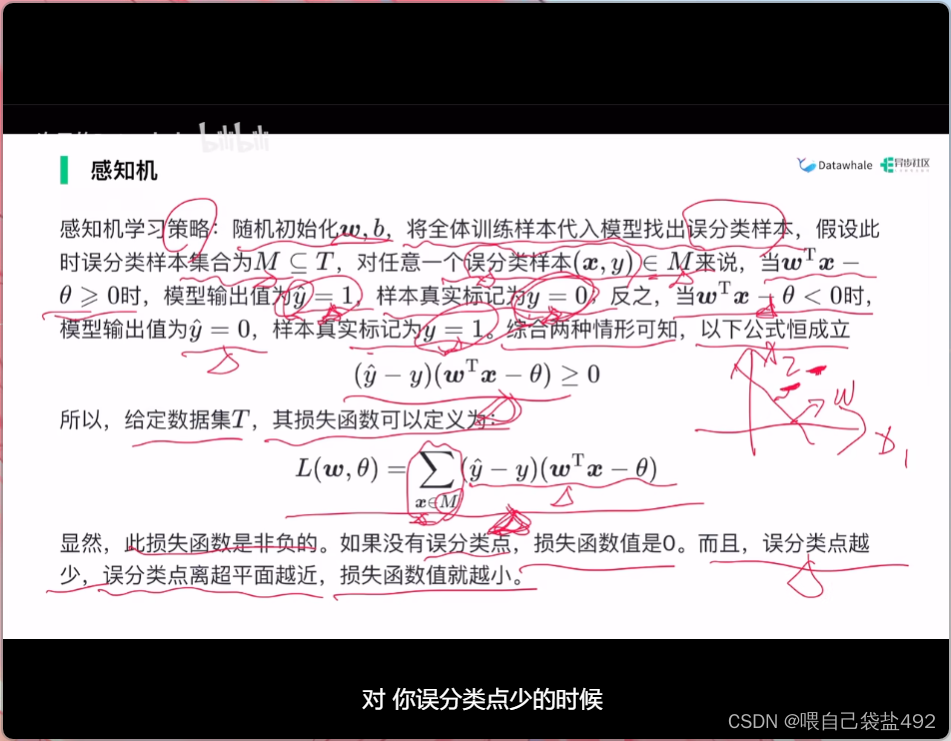

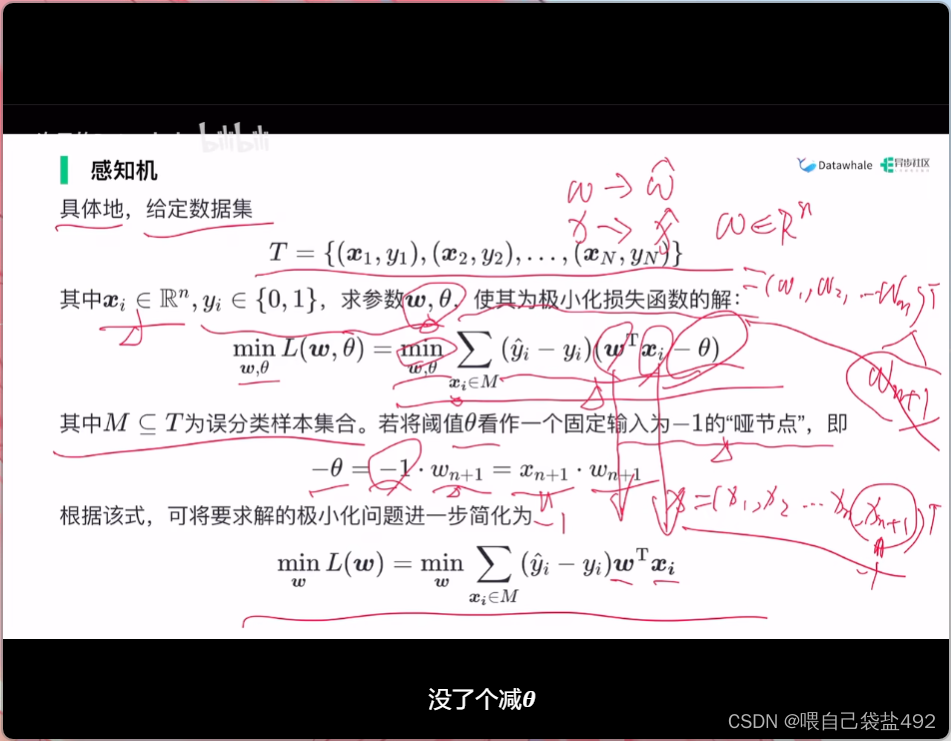

学习策略(损失函数推导)

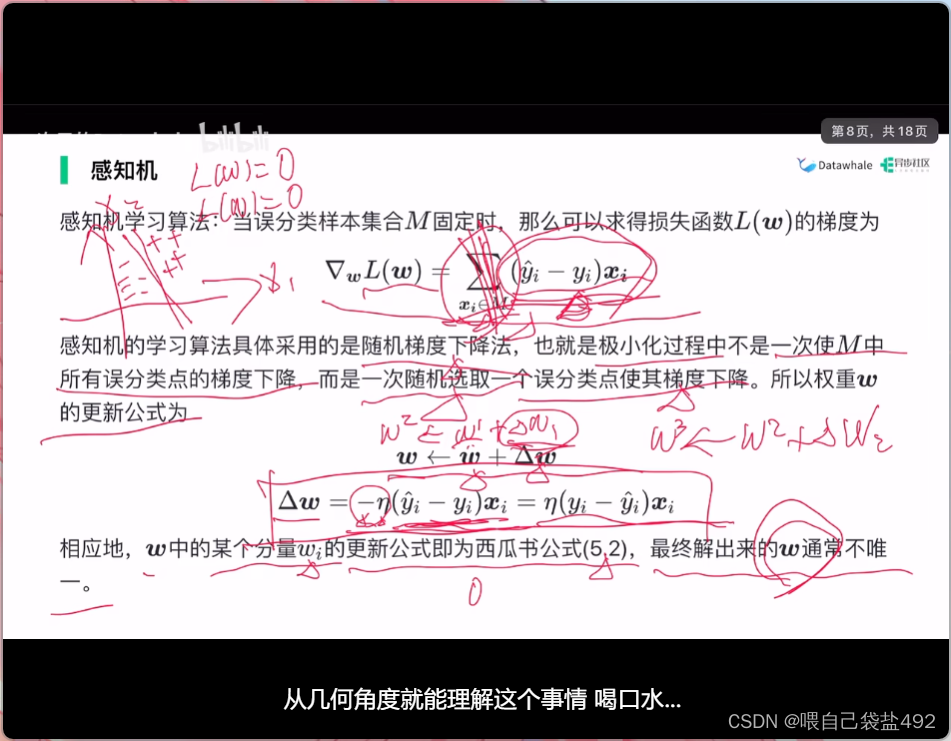

损失函数优化方法

用随机梯度下降法

详细理论可以参见《统计学方法》

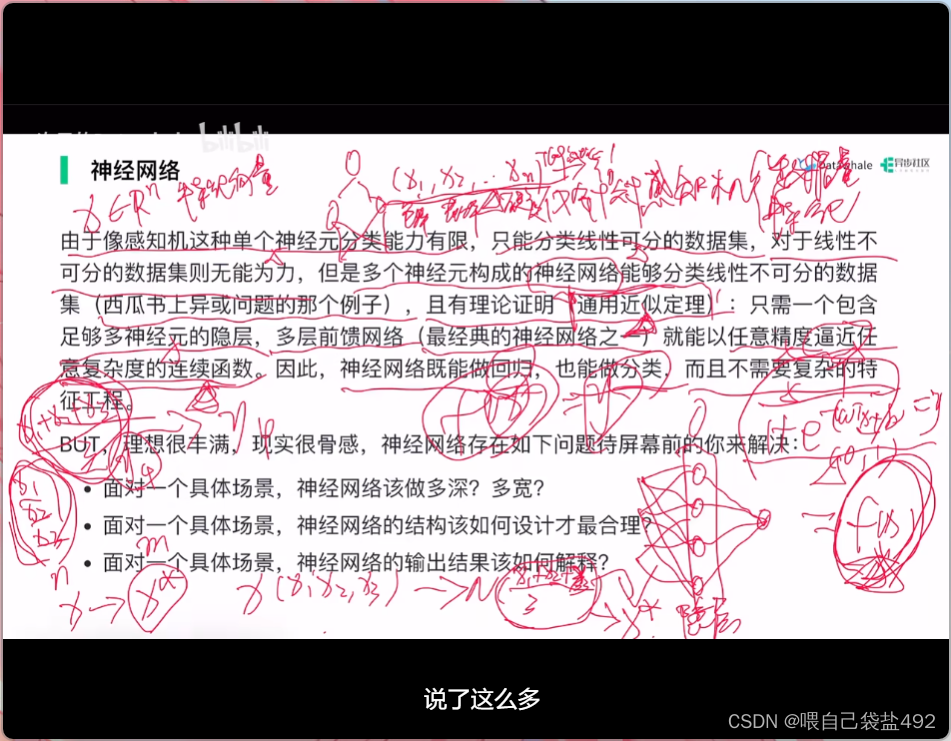

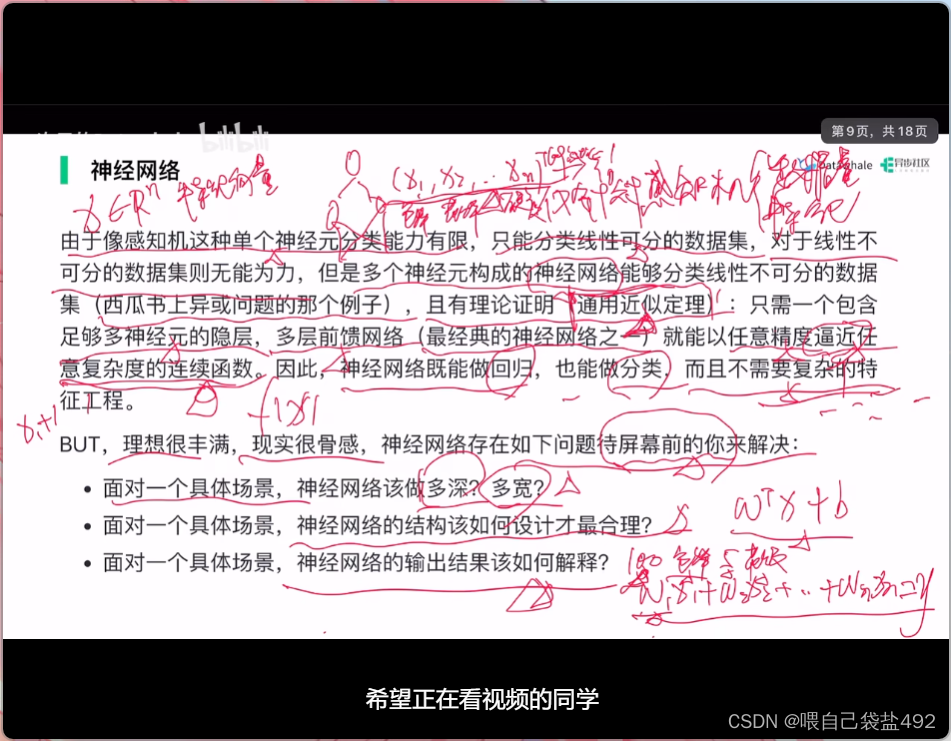

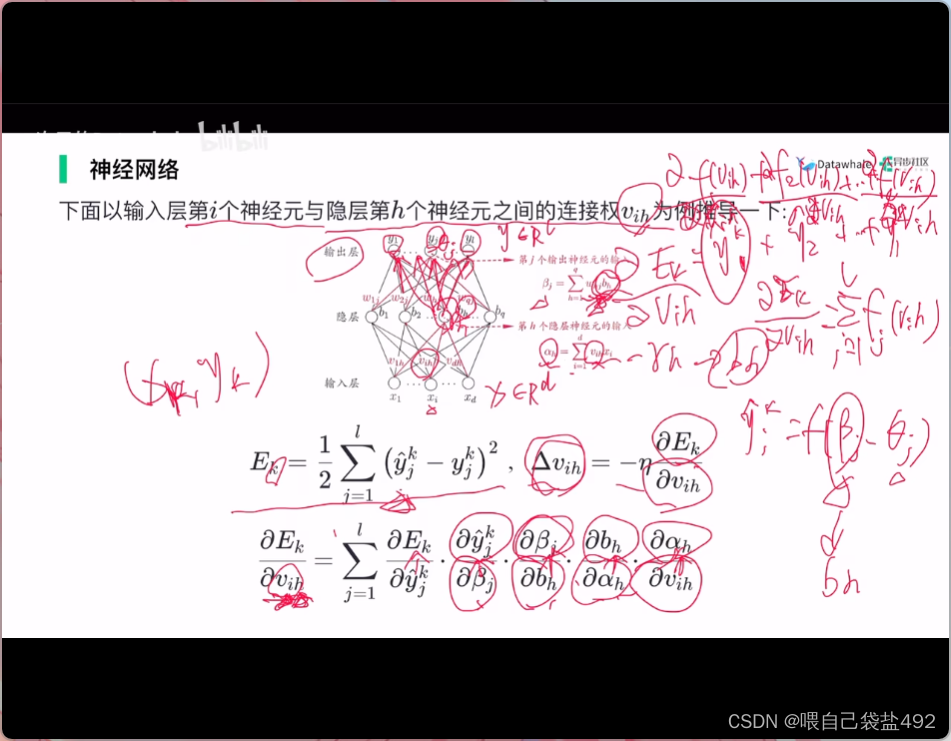

三、神经网络

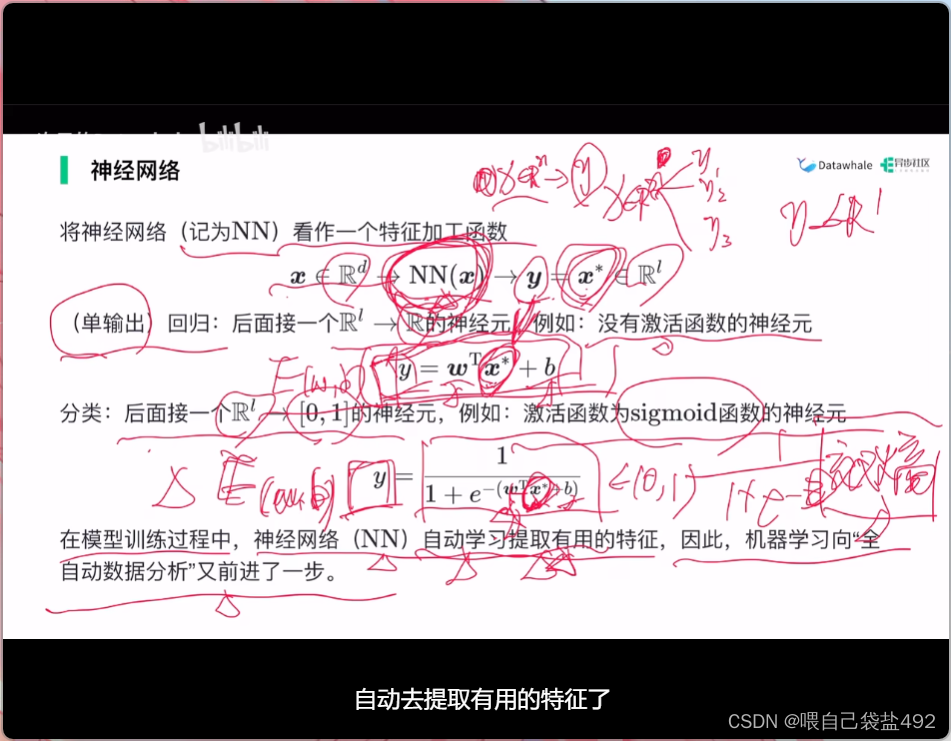

神经网络包含特征工程的能力

神经网络虽然强大,但也存在一些问题

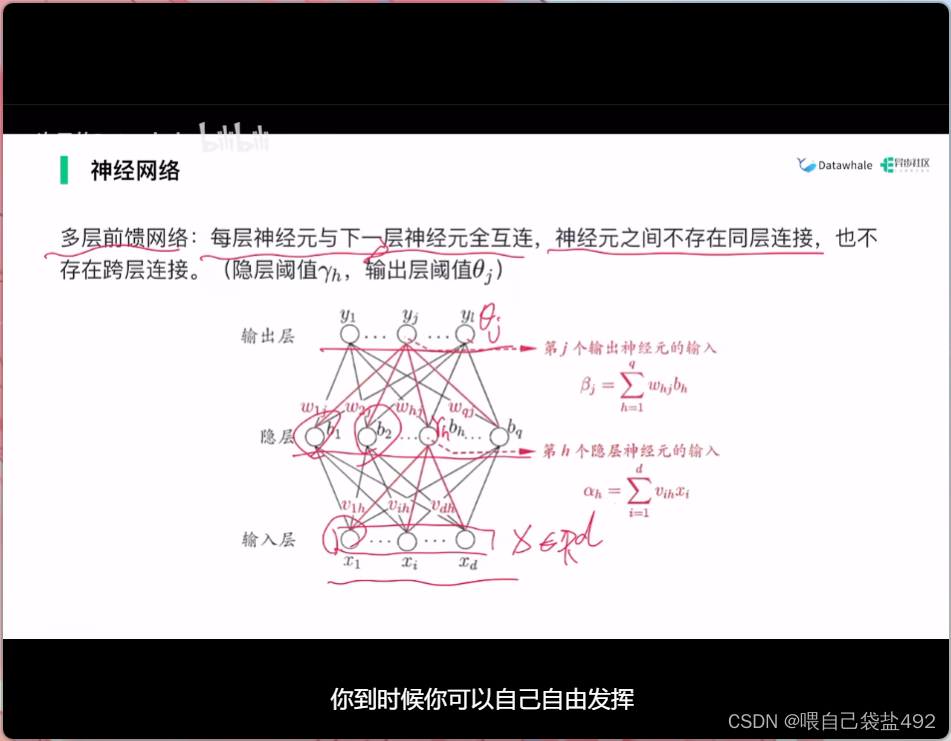

多层前馈网络

结构

现在我们用神经网络做分类与回归两大任务

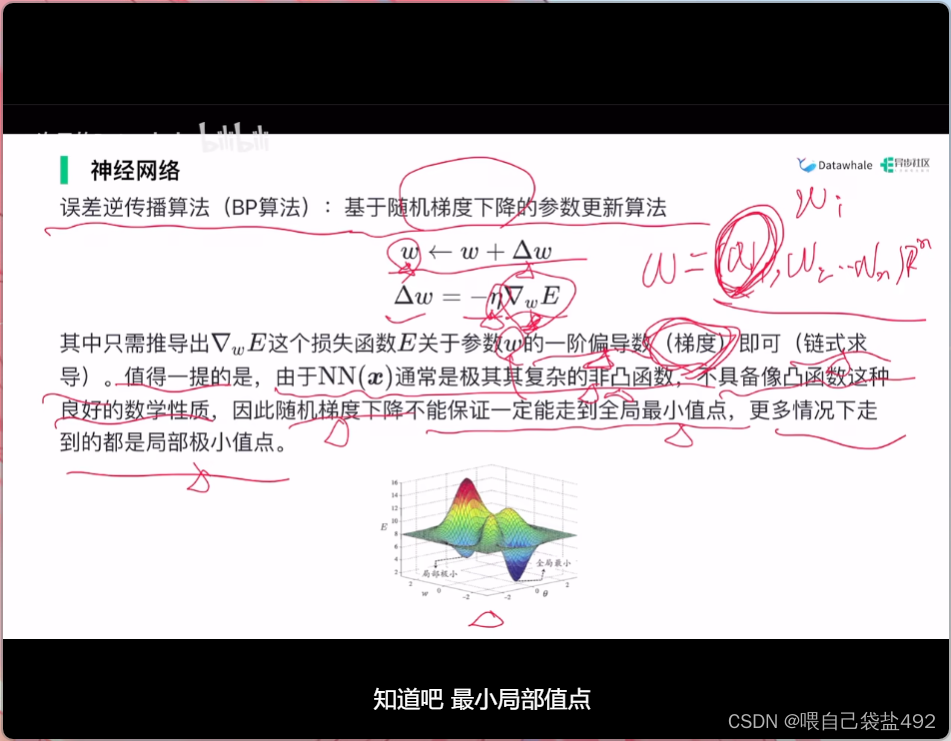

回归(输出单值或多值):套用线性回归模型,但神经网络套用线性回归模型后所导出的函数往往不是凸函数,故我们采用梯度下降法结合BP算法去确定参数。

分类:套用sigmoid函数,也是梯度下降法结合BP算法。

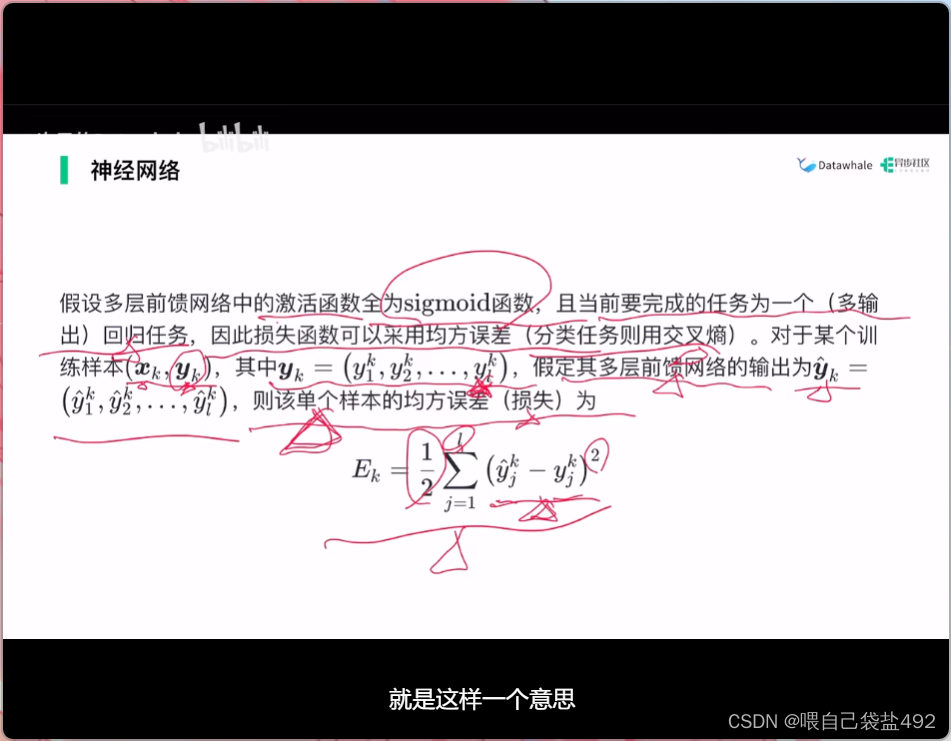

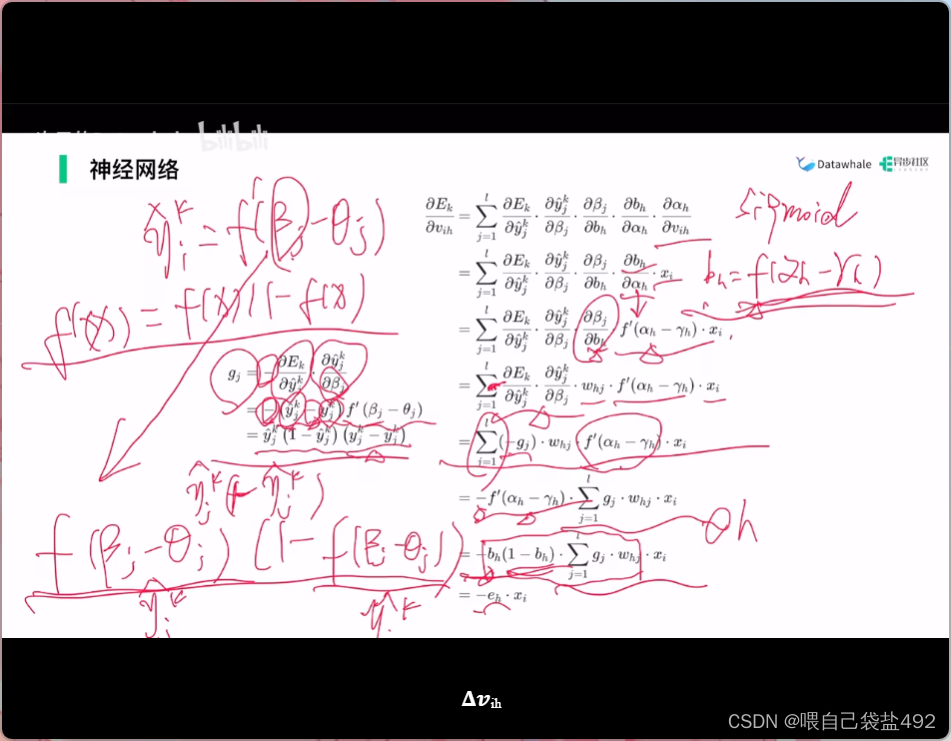

算法原理,以sigmoid函数回归多输出任务为例

随机梯度下降未必能够走到全局最小值点,更多情况是局部极小值点,我们可以通过看测试集效果来进行考量

由于前馈神经网络是层连的,因此要把所有的链式求导结果相加

我们以一个参数为例

672

672

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?