一、神经网络基础

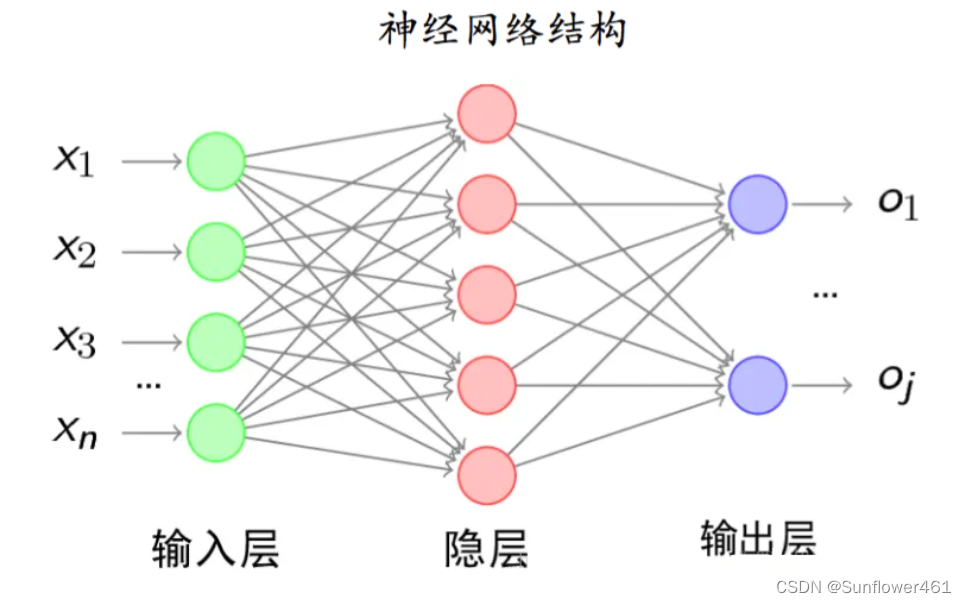

全连接神经网络

全连接神经网络是一种连接方式较为简单的人工神经网络结构,某一层的任意一个节点,都和上一层所有节点相连接。

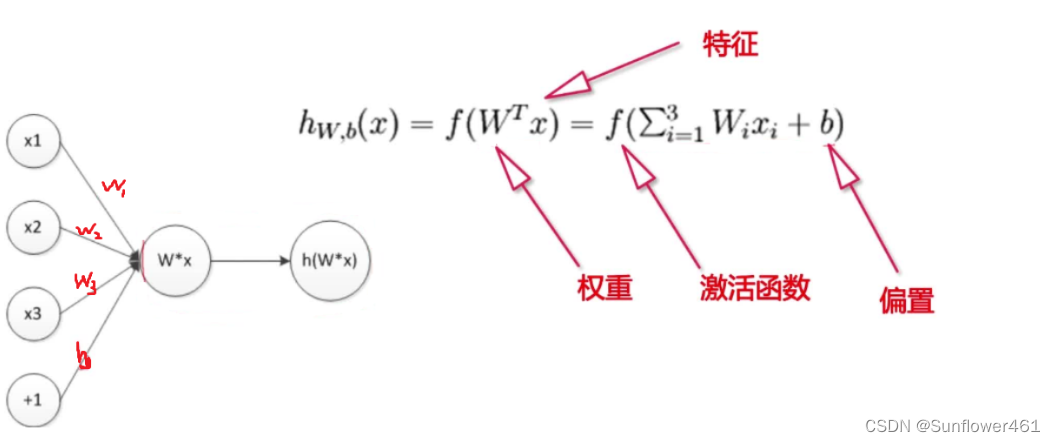

感知器工作机制

感知器即单层神经网络,也即"人工神经元",是组成神经网络的最小单元

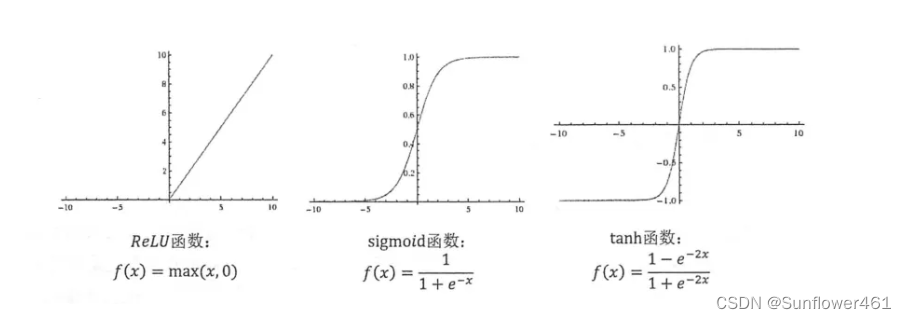

神经网络的激活函数

在神经网络中可以引入非线性激活函数,这样就可以使得神经网络可以对数据进行非线性变换,解决线性模型的表达能力不足的问题。

常见的激活函数

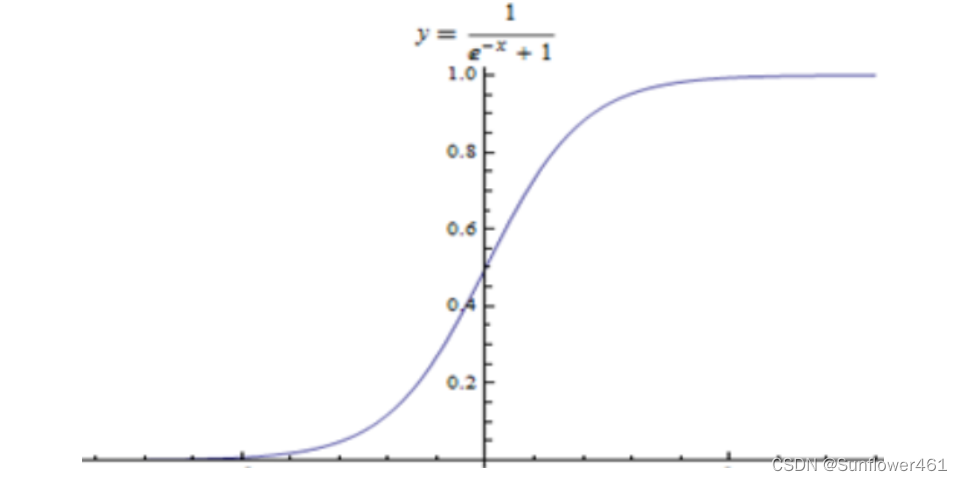

Sigmoid激活函数:

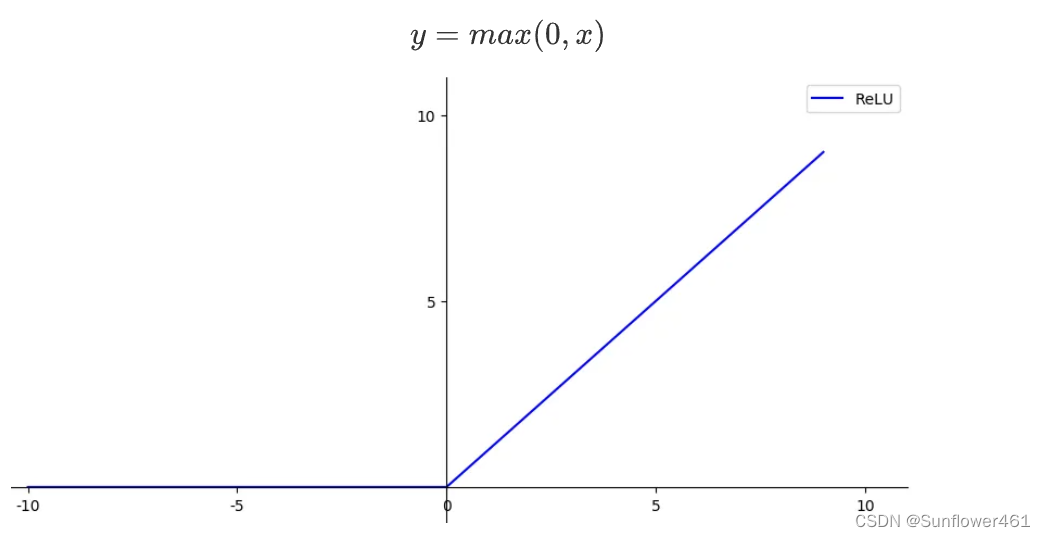

Relu激活函数

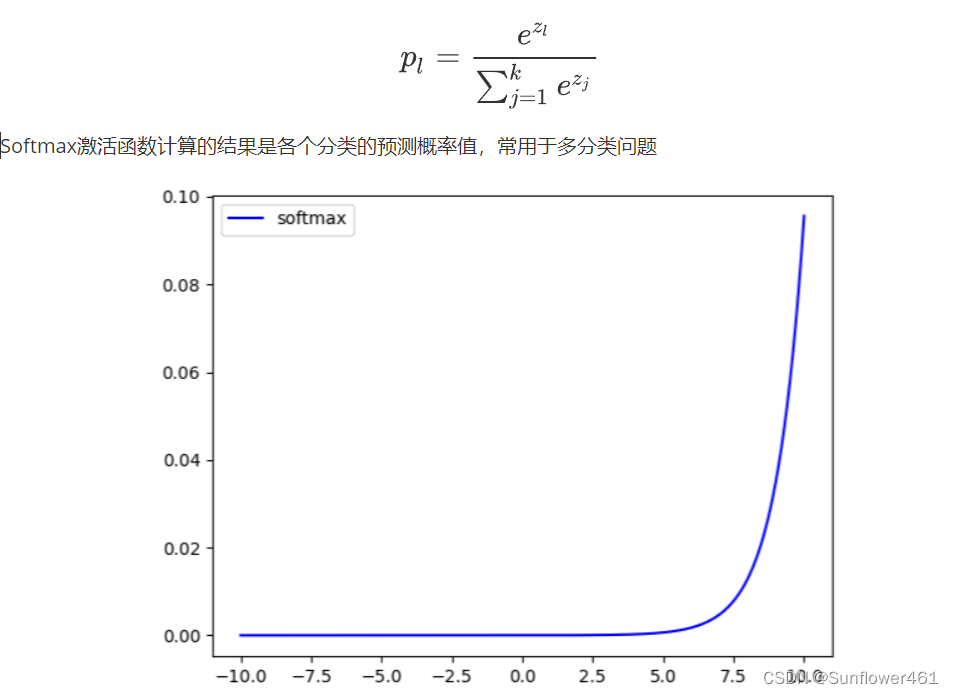

Softmax激活函数

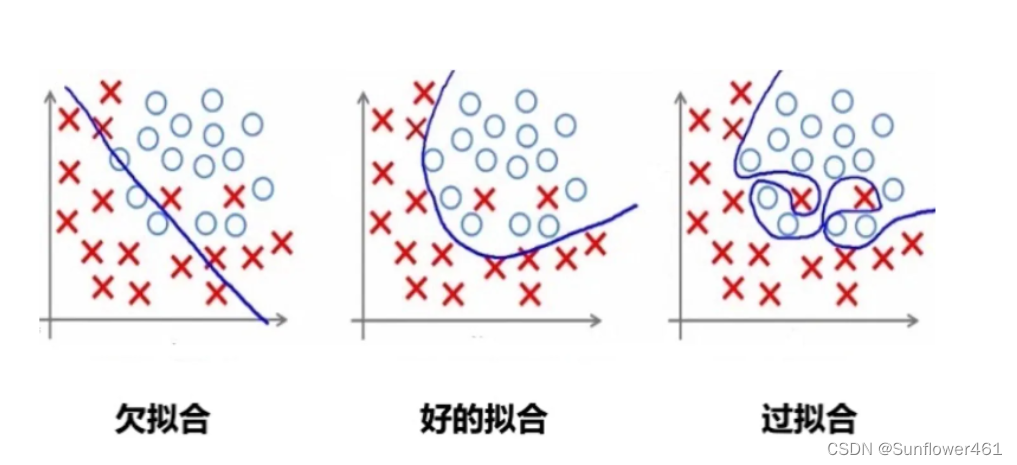

神经网络的过拟合问题

解决神经网络过拟合问题的方法

-

正则化

与很多机器学习算法一样,可以在待优化的目标函数上添加正则化项(例如L1、L2正则),可以在一定程度减少过拟合的程度。

-

Dropout(随机失活)

可以将Dropout理解为对神经网络中的每一个神经元加上一道概率流程,使得在神经网络训练时能够随机使某个神经元失效。

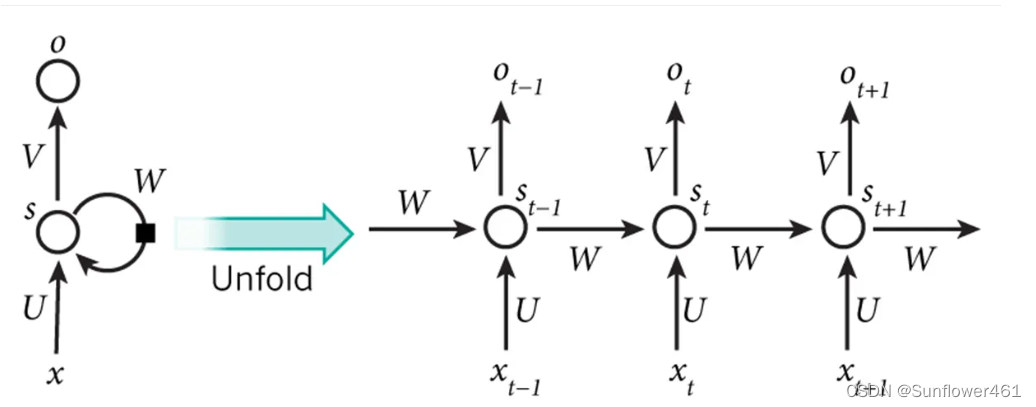

二、循环神经网络

认识RNN

RNN(Recurrent Neural Network),即"循环神经网络",是在基础神经网络模型中增加了循环机制。具体的表现形式为网络会对前面的信息进行记忆并应用于当前的计算中,即当前时刻利用了上一时刻的信息,这便是“循环”的含义。

RNN的应用领域

-

语音识别

-

OCR识别(optical character recognition)

-

机器翻译

-

文本分类

-

视频动作识别

-

序列标注

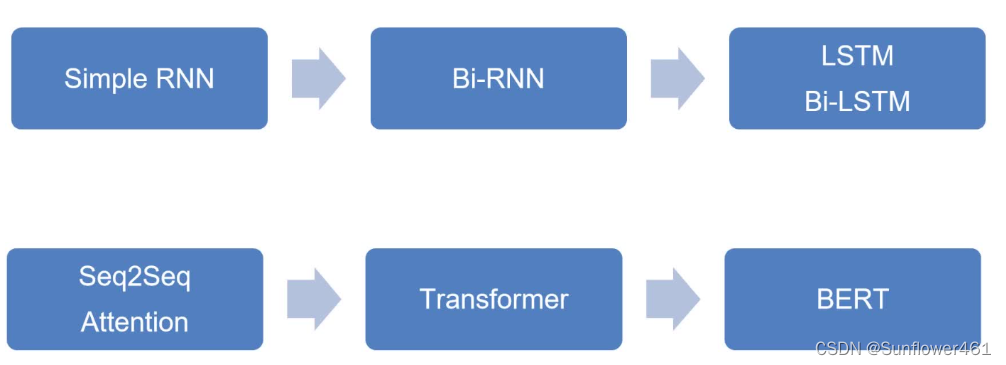

常见的RNN模型

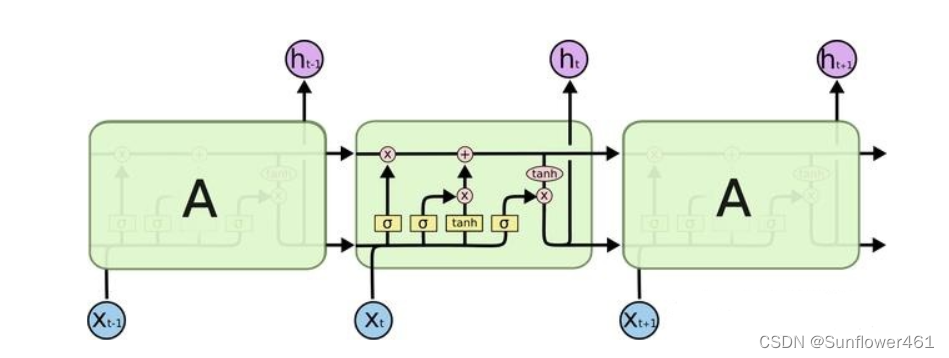

LSTM

LSTM是Long-Short Term Memory的缩写,中文名叫长短期记忆网络,它是RNN的改进版本。为了更好地解决“梯度爆炸”和“梯度消失”的问题,让RNN具备更强、更好的记忆,于是就出现了LSTM。

LSTM的“门结构”

LSTM的关键就是记忆细胞(在最上面的贯穿水平线上)。记忆细胞提供了记忆的功能,使得记忆信息在网络各层之间很容易保持下去。

-

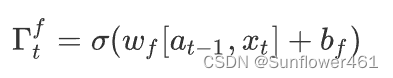

遗忘门(Forget Gate)

遗忘门的作用是控制t-1时刻到t时刻时允许多少信息进入t时刻的门控设备

遗忘门的计算公式如下:

其中,xt是当前时刻的输入,at-1是上一时刻隐状态的值

-

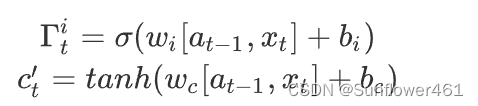

输入门(Input Gate)

输入门的作用是确定需要将多少信息存入记忆细胞中。除了计算输入门外,还需要使用tanh计算记忆细胞的候选值c't

然后,就可以对当前时刻的记忆细胞进行更新了

![]()

-

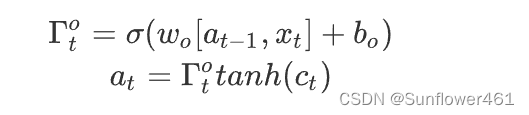

输出门(Output Gate)

输出门是用来控制t时刻状态值对外多少是可见的门控设备

输出门与t时刻隐层节点输出值得公式为:

7725

7725

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?