这个问题其实还有很多博主已经给出了解决问题,但我根据他们提出的解决方案仍然无法解决我DCGAN训练无法收敛的问题。

问题阐述

最近去做了DCGAN的项目,已经找好了数据集,代码也写完了。但是模型反复训练了有十几次,期间也断断续续的debug检查细节,修改代码。可是无论怎么改参数、改模型,甚至训练1000epoch,训练结果也还是呈现出生成器G损失不断上升,判别器损失趋于0的情况,出现不了所谓的纳什均衡。检查了生成器生成的图片,结果发现每一次迭代生成的都是随机噪声。

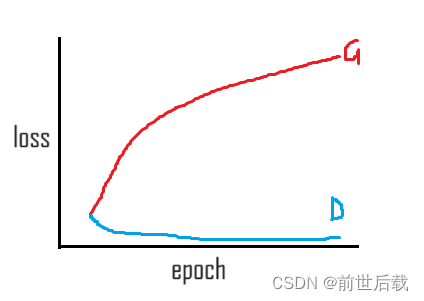

出现的问题的生成器G损失和判别器D损失曲线如下:

解决

错误1(训练策略的错误)

通过千辛万苦的检查,终于找出了错误。原来是训练生成器的时候。应该反向传播更新生成器的梯度,但是我手动切断了生成器的梯度,后果就是训练过程中梯度永远无法流经生成器模型,于是生成器学习停止。

这个问题出现在非常隐蔽的位置,问题出现在更新生成器的时候,仅仅是因为我在每一个batch批次使用判别器预测生成器的图片时给输入使用了.detach()。错误代码在如下:

g_pred = d_model(fake_img.detach())这行代码是在更新完判别器之后,更新生成器时,需要使用更新之后的判别器预测生成器生成的假图片,来让生成器学习提升自己。我错误的给G生成的图片fake_img使用了detach()函数,梯度根据g_pred反向传播的时候就从fake_img断开,不再流入生成器模型,生成器停滞学习。

正确代码为:

g_pred = d_model(fake_img) # 注意这里的fake_img不能detach,因为需要生成器的梯度错误2(数据预处理)

DCGAN作者提出的生成器模型结构的最后一层激活函数是Tanh(),根据Tanh()函数图像知,其输入结果为-1~1之间,因此对原数据集处理的时候就一定不要只进行归一化就完了,还需要进行标准化。

归一化的结果在0~1之间,而标准化的结果为标准正态分布,绝大多数都在-1~1之间。

数据预处理对于机器学习、深度学习,都是一个非常重要的步骤,永远不要粗心忽视了数据预处理。

问题讨论

有许多的其他博主针对此类问题,提出是判别器太强,判别器学习率太高的问题。但是对于本文中出现的此类严重问题不适用。本文中出现的问题,将导致生成器生成的图片永远都是随机噪声,无论怎么修改模型和学习率都不会收敛。

如果你训练GAN、DCGAN的时候,随着训练代数的增加,生成器的生成图片可以生成达到一定预期的图片,但是效果不行,那就是上面下划线的问题。

经过实验,生成器和判别器模型的参数量相近,本实验为1200w+个参数,不会出现判别器太强。

样例代码

这是我训练时候的代码,仅供参考

说明:g_model是生成器,d_model是判别器,optimizerD只对判别器参数进行优化,optimizerG只对生成器参数进行优化,real是全1的一维列表,fake是全0的一维列表

for epoch in range(epoch, max_epoch+1):

for i, real_img in enumerate(dloader):

z = torch.normal(0, 1, size=(batch_size, nz, 1, 1), device=device)

real_img = real_img.to(device)

fake_img = g_model(z)

real_pred = d_model(real_img)

fake_pred = d_model(fake_img.detach())

d_model.zero_grad()

d_loss = criterion(real_pred, torch.ones_like(real_pred, device=device))

d_loss.backward()

d_loss = criterion(fake_pred, fake)

d_loss.backward()

optimizerD.step()

g_model.zero_grad()

g_pred = d_model(fake_img) # 注意这里的fake_img不能detach,因为需要生成器的梯度

g_loss = criterion(g_pred, real)

g_loss.backward()

optimizerG.step()结果

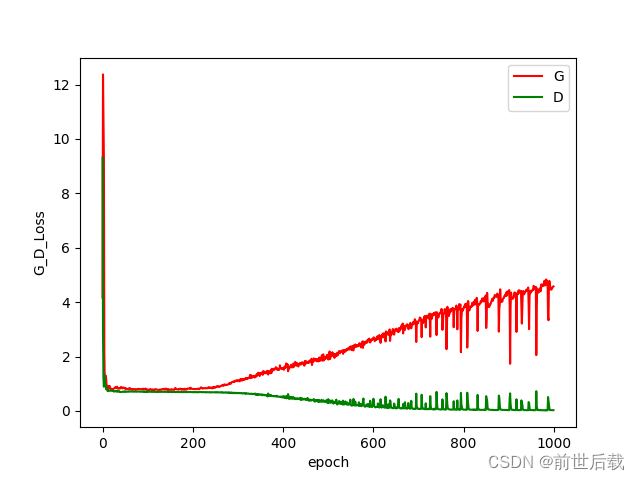

修改之后训练终于正常,生成器损失时而上升时而下降,而判别器损失上升下降与之相反。生成器生成的图片不再是随机噪声。这是1000epoch训练过程的损失曲线图。

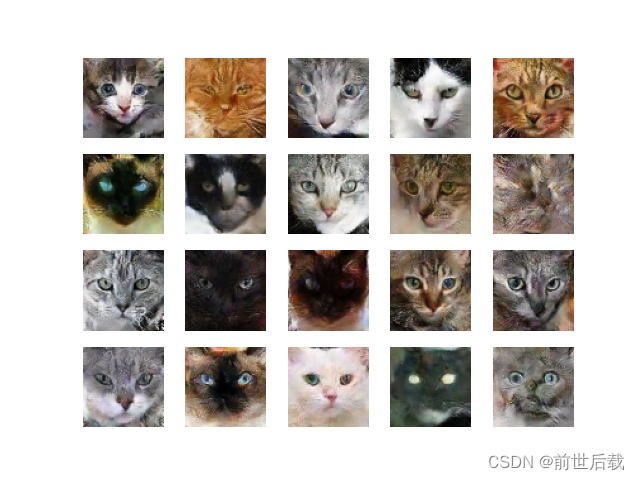

我使用的数据集是找的github一个博主的GAN项目的cat数据集,这是我训练1000epoch之后生成器生成的图片。

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?