@ 使用openai translator 配置本地大模型进行离线翻译。

1、下载并安装 chrome 插件 openai-translator. https://github.com/openai-translator/openai-translator/releases/tag/v0.3.25

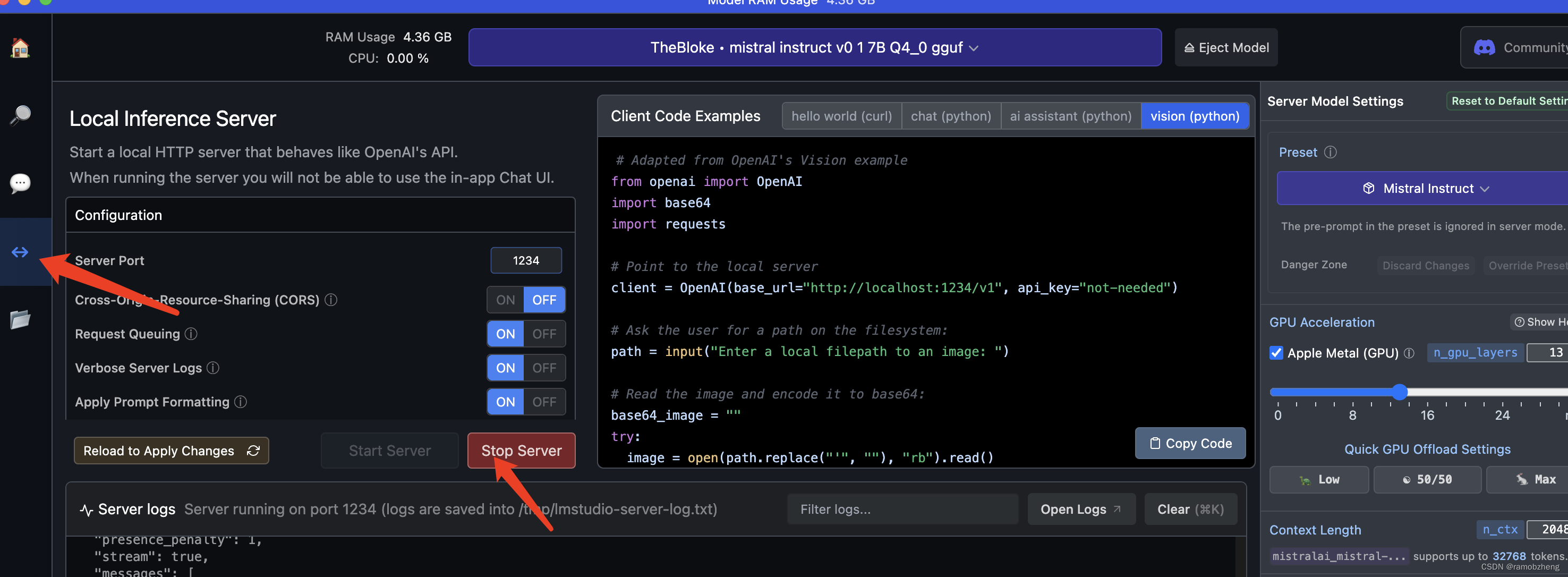

2、在 LM studio 中的Local Server 启动 本地大模型服务。以 Qwen-7B 大模型作为示例;(也可以通过ollama 启动本地大模型)

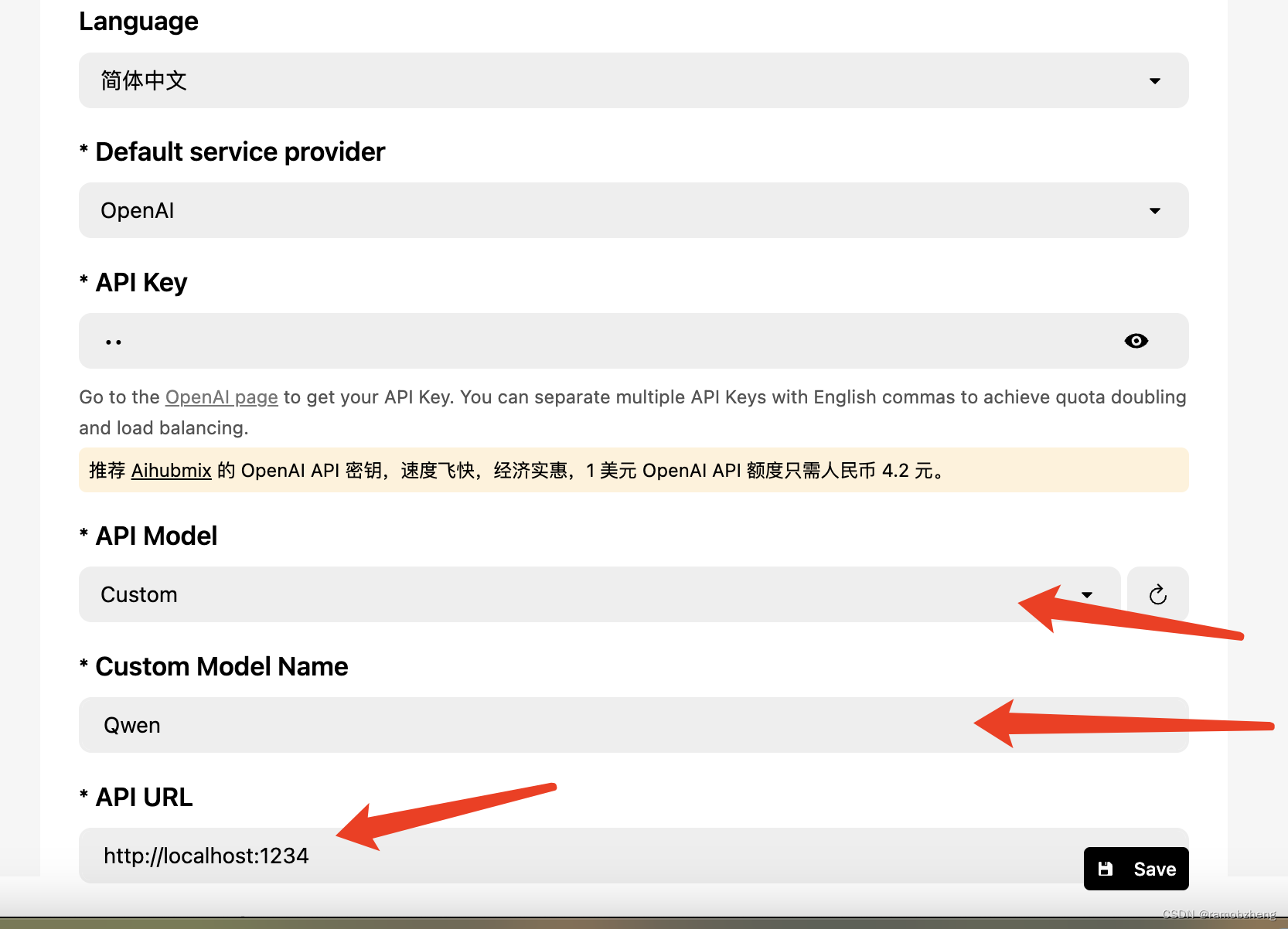

3、在openai-translator 配置使用本地LLM。

API Model 选择 Custom,Custom Model Name 填写你启动的模型,此次示例填写 Qwen。API URL填写你启动的服务地址和端口,本处以 http://localhost:1234 作为示例。选择保持后即可开始使用 openai translator进行文章翻译等功能。

73

73

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?