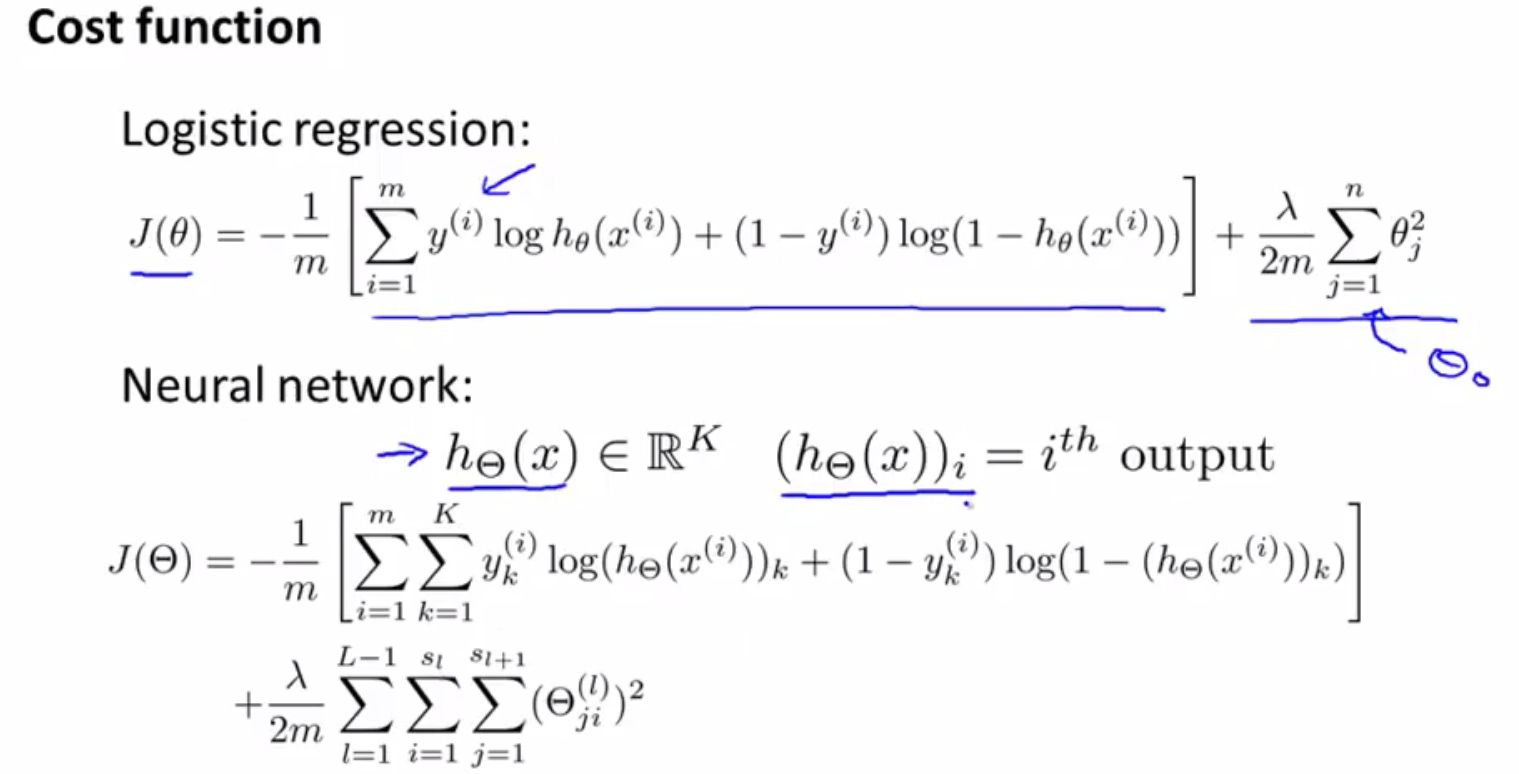

神经网络分类的costFunction

与逻辑回归类似, 只是将多分类k个误差加了上去。

要注意的是, 对于

θj0

不用进行正则化,这与逻辑回归的常数项不进行正则化也一样。

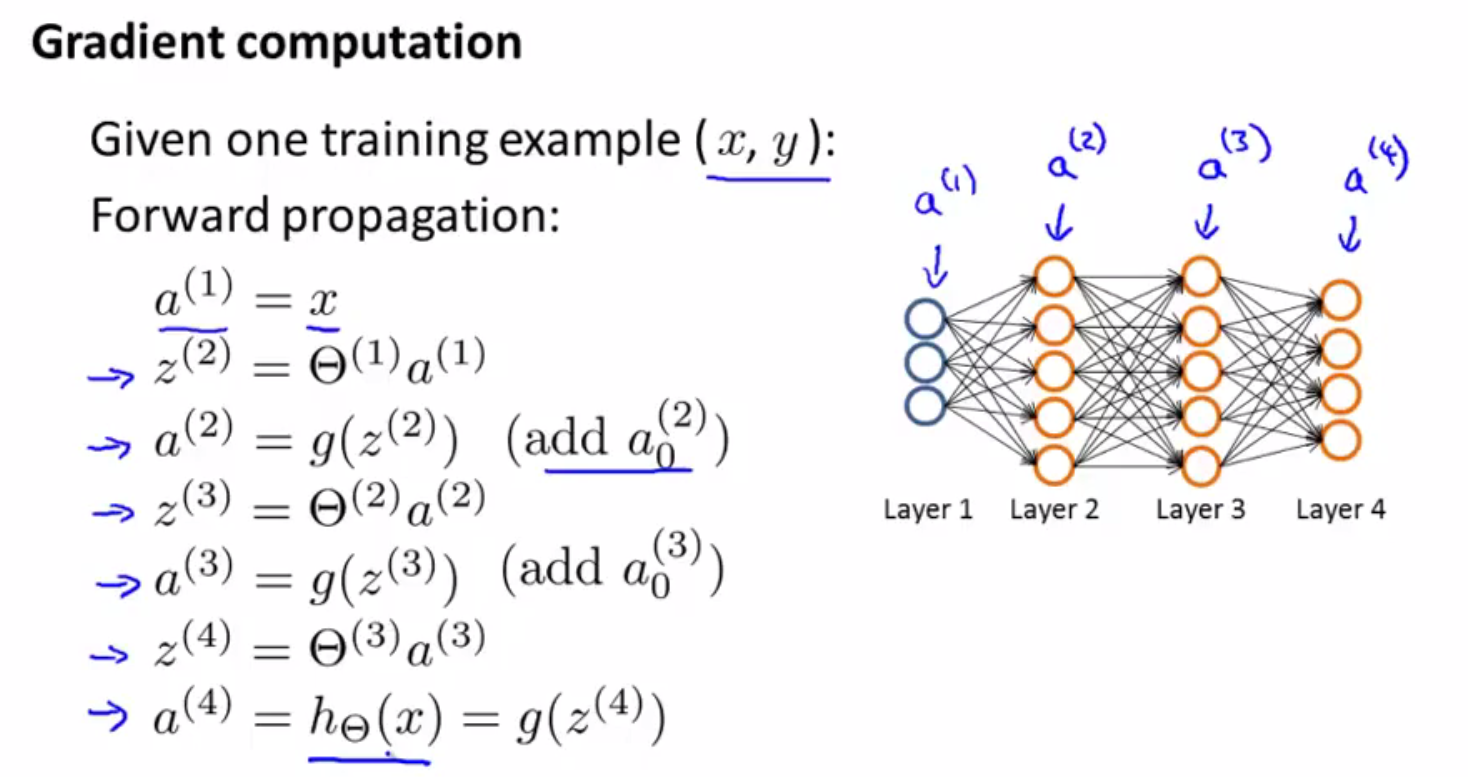

backpropagation

1.前向传播

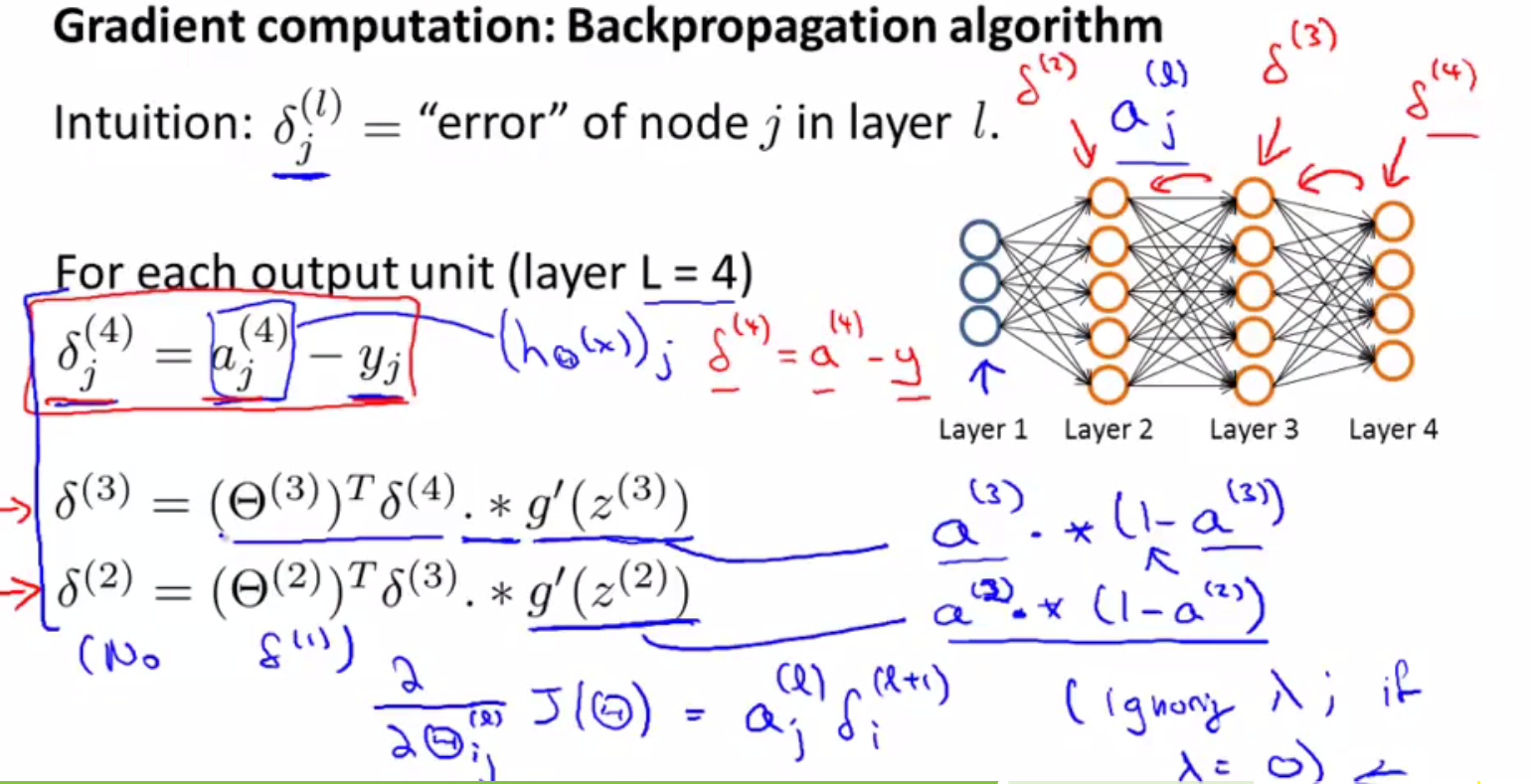

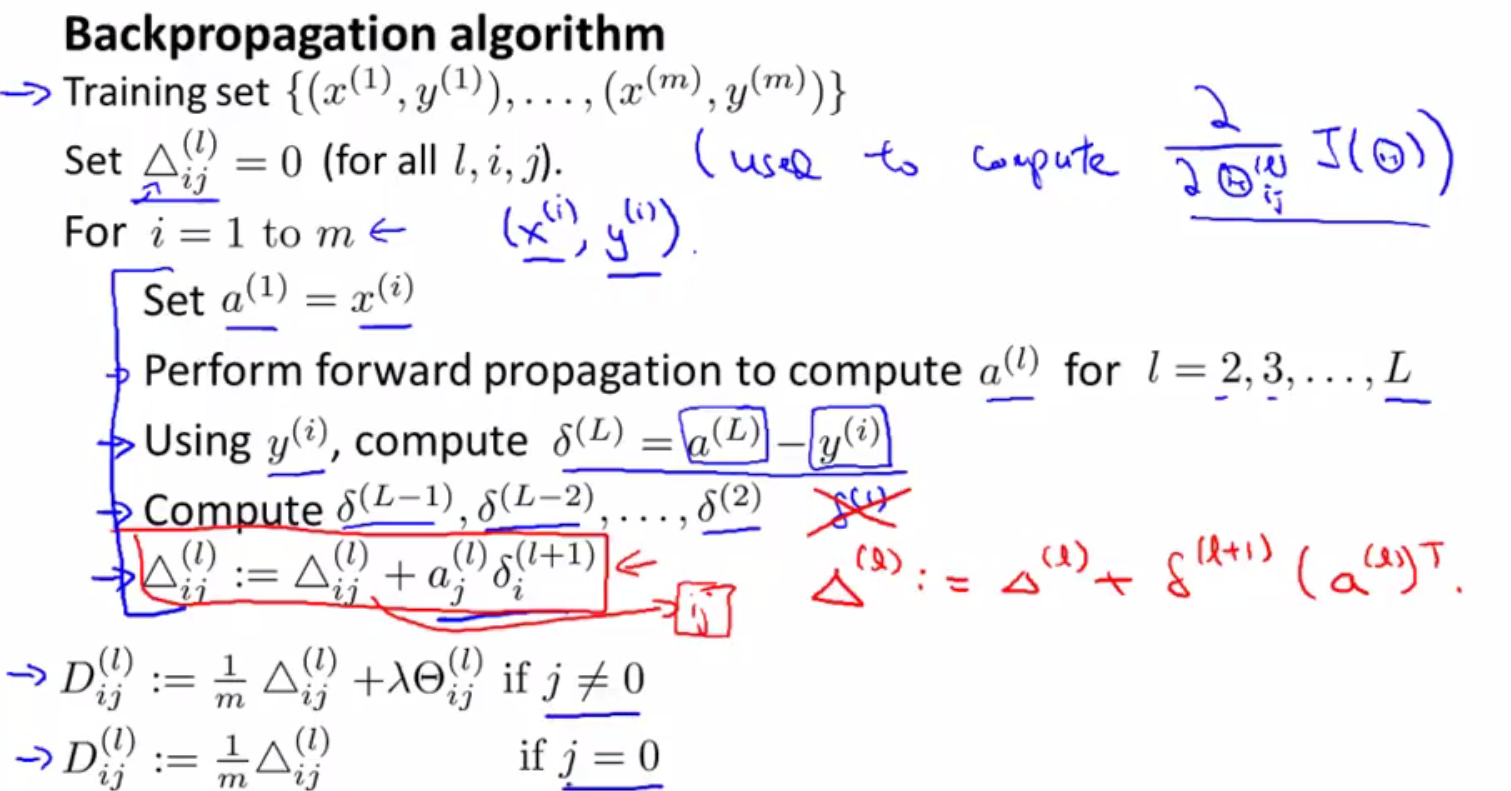

2.反向传播

通过计算最后一层输出的值与真实的误差,可以逐层反向的推导出各个层的误差,其中激活函数的导数为a(1-a)

梯度检验

利用双侧差分对梯度下降的算法进行比较

随机初始化权重

否则会导致权重相同,学习不到应有的特征

训练神经网络的过程

- 随机初始化权重

- 通过前向反馈计算每个样本的输出

- 计算损失函数

- 计算损失函数的偏导

- 梯度检查

- 利用优化算法最小化cost函数

3222

3222

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?