本文要解决的问题:

了解Spark在Yarn平台上的运行过程。

修改配置文件

首先需要修改配置文件spark-env.sh。在这个文件中需要添加两个属性:

Export HADOOP_HOME=/../hadoop..

ExportHADOOP_CONF_DIR=/../hadoop/etc/hadoop

这里,一个是要hadoop的home目录。一个是配置文件目录。

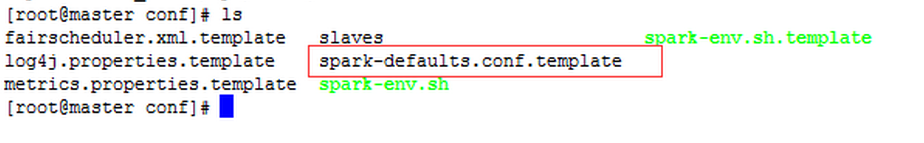

还需要配置一个就是spark-defaults.conf这个文件:

需要修改红色框内的文件。下面看下这个文件里面的内容:

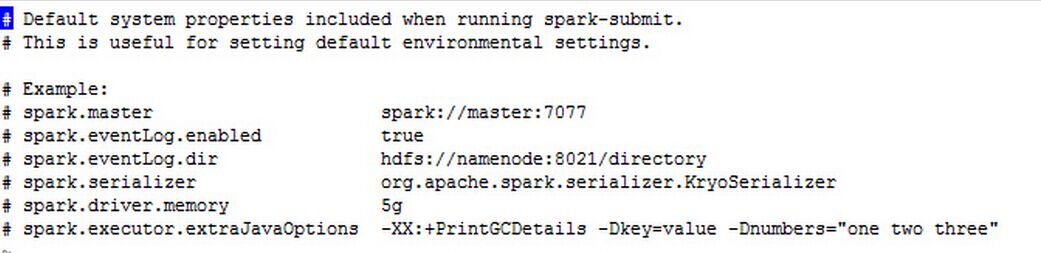

在spark的源文件中给出了一些配置参数的示例。另外它还下面一个可以配置的属性

| 属性名 | 说明 | 默认值 |

|---|---|---|

| spark.yarn.applicationMaster.waitTries | RM等待Spark AppMaster启动次数,也就是SparkContext初始化次数。超过这个数值,启动失败。 | 10 |

| spark.yarn.submit.file.replication | 应用程序上载到HDFS的文件的复制因子 | 3 |

| spark.yarn.preserve.staging.files | 设置为true,在job结束后,将stage相关的文件保留而不是删除。 | false |

| spark.yarn.scheduler.heartbeat.interval-ms | Spark AppMaster发送心跳信息给YARN RM的时间间隔 | 5000 |

| spark.yarn.max.executor.failures | 导致应用程序宣告失败的最大executor失败数 | 2倍于 |

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1377

1377

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?