误差理论

一、偏倚(bias)和方差(variance)

在讨论线性回归时,我们用一次线性函数对训练样本进行拟合(如图1所示);然而,我们可以通过二次多项式函数对训练样本进行拟合(如图2所示),函数对样本的拟合程序看上去更“好”;当我们利用五次多项式函数对样本进行拟合(如图3所示),函数通过了所有样本,成为了一次“完美”的拟合。

图3建立的模型,在训练集中通过x可以很好的预测y,然而,我们却不能预期该模型能够很好的预测训练集外的数据。换句话说,这个模型没有很好的泛化能力。因此,模型的泛化误差(generalization error)不仅包括其在样本上的期望误差,还包括在训练集上的误差。

图1和图3中的模型都有较大的泛化误差,然而他们的误差原因却不相同。图1建立了一个线性模型,但是该模型并没有精确的捕捉到训练集数据的结构,我们称图1有较大的偏倚(bias),也称欠拟合;图3通过5次多项式函数很好的对样本进行了拟合,然而,如果将建立的模型进行泛化,并不能很好的对训练集之外数据进行预测,我们称图3有较大的 ,也称过拟合。

通常,在偏倚和方差之间,这样一种规律:如果模型过于简单,其具有大的偏倚,而如果模型过于复杂,它就有大的方差。调整模型的复杂度,建立适当的误差模型,就变得极其重要了。

二、预备知识

首先我们先介绍两个非常有用的引理:

引理1:一致限(the union bound)令为k个不同的事件(不一定相互独立),那么有:

一致限说明:k个事件中任一个事件发生的概率小于等于这k个事件发生的概率和(等号成立的条件为这k个事件相两两互斥)。

引理2:Hoeffding 不等式(Hoeffding inequality)令为m个独立同分布的随机变量,由参数为 的伯努利分布(即)生成。令,为这些随机变量的均值,对于任意有:

在机器学习中,引理2称为Chernoff边界(Chernoff bound),它说明:假设我们用随机变量的均值去估计参数,估计的参数和实际参数的差超过一个特定数值的概率有一确定的上界,并且随着样本量m的增大,与很接近的概率也越来越大。

通过以上两个引理,我们能够引出机器学习中很重要结论。

为简单起见,我们只讨论二分类问题,即类标签为 。

假设给定的训练集为,且各训练样本独立同分布,皆为某个特定分布D生成。对于一个假设函数(hypothesis),定义训练误差(training error)(也称为经验风险(empirical risk)或经验误差(empiriacal error))为:

训练误差为模型在训练样本中的错分类的比例,如果我们要强调是依赖训练集的,也可以将其写作。

我们再定义泛化误差(generalization error):

这里得到的是一个概率,表示通过特定的分布D生成的样本(x,y)中的y与通过预测函数h(x)生成的结果不同的概率。

注意,我们假设训练集的数据是通过某种分布D生成的,我们以此为依据来衡量假设函数。这里的假设有时称为PAC(probablyapproximately correct)假设。

在线性分类中,假设函数中参数如何得来?其中一个方法就是调整参数,使得训练误差最小,即:

我们称这样的方法为经验风险最小化(empirical risk mininmization,ERM),其中 ,基于ERM原则的算法可视作最基本的学习算法。线性回归和logistic回归都可以看作是遵守ERM的算法。

我们定义假设类集合(hypothesis class)为所有假设函数的集合。例如线性分类问题中,,其为所有的(输入的定义域),对应的线性决策边界。

因此,ERM也可以认为是一组分类器的集合中,使得训练误差最小的那个分类器,即:

我们定义假设类集合由k个假设类(hypotheses)构成。其中,为k个由至{0,1}的映射函数构成,ERM从集合中k个元素选择使得训练误差最小。

为了确保和泛化误差的差值是有上界的,即如果训练误差很小,那么泛化误差也不会太大,我们需要完成两个步骤:首先,证明对于任意h,是对的可靠估计;其次,证明存在上界。

我们令,随机变量Z服从伯努利分布,样本由分布生成:即:。并且定义:,即Z为指示变量,用来标记被假设函数错误分类的样本。

泛化误差定义为随机变量Z的期望,训练误差为训练样本被假设函数误分类的比例,即:

利用Hoeffding不等式,可以得到:

从上式可以看出,对于特定的的,当m很大时,训练误差和泛化误差很接近的概率很大。但是,我们不仅仅需要考察对于特定的 ,训练误差和泛化误差的接近程度,而是需要验证对于所有的不等式也成立。

也可以得到他的等价式:

上式表示了假设集内任意假设函数的训练误差和泛化误差的的接近程度小于一个常数的概率有下界,并且随着样本量的增加,训练误差接近泛化误差的概率随之增大。上式的结果称为一致收敛。下面以此不等式引出个推论:

样本量下界:

以上的不等式有三个元素:样本量m,误差阈值和概率,通过任意两个元素,可以确定第三个元素。例如,我们可以关心下列问题:如果给定和,我们需要多大的样本量才能保证训练误差和泛化误差相差不超过的概率最小为?令可以解出m:

上面的不等式确定了一个m的下界,该下界称为算法的样本复杂度(algorithm’s sample complex),也就是说,如果我们想通过样本对总体有个较为准确的估计,我们需要采集最小的样本量是多少。

误差界限:

假设一致收敛成立,那么对于所有,有,那么,可以得到样本泛化误差和总体泛化误差的距离:

令 ,,即h*表示在集合中使得泛化误差最小的那个假设函数。那么有:

上式第一行不等式依据的是和,不等式第二行是由是对样本最小的误差的假设函数,因此小于 ,第三行是根据不等式。从不等式可以看出,对于(即利用训练集得到的假设函数)的泛化误差在任何情况下也不会比最理想的泛化误差多。结合前面的结论,我们可以得到定理1:

定理1:令,且m和值固定,在误差小于一个阈值的概率为至少为的情形下,有:

定理1给出了一个很重要的结论:如果我们扩充假设类集合的范围,即由原来的假设类扩充为即,则上式第一项(可以非正式的视其为偏差)的值会变小,因为扩充假设类集,可能有更好的假设函数使得最小泛化误差下降;第二项(可以非正式的视其为方差)的值会增大,因为k的值增加了。因此,如果假设类过小,则第一项过大,会造成欠拟合,通过扩充假设类,可以使得第一项的值下降,但是第二项值上升,如果扩充过大,会造成过拟合,同样会增加泛化误差。因此要想得到最小的泛化误差,需要在选择合适的,即在方差和偏差之间进行权衡。

假如固定和,去求解m,我们可以得到一条关于样本复杂度的推论:

4.无穷集

前一节我们介绍了在假设类集合是有穷集的情况下泛化误差、训练误差和样本量之间的关系。然而,存在很多以实数为参数的模型,假设类集合中元素数量是无穷的(如线性分类问题)。我们将如何处理?

下面以线性分类为例,假设分类的决策边界由线性函数表示,且该线性函数有d个实数参数。如果我们用计算机表示这些实数,根据IEEE双精度浮点数的标准,用64位二进制表示一个实数,那么,这d个实数需要用64d个2进制位表示,因此,这里假设类集合最多由个元素构成。由推论1可得,如果需要保证的概率不小于,需满足,因此可以看出,训练样本量和模型参数数量为线性关系。事实上,依赖64位浮点数无法得出准确的参数,然而, 如果我们尝试去最小化训练误差,也会得出理想的假设函数。

前文的结论是依赖于的参数设置。如在线性分类器中 ,此处有n+1个参数。如果这样定义分类器:,此时有2n+2个参数,但是这二者定义了相同的:在n维空间的线性分类器。

最后通过引入VC维的概念,将误差理论推广到更加一般的情形:

VC维

给定一个集合;,,这d个点可以用种方法正负样本。如果存在可以将这种标记的情况都能够有效分类,我们就称可以散列(shatter)S。通过集合中的某个假设函数h,可以对这个点构成的任何情况进行无误差的分类。将一个假设集能够无误差分类的最大的点的数量称为改假设集的VC维,记作。

下面举例说明,假设有三个点如下图所示:

这三个样本点有23=8种分类可能,如果使用线性分类器对其进行分类,可以得到“零训练误差”,如下图所示:

然而,线性分类器最多对3个点构成的所有可能分类情况进行无误差分类。如果超过3个点线性分类器将无法进行分类。如下图所示:

这里的结论可能很悲观,线性分类器在二维平面上至多只能给3个点进行无误差的分类。(更一般的,k维线性分类器最多只能给k+1个点进行无误差分类。)然而,实际的应用中,并不需要构建一个模型使得对于训练集进行无误差的分类,甚至分类过于精确,会使得模型的泛化能力变得很弱,因此VC维仅仅是保证理论的严密,以及可以相关证明的前提条件,并不能完全做为分类算法准确程度的度量。

最后,介绍两个重要的定理:

定理2:令为给定的假设集,且,在概率不小于的情况下,对于任意,有:

同样有

也就是说,如果一个假设集,VC维是有限的,那么,随着m的增大,任意的训练误差和泛化误差一致收敛。并且有如下推论:

推论2的含义是,如果需要确保训练误差和泛化误差的差值在一个给定的范围内,并且发生的概率不低于,需要的样本数量和假设集的VC维大小呈线性相关。

5.总结

Andrew Ng的讲义给的标题是学习理论(LearningTheory),然而本文给出了训练误差和泛化误差的一般性定义;并介绍了ERM原则;证明了泛化误差和训练误差间差距、样本量和误差概率之间的关系;最后通过引入VC维,推出了更一般的情况下他们之间的关系。因此文章标题为误差理论。

z

算法——贝叶斯

简介

学过概率理论的人都知道条件概率的公式:P(AB)=P(A)P(B|A)=P(B)P(A|B);即事件A和事件B同时发生的概率等于在发生A的条件下B发生的概率乘以A的概率。由条件概率公式推导出贝叶斯公式:P(B|A)=P(A|B)P(B)/P(A);即,已知P(A|B),P(A)和P(B)可以计算出P(B|A)。

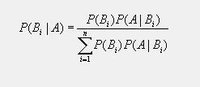

假设B是由相互独立的事件组成的概率空间{B1,b2,...bn}。则P(A)可以用全概率公式展开:P(A)=P (A|B1)P(B1)+P(A|B2)P(B2)+..P(A|Bn)P(Bn)。贝叶斯公式表示成:P(Bi|A)=P(A|Bi)P(Bi)/(P(A|B1)P(B1)+P(A|B2)P(B2)+..P(A|Bn)P(Bn));常常把P(Bi|A)称作后验概率,而P(A|Bn)P(Bn)为先验概率。而P(Bi)又叫做基础概率。

贝叶斯公式:

贝叶斯公式看起来很简单,但是在自然科学领域应用范围及其广泛。同时理论本身蕴含了深刻的思想。

贝叶斯概率的历史

贝叶斯理论和贝叶斯概率以托马斯·贝叶斯(1702-1761)命名,他证明了现在称为贝叶斯定理的一个特例。术语贝叶斯却是在1950年左右开始使用,很难说贝叶斯本人是否会支持这个以他命名的概率非常广义的解释。拉普拉斯证明了贝叶斯定理的一个更普遍的版本,并将之用于解决天体力学、医学统计中的问题,在有些情况下,甚至用于法理学。但是拉普拉斯并不认为该定理对于概率论很重要。他还是坚持使用了概率的经典解释。

弗兰克·普伦普顿·拉姆齐在《数学基础》(1931年)中首次建议将主观置信度作为概率的一种解释。Ramsey视这种解释为概率的频率解释的一个补充,而频率解释在当时更为广泛接受。统计学家Bruno de Finetti于1937年采纳了Ramsey的观点,将之作为概率的频率解释的一种可能的代替。L. J. Savage在《统计学基础》(1954年)中拓展了这个思想。

有人试图将“置信度”的直观概念进行形式化的定义和应用。最普通的应用是基于打赌:置信度反映在行为主体愿意在命题上下注的意愿上。

当信任有程度的时候,概率计算的定理测量信任的理性程度,就像一阶逻辑的定理测量信任的理性程度一样。很多人将置信度视为经典的真值(真或假)的一种扩展。

Harold Jeffreys, Richard T. Cox, Edwin Jaynes和I. J. Good研探了贝叶斯理论。其他著名贝叶斯理论的支持者包括John Maynard Keynes和B.O. Koopman。

贝叶斯法则的原理

通常,事件A在事件B(发生)的条件下的概率,与事件B在事件A的条件下的概率是不一样的;然而,这两者是有确定的关系,贝叶斯法则就是这种关系的陈述。

作为一个规范的原理,贝叶斯法则对于所有概率的解释是有效的;然而,频率主义者和贝叶斯主义者对于在应用中概率如何被赋值有着不同的看法:频率主义者根据随机事件发生的频率,或者总体样本里面的个数来赋值概率;贝叶斯主义者要根据未知的命题来赋值概率。一个结果就是,贝叶斯主义者有更多的机会使用贝叶斯法则。

贝叶斯法则是关于随机事件A和B的条件概率和边缘概率的。

bayes&

其中L(A|B)是在B发生的情况下A发生的可能性。

在贝叶斯法则中,每个名词都有约定俗成的名称:

Pr(A)是A的先验概率或边缘概率。之所以称为"先验"是因为它不考虑任何B方面的因素。

Pr(A|B)是已知B发生后A的条件概率,也由于得自B的取值而被称作A的后验概率。

Pr(B|A)是已知A发生后B的条件概率,也由于得自A的取值而被称作B的后验概率。

Pr(B)是B的先验概率或边缘概率,也作标准化常量(normalized constant)。

按这些术语,Bayes法则可表述为:

后验概率 = (似然度 * 先验概率)/标准化常量 也就是说,后验概率与先验概率和似然度的乘积成正比。

另外,比例Pr(B|A)/Pr(B)也有时被称作标准似然度(standardised likelihood),Bayes法则可表述为:

后验概率 = 标准似然度 * 先验概率

要理解贝叶斯推断,必须先理解贝叶斯定理。后者实际上就是计算"条件概率"的公式。

所谓"条件概率"(Conditional probability),就是指在事件B发生的情况下,事件A发生的概率,用P(A|B)来表示。

根据文氏图,可以很清楚地看到在事件B发生的情况下,事件A发生的概率就是P(A∩B)除以P(B)。

因此,

同理可得,

所以,

即

这就是条件概率的计算公式。

全概率公式

由于后面要用到,所以除了条件概率以外,这里还要推导全概率公式。

假定样本空间S,是两个事件A与A'的和。

上图中,红色部分是事件A,绿色部分是事件A',它们共同构成了样本空间S。

在这种情况下,事件B可以划分成两个部分。

即

在上一节的推导当中,我们已知

所以,

这就是全概率公式。它的含义是,如果A和A'构成样本空间的一个划分,那么事件B的概率,就等于A和A'的概率分别乘以B对这两个事件的条件概率之和。

将这个公式代入上一节的条件概率公式,就得到了条件概率的另一种写法:

贝叶斯推断的含义

对条件概率公式进行变形,可以得到如下形式:

我们把P(A)称为"先验概率"(Prior probability),即在B事件发生之前,我们对A事件概率的一个判断。P(A|B)称为"后验概率"(Posterior probability),即在B事件发生之后,我们对A事件概率的重新评估。P(B|A)/P(B)称为"可能性函数"(Likelyhood),这是一个调整因子,使得预估概率更接近真实概率。

所以,条件概率可以理解成下面的式子:

后验概率 = 先验概率 x 调整因子

这就是贝叶斯推断的含义。我们先预估一个"先验概率",然后加入实验结果,看这个实验到底是增强还是削弱了"先验概率",由此得到更接近事实的"后验概率"。

在这里,如果"可能性函数"P(B|A)/P(B)>1,意味着"先验概率"被增强,事件A的发生的可能性变大;如果"可能性函数"=1,意味着B事件无助于判断事件A的可能性;如果"可能性函数"<1,意味着"先验概率"被削弱,事件A的可能性变小。

医患诊断模型

1、背景材料及引言

7岁女孩晓宇(化名)患急性支气管炎,在武汉市儿童医院住院4天,医生为确诊病情,为她抽血化验了32个指标,仅化验费就花费1130元。晓宇的家长质疑:医院如此看病,是过度检查。晓宇的接诊医生李志超说:“晓宇入院时,根据其家长自述病情,我认为孩子的情况有些严重,于是确定了上述化验指标”。该院四内科副主任李医生说:在当时情况下,李志超对患者的病情判断、以及开出的化验指标,都是有道理的。但如果是我接诊,会以自己的经验有针对性地进行化验检查,可能不会一下开出这么多化验指标。该科主任温玟莉主任医师称:一次抽血化验32个指标,是因为李志超当时怀疑孩子得了败血症,这样处理没有问题。但最后的检查结果并不是败血症,这只能说明李志超较年轻,缺乏丰富的临床经验,只有通过全面检查才能确诊。

在医患关系紧张,看病难、看病贵的现实情况下,我们应如何看待这个颇有争议的案例,医生看病是应该有针对性地开方,还是列出“算法式”的化验指标进行排查,本研究以贝叶斯公式为依据,从中国现行的医疗体制出发,对此类问题进行了有益的探索,以期建立一种定量化的诊断模型。

2、模型建立

设“患者有某种病症”为事件A,引起事件A的病因为样本空间Ω。B1,B2,…Bn为Ω的一个分划,即Bi∩Bj=Φ,i≠j,Uni=1Bi=Ω,并假定P(Bi)>0。由贝叶斯公式,由某病因引起事件A的概率为:

P(Bi|A)=P(Bi)P(A|Bi)/n/j=1P(Bj)P(A⌒Bj)(1)

公式(1)为医生有针对性地确诊提供了参考。

在疹疗过程中,医生要根据临床经验对各种病因Bi进行权衡。如果误诊,则有可能承担相应的医疗事故风险,相应的误诊概率记为P′(Bi),并设因可能承担风险而承担的赔偿费用为C′i,患者承担医生针对病因Bi开出的疹疗方案的费用为Ci,于是在一次诊治过程中患者承担的平均费用为:

E(A)=ni=1P(Bi)Ci(2)

医生可能承担的平均赔偿金额为:

E′(A)=ni=1P′(Bi)C′i(3)

我们称该模型为诊断模型,并以δ1≤E(A)-E′(A)≤δ2为标准来衡量诊断方案的合理性,其中δ1≥0,δ2为某一不是特别大的正数。即患者所承担的平均医疗费用应比医生可能承担的平均赔偿金要多,但两者不应差别太大。

3、模型检验

我们以发热和上腹疼痛两个病症的相关数据对该模型进行检验。设原假设为H0:诊断是合理的。备择假设为H1,诊断合理与否需要进一步考查。

对表1和表2中相关数据的说明:中国2002年9月1日实施的《医疗事故处理条例》(以下简称《条例》)第五十条对赔偿项目和标准的规定与当地上一年度职工平均工资水平紧密挂钩,实行一次性结算。表1和表2中的工资水平参考了2007年2月湖北省第十届人民代表大会上的湖北省政府工作报告中的数据:2006年城镇居民人均可支配收入为9803元。对发热症状中的“非典”及“某种类似非典的突发疾病”所可能带来的医疗事故我们以一级医疗事故中的死亡来处理,赔偿金额按<国家赔偿法>第二十七条的规定,检查费用以一次全身检查所需费用10000元进行计算;对“心肺功能缺陷”所可能带来的医疗事故我们按二级医疗事故处理,赔偿金额取202110,检查费用按心电图20元次,心脏彩超180元次,心肌酶谱60元次,肺检查80元次进行计算,药费以相应检查费用的0.8计算。对上腹疼痛症状中的“胃癌”及“心、膈等器官有病变”可能带来的医疗事故我们按二级医疗事故来处理,赔偿金额取202110,对B3的检查费用以B超40元次,催C120元次,胃镜(无痛)240元次进行计算,药费以相应检查费用的0.8计算,对B4的检查费用以胃镜(无痛)240元次和心脏彩超180元次进行计算,药费以相应检查费用的0.8计算。对两种症状中“其它”原因对患者可能造成的损害我们以《条例》第三十三条(三)的规定进行处理:在现有医学科学技术条件下,发生无法预料或者不能防范的不良后果的,不属于医疗事故。对两种症状中“其它”原因,患者的一次医疗费用我们取城镇居民人均可支配收入的5%,即490元进行计算。所有医疗费用均指一次诊治的检查费和药费之和,不包括后续治疗的费用。检查费用以武汉市某三级甲等医院的相关标准为参考。表1发热症状诊断模型的相关数据注:B1=人体生理功能的正常表现:B4=某种类似非典的突发疾病;B5=心肺功能缺陷。表2上腹疼痛症状诊断模型的相关数据注,B2=胃溃疡、十二指肠溃疡;B4=心、膈等器官有病变。

设“发热症状”为事件A1,“上腹疼痛症状”为事件A2,由表1和表2的数据计算得(四舍五入精确到元):

E(A1)=121,E′(A1)=187165;E(A2)=265,E′(A2)=22232

我们会发现原假设H0:诊断是合理的,是不成立的。这些数据告诉我们医生这个职业的确是个高风险的职业,在中国建立医疗责任保险制度有着必要性与迫切性。

4、模型评价

该模型在合理假设的基础上,对“对症下药”进行量化,对诊疗方案的合理性给出了一个量化的标准,有一定的合理性与临床参考价值。特别是在用数据对模型检验后,证实了医生的确是个高风险的职业,也显示了在中国建立医疗责任保险制度的必要性和紧迫性。但在模型应用过程中还需要注意以下几个方面:①病因的复杂性。病因的复杂性会导致样本空间的分划的个数n比较大,因此需要结合医学规律对样本空间分划进行合理的选择。②患者体质的差别。不同的患者对同类的医疗事故,由于体质的差别可能带来不同程度的损害。③医生临床诊断水平的差异。不同的医生,由于经验等方面的因素,误诊概率可能有较大的差别。④医院的潜规则。有的医院把医生的收入与其给医院的创收挂钩,这样同一病症在不同的医院治疗,诊疗费用会有较大的差别。⑤实际赔偿金的差别。不同地区上一年度人均收入差别较大,加之实际赔偿金还与实际谈判能力有关系,这样就可能导致同类医疗事故在不同地区及不同的患者(或家属)身上,实际赔偿金差别也较大。⑥现行医疗体制对模型的影响。下面对此进行较详细的分析。

中国现行的医疗事故赔偿责任者只有一个,就是医疗机构,但医疗机构作为理性人,会尽量减少其自身的医疗成本以实现利益的最大化。医疗机构会将其自身受到的损失通过以下三种主要方式进行转移:一是利用价格机制,提高医疗费用,即将损失分散于所有的就医者身上;二是由具体责任人承担风险,即将损失的一部分转移给与事故直接相关的医务人员;三是通过责任保险机制,将损失转移给保险公司。但长期以来,在中国实际上只有第一种和第二种途径在发挥着作用,责任保险机制可以说作用甚微。

这样,就很容易导致医疗费用上涨,引发医患关系紧张。医学的专业化使得医疗机构和患者之间存在巨大的信息差,医疗机构有动机也有能力通过使患者进行重复或者不必要的检查项目等方法多收费用,弥补自身损失.因此模型作用的发挥,还需要以下几方面的配合:

①重视医德建设,提高医护人员自身修养。裘法祖院士在文献里有很深刻的认识。

②加强医患之间的沟通,进行换位思考,让医生理解患者的苦衷,让患者理解诊疗的风险。

③加强误诊规律的研究。医疗技术的进步从来都是和风险相并存的,从某种程度上说误诊是不可避免的,但作为医护人员要提高生命权保护意识,不断提高自身的临床思维能力诊断能力力争把误诊率降到最低。

④加强医护人员临床思维能力和临床经验的提高。医学很大程度上是经验学科,医学理论最终还要内化为医护人员的实际诊断能力才能发挥作用。公式(1)为医护人员提高诊断水平提供了一个很好的参考。

⑤探索适合中国国情的、于患于医均有益的医疗责任保险制度。尤其是在生命意识越来越受到重视的今天,只有切实的降低行医的风险,才能从根本上解决医患关系紧张的现状,实现医患关系的和谐。

别墅和狗

一座别墅在过去的 20 年里一共发生过 2 次被盗,别墅的主人有一条狗,狗平均每周晚上叫 3 次,在盗贼入侵时狗叫的概率被估计为 0.9,问题是:在狗叫的时候发生入侵的概率是多少?

我们假设 A 事件为狗在晚上叫,B 为盗贼入侵,则 P(A) = 3 / 7,P(B)=2/(20·365)=2/7300,P(A | B) = 0.9,按照公式很容易得出结果:P(B|A)=0.9*(2/7300)/(3/7)=0.00058

容器里的球

另一个例子,现分别有 A,B 两个容器,在容器 A 里分别有 7 个红球和 3 个白球,在容器 B 里有 1 个红球和 9 个白球,现已知从这两个容器里任意抽出了一个球,且是红球,问这个红球是来自容器 A 的概率是多少?

假设已经抽出红球为事件 B,从容器 A 里抽出球为事件 A,则有:P(B) = 8 / 20,P(A) = 1 / 2,P(B | A) = 7 / 10,按照公式,则有:P(A|B)=(7 / 10)*(1 / 2)/(8/20)=0.875

贝叶斯公式为利用搜集到的信息对原有判断进行修正提供了有效手段。在采样之前,经济主体对各种假设有一个判断(先验概率),关于先验概率的分布,通常可根据经济主体的经验判断确定(当无任何信息时,一般假设各先验概率相同),较复杂精确的可利用包括最大熵技术或边际分布密度以及相互信息原理等方法来确定先验概率分布。

贝叶斯定理的推广

对于变量有二个以上的情况,贝式定理亦成立。例如:

P(A|B,C)=P(B|A)*P(A)*P(C|A,B)/(P(B)*P(C|B))

这个式子可以由套用多次二个变量的贝式定理及条件机率的定义导出:

贝叶斯理论及应用

| 数学领域 | ▪ 贝叶斯分类算法 (应用:统计分析、测绘学) ▪ 贝叶斯公式 (应用:概率空间) ▪ 贝叶斯区间估计 (应用:数学中的区间估计) ▪ 贝叶斯序贯决策函数 (应用:统计决策论) | ▪ 贝叶斯风险 (应用:统计决策论) ▪ 贝叶斯估计 (应用:参数估计) ▪ 贝叶斯统计 (应用:统计决策论) ▪ 经验贝叶斯方法 (应用:统计决策论) |

| 工程领域 | ▪ 贝叶斯定理 (应用:人工智能、心理学、遗传学) ▪ 贝叶斯分析 (应用:计算机科学) ▪ 贝叶斯逻辑 (应用:人工智能) ▪ 贝叶斯网络 (应用:人工智能) | ▪ 贝叶斯分类器 (应用:模式识别、人工智能) ▪ 贝叶斯决策 (应用:人工智能) ▪ 贝叶斯推理 (应用:数量地理学、人工智能) ▪ 贝叶斯学习 (应用:模式识别) |

| 其他领域 | ▪ 贝叶斯主义 (应用:自然辩证法) | ▪ 有信息的贝叶斯决策方法 (应用:生态系统生态学) |

【例子】水果糖问题

为了加深对贝叶斯推断的理解,我们看两个例子。

第一个例子。两个一模一样的碗,一号碗有30颗水果糖和10颗巧克力糖,二号碗有水果糖和巧克力糖各20颗。现在随机选择一个碗,从中摸出一颗糖,发现是水果糖。请问这颗水果糖来自一号碗的概率有多大?

我们假定,H1表示一号碗,H2表示二号碗。由于这两个碗是一样的,所以P(H1)=P(H2),也就是说,在取出水果糖之前,这两个碗被选中的概率相同。因此,P(H1)=0.5,我们把这个概率就叫做"先验概率",即没有做实验之前,来自一号碗的概率是0.5。

再假定,E表示水果糖,所以问题就变成了在已知E的情况下,来自一号碗的概率有多大,即求P(H1|E)。我们把这个概率叫做"后验概率",即在E事件发生之后,对P(H1)的修正。

根据条件概率公式,得到

已知,P(H1)等于0.5,P(E|H1)为一号碗中取出水果糖的概率,等于0.75,那么求出P(E)就可以得到答案。根据全概率公式,

所以,

将数字代入原方程,得到

这表明,来自一号碗的概率是0.6。也就是说,取出水果糖之后,H1事件的可能性得到了增强。

贝叶斯过滤器

垃圾邮件是一种令人头痛的顽症,困扰着所有的互联网用户。

正确识别垃圾邮件的技术难度非常大。传统的垃圾邮件过滤方法,主要有"关键词法"和"校验码法"等。前者的过滤依据是特定的词语;后者则是计算邮件文本的校验码,再与已知的垃圾邮件进行对比。它们的识别效果都不理想,而且很容易规避。

2002年,Paul Graham提出使用"贝叶斯推断"过滤垃圾邮件。他说,这样做的效果,好得不可思议。1000封垃圾邮件可以过滤掉995封,且没有一个误判。

另外,这种过滤器还具有自我学习的功能,会根据新收到的邮件,不断调整。收到的垃圾邮件越多,它的准确率就越高。

贝叶斯过滤器是一种统计学过滤器,建立在已有的统计结果之上。所以,我们必须预先提供两组已经识别好的邮件,一组是正常邮件,另一组是垃圾邮件。

我们用这两组邮件,对过滤器进行"训练"。这两组邮件的规模越大,训练效果就越好。Paul Graham使用的邮件规模,是正常邮件和垃圾邮件各4000封。

"训练"过程很简单。首先,解析所有邮件,提取每一个词。然后,计算每个词语在正常邮件和垃圾邮件中的出现频率。比如,我们假定"sex"这个词,在4000封垃圾邮件中,有200封包含这个词,那么它的出现频率就是5%;而在4000封正常邮件中,只有2封包含这个词,那么出现频率就是0.05%。(【注释】如果某个词只出现在垃圾邮件中,Paul Graham就假定,它在正常邮件的出现频率是1%,反之亦然。这样做是为了避免概率为0。随着邮件数量的增加,计算结果会自动调整。)

有了这个初步的统计结果,过滤器就可以投入使用了。

现在,我们收到了一封新邮件。在未经统计分析之前,我们假定它是垃圾邮件的概率为50%。(【注释】有研究表明,用户收到的电子邮件中,80%是垃圾邮件。但是,这里仍然假定垃圾邮件的"先验概率"为50%。)

我们用S表示垃圾邮件(spam),H表示正常邮件(healthy)。因此,P(S)和P(H)的先验概率,都是50%。

然后,对这封邮件进行解析,发现其中包含了sex这个词,请问这封邮件属于垃圾邮件的概率有多高?

我们用W表示"sex"这个词,那么问题就变成了如何计算P(S|W)的值,即在某个词语(W)已经存在的条件下,垃圾邮件(S)的概率有多大。

根据条件概率公式,马上可以写出

公式中,P(W|S)和P(W|H)的含义是,这个词语在垃圾邮件和正常邮件中,分别出现的概率。这两个值可以从历史资料库中得到,对sex这个词来说,上文假定它们分别等于5%和0.05%。另外,P(S)和P(H)的值,前面说过都等于50%。所以,马上可以计算P(S|W)的值:

因此,这封新邮件是垃圾邮件的概率等于99%。这说明,sex这个词的推断能力很强,将50%的"先验概率"一下子提高到了99%的"后验概率"。

做完上面一步,请问我们能否得出结论,这封新邮件就是垃圾邮件?

回答是不能。因为一封邮件包含很多词语,一些词语(比如sex)说这是垃圾邮件,另一些说这不是。你怎么知道以哪个词为准?

Paul Graham的做法是,选出这封信中P(S|W)最高的15个词,计算它们的联合概率。(【注释】如果有的词是第一次出现,无法计算P(S|W),Paul Graham就假定这个值等于0.4。因为垃圾邮件用的往往都是某些固定的词语,所以如果你从来没见过某个词,它多半是一个正常的词。)

所谓联合概率,就是指在多个事件发生的情况下,另一个事件发生概率有多大。比如,已知W1和W2是两个不同的词语,它们都出现在某封电子邮件之中,那么这封邮件是垃圾邮件的概率,就是联合概率。

在已知W1和W2的情况下,无非就是两种结果:垃圾邮件(事件E1)或正常邮件(事件E2)。

其中,W1、W2和垃圾邮件的概率分别如下:

如果假定所有事件都是独立事件(【注释】严格地说,这个假定不成立,但是这里可以忽略),那么就可以计算P(E1)和P(E2):

又由于在W1和W2已经发生的情况下,垃圾邮件的概率等于下面的式子:

即

将P(S)等于0.5代入,得到

将P(S|W1)记为P1,P(S|W2)记为P2,公式就变成

这就是联合概率的计算公式。

将上面的公式扩展到15个词的情况,就得到了最终的概率计算公式:

一封邮件是不是垃圾邮件,就用这个式子进行计算。这时我们还需要一个用于比较的门槛值。Paul Graham的门槛值是0.9,概率大于0.9,表示15个词联合认定,这封邮件有90%以上的可能属于垃圾邮件;概率小于0.9,就表示是正常邮件。

有了这个公式以后,一封正常的信件即使出现sex这个词,也不会被认定为垃圾邮件了。

最大似然估计学习总结------MadTurtle

1. 作用

在已知试验结果(即是样本)的情况下,用来估计满足这些样本分布的参数,把可能性最大的那个参数![]() 作为真实

作为真实![]() 的参数估计。

的参数估计。

2. 离散型

设![]() 为离散型随机变量,

为离散型随机变量,![]() 为多维参数向量,如果随机变量

为多维参数向量,如果随机变量![]() 相互独立且概率计算式为P{

相互独立且概率计算式为P{![]() ,则可得概率函数为P{

,则可得概率函数为P{![]() }=

}=![]() ,在

,在![]() 固定时,上式表示

固定时,上式表示![]() 的概率;当

的概率;当![]() 已知的时候,它又变成

已知的时候,它又变成![]() 的函数,可以把它记为

的函数,可以把它记为![]() ,称此函数为似然函数。似然函数值的大小意味着该样本值出现的可能性的大小,既然已经得到了样本值

,称此函数为似然函数。似然函数值的大小意味着该样本值出现的可能性的大小,既然已经得到了样本值![]() ,那么它出现的可能性应该是较大的,即似然函数的值也应该是比较大的,因而最大似然估计就是选择使

,那么它出现的可能性应该是较大的,即似然函数的值也应该是比较大的,因而最大似然估计就是选择使![]() 达到最大值的那个

达到最大值的那个![]() 作为真实

作为真实![]() 的估计。

的估计。

3. 连续型

设![]() 为连续型随机变量,其概率密度函数为

为连续型随机变量,其概率密度函数为![]() ,

,![]() 为从该总体中抽出的样本,同样的如果

为从该总体中抽出的样本,同样的如果![]() 相互独立且同分布,于是样本的联合概率密度为

相互独立且同分布,于是样本的联合概率密度为![]() 。大致过程同离散型一样。

。大致过程同离散型一样。

4. 关于概率密度(PDF)

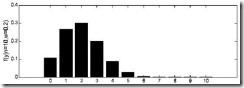

我们来考虑个简单的情况(m=k=1),即是参数和样本都为1的情况。假设进行一个实验,实验次数定为10次,每次实验成功率为0.2,那么不成功的概率为0.8,用y来表示成功的次数。由于前后的实验是相互独立的,所以可以计算得到成功的次数的概率密度为:

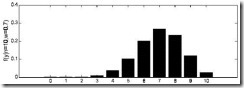

由于y的取值范围已定,而且![]() 也为已知,所以图1显示了y取不同值时的概率分布情况,而图2显示了当

也为已知,所以图1显示了y取不同值时的概率分布情况,而图2显示了当![]() 时的y值概率情况。

时的y值概率情况。

那么![]() 在[0,1]之间变化而形成的概率密度函数的集合就形成了一个模型。

在[0,1]之间变化而形成的概率密度函数的集合就形成了一个模型。

5. 最大似然估计的求法

由上面的介绍可以知道,对于图1这种情况y=2是最有可能发生的事件。但是在现实中我们还会面临另外一种情况:我们已经知道了一系列的观察值和一个感兴趣的模型,现在需要找出是哪个PDF(具体来说参数![]() 为多少时)产生出来的这些观察值。要解决这个问题,就需要用到参数估计的方法,在最大似然估计法中,我们对调PDF中数据向量和参数向量的角色,于是可以得到似然函数的定义为:

为多少时)产生出来的这些观察值。要解决这个问题,就需要用到参数估计的方法,在最大似然估计法中,我们对调PDF中数据向量和参数向量的角色,于是可以得到似然函数的定义为:

该函数可以理解为,在给定了样本值的情况下,关于参数向量![]() 取值情况的函数。还是以上面的简单实验情况为例,若此时给定y为7,那么可以得到关于

取值情况的函数。还是以上面的简单实验情况为例,若此时给定y为7,那么可以得到关于![]() 的似然函数为:

的似然函数为:

继续回顾前面所讲,图1,2是在给定![]() 的情况下,样本向量y取值概率的分布情况;而图3是图1,2横纵坐标轴相交换而成,它所描述的似然函数图则指出在给定样本向量y的情况下,符合该取值样本分布的各种参数向量

的情况下,样本向量y取值概率的分布情况;而图3是图1,2横纵坐标轴相交换而成,它所描述的似然函数图则指出在给定样本向量y的情况下,符合该取值样本分布的各种参数向量![]() 的可能性。若

的可能性。若![]() 相比于

相比于![]() ,使得y=7出现的可能性要高,那么理所当然的

,使得y=7出现的可能性要高,那么理所当然的![]() 要比

要比![]() 更加接近于真正的估计参数。所以求

更加接近于真正的估计参数。所以求![]() 的极大似然估计就归结为求似然函数

的极大似然估计就归结为求似然函数![]() 的最大值点。那么

的最大值点。那么![]() 取何值时似然函数

取何值时似然函数![]() 最大,这就需要用到高等数学中求导的概念,如果是多维参数向量那么就是求偏导。

最大,这就需要用到高等数学中求导的概念,如果是多维参数向量那么就是求偏导。

主要注意的是多数情况下,直接对变量进行求导反而会使得计算式子更加的复杂,此时可以借用对数函数。由于对数函数是单调增函数,所以![]() 与

与![]() 具有相同的最大值点,而在许多情况下,求

具有相同的最大值点,而在许多情况下,求![]() 的最大值点比较简单。于是,我们将求

的最大值点比较简单。于是,我们将求![]() 的最大值点改为求

的最大值点改为求![]() 的最大值点。

的最大值点。

若该似然函数的导数存在,那么对![]() 关于参数向量的各个参数求导数(当前情况向量维数为1),并命其等于零,得到方程组:

关于参数向量的各个参数求导数(当前情况向量维数为1),并命其等于零,得到方程组:

可以求得![]() 时似然函数有极值,为了进一步判断该点位最大值而不是最小值,可以继续求二阶导来判断函数的凹凸性,如果

时似然函数有极值,为了进一步判断该点位最大值而不是最小值,可以继续求二阶导来判断函数的凹凸性,如果![]() 的二阶导为负数那么即是最大值,这里再不细说。

的二阶导为负数那么即是最大值,这里再不细说。

还要指出,若函数![]() 关于

关于![]() 的导数不存在,我们就无法得到似然方程组,这时就必须用其它的方法来求最大似然估计值,例如用有界函数的增减性去求

的导数不存在,我们就无法得到似然方程组,这时就必须用其它的方法来求最大似然估计值,例如用有界函数的增减性去求![]() 的最大值点

的最大值点

6. 总结

最大似然估计,只是一种概率论在统计学的应用,它是参数估计的方法之一。说的是已知某个随机样本满足某种概率分布,但是其中具体的参数不清楚,参数估计就是通过若干次试验,观察其结果,利用结果推出参数的大概值。最大似然估计是建立在这样的思想上:已知某个参数能使这个样本出现的概率最大,我们当然不会再去选择其他小概率的样本,所以干脆就把这个参数作为估计的真实值。

求最大似然函数估计值的一般步骤:

(1) 写出似然函数

(2) 对似然函数取对数,并整理

(3) 求导数

(4) 解似然方程

对于最大似然估计方法的应用,需要结合特定的环境,因为它需要你提供样本的已知模型进而来估算参数,例如在模式识别中,我们可以规定目标符合高斯模型。而且对于该算法,我理解为,“知道”和“能用”就行,没必要在程序设计时将该部分实现,因为在大多数程序中只会用到我最后推导出来的结果。个人建议,如有问题望有经验者指出。在文献[1]中讲解了本文的相关理论内容,在文献[2]附有3个推导例子。

7. 参考文献

[1]I.J. Myung. Tutorial on maximum likelihood estimation[J]. Journal of Mathematical Psychology, 2003, 90-100.

[2] http://edu6.teacher.com.cn/ttg006a/chap7/jiangjie/72.htm

普通最小二乘估计(Ordinary least squares,OLS)

最小二乘法http://baike.baidu.com/view/139822.htm

最小二乘估计法http://baike.baidu.com/view/2021020.htm

最小二乘拟合http://baike.baidu.com/view/3137894.htm

1801年,意大利天文学家朱赛普?皮亚齐发现了第一颗小行星谷神星。经过40天的跟踪观测后,由于谷神星运行至太阳背后,使得皮亚齐失去了谷神星的位置。随后全世界的科学家利用皮亚齐的观测数据开始寻找谷神星,但是根据大多数人计算的结果来寻找谷神星都没有结果。时年24岁的高斯也计算了谷神星的轨道。奥地利天文学家海因里希?奥尔伯斯根据高斯计算出来的轨道重新发现了谷神星。高斯使用的最小二乘法的方法发表于1809年他的著作《天体运动论》中。法国科学家勒让德于1806年独立发现“最小二乘法”,但因不为世人所知而默默无闻。勒让德曾与高斯为谁最早创立最小二乘法原理发生争执。1829年,高斯提供了最小二乘法的优化效果强于其他方法的证明,因此被称为高斯-莫卡夫定理。

最大似然估计(Maximum likelihood,ML)

最大似然法http://baike.baidu.com/view/1918804.htm

极大似然法http://baike.baidu.com/view/1460040.htm

极大似然估计http://baike.baidu.com.cn/view/185250.htm

最大似然估计法http://bbs.sciencenet.cn/blog-491809-400893.html

最大似然估计http://www.cnblogs.com/liliu/archive/2010/11/22/1883702.html

最大似然法,也称最大或然法、极大似然法,最早由高斯提出,后由英国遗传及统计学家费歇于1912年重新提出,并证明了该方法的一些性质,名称“最大似然估计”也是费歇给出的。该方法是不同于最小二乘法的另一种参数估计方法,是从最大似然原理出发发展起来的其他估计方法的基础。虽然其应用没有最小二乘法普遍,但在计量经济学理论上占据很重要的地位,因为最大似然原理比最小二乘原理更本质地揭示了通过样本估计总体的内在机理。计量经济学的发,更多地是以最大似然原理为基础的,对于一些特殊的计量经济学模型,只有最大似然法才是成功的估计方法。

对于最小二乘法,当从模型总体随机抽取n组样本观测值后,最合理的参数估计量应该使得模型能最好地拟合样本数据;而对于最大似然法,当从模型总体随机抽取n组样本观测值后,最合理的参数估计量应该是使得从模型中抽取该n组样本观测值的概率最大。

从总体中经过n次随机抽取得到的样本容量为n的样本观测值,在任一次随机抽取中,样本观测值都以一定的概率出现。如果已经知道总体的参数,当然由变量的频率函数可以计算其概率。如果只知道总体服从某种分布,但不知道其分布参数,通过随机样本可以求出总体的参数估计。

以正态分布的总体为例,每个总体都有自己的分布参数期望和方差,如果已经得到n组样本观测值,在可供选择的总体中,哪个总体最可能产生已经得到的n组样本观测值呢?显然,要对每个可能的正态总体估计取n组样本观测值的联合概率,然后选择其参数能使观测值的联合概率最大的那个总体。将样本观测值联合概率函数称为变量的似然函数。在已经取得样本观测值的情况下,使似然函数取极大值的总体分布参数所代表的总体具有最大的概率取得这些样本观测值,该总体参数即是所要求的参数。通过似然函数极大化以求得总体参数估计量的方法被称为极大似然法。

矩估计(Moment method,MM)

矩估计http://baike.baidu.com/view/2019009.htm

矩估计http://wenku.baidu.com/view/37e371c7aa00b52acfc7ca28.html

广义矩估计http://baike.baidu.com/view/8471298.htm

工具变量法http://baike.baidu.com/view/2107261.htm

原点矩http://baike.baidu.com/view/7115935.htm

中心矩http://baike.baidu.com/view/7115935.htm

由英国统计学家皮尔逊于1894年提出的,是最古老的一种估计法之一。所谓矩估计法,就是利用样本矩来估计总体中相应的参数。最简单的矩估计法是用一阶样本原点矩估计总体期望,而用二阶样本中心矩估计总体方差。对于随机变量来说,矩是其最广泛、最常用的数字特征,主要有中心矩和原点矩。

由辛钦大数定律知,简单随机样本的原点矩依概率收敛到相应的总体原点矩,这就启发我们想到用样本矩替换总体矩,进而找出未知参数的估计,基于这种思想求估计量的方法称为矩法,用矩法求得的估计称为矩法估计,简称矩估计。

传统的计量经济学估计方法,例如普通最小二乘法、工具变量法和最大似然法等都存在自身的局限性,即其参数估计量必须在满足某些假设时,比如模型的随机误差项服从正态分布或某一已知分布时,才是可靠的估计量。而矩估计原理简单、使用方便,使用时可以不知道总体分布,而且具有一定的优良性质(如矩估计为E(ξ)的一致最小方差无偏估计)。广义矩估计法除不需要知道随机误差项分布外,且允许随机误差项存在异方差和序列相关,因而所得到的估计量比其他方法更有效。

但在寻找参数的矩法估计量时,对总体原点矩不存在的分布如柯西分布等不能用,另一方面它只涉及总体的一些数字特征,并未用到总体的分布,因此矩法估计量实际上只集中了总体的部分信息,这样它在体现总体分布特征上往往性质较差,只有在样本容量n较大时,才能保障它的优良性,因而理论上讲,矩法估计是以大样本为应用对象的。

7602

7602

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?