【交叉验证方法介绍】

转自http://page.renren.com/600754883/note/912691419 在pattern recognition与 machine learning 的相关研究中,经常会将 dataset 分为 training 跟 test 这两个subsets,前者用以建立 model,后者则用来评估该 model 对未知样本进行预测时的精确度,正规的说法是generalization ability。在往下叙述之前,这边就必须点出一个极为重要的观念:只有 training data 才可以用在 model 的训练过程中,test data 则必须在 model 完成之后才被用来评估 model 优劣的依据。

怎么将完整的 dataset 分为 training set 与 test set 也是学问,必须遵守两个要点:

1. training set 中样本数量必须够多,一般至少大于总样本数的 50%。

2. 两组子集必须从完整集合中均匀取样。 其中第 2 点特别重要,均匀取样的目的是希望减少 training/test set 与完整集合之间的偏差(bias),但却也不易做到。一般的作法是随机取样,当样本数量足够时,便可达到均匀取样的效果。然而随机也正是此作法的盲点,也是经常是可以在数据上做手脚的地方。举例来说,当辨识率不理想时,便重新取样一组training set 与 test set,直到 test set 的辨识率满意为止,但严格来说这样便算是作弊了。Cross-validation 正是为了有效的估测 generalization error 所设计的实验方法,可以细分为 double cross-validation、k-fold cross-validation 与leave-one-out cross-validation。

Double cross-validation 也称 2-fold cross-validation(2-CV),作法是将 dataset 分成两个相等大小的subsets,进行两回合的分类器训练。在第一回合中,一个 subset 作为 training set,另一个便作为 test set;在第二回合中,则将 training set 与 test set 对换后,再次训练分类器,而其中我们比较关心的是两次 test sets 的辨识率。不过在实务上 2-CV 并不常用,主要原因是 training set 样本数太少,通常不足以代表母体样本的分布,导致test 阶段辨识率容易出现明显落差。此外,2-CV 中分 subset的变异度大,往往无法达到「实验过程必须可以被复制」的要求。

K-fold cross-validation (k-CV)则是 double cross-validation 的延伸,作法是将dataset 切成 k 个大小相等的 subsets,每个 subset 皆分别作为一次 test set,其余样本则作为training set,因此一次 k-CV 的实验共需要建立 k 个models,并计算 k 次 test sets 的平均辨识率。在实作上,k 要够大才能使各回合中的 training set 样本数够多,一般而言 k=10 算是相当足够了。

最后是leave-one-out cross-validation (LOOCV),假设 dataset 中有 n 个样本,那 LOOCV 也就是n-CV,意思是每个样本单独作为一次 test set,剩余 n-1个样本则做为 training set,故一次 LOOCV 共要建立 n个 models。相较于前面介绍的 k-CV,LOOCV 有两个明显的优点: 每一回合中几乎所有的样本皆用于训练model,因此最接近母体样本的分布,估测所得的 generalization error比较可靠;实验过程中没有随机因素会影响实验数据,确保实验过程是可以被复制的。但 LOOCV 的缺点则是计算成本高,因为需要建立的models 数量与总样本数量相同,当总样本数量相当多时,LOOCV 在实作上便有困难,除非每次训练 model的速度很快,或是可以用平行化计算减少计算所需的时间。

在MATLAB中,用户可以使用cvpartition、repartition等命令对数据集进行拆分,完成交叉验证。

【交叉验证Mark】

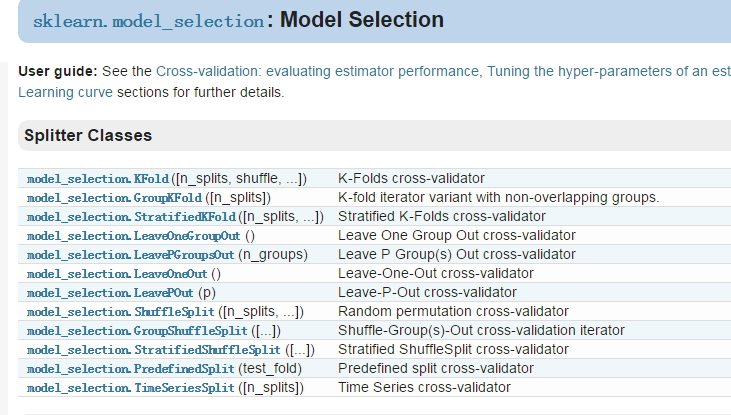

1. Python 利用scikit-learn 实现交叉验证

*0.17版本在sklearn.cross_validation中

*0.19版本在sklearn.model_selection中

两个版本使用起来有微小差别,根据官方提醒,可能这个功能在0.20版本后会移除。

通常使用StratifiedKFold,可利用统计信息将样本的不同种类按原来的比例分到每一则数据集当中。若设定shuffle = True,样本将随机抽取。

使用教程:

http://scikit-learn.org/dev/modules/generated/sklearn.model_selection.StratifiedKFold.html#sklearn.model_selection.StratifiedKFold

2. 注意validation set和 cross-validation的区别

在实验的过程中,通常将training set划分出一部分为validation set,进行中间参数的选择。

265

265

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?