pytorch框架中有一个非常重要且好用的包:torchvision,顾名思义这个包主要是关于计算机视觉cv的。这个包主要由3个子包组成,分别是:torchvision.datasets、torchvision.models、torchvision.transforms。

具体介绍可以参考官网:https://pytorch.org/docs/master/torchvision

具体代码可以参考github:https://github.com/pytorch/vision

torchvision.models这个包中包含alexnet、densenet、inception、resnet、squeezenet、vgg等常用经典的网络结构,并且提供了预训练模型,可以通过简单调用来读取网络结构和预训练模型。

今天我们来解读一下ResNet的源码实现。如果对ResNet不是很了解 可以查看这里的论文笔记

https://blog.csdn.net/sinat_33487968/article/details/83650718

torchvision里面实现了ResNet的多个版本,见下图。

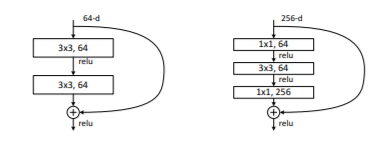

__all__ = ['ResNet', 'resnet18', 'resnet34', 'resnet50', 'resnet101','resnet152']我们知道ResNet里面最重要的就是残差学习模块的构建了,在论文里面一共有两种模块,在这里分别定义为BasicBlock类和Bottleneck类。前者适用于ResNet18和ResNet34,后者用于ResNet50,ResNet101和ResNet152.

先看看左边的BasicBlock类。先是定义了一个conv3*3的函数卷积操作留待后面用,在BasicBlock类里两个3*3的卷积为主要部分,用了batchnorm和relu激活函数,其中downsample在后面_make_layer函数会有定义,它其实就是一个普通的卷积过程(卷积核大小为1),字面意思就是下采样。

out += residual 就是将残差和原始的输入相加,最后再用relu激活函数。很直观。

expansion是跟downsample有关的,他的直面意思是扩张,因为残差层里输入输出需要保持一致,所以不一致就要用到downsample。

def conv3x3(in_planes, out_planes, stride=1):

"""3x3 convolution with padding"""

return nn.Conv2d(in_planes, out_planes, kernel_size=3, stride=stride,

padding=1, bias=False)

class BasicBlock(nn.Module):

expansion = 1

def __init__(self, inplanes, planes, stride=1, downsample=None):

super(BasicBlock, self).__init__()

self.conv1 = conv3x3(inplanes, planes, stride)

self.bn1 = nn.BatchNorm2d(planes)

self.relu = nn.ReLU(inplace=True)

self.conv2 = conv3x3(planes, planes)

self.bn2 = nn.BatchNorm2d(planes)

self.downsample = downsample

self.stride = stride

def forward(self, x):

residual = x

out = self.conv1(x)

out = self.bn1(out)

out = self.relu(out)

out = self.conv2(out)

out = self.bn2(out)

if self.downsample is not None:

residual = self.downsample(x)

out += residual

out = self.relu(out)

return out

再来看一下右边的残差学习模块Bottleneck类。主要由1*1,3*3和1*1三个卷积层组成。跟上面的只是卷积层的个数和卷积核的大小改变了,并没有其他不同。

class Bottleneck(nn.Module):

expansion = 4

def __init__(self, inplanes, planes, stride=1, downsample=None):

super(Bottleneck, self).__init__

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

711

711

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?