人工神经网络(Artificial Neural Networks, ANN),是模拟生物神经网络进行信息处理的一种数学模型。

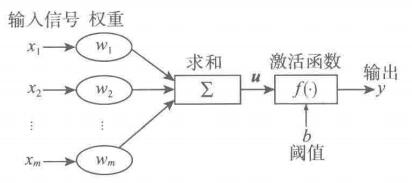

人工神经元是人工神经网络操作的基本信息处理单位。人工神经元的处理的模型如下:

一个人工神经元对输入信号

X

=

[

x

1

,

x

2

,

.

.

.

x

m

]

T

X =[x_1,x_2,...x_m]^T

X=[x1,x2,...xm]T的输出

y

=

f

(

u

+

b

)

y=f(u+b)

y=f(u+b),其中

∑

i

=

1

m

w

i

x

i

\displaystyle \sum^{m}_{i=1}{w_ix_i}

i=1∑mwixi。

人工神经网络的学习也称为训练,指的是神经网络在受到外部环境的刺激下调整神经网络的参数,使神经网络以一种新形式对外部环境作出反应的一个过程。在分类与预测中,人工神经网络主要使用有指导的学习方式,即根据给定的训练样本,调整人工神经网络的参数以使网络输出接近于已知的样本类标记或其他形式的因变量。

激活函数主要有以下

4

4

4 种形式

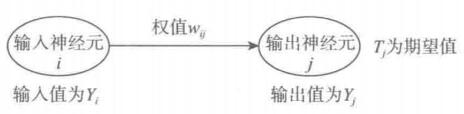

在分类与预测中,

δ

\delta

δ 学习规则(误差校正学习算法)是使用最广泛的一种。误差校正学习算法根据神经网络的输出误差对神经元的连接强度进行修正,属于有指导学习。设神经元

i

i

i 作为输入,神经元

j

j

j 作为输出神经元,它们的连接权值为

w

i

j

w_{ij}

wij,则对权值的修正为

Δ

w

i

j

=

η

δ

j

Y

i

\Delta w_{ij} = \eta\delta_jY_i

Δwij=ηδjYi,其中

η

\eta

η 为学习效率,

δ

j

=

T

j

−

Y

j

\delta_j = T_j-Y_j

δj=Tj−Yj 为

j

j

j 的偏差,即输出神经元

j

j

j 的实际输出和教师信号之差,如图所示。

神经网络的训练是否完成常用误差函数(也称目标函数) E E E来衡量。当误差函数小于某一个设定的值时即停止神经网络的训练。误差函数为衡量实际输出向量 Y k Y_k Yk 与期望值向量 T k T_k Tk 误差大小的函数,常采用二乘误差函数来定义 E = 1 2 ∑ k = 1 N [ Y k − T k ] 2 , k = 1 , 2 , . . , N E=\frac{1}{2}\displaystyle \sum^{N}_{k=1}{[Y_k-T_k]^2},k=1,2,..,N E=21k=1∑N[Yk−Tk]2,k=1,2,..,N为训练样本个数。

人工神经网络算法

| 算法名称 | 算法描述 |

|---|---|

| BP神经网络 | 是一种按误差逆传播算法训练的多层前馈网络,学习算法是 δ \delta δ 学习规则,是目前应用最广泛的神经网络模型之一 |

| LM神经网络 | 是基于梯度下降法和牛顿法结合的多层前馈网络,特点:迭代次数少,收敛速度快,精确度高 |

| RBF径向神经网络 | RBF网络能够以任意精度逼近任意连续函数,从输入层到隐含层的变换是非线性的,而从隐含层到输出层的变换是线性的,特别适合于解决分类问题 |

| FNN模糊神经网络 | FNN模糊神经网络是具有模糊权系数或者输入信号是模糊量的神经网络,是模糊系统与神经网络想结合的产物,它汇聚了神经网络与模糊系统的优点,集联想、识别、自适应及模糊信息处理于一体 |

| GMDH神经网络 | GMDH网络也称为多项式网络,它是前馈神经网络中常用的一种用于预测的神经网络。它的特点是网络结构不固定,而且在训练过程中不断改变 |

| ANFIS自适应神经网络 | 神经网络镶嵌在一个全部模糊的结构之中,在不知不觉中向训练数据学习,自动产生、修正并高度概况出最佳的输入与输出变量的隶属函数以及模糊规则;另外,神经网络的各层结构与参数也都具有了明确的、易于理解的物理意义 |

人工神经网络——反向传播(Back Propagation, BP)算法

BP算法是利用输出后的误差来估计输出层的直接前导层误差,再利用这个误差估计更前一层的误差,如此一层一层的反向传播下去,就获得所有其他各层的误差估计。这样就形成了将输出层表现出的误差沿着与输入传送相反的方向逐级向网络的输入层传递的过程。以典型的三层BP网络为例,描述标准的BP算法。假设有一个有3个输入节点,4个隐层节点,1个输出节点的三层BP神经网络。

BP算法的学习过程由信号的正向传播与误差逆向传播两个过程组成。正向传播时,输入信号经过隐层的处理后传向输出层。若输出层节点未能得到期望的输出,则转入误差的逆向传播阶段,将输出误差按照某种子形式,通过隐层向输入层返回,并“分摊”给隐层 4 个节点与输入层

x

1

、

x

2

、

x

3

x_1、x_2、x_3

x1、x2、x3三个输入节点,从而获得各层单元的参考误差或误差信号,作为修改各个单元权值的依据。这种信号正向传播与误差逆向传播的各层权矩阵的修改过程,是周而复始的。权值不断修改的过程,也就是网络学习(或训练)的过程。此过程一直进行到网络输出误差逐渐减少到可接受的程度或达到设定的学习次数为止。

算法开始后,给定学习次数上限,初始化学习次数为 0,对权值和阈值赋予小的随机数,一般在

[

−

1

,

1

]

[-1,1]

[−1,1] 之间。输入样本数据,网络正向传播,得到中间层与输出层的值。比较输出层的值与教师信号值的误差,用误差函数

E

E

E 来判断误差是否小于误差上线,如不小于误差上限,则对中间层和输出层权值和阈值进行更新,更新的算法为

δ

\delta

δ 学习规则。更新权值和阈值后,再次将样本数据作为输入,得到中间层与输出层的值,计算误差

E

E

E 是否小于上限,学习次数是否达到指定值,如果达到,则学习结束。

BP算法值用到均方误差函数对权值和阈值的一阶导数(梯度)信息,使得算法存在收敛速度缓慢、易陷入局部极小等缺陷

示例

神经网络算法预测销量高低

数据下载: sales_data.xls

import pandas as pd

from keras.models import Sequential

from keras.layers.core import Dense, Activation

def cm_plot(y, yp):

from sklearn.metrics import confusion_matrix # 导入混淆矩阵函数

cm = confusion_matrix(y, yp) # 混淆矩阵

import matplotlib.pyplot as plt # 导入作图库

plt.matshow(cm, cmap=plt.cm.Greens) # 画混淆矩阵图,配色风格使用cm.Greens,更多风格请参考官网。

plt.colorbar() # 颜色标签

for x in range(len(cm)): # 数据标签

for y in range(len(cm)):

plt.annotate(cm[x, y], xy=(x, y), horizontalalignment='center', verticalalignment='center')

plt.ylabel('True label') # 坐标轴标签

plt.xlabel('Predicted label') # 坐标轴标签

return plt

# 参数初始化

inputfile = '../Data/sales_data.xls'

data = pd.read_excel(inputfile, index_col=u'序号') # 导入数据

# 数据是类别标签,要将它转换为数据

# 用1来表示“好” “是” “高” 这 3 个属性,用 0 来表示 “坏” “否” “低”

data[data == u'好'] = 1

data[data == u'是'] = 1

data[data == u'高'] = 1

data[data != 1] = 0

x = data.iloc[:, :3].values.astype(int)

y = data.iloc[:, 3].values.astype(int)

model = Sequential() # 建立模型

model.add(Dense(input_dim=3, units=10, activation='relu')) # 用relu函数作为激活函数,能够大幅度提供准确度

model.add(Dense(input_dim=10, units=1, activation='sigmoid')) # 由于是 0-1 输出,用 sigmoid 函数作为激活函数

model.compile(loss='binary_crossentropy', optimizer='adam', metrics=['accuracy']) # 求解方法我们指定用 adam,还有sgd、rmsprop等可选

model.fit(x, y, epochs=1000, batch_size=10) # 训练模型,学习1000次,每次以10个样本为一个batch进行迭代

yp = model.predict_classes(x).reshape(len(y)) # 分类预测

cm_plot(y, yp).show() # 显示混淆矩阵可视化结果

效果:

从上图可以看出,样本检测为34个,预测正确的个数为 26 个,预测准确率为 76.4%,预测准确率较低,是由于神经网络训练时需要较多样本,而这里是由于训练数据较少造成的。

目前神经网络(尤其是深度神经网络)中流行的防止过拟合的方法是随机地让部分神经网络节点休眠。

1275

1275

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?