LLM系列(4):通义千问7B在Swift/DeepSpeed上微调秘诀与实战陷阱避坑指南

阿里云于 2023年8 月 3 日开源通义千问 70 亿参数模型,包括通用模型 Qwen-7B 以及对话模型 Qwen-7B-Chat,这也是国内首个开源自家大模型的大厂。在诸多权威大模型能力测评基准上,如 MMLU、C-Eval、GSM8K、HumanEval、WMT22,通义千问 7B 均取得了同参数级别开源模型中的最好表现,令人印象深刻。

近期,我们在 DeepSpeed 和 ModelScope 所提供的 Swift 两种框架下成功对通义千问 7B 模型进行了微调,本文用于将其最佳实践以及实践过程中所踩过的坑进行沉淀记录,一方面用于团队内部的温故复习,另一方面希望能够分享到社区,与大家沟通交流。由于硬件限制,本文暂不涉及 RLHF 强化训练部分,仅涉及通义千问模型的 SFT 阶段;

- 运行环境

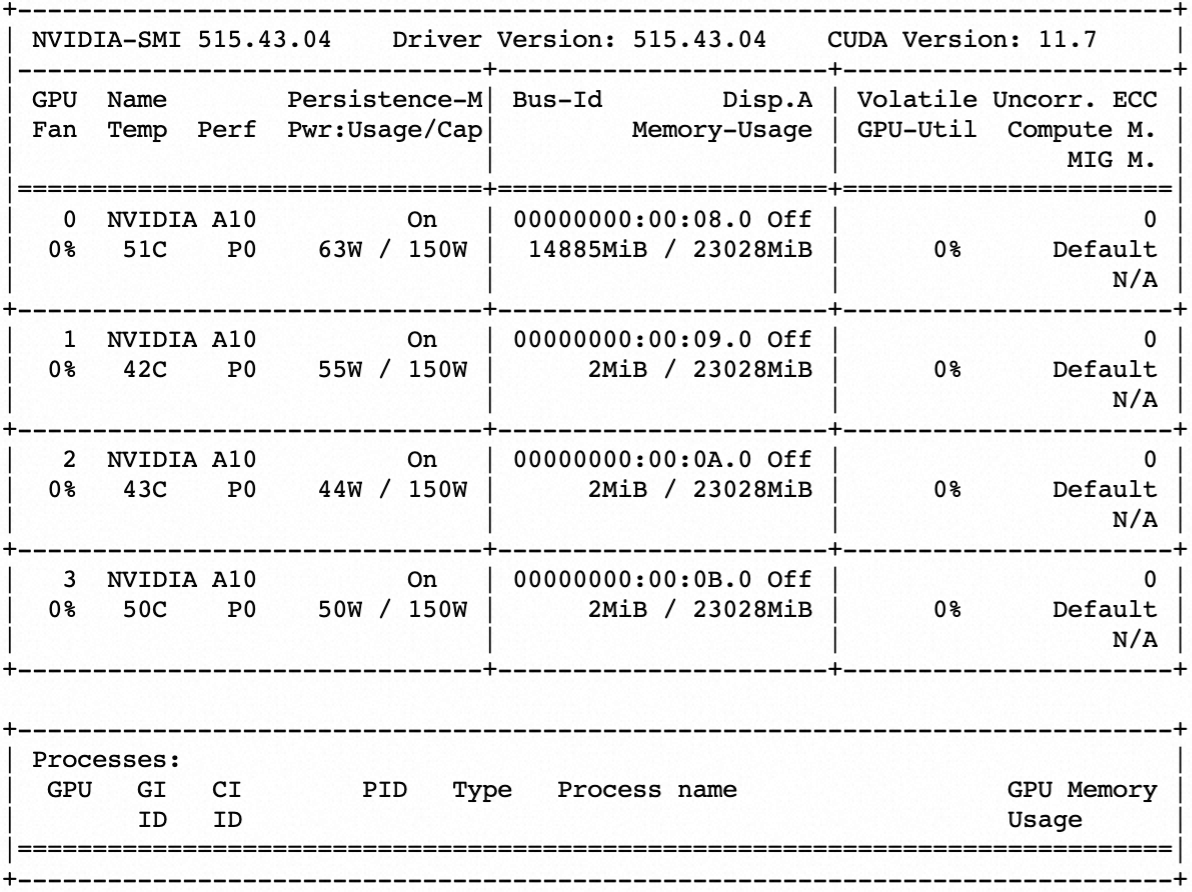

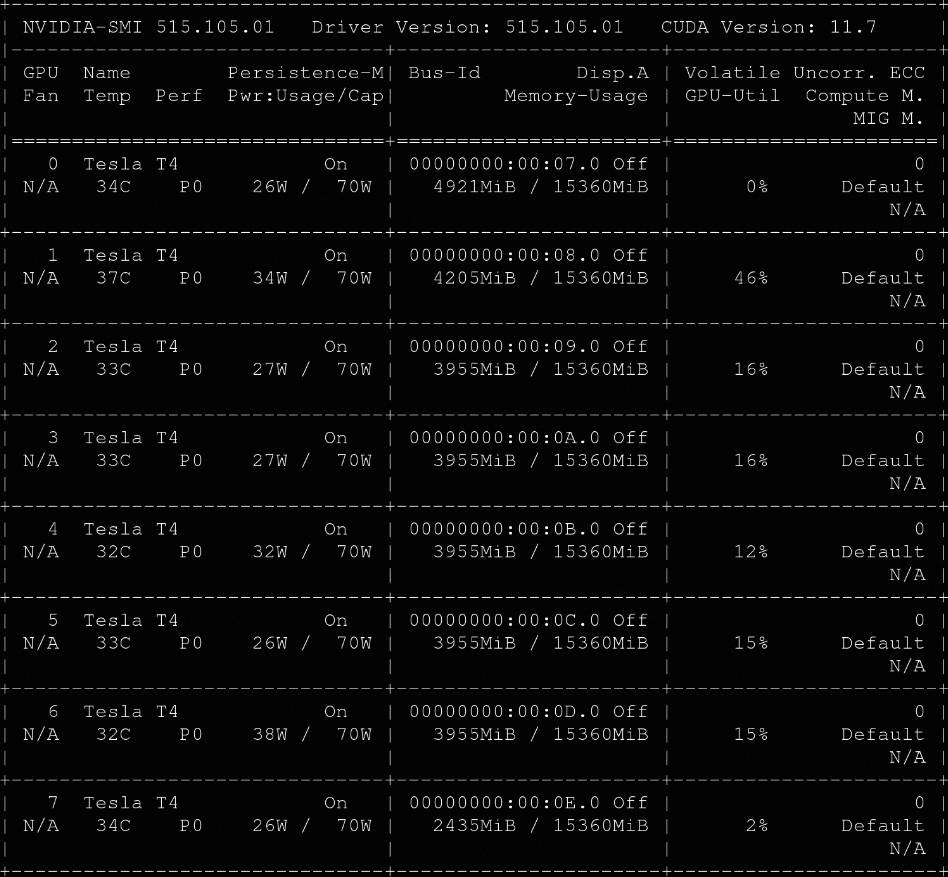

我们曾分别在处于在线环境以及离线环境的两台机器上进行微调训练,其中:

- 在线环境显卡配置为:4 张 24G 显存的 A10 显卡。

- 离线环境显卡配置为:8 张 15G 显存的 Tesla T4 显卡。

由于存在需要在未联网机器上训练

订阅专栏 解锁全文

订阅专栏 解锁全文

389

389

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?