位置感知图神经网络:主动学习节点的相对位置

摘要

大多数现有的图神经网络(GNNs)都使用消息传递和聚合的框架来学习节点嵌入。这样的GNNs无法学习图中图节点之间的相对位置。为了使GNNs能够感知节点的位置,一些节点被设置为锚点。然后,利用从一个节点到锚点的距离,GNNs可以推断出节点之间的相对位置。然而,P-GNNs选择锚点,导致了位置感知和特征提取的妥协。为了消除这种妥协,我们证明了选择均匀分布和不对称的锚点是必要的。另一方面,我们证明了选择可以聚合图中所有节点的嵌入的锚点是NP困难的。因此,在确定性方法中设计有效的最优算法实际上是不可行的。为了确保位置感知和绕过NP的完整性,我们提出了位置感知图神经网络(PSGNNs, Position-Sensing Graph Neural Networks ),学习如何以可反向传播的方式选择锚点。实验验证了PSGNNs对最先进的GNN的有效性,在各种合成和真实图数据集上的性能。具体来说,与现有最先进的位置感知方法相比,PSGNNs对节点分类的平均AUC超过14%,对链接预测的提高18%。我们的源代码可以在: https://github.com/ZhenyueQin/PSGNN上公开获得。

关键词-图神经网络,位置感知(position-aware )

1.Introduction

目前神经网络研究的一个新趋势是设计图神经网络(GNNs)用于学习网络结构化数据,如分子、生物和社会网络[1]。为了提取有意义的节点表示,GNNs通常遵循递归的邻域聚合模式。具体来说,每个节点聚合自己和邻居的特征向量,然后进行一个非线性变换。随着迭代的继续,一个节点稳定地聚集越来越遥远的邻居的信息。我们将此模式称为消息传递和聚合的方法。这种学习范式已被证明在许多任务上都是有效的,如节点和图的分类、链接预测和图的生成。

[1] Zonghan Wu, Shirui Pan, Fengwen Chen, Guodong Long, Chengqi Zhang, and S Yu Philip, “A comprehensive survey on graph neural networks,” IEEE TNNLS, 2020. 1

尽管使用消息传递和聚合的方法来学习节点表示是有效的,但它不能提取图[2]中节点之间的相对位置。然而,了解相对位置对于各种任务[3],[4]是必不可少的。例如,节点更有可能有连接,并与其他节点之间距离较小的节点位于[5]。因此,发现节点间的相对距离有利于链路预测和社区检测等任务。特别是,当所有节点的特征相同时,两个节点之间的成对距离信息就成为解决这两个问题不可缺少的唯一线索。

[2] Jiaxuan You, Rex Ying, and Jure Leskovec, “Position-aware graph neural networks,” in ICML, 2019, pp. 7134–7143. 1, 2, 3, 4, 5

[3] EL-MOUSSAOUI Mohamed, Tarik Agouti, Abdessadek Tikniouine, and Mohamed El Adnani, “A comprehensive literature review on community detection: Approaches and applications,” Procedia Computer Science, vol. 151, pp. 295–302, 2019. 1

[4] Muhan Zhang and Yixin Chen, “Link prediction based on graph neural networks,” in Advances in Neural Information Processing Systems, 2018, pp. 5165–5175. 1

[5] Nur Nasuha Daud, Siti Hafizah Ab Hamid, Muntadher Saadoon, Firdaus Sahran, and Nor Badrul Anuar, “Applications of link prediction in social networks: A review,” Journal of Network and Computer Applications, p. 102716, 2020. 1

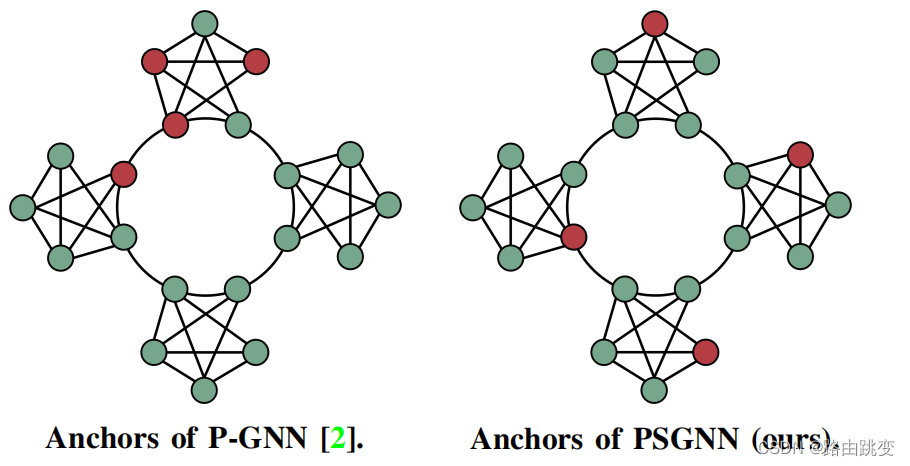

为了使GNNs具有位置感知能力,最近,You等人[2]提出了位置感知(position-aware)图神经网络(P-GNNs),通过将图中的一些节点作为锚点。因此,其他节点可以通过比较它们与锚点[2]的距离来知道它们的相对距离。然而,P-GNNs[2]以一种随机的方式选择锚点。当锚点选择不当时,会出现两个问题: 1)锚点在图中不均匀分布。在P-GNNs中,节点通过聚合不同锚点的表示来学习其特征向量,锚点通过聚合其邻居的信息来提取特征。因此,如果锚点集中在一个小的子图中(见图1左侧),锚点无法提取出图的综合信息,导致远离锚点的节点表示较差。2)锚定点定位于对称节点上。在所有节点具有相同特征的条件下,如果两个节点通过消息传递和聚合得到的学习表示相同,则这两个节点是对称的。也就是说,这两个节点周围的两个子图是同构的。如果两个锚点是对称的,那么从两个对称节点到两个锚点的距离将是相同的,从而导致位置无意识。我们将在第四节的后面进行更详细的解释。

[2] Jiaxuan You, Rex Ying, and Jure Leskovec, “Position-aware graph neural networks,” in ICML, 2019, pp. 7134–7143. 1, 2, 3, 4, 5

图1:P-GNN[2](左)和本文提出的PSGNN(右)为连接Caveman图选择的锚的样本。锚点用红色突出显示。PSGNN选择的锚点在不同的群落中均匀分布,没有对称的锚点,而P-GNN选择的锚点则随机分散并产生对称性。

为了解决随机选择锚点的缺点,我们提出了位置感知图神经网络(PSGNNs)。PSGNN不是任意选择锚,而是包含一个可学习的锚-选择组件,使网络能够以一种可反向传播的方法来选择锚。从理论上讲,我们证明了选择最优锚等价于一个NP完备问题,这导致了用一个有效的确定性算法来选择最优锚是不可行的。因此,通过学习等启发式方法来选择锚点是不可避免的。实际上,PSGNNs在许多图形数据集上比现有的竞争性GNNs表现出了实质性的改进。随后的分析发现,PSGNNs选择了分布良好且不对称的锚点(见图1中的右图)。此外,随着图大小的增大,PSGNNs的性能稳步增长,这反映了其理想的可伸缩性。

我们总结了我们的贡献如下:

1)我们展示了选择良好分布和非对称锚的NP完全困难。

2)我们提出了PSGNNs,它可以学习以一种可反向传播的方式选择理想的锚点,其性能优于现有的各种最先进的模型。

3)PSGNNs还揭示了理想的可伸缩性,在巨大图上很好地学习节点之间的相对位置。

2. Related Work

现有的GNN模型起源于基于频谱的图卷积网络,尽管它们目前的形式似乎与基于频谱的模型[6]非常不同。基于光谱的GNNs将输入图映射到频谱表示,表示扩散[7]的程度。

[6] Filippo Maria Bianchi, Daniele Grattarola, and Cesare Alippi, “Spectral clustering with graph neural networks for graph pooling,” ICML, 2020. 2

[7] Joan Bruna, Wojciech Zaremba, Arthur Szlam, and Yann LeCun, “Spectral networks and locally connected networks on graphs,” ICLR, 2013. 2

原始的基于频谱的GNNs直接利用拉普拉斯变换[8]和卷积定理[9]对图[10]进行卷积运算。为了降低拉普拉斯变换的计算代价,切比雪夫近似已被应用于解决高计算代价运算[11]的问题。利用切比雪夫多项式的前两项,Kipf等人[12]提出了图卷积网络(GCNs)。在GCNs之后,还有各种其他的GNNs,如图注意网络(GATs)[13]、图采样和聚合(GraphSAGE)[14]和图同构网络(GIN)[15]。另一方面,也提出了一系列的网络嵌入方法,如DeepWalk [16]、LINE [17]和节点2vec[18]。

[8] Eduardo Pavez and Antonio Ortega, “Generalized laplacian precision matrix estimation for graph signal processing,” in 2016 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP). IEEE, 2016, pp. 6350–6354. 2

[9] Bingbing Xu, Huawei Shen, Qi Cao, Yunqi Qiu, and Xueqi Cheng, “Graph wavelet neural network,” in International Conference on Learning Representations, 2018. 2

[10] Hermina Petric Maretic and Pascal Frossard, “Graph laplacian mixture model,” IEEE Transactions on Signal and Information Processing over Networks<

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?