越来越多没填的坑。而我还在开新的坑。。。。。。

这次实现了一个搜索引擎,语言为python,搜索内容为自己从知乎上面抓下来的10万个问题。仅搜索问题题目。

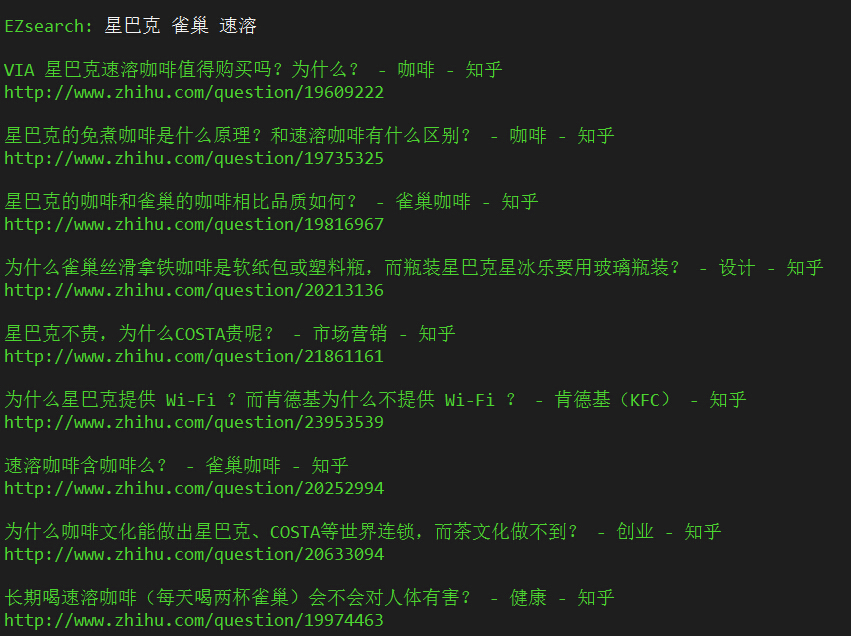

以下大概是搜索效果:

其实搜索引擎的建立基础流程也就那样,最主要的是大量,不不不,巨量的数据处理,巨量的算法,巨量的排序。

下面是流程分析:

一 爬取网页

这一块感觉没啥好说的, 就是学了两三天scrapy,当然其中很多的弯弯绕绕我也没搞懂,但是基本的使用确实能满足要求了。爬取使用了深度优先爬,本程序中,使用的方式是从五个种子问题开始,爬标题,url,html文档,获取当前页面中http://www.zhihu.com/question开头的网址。然后从获取的新的网址中进行新一轮的递归,从而完成深度优先的爬取。不过书上说广度优先爬取比较好,因为如果从首页开始爬,深度越浅,说明该页面越重要(有道理)。但是我们爬知乎的问题之间的关系都是平行的,所以不存在这个问题。

爬到的数据库用sqlite3存起来,不得不敬服一下女朋友在数据库上深厚的造诣,我是搞不定数据库的语法了T T。

保存结果用SQLiteSpy打开大概这样:

本文介绍了使用Python实现一个简单的搜索引擎的过程,包括爬取知乎问题、分词、建立索引和查询系统。主要依赖Scrapy进行网页爬取,使用jieba进行分词,构建词典、正排索引和倒排索引,并实现了基于倒排索引的查询系统。

本文介绍了使用Python实现一个简单的搜索引擎的过程,包括爬取知乎问题、分词、建立索引和查询系统。主要依赖Scrapy进行网页爬取,使用jieba进行分词,构建词典、正排索引和倒排索引,并实现了基于倒排索引的查询系统。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

436

436

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?