5ire是一款开源跨平台的桌面智能助手和MCP(Model Context Protocol)客户端

官网:5ire - A Sleek Desktop AI Assistant and MCP (Model Context Protocol) Client

star 1.5k ,所以这是一款比较流行的支持MCP的大模型助手。

目录

现在的问题:在5ire里,可以安装工具,但是大模型没有调用工具

通过 MCP 服务器支持工具

MCP 是一种开放协议,它标准化了应用程序如何为 LLM 提供上下文。将 MCP 想象成 AI 应用程序的 USB-C 端口。正如 USB-C 提供了一种将设备连接到各种外围设备和配件的标准化方式一样,MCP 也提供了一种将 AI 模型连接到不同数据源和工具的标准化方式。

使用工具,您可以访问文件系统、获取系统信息、与数据库交互、访问远程数据等,而不仅仅是进行简单的对话。

近期MCP非常火,很多人都预测今年2025年将是MCP年,个人深有同感。但是在5ire 使用MCP实践过程中,遇到了很多问题,留档以助学习和记忆!

安装使用5ire

安装5ire

Windows可以直接下载安装软件,到这里下载:

启动配置5ire

启动5ire后,先去确认下它是否支持MCP:

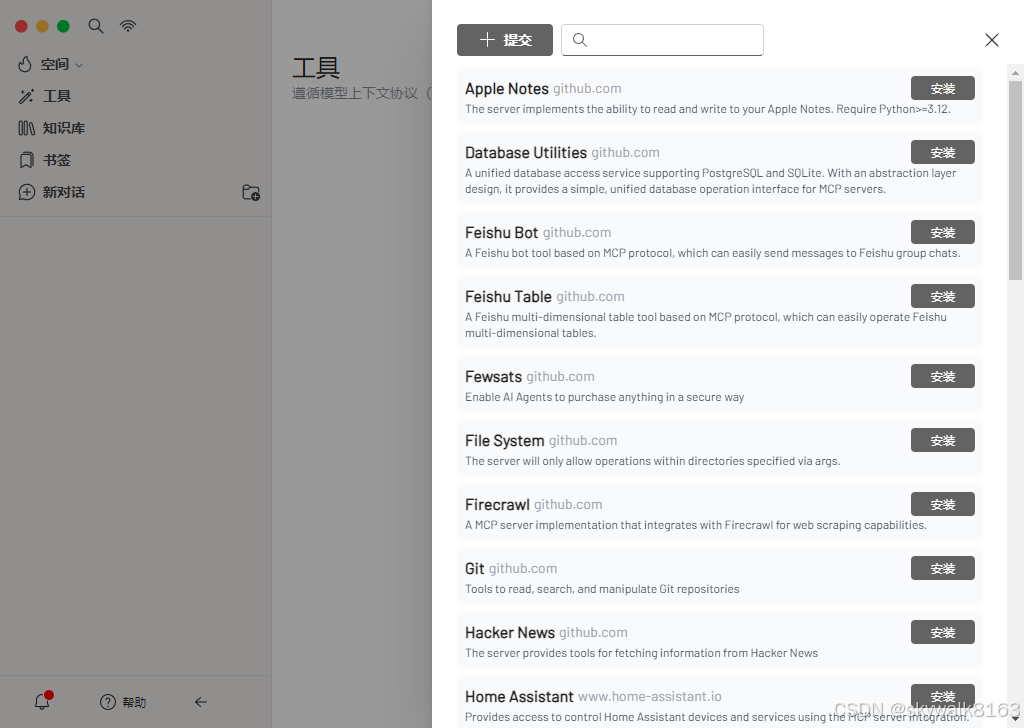

点工具,工具市场,终于能看到MCP服务软件了!

创建或添加几个mcp工具

新创建一个Blender-mcp的

配置如下:

{

"name": "blender-mcp",

"key": "blendermcp",

"description": "blender-mcp",

"command": "uvx",

"args": [

"blender-map"

]

}

然后停止原来的服务:

uvx blender-mcp但是连接还是报错:

Error: MCP error -1: Connection closed

碰到的第一个坑:设定模型

而且这个5ire软件里面竟然没有找到设置大模型的地方,“首页”显示:请先在设置页面填写 API 的必要信息。

创建新对话“目录”后,可以设定模型,但是只有8个模型可选...逼的我都问AI去了....

晕,找到了,原来是在“空间”-“设置”里面可以设置API信息。使用的是自建 大模型API服务器192.168.1.5:1337,所以在5ire里面选的是LMStudio模型,这样可以浏览到自建服务器里所有的模型。如果选OpenAI,则只有8个模型可以选,且里面没有deepseek模型。

安装Time MCP工具

设置好后,在工具那里安装了Time工具。

但是对话框里问它几点,还是回答:我无法直接执行代码或使用实时工具查看时间。

发现自己本机还没有nodejs,装nodejs看看。

装完没变化。这时候又尝试安装几个工具,比如File System、Shell等,但是都启动失败。

关掉5ire,然后再打开5ire,这回几个新装的工具都启动成功了!

还是无法在chat窗口调用Time等工具,是不是需要专门的支持函数调用的大模型?

换用chatglm模型试试

还是无法跟工具交互。

现在的问题:在5ire里,可以安装工具,但是大模型没有调用工具

问题解决,后来是测试了很多模型比如gpt-4o、chatglm、gpt-4等(正好自己搭建的平台claude-3-5-sonnet等几个claude模型都不能用),发现deepseek-v3 可以使用,问题解决

比如问它现在几点,输出:

现在几点了? 当前时间

今天是 2025 年 3 月 17 日,星期一。以下是部分地区的当前时间:

Al Jīzah, 埃及:3:40 上午

安卡拉, 土耳其:4:40 上午

万隆, 印度尼西亚:8:40 上午太棒了!

安装Hacker News工具

测试成功

从Hacker News 下载2个故事

从 Hacker News 网站获取一些头条新闻 You: ### 获取 Hacker News 头条新闻

以下是从 Hacker News 获取的一些最新头条新闻信息:

Hacker News AI 助手

- 链接: GitHub 项目

- 内容: 一个中文日报项目,自动抓取 Hacker News 和 Dev Community 热门文章及评论,并通过 AI 生成中文解读与总结。

总结

终于成功让MCP返回了当前时间和 从Hacker News 网站获取一些头条新闻,这次MCP的实践终于成功了。

测试mcp成功的模型:deepseek-v3 llama3.2:3b

踩过的一些坑:

首先因为国内无法使用claude desktop,找合适的MCP工具颇费了一些功夫。幸好最后两个软件5ire和mcphost都调试成功了。

因为没怎么接触过nodejs,所以对MCP 服务器的书写方式也比较陌生。不过好消息是,首先mcp服务器的书写和启动非常简单,其次一些软件会把MCP服务器放在软件里面,只要点点鼠标就行了,非常方便。

第三点就是一些模型好像不支持函数调用,又因为没有用Claude官方适配的模型,所以要一个一个试模型,花费了一些时间。

2372

2372

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?