(欢迎转载。本文源地址:http://blog.csdn.net/speeds3/article/details/76209152)

最近打算尝试一下OLAMI在游戏中应用的可能性,这里做一下记录。

unity官方教程中的几个项目很精简,但看起来很不错,里面有全套的资源。最后我选择了tanks-tutorial来做这个实验。

下载和修改项目

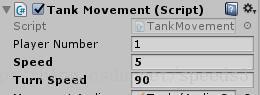

首先按照教程下好项目,把坦克移动和射击的代码加上。这时就已经可以称的上是一个“游戏”了,可以控制坦克在地图上环游,也可以开炮。虽然缺少了挨揍的敌人,但是对设想的用语音控制坦克移动和射击已经足够了。这里我把地图扩大了一些,把坦克的速度降了一些,这样不至于几下就开到了地图的边缘。

准备语义理解服务

接下来就可以开始加入语音功能了。OLAMI官网有c#的示例,示例中分别有cloud-speech-recognition和natural-language-understanding两个部分,前者字面意思似乎是语音识别,后者看起来是自然语义理解,里面又分为speech-input和text-input两部分,只是speech-input是空的。看看readme,原来已经包含在cloud-speech-recognition了。由于在这里不关心语音识别,所以就把他俩当作一样使用了,一个对应语音理解,是我们需要的部分,一个对应文字理解,可以用来测试,正好。

把SpeechApiSample.cs和NluApiSample.cs拖入unity里,稍作修改就可以直接使用。

在移动和射击脚本中添加语音控制接口

因为打算实现的方案是语音和键盘混合输入,键盘输入能打断语音控制的输入,所以这里要保存一些状态,记录是否是通过语音在控制行动或转向,以及语音转向的角度和当前已经转过的角度。代码如下:

TankMovement.cs

// 语音控制中已经转过的角度

private float turnAmount = 0f;

// 语音控制中希望转到的角度

private float turnTarget = 0f;

// 记录是否是语音控制移动的状态

private bool voiceMove;

// 记录是否是语音转向的状态

private bool voiceTurn;

private void Update () {

// Store the value of both input axes.

float movement = Input.GetAxis (m_MovementAxisName);

if (movement != 0) {

voiceMove = false;

m_MovementInputValue = movement;

} else if (!voiceMove) {

m_MovementInputValue = 0f;

}

float turn = Input.GetAxis (m_TurnAxisName);

if (turn != 0) {

voiceTurn = false;

m_TurnInputValue = turn;

} else if (!voiceTurn) {

m_TurnInputValue = 0f;

}

EngineAudio ();

}

private void Turn () {

// Determine the number of degrees to be turned based on the input, speed and time between frames.

float turn = m_TurnInputValue * m_TurnSpeed * Time.deltaTime;

if (turnTarget != 0) {

turnAmount += turn;

if (turnTarget > 0) {

if (turnAmount > turnTarget) {

m_TurnInputValue = 0f;

turnTarget = 0f;

turnAmount = 0f;

voiceTurn = false;

}

} el

本文介绍了如何在Unity游戏中结合OLAMI实现中文语音控制。通过下载和修改Unity项目,设置语义理解服务,添加语音控制接口,以及在OLAMI平台上配置语义,实现了坦克的语音移动和射击。尽管存在一定的延迟,但OLAMI的实时性适用于某些场景,作者计划进一步完善该功能。

本文介绍了如何在Unity游戏中结合OLAMI实现中文语音控制。通过下载和修改Unity项目,设置语义理解服务,添加语音控制接口,以及在OLAMI平台上配置语义,实现了坦克的语音移动和射击。尽管存在一定的延迟,但OLAMI的实时性适用于某些场景,作者计划进一步完善该功能。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1795

1795

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?