Gradient descent 用于解决 Optimization Problems, 而Exact Line Search和Backtracking Line Search是 Gradient descent算法 中用于确定步长的具体线搜索策略。这些策略被应用于Gradient descent算法的每次迭代中,以确定参数更新的合适步长,以便逐步接近最优解。

拿到一个问题,

-

确定目标函数:明确要优化的目标函数。这可以是一个损失函数,需要最小化

-

初始化参数:为优化过程初始化参数的初始值。这些参数将被逐步更新以接近最优解。

-

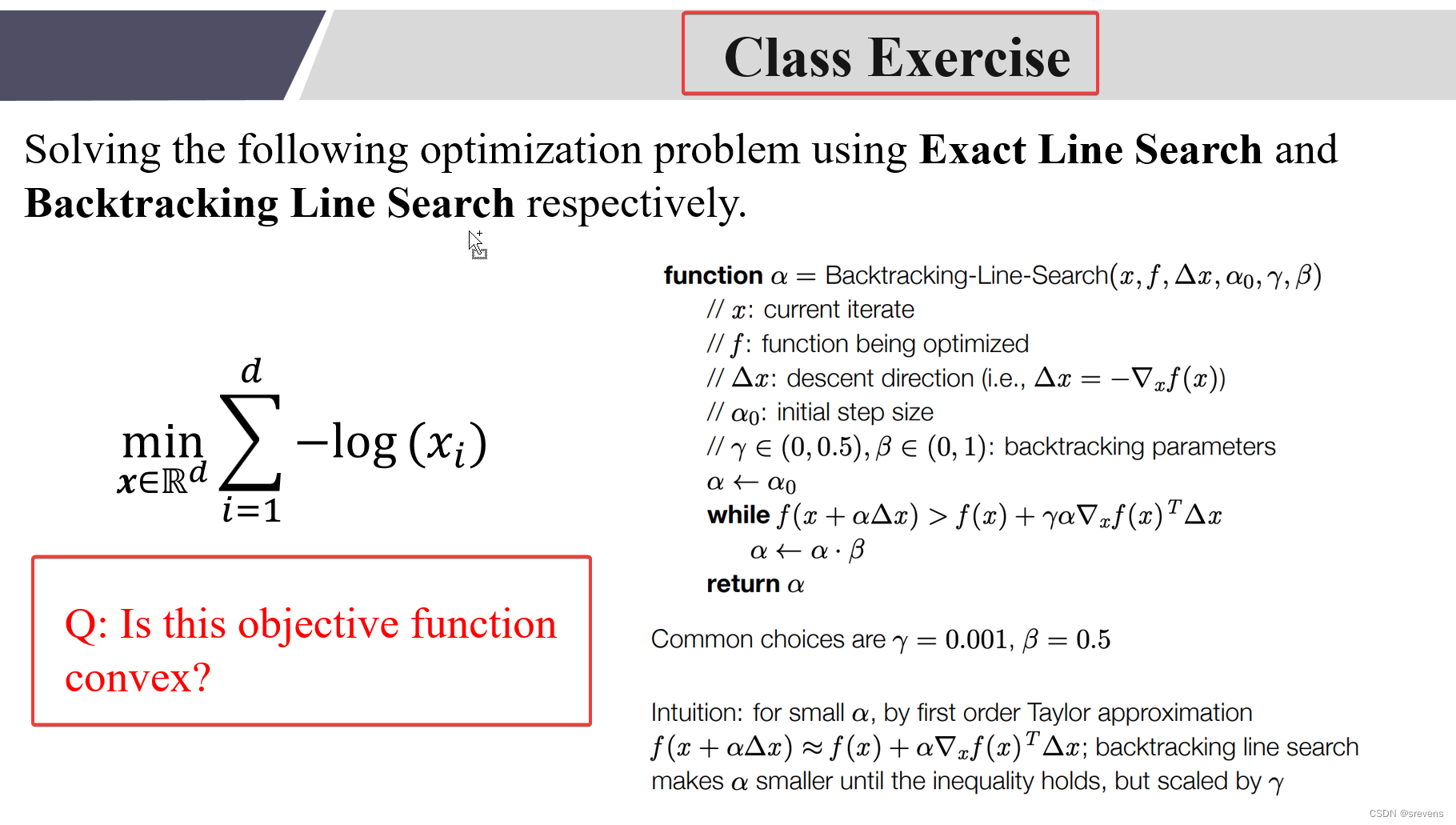

判断函数凸性:判断目标函数是否是凸函数。如果是凸函数,则梯度下降算法有望找到全局最优解。(二阶导大于0)( 凸函数的和还是凸函数 )得出结论后,不需要在代码实现中去验证。

-

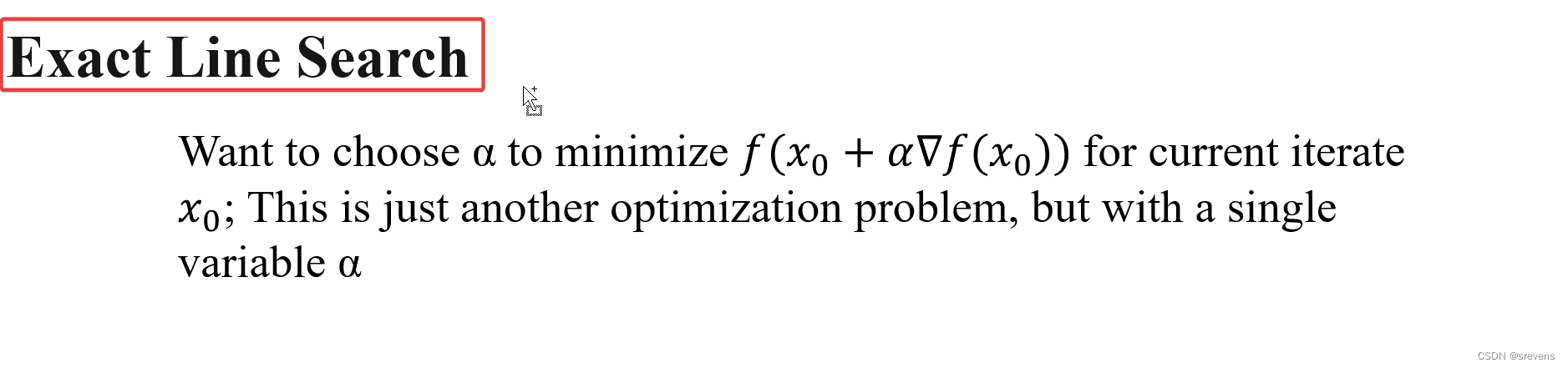

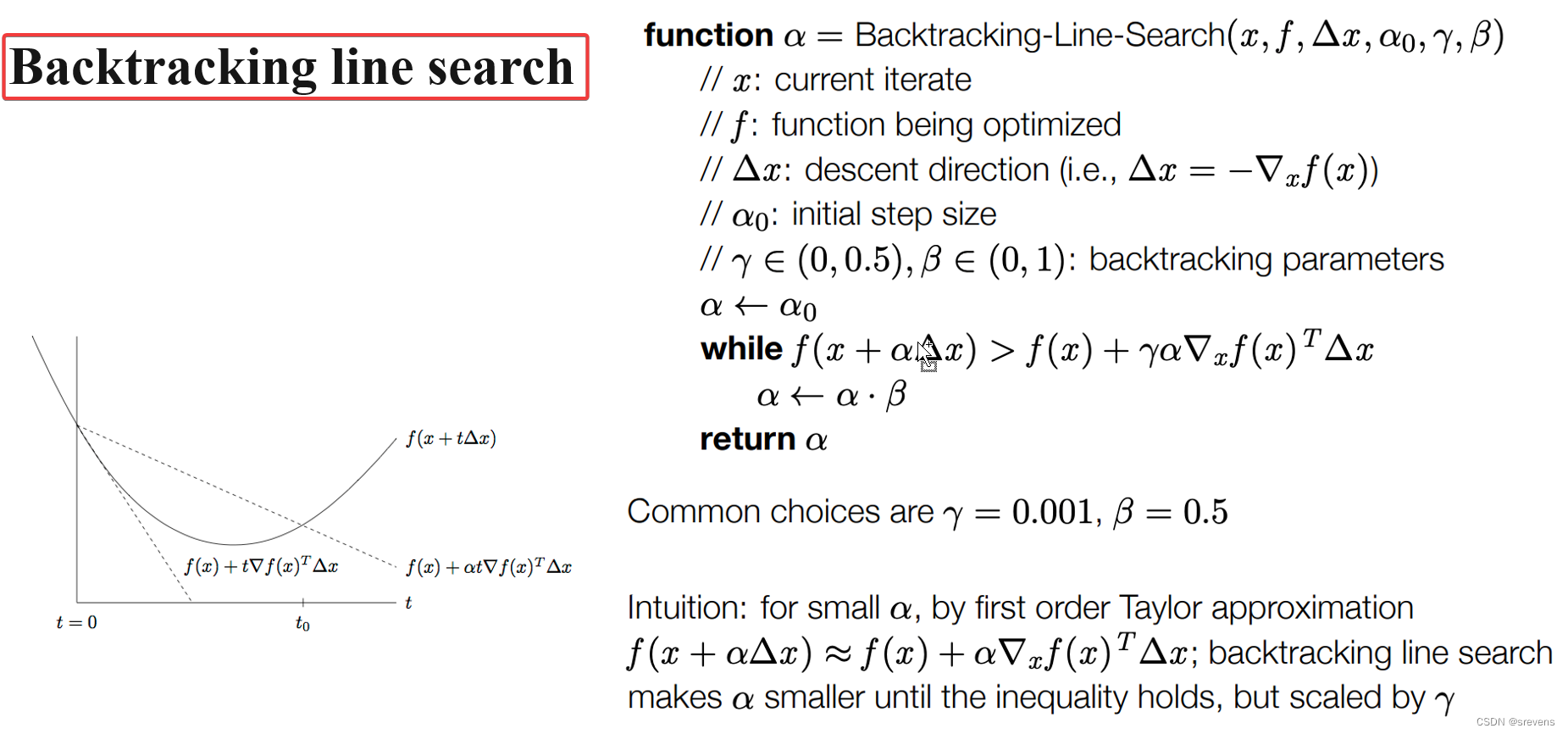

设置学习率:选择一个合适的学习率(步长),控制每次参数更新的幅度。学习率过大可能导致震荡或发散,学习率过小可能导致收敛缓慢。Exact Line Search和Backtracking Line Search

-

迭代更新参数:使用梯度下降算法迭代地更新参数值,直到满足终止条件。具体步骤如下:

计算梯度:计算目标函数对于每个参数的梯度。梯度表示目标函数在给定参数值下的变化率。可以使用解析方法或数值逼近方法计算梯度。 参数更新:使用以下公式进行参数更新:新参数值 = 旧参数值 - 学习率 × 梯度。根据梯度下降的方向,逐步调整参数值以接近最优解。 重复迭代:重复计算梯度和参数更新的步骤,直到满足终止条件。终止条件可以是达到最大迭代次数、目标函数值的收敛或参数变化的小于某个阈值。 -

终止条件:定义适当的终止条件,以确定何时停止迭代。这可以是达到最大迭代次数、目标函数值的收敛或参数变化的小于某个阈值。

-

结果评估:评估最终得到的参数值,并根据需要将其用于进一步的应用,如预测、优化等。

Class Exercise

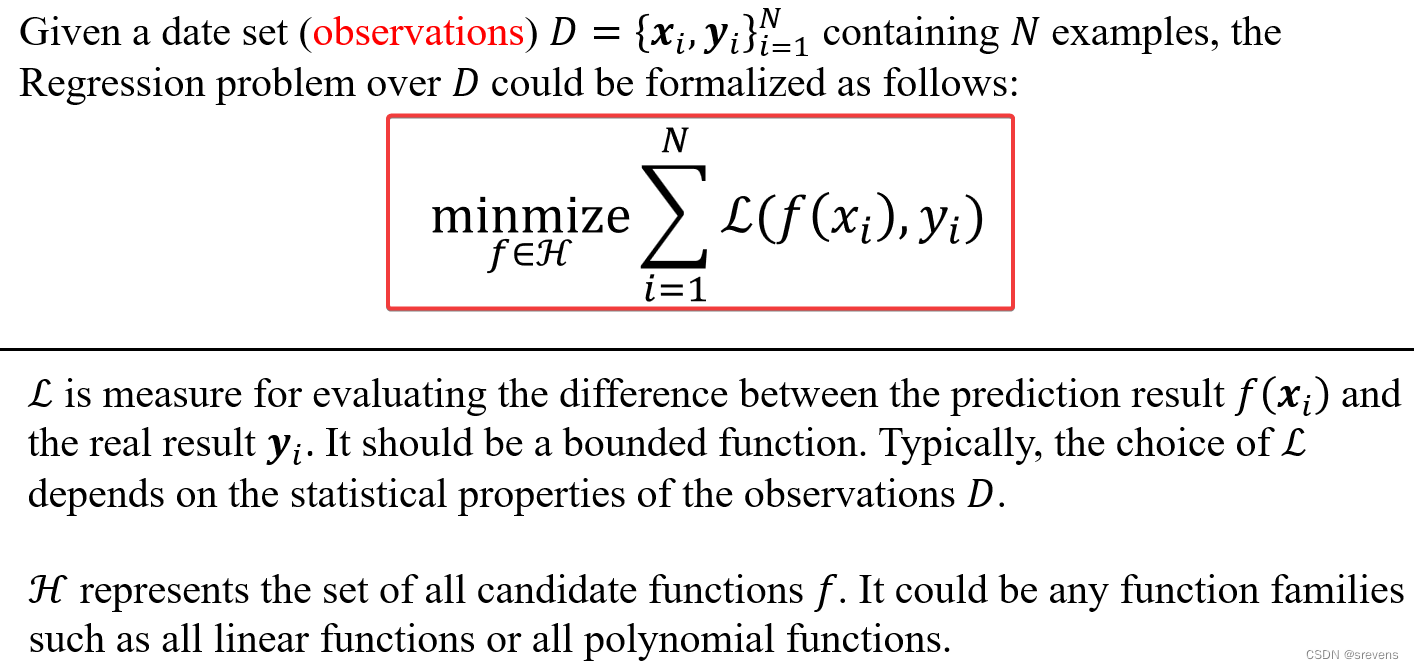

回归

56

56

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?