目录

1.模型描述(一元线性回归模型)

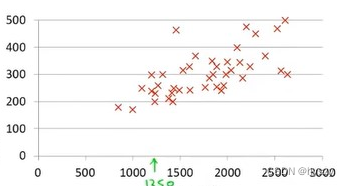

预测1250平的房子能卖多少钱

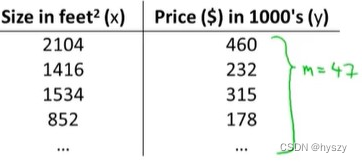

1.1 训练样本(数据集)

| 变量 | 说明 | 例子 |

| m | 训练样本的数量 | 47 |

| x | 输入变量/特征 | 2104 |

| y | 输出变量/要预测的目标变量 | 460 |

| (x,y) | 表示一个训练样本 | |

| (x(i), y(i) ) | 第i个训练样本 |

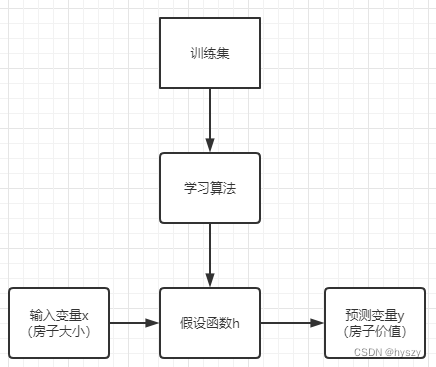

1.2 监督算法工作流程

向学习算法提供训练集,学习算法的任务是输出一个假设函数h。

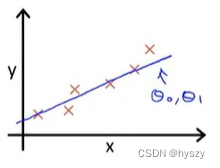

1.3 假设函数h

1)假设函数h的作用:引导从x得到y的函数。

如把房子大小作为输入变量x,它会试着输出相应房子的预测价值y。

2)写法

![]()

2.代价函数的数学定义

2.1 转化问题

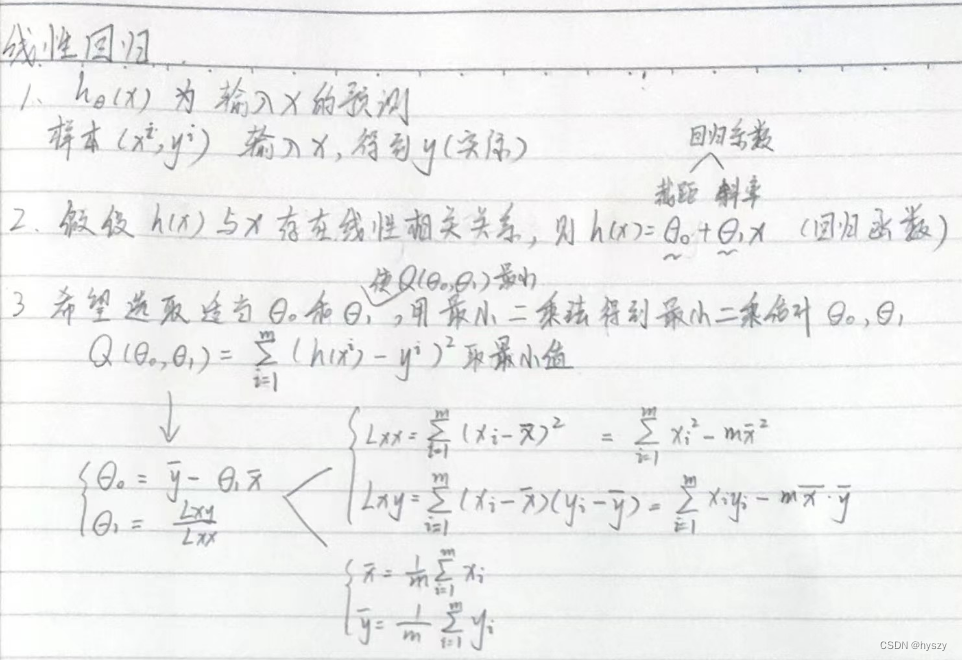

h(x)=输入x时预测的值

我们要使h(x)最接近样本对应的y值,我们通过样本集,计算出h(x)中的模型参数。

这就是在线性回归中我们要解决的一个最小化问题:

模型参数的最小化 && min[ |h(x)-y| ] => min[ ( h(x)-y )2 ]

2.2 数学

1)第i个训练样本是(x(i), y(i) )

2)对所有训练样本求和 = (从i=1->i=m)的样本求和

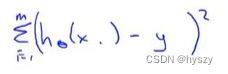

t=

x(i)=输入第i号房子的面积

h(x(i))=预测结果

[h(x(i))-y(i)]2 = (第i号的预测结果 - 房子实际价格)的平方,想尽量减少这个值

1/m * t:尽量减少我们平均误差

2.3 总结

将这个问题变成:找到能使训练集的预测值h(x)与真实值y的差的平方的总和的1/(2m)最小的![]() 则这个过程就变成了一个线性回归问题:使

则这个过程就变成了一个线性回归问题:使![]() 最小,则用【最小二乘法】得到【最小二乘估计】选取恰当

最小,则用【最小二乘法】得到【最小二乘估计】选取恰当![]() ,使得 t 最小,用公式求出

,使得 t 最小,用公式求出![]()

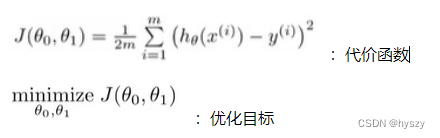

2.4 代价函数

2.4.1 概念

为了使它更明确,要改写这个函数,按照惯例定义一个代价函数:关于![]() 对函数

对函数![]() 求最小值

求最小值

代价函数也叫做【平方误差函数】,或【平方误差代价函数】

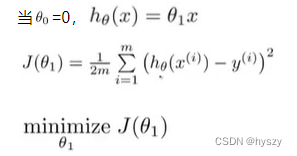

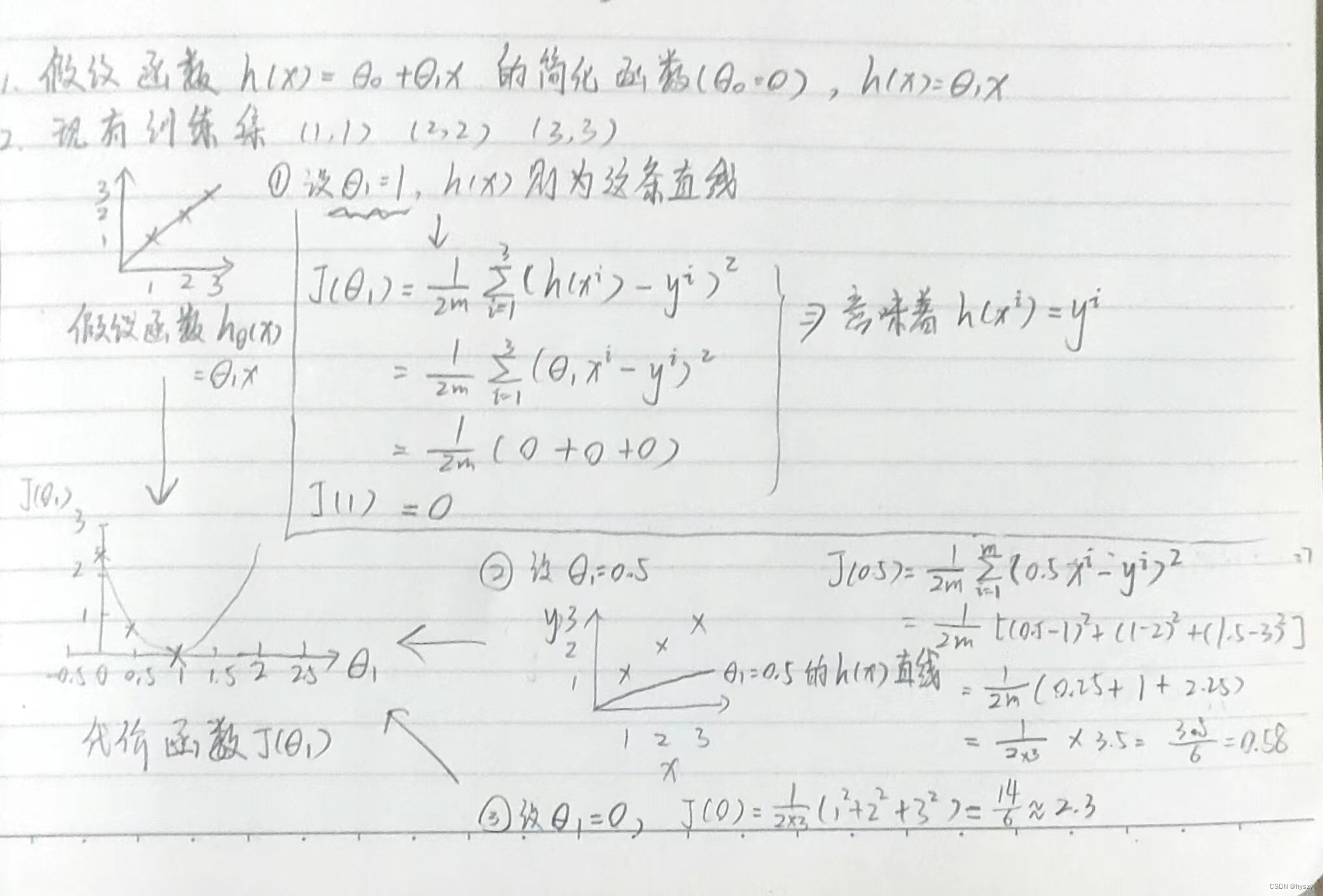

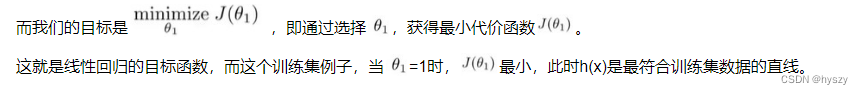

2.4.2 简化代价函数,理解原理

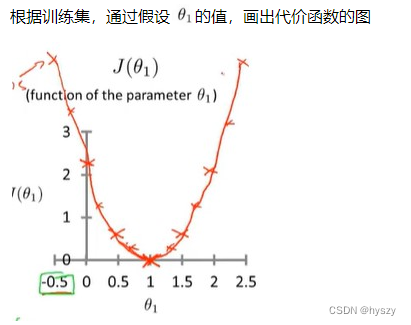

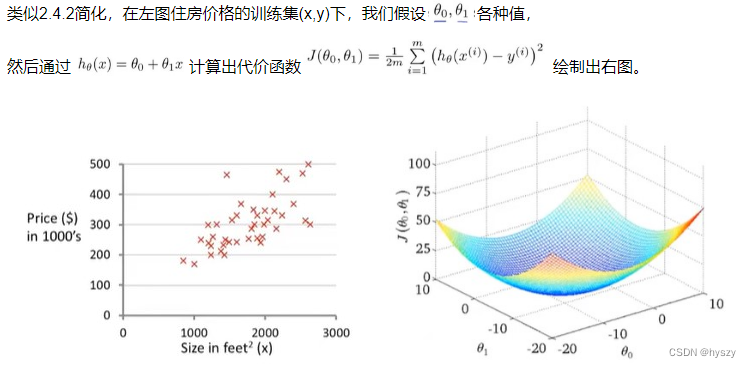

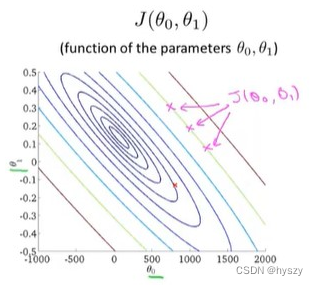

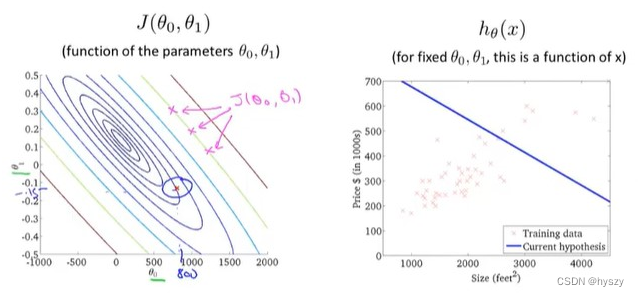

2.4.3 代价函数图形化

1)图形展示

也可以用等高线图或等高图像来展示代价函数

2)等高线图意义

![]()

其对应的假设函数h(x)与垂直轴相交于800,斜率为-0.15的线。

这里h(x)=800+(-0.15)*x,当x=0时,h(x)=800,所以假设函数h(x)与垂直轴相交于800,斜率为-0.15

可以看到右边的线没有很好拟合数据,而作图的点距离最小值(椭圆中心)相当远,所以代价相当高。

2.5 总结

622

622

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?