数据操作

宽是列的个数

4维是n个3维数组放一起 比如每次读128张图片

5维 视频 有时间维度

[1:3,1:] 1:3——拿1,2行,左闭右开 1:——拿1到所有列

[::3,::2] ::所有行/列

::3——所有行,每三行一跳,就取第0,3行,::2——所有列,每两列一跳,就取第0,2列

数据操作

import torch

x=torch.arange(12)

x

x.shape#张量形状 向量维度为1长度为12

x.numel()#元素个数

- 可以通过

张量的shape属性来访问张量的形状 (沿每个轴的长度)。

x.shape #张量形状 向量维度为1长度为12

- 如果只想知道张量中元素的总数,即形状的所有元素乘积,可以检查它的大小(size)。

`x.numel()

- 要改变一个张量的

形状而不改变元素数量和元素值,可以调用reshape函数。

可以把张量x从形状为(12,)的行向量转换为形状为(3,4)的矩阵

X = x.reshape(3, 4)#二维矩阵

X

- 使用全0、全1、其他常量或者从特定分布中随机采样的数字来初始化矩阵

torch.zeros((2, 3, 4))

torch.ones((2, 3, 4))

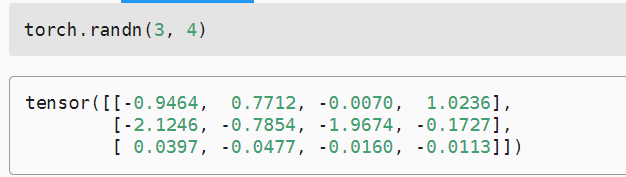

- 通过从某个特定的概率分布中随机采样来得到张量中每个元素的值

其中的每个元素都从均值为0、标准差为1的标准高斯(正态)分布中随机采样。

例如,当我们构造数组来作为神经网络中的参数时,我们通常会随机初始化参数的

torch.randn(3, 4)

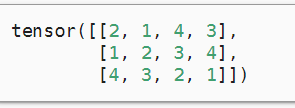

- 提供包含数值的Python列表(或嵌套列表)来为所需张量中的每个元素赋予确定值。在这里,最

外层的列表对应于轴0,内层的列表对应于轴1。

torch.tensor([[2, 1, 4, 3], [1, 2, 3, 4], [4, 3, 2, 1]])

torch.tensor([[2, 1, 4, 3], [1, 2, 3, 4], [4, 3, 2, 1]]).shape

- 加减乘除运算

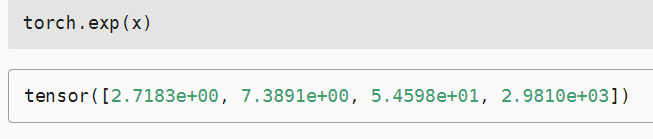

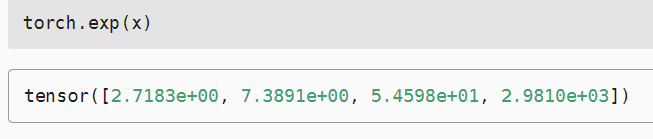

- 指数运算

x=x = torch.tensor([1.0, 2, 4, 8])

torch.exp(x)

- 张量连结(concatenate)

- 把它们

端对端地叠起来形成一个更大的张量。我们只需要提供张量列表,并给出沿哪个轴连结。下面的例子分别演示了当我们沿行(轴-0,形状的第一个元素)和按列(轴-1,形状的第二个元素)连结两个矩阵时会发生什么情况。我们可以看到,第一个输出张量的轴-0长度( 6 )是两个输入张量轴-0长度的总和( 3+3 );第二个输出张量的轴-1长度( 8 )是两个输入张量轴-1长度的总和( 4+4 )。

x=torch.arrange(12,dtype=torch.float32).reshape((3,4))#dtype=torch.float32指定类型是32位浮点

y= torch.tensor([[2.0, 1, 4, 3], [1, 2, 3, 4], [4, 3, 2, 1]])

torch.cat((X, Y), dim=0), torch.cat((X, Y), dim=1)

广播机制

X=torch.arange(6).reshape(((3,1,2)))

print(X)

Y=torch.arange(12).reshape(((3,4,1)))

print(Y)

print(X+Y)

tensor([[[0, 1]],

[[2, 3]],

[[4, 5]]])

tensor([[[ 0],

[ 1],

[ 2],

[ 3]],

[[ 4],

[ 5],

[ 6],

[ 7]],

[[ 8],

[ 9],

[10],

[11]]])

tensor([[[ 0, 1],

[ 1, 2],

[ 2, 3],

[ 3, 4]],

[[ 6, 7],

[ 7, 8],

[ 8, 9],

[ 9, 10]],

[[12, 13],

[13, 14],

[14, 15],

[15, 16]]])

数据预处理

https://www.cnblogs.com/an-ning0920/p/10037790.html

删除缺失值最多的列

import os

os.makedirs(os.path.join('..', 'data'), exist_ok=True)

data_file = os.path.join('..', 'data', 'house_tiny.csv')

with open(data_file, 'w') as f:

f.write('NumRooms,Alley,Price\n') # 列名

f.write('NA,Pave,127500\n') # 每行表示一个数据样本

f.write('2,NA,106000\n')

f.write('4,NA,178100\n')

f.write('NA,Pave,140000\n')

f.write('5,NA,140000\n')

f.write('6,10,140000\n')

# 删除缺失值最多的列

print(data.isnull().sum())

MAX = -1

for i in data:

#i分别是NumRooms Alley Price等字符串

count = data[i].isnull().sum()

if count > MAX:

MAX = count

str = i

print(MAX, str)

data = data.drop([str], axis=1)

print(data)

数据处理实例

import os

import pandas as pd

import torch

os.makedirs(os.path.join('..', 'data'), exist_ok=True)

data_file = os.path.join('..', 'data', 'house_tiny.csv')

with open(data_file, 'w') as f:

f.write('NumRooms,Alley,Price\n') # 列名

f.write('NA,Pave,127500\n') # 每行表示一个数据样本

f.write('2,NA,106000\n')

f.write('4,NA,178100\n')

f.write('NA,Pave,140000\n')

f.write('5,NA,140000\n')

f.write('6,Pave,140000\n')

data = pd.read_csv(data_file)

print(data)

'''

NumRooms Alley Price

0 NaN Pave 127500

1 2.0 NaN 106000

2 4.0 NaN 178100

3 NaN Pave 140000

4 5.0 NaN 140000

5 6.0 Pave 140000

'''

# 处理缺失数据 分别取出前两列做输入 最后一列做输出

inputs, outputs = data.iloc[:, 0:2],data.iloc[:, 2]

print(inputs)

print(outputs)

# 对于数值域中的NumRooms 用均值补齐NaN

inputs = inputs.fillna(inputs.mean())

print(inputs)

'''

NumRooms Alley

0 4.25 Pave

1 2.00 NaN

2 4.00 NaN

3 4.25 Pave

4 5.00 NaN

5 6.00 Pave

'''

# 为非数值类的类别值分类

inputs = pd.get_dummies(inputs, dummy_na=True)# NaN看做一个类别

print(inputs)

'''

NumRooms Alley_Pave Alley_nan

0 4.25 1 0

1 2.00 0 1

2 4.00 0 1

3 4.25 1 0

4 5.00 0 1

5 6.00 1 0

'''

x, y = torch.tensor(inputs.values), torch.tensor(outputs.values)

print(x)

print(y)

'''

tensor([[4.2500, 1.0000, 0.0000],

[2.0000, 0.0000, 1.0000],

[4.0000, 0.0000, 1.0000],

[4.2500, 1.0000, 0.0000],

[5.0000, 0.0000, 1.0000],

[6.0000, 1.0000, 0.0000]], dtype=torch.float64)

tensor([127500, 106000, 178100, 140000, 140000, 140000])

'''

2047

2047

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?