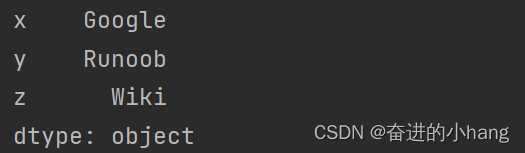

1.Pandas series

pandas.Series( data, index, dtype, name, copy)

Pandas Series 类似表格中的一个列(column),类似于一维数组,可以保存任何数据类型

import pandas as pd

a = ["Google", "Runoob", "Wiki"]

myvar = pd.Series(a, index = ["x", "y", "z"])

print(myvar)

可以使用 key/value 对象,类似字典来创建 Series,如果我们只需要字典中的一部分数据,只需要指定需要数据的索引即可

import pandas as pd

sites = {1: "Google", 2: "Runoob", 3: "Wiki"}#字典的 key 变成了索引值

myvar = pd.Series(sites, index = [1, 2])

print(myvar)

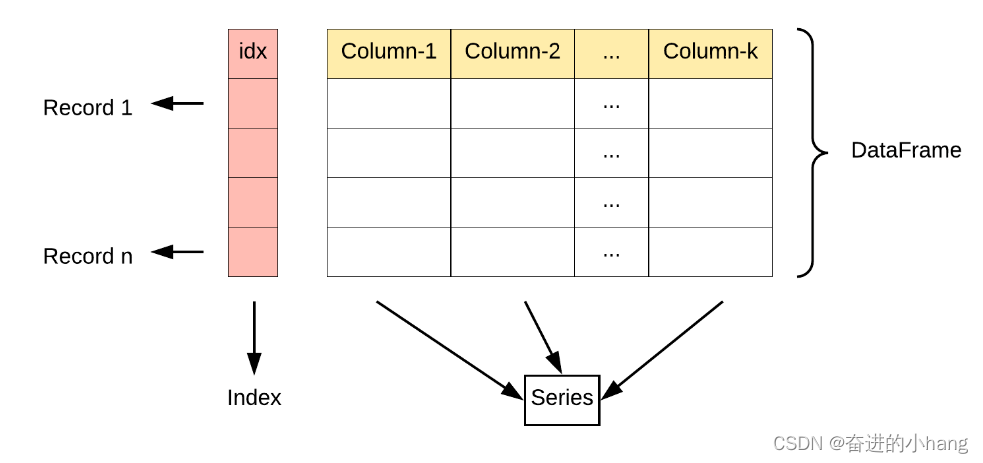

2.Pandas 数据结构 - DataFrame

pandas.DataFrame( data, index, columns, dtype, copy)

DataFrame 是一个表格型的数据结构,它含有一组有序的列,每列可以是不同的值类型(数值、字符串、布尔型值)。DataFrame 既有行索引也有列索引,它可以被看做由 Series 组成的字典(共同用一个索引)

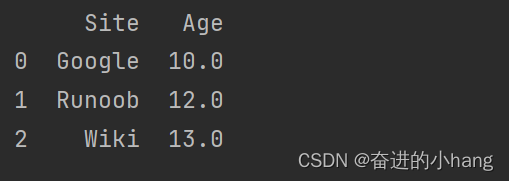

(1)实例 - 使用列表创建

import pandas as pd

data = [['Google',10],['Runoob',12],['Wiki',13]]

df = pd.DataFrame(data,columns=['Site','Age'],dtype=float)

print(df)

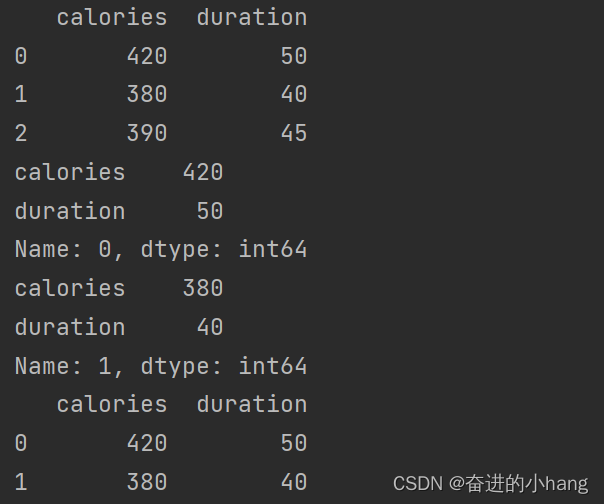

(2)实例 - 使用 ndarrays 创建

import pandas as pd

data = {

"calories": [420, 380, 390],

"duration": [50, 40, 45]

}

# 数据载入到 DataFrame 对象

df = pd.DataFrame(data)

print(df)

# 返回第一行

print(df.loc[0])

# 返回第二行

print(df.loc[1])

# 返回第一行和第二行

print(df.loc[[0, 1]])

(3)实例 - 使用字典创建

import pandas as pd

data = [{'a': 1, 'b': 2},{'a': 5, 'b': 10, 'c': 20}]

df = pd.DataFrame(data)

print (df)

3.Pandas CSV 文件

(1)CSV(Comma-Separated Values,逗号分隔值,有时也称为字符分隔值,因为分隔字符也可以不是逗号),其文件以纯文本形式存储表格数据(数字和文本)。

import pandas as pd

df = pd.read_csv('nba.csv')

print(df.to_string())#to_string() 用于返回 DataFrame 类型的数据,如果不使用该函数,则输出结果为数据的前面 5 行和末尾 5 行,中间部分以 ... 代替。

(2)使用 to_csv() 方法将 DataFrame 存储为 csv 文件

import pandas as pd

# 三个字段 name, site, age

nme = ["Google", "Runoob", "Taobao", "Wiki"]

st = ["www.google.com", "www.runoob.com", "www.taobao.com", "www.wikipedia.org"]

ag = [90, 40, 80, 98]

# 字典

dict = {'name': nme, 'site': st, 'age': ag}

df = pd.DataFrame(dict)

# 保存 dataframe

df.to_csv('site.csv')

(3)数据处理

1)head( n ) 方法用于读取前面的 n 行,如果不填参数 n ,默认返回 5 行。

2)tail( n ) 方法用于读取尾部的 n 行,如果不填参数 n ,默认返回 5 行,空行各个字段的值返回 NaN。

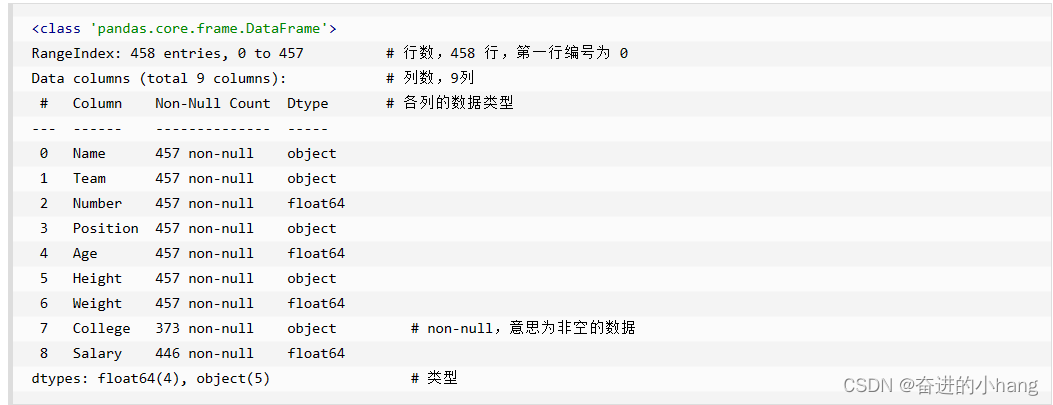

3)info() 方法返回表格的一些基本信息:

import pandas as pd

df = pd.read_csv('nba.csv')

print(df.info())

4.Pandas JSON

JSON的格式

[

{

"id": "A001",

"name": "菜鸟教程",

"url": "www.runoob.com",

"likes": 61

},

{

"id": "A002",

"name": "Google",

"url": "www.google.com",

"likes": 124

},

{

"id": "A003",

"name": "淘宝",

"url": "www.taobao.com",

"likes": 45

}

]

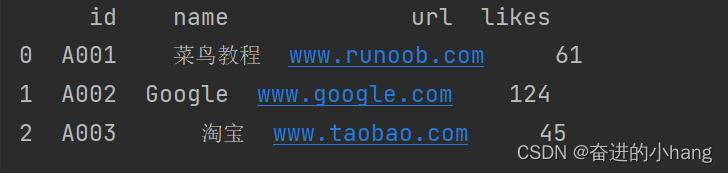

如何读取JSON数据

import pandas as pd

df = pd.read_json('sites.json')

print(df.to_string())

从URL中读取JSON数据

import pandas as pd

URL = 'https://static.runoob.com/download/sites.json'

df = pd.read_json(URL)

print(df)

内嵌的JSON

#nested_list.json 文件内容

{

"school_name": "ABC primary school",

"class": "Year 1",

"students": [

{

"id": "A001",

"name": "Tom",

"math": 60,

"physics": 66,

"chemistry": 61

},

{

"id": "A002",

"name": "James",

"math": 89,

"physics": 76,

"chemistry": 51

},

{

"id": "A003",

"name": "Jenny",

"math": 79,

"physics": 90,

"chemistry": 78

}]

}

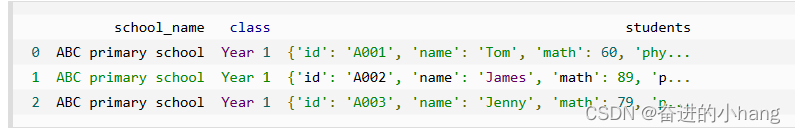

使用以下代码格式化完整内容:

import pandas as pd

df = pd.read_json('nested_list.json')

print(df)

使用json_normalize() 方法将内嵌的数据完整的解析出来

import pandas as pd

import json

# 使用 Python JSON 模块载入数据

with open('nested_list.json','r') as f:

data = json.loads(f.read())

# 展平数据

df_nested_list = pd.json_normalize(data, record_path =['students'])

print(df_nested_list)

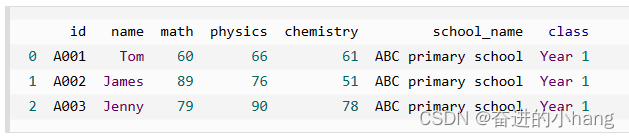

显示结果还没有包含 school_name 和 class 元素,如果需要展示出来可以使用 meta 参数来显示这些元数据:

import pandas as pd

import json

# 使用 Python JSON 模块载入数据

with open('nested_list.json','r') as f:

data = json.loads(f.read())

# 展平数据

df_nested_list = pd.json_normalize(

data,

record_path =['students'],

meta=['school_name', 'class']#如果有多级则写成['info', 'contacts', 'tel']

)

print(df_nested_list)

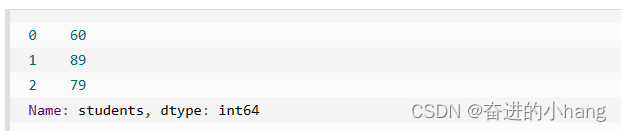

读取内嵌数据中的一组数据,需要使用到 glom 模块来处理数据套嵌

import pandas as pd

from glom import glom

df = pd.read_json('nested_deep.json')

data = df['students'].apply(lambda row: glom(row, 'grade.math'))

print(data)

5. Pandas 数据清洗

数据清洗是对一些没有用的数据进行处理的过程。

很多数据集存在数据缺失、数据格式错误、错误数据或重复数据的情况,如果要对使数据分析更加准确,就需要对这些没有用的数据进行处理。

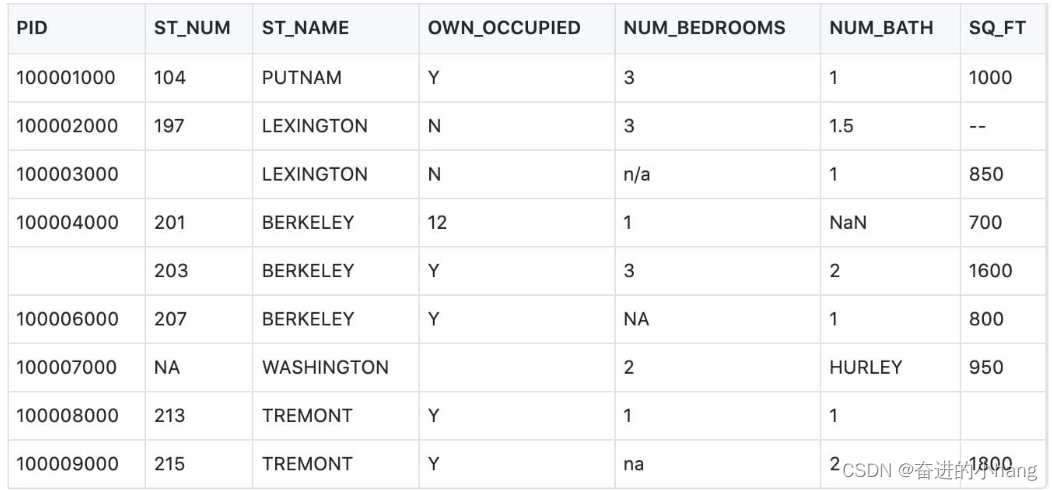

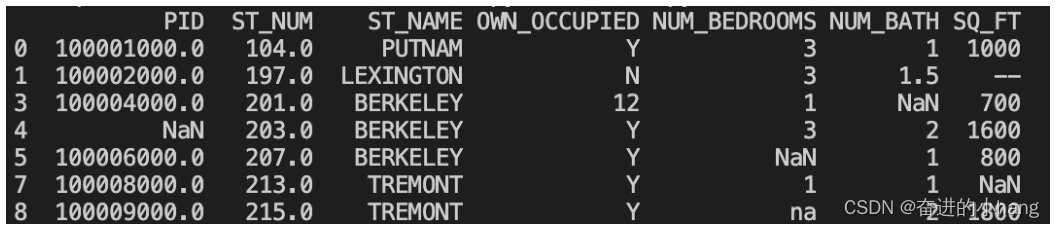

eg:

(1)Pandas 清洗空值

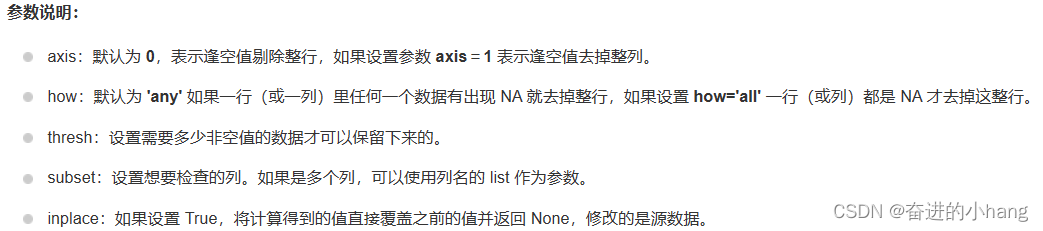

如果我们要删除包含空字段的行,可以使用 dropna() 方法,语法格式如下:

DataFrame.dropna(axis=0, how='any', thresh=None, subset=None, inplace=False)

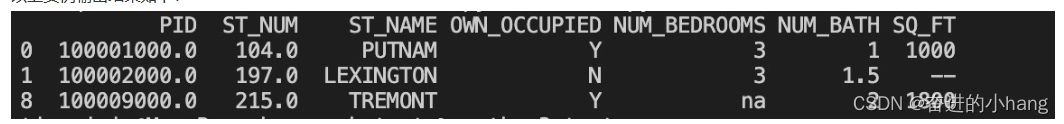

import pandas as pd

df = pd.read_csv('property-data.csv')

new_df = df.dropna()

print(new_df.to_string())

注意: Pandas 把 n/a 和 NA 当作空数据,默认情况下,dropna() 方法返回一个新的DataFrame,不会修改源数据。如果你要修改源数据 DataFrame, 可以使用 inplace = True 参数。

可以移除指定列有空值的行:

import pandas as pd

df = pd.read_csv('property-data.csv')

df.dropna(subset=['ST_NUM'], inplace = True)

print(df.to_string())

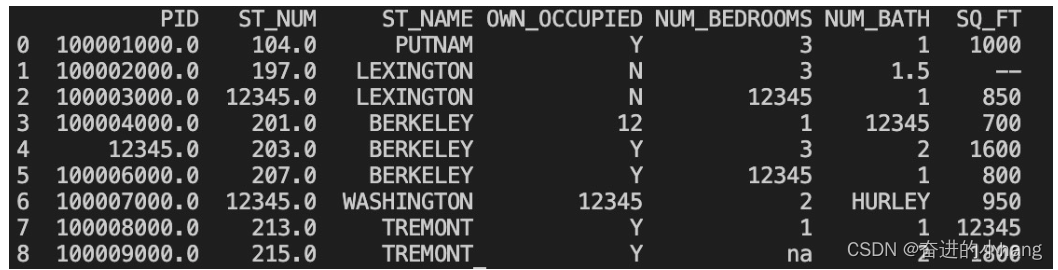

(2)可以 fillna() 方法来替换一些空字段

import pandas as pd

df = pd.read_csv('property-data.csv')

df.fillna(12345, inplace = True)

print(df.to_string())

也可以指定某一个列来替换数据

import pandas as pd

df = pd.read_csv('property-data.csv')

df['PID'].fillna(12345, inplace = True)

print(df.to_string())

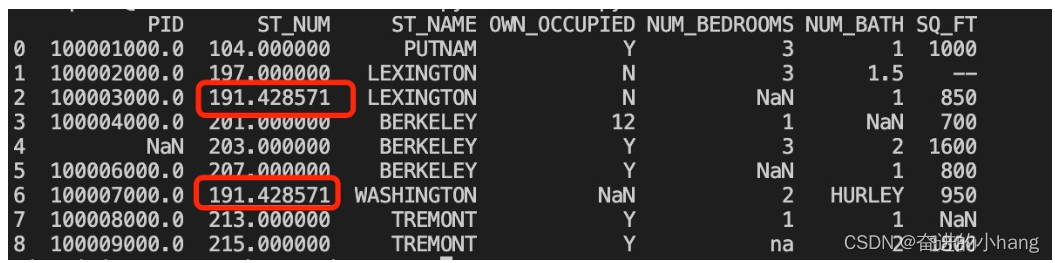

替换空单元格的常用方法是计算列的均值、中位数值或众数。

Pandas使用 mean()、median() 和 mode() 方法计算列的均值(所有值加起来的平均值)、中位数值(排序后排在中间的数)和众数(出现频率最高的数)。

import pandas as pd

df = pd.read_csv('property-data.csv')

x = df["ST_NUM"].mean()

df["ST_NUM"].fillna(x, inplace = True)

print(df.to_string())

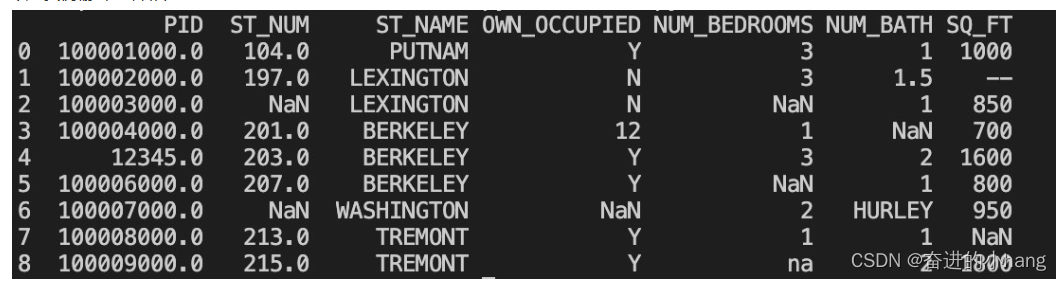

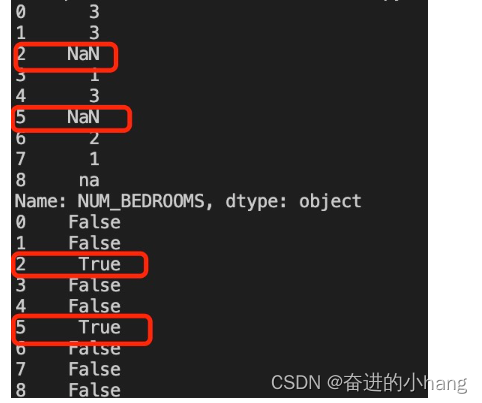

(3)可以通过 isnull() 判断各个单元格是否为空

import pandas as pd

df = pd.read_csv('property-data.csv')

print (df['NUM_BEDROOMS'])

print (df['NUM_BEDROOMS'].isnull())

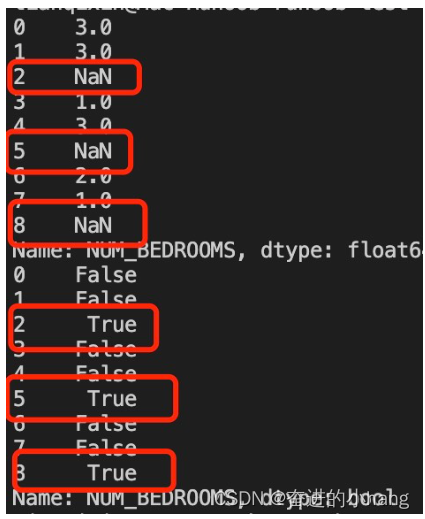

na 不是空数据,不符合我们要求,我们可以指定空数据类型:

import pandas as pd

missing_values = ["n/a", "na", "--"]

df = pd.read_csv('property-data.csv', na_values = missing_values)

print (df['NUM_BEDROOMS'])

print (df['NUM_BEDROOMS'].isnull())

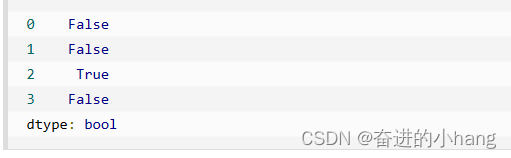

(4)Pandas 清洗重复数据

如果我们要清洗重复数据,可以使用 duplicated() 和 drop_duplicates() 方法。

如果对应的数据是重复的,duplicated() 会返回 True,否则返回 False。

import pandas as pd

person = {

"name": ['Google', 'Runoob', 'Runoob', 'Taobao'],

"age": [50, 40, 40, 23]

}

df = pd.DataFrame(person)

print(df.duplicated())

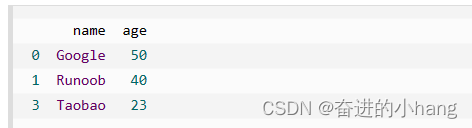

删除重复数据,可以直接使用drop_duplicates() 方法

import pandas as pd

persons = {

"name": ['Google', 'Runoob', 'Runoob', 'Taobao'],

"age": [50, 40, 40, 23]

}

df = pd.DataFrame(persons)

df.drop_duplicates(inplace = True)

print(df)

4358

4358

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?