作者:Arjun Sarkar

翻译:陈之炎

校对:欧阳锦

本文约1900字,建议阅读8分钟

本文带你学习使用Python中的wrapper函数和OOP来编写自定义损失函数。

标签:TensorFlow 2,损失函数

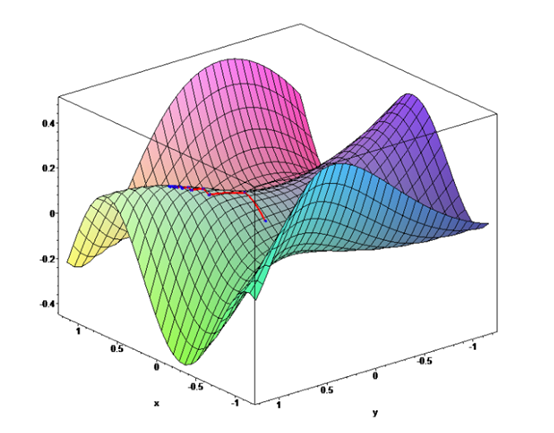

图1:梯度下降算法(来源:公共域,https://commons.wikimedia.org/w/index.php?curid=521422 )

神经网络利用训练数据,将一组输入映射成一组输出,它通过使用某种形式的优化算法,如梯度下降、随机梯度下降、AdaGrad、AdaDelta等等来实现,其中最新的算法包括Adam、Nadam或RMSProp。梯度下降中的“梯度”是指误差梯度。每次迭代之后,网络将其预测输出与实际输出进行比较,然后计算出“误差”。

通常,对于神经网络,寻求的是将误差最小化。将误差最小化的目标函数通常称之为成本函数或损失函数,由“损失函数”计算出的值称为“损失”。在各种问题中使用的典型损失函数有:

均方误差;

均方对数误差;

二元交叉熵;

分类交叉熵;

稀疏分类交叉熵。

Tensorflow已经包含了上述损失函数,直接调用它们即可,如下所示:

1. 将损失函数当作字符串进行调用

model.compile (loss = ‘binary_crossentropy’,optimizer = ‘adam’, metrics = [‘accuracy’])

2. 将损失函数当作对象进行调用

from tensorflow.keras.losses importmean_squared_error

model.compile(loss = mean_squared_error,optimizer=’sgd’)

将损失

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3396

3396

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?