在H.G.Wells的时光机器数据集上训练。先读取数据集。

%matplotlib inline

import math

from mxnet import autograd, gluon, np, npx

from d2l import mxnet as d2l

npx.set_np()

batch_size, num_steps = 32, 35

train_iter, vocab = d2l.load_data_time_machine(batch_size, num_steps)独热编码

在train_iter中,每个词元都表示为一个数字索引, 将这些索引直接输入神经网络可能会使学习变得困难。 我们通常将每个词元表示为更具表现力的特征向量。 最简单的表示称为独热编码(one-hot encoding)。

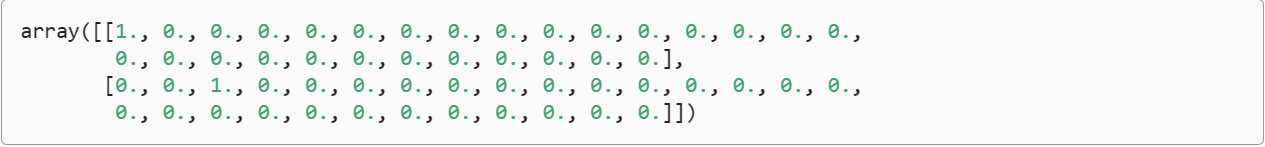

简言之,将每个索引映射为相互不同的单位向量: 假设词表中不同词元的数目为N(即len(vocab)), 词元索引的范围为0到N−1。 如果词元的索引是整数i, 那么我们将创建一个长度为N的全0向量, 并将第i处的元素设置为1。 此向量是原始词元的一个独热向量。 索引为0和2的独热向量如下所示:

npx.one_hot(np.array([0, 2]), len(vocab))

我们每次采样的小批量数据形状是二维张量:(批量大小,时间步数)。 one_hot函数将这样一个小批量数据转换成三维张量, 张量的最后一个维度等于词表大小(len(vocab))。 我们经常转换输入的维度,以便获得形状为 (时间步数,批量大小,词表大小)的输出。 这将使我们能够更方便地通过最外层的维度, 一步一步地更新小批量数据的隐状态。

X = np.arange(10).reshape((2, 5))

npx.one_hot(X.T, 28).shape

初始化模型参数

接下来,初始化循环神经网络模型的模型参数。 隐藏单元数num_hiddens是

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2248

2248

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?