任务调度系统 Airflow

文章目录

一. Airflow 简介

Airflow 是 Airbnb 开源的一个用 Python 编写的调度工具。于 2014 年启动,2015 年春季开源,2016 年加入 Apache 软件基金会的孵化计划。

Airflow 将一个工作流制定为一组任务的有向无环图(DAG),并指派到一组计算节点上,根据相互之间的依赖关系,有序执行。Airflow 有以下优势:

- 灵活易用。Airflow 是 Python 编写的,工组流的定义也使用 Python 编写;

- 功能强大。支持多种不同类型的作业,可自定不同类型的作业,可自定义不同类型的作业。如 Shell、Python、MySQL、Oracle、Hive 等;

- 简介优雅。作业的定义简单明了;

- 易扩展。提供各种基类供扩展,有多种执行器可供选择;

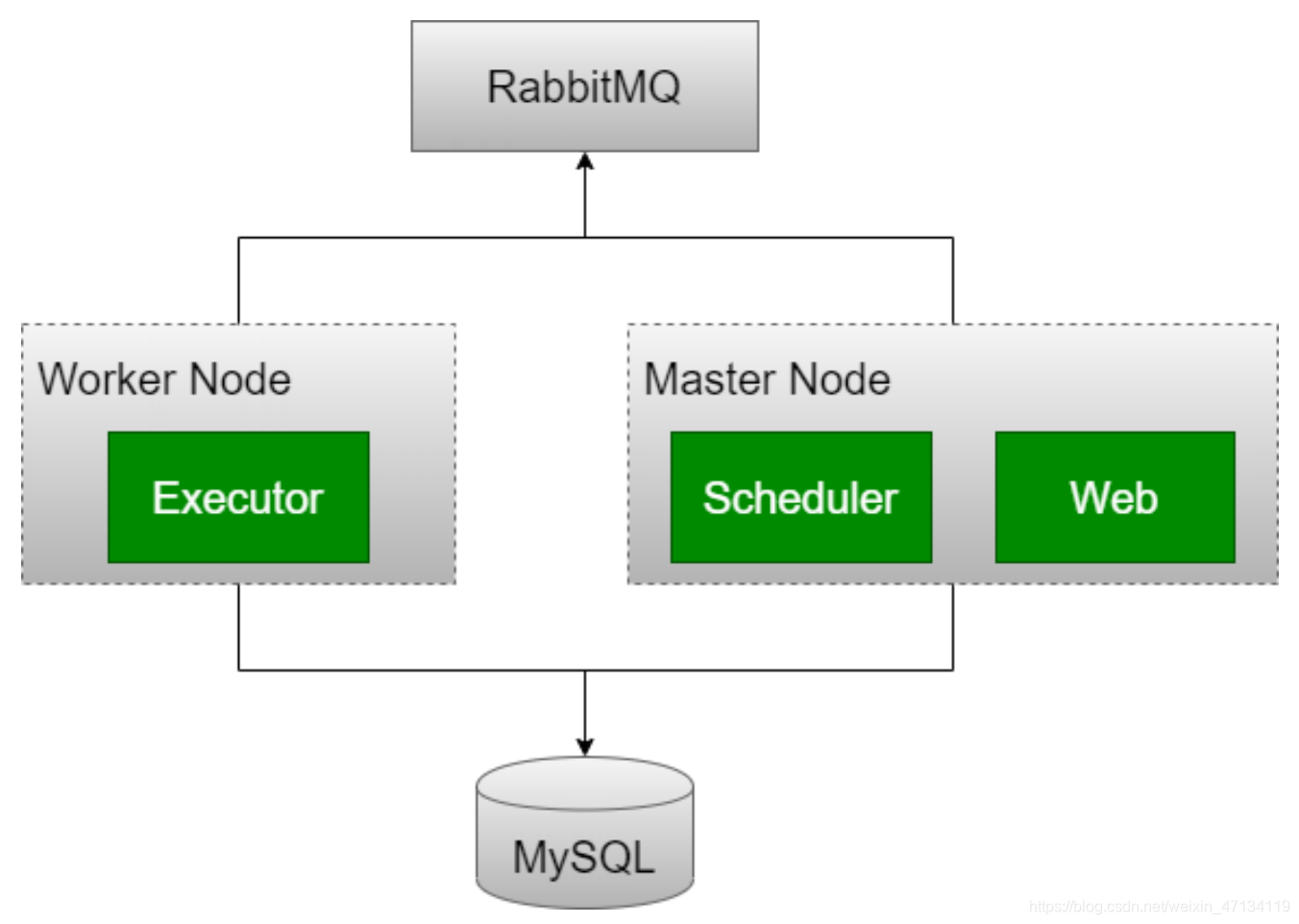

1.1 体系结构

Webserver 守护进程。接受 HTTP 请求,通过 Python Flask Web 应用程序与 airflow 进行交互。Webserver 提供的功能包括:中止、恢复、触发任务;监控正在运行的任务,断电续跑任务;查询任务的状态,日志等详细信息。

Scheduler 守护进程。周期性地轮询任务的调度计划,以确定是否触发任务执行。

Worker 守护进程。Worker 负责启动机器上的 executor 来执行任务。使用 celetyExecutor 后可以在多个机器上部署 worker 服务。

1.2 重要概念

1.2.1 DAG(Directed Acyclic Graph)有向无环图

在 Airflow 中,一个 DAG 定义了一个完成的作业。同一个 DAG 中的所有 Task 拥有相同的调度时间。

参数:

dag_id:唯一识别 DAGdefault_args:默认参数,如果当前 DAG 实例的作业没有配置相应参数,则采用 DAG 实例的 default_args 中的相应参数。schedule_interval:配置 DAG 的执行周期,可采用 crontab 语法

1.2.2 Task

Task 为 DAG 中具体的作业任务,依赖于 DAG,必须存在于某个 DAG 中。Task 在 DAG 中可以配置依赖关系

参数:

dag:当前作业属于相应的 DAGtask_id:任务标识符owner:任务的拥有者start_date:任务的开始时间

二. Airflow 安装部署

2.1 安装依赖

-

CentOS 7.x

-

Python 3.5 或以上版本(推荐)

-

MySQL 5.6.x

-

Apache-Airflow 1.10.11

-

虚拟机可上网,需在线安装

备注:后面要安装的三个软件 Airflow、Atlas、Griffin,相对 Hadoop 的安装都较为复杂

- 正式安装软件之前给虚拟机做一个快照

- 按照讲义中指定的软件安装

- 按照讲义的步骤执行对应的命令,命令的遗漏会对后面的安装造成影响

Airflow 1.10.11 安装请注意一下两条命令:

-- 下载的时候指定 airflow 的版本 pip install apache-airflow==1.10.11 -i https://pypi.douban.com/simple -- 下载的时候指定 mysqlclient 的版本 pip install mysqlclient==1.4.6

2.2 Python 环境准备

备注:提前下载 Python-3.6.6.tgz

备注:使用 linux122 安装(没有安装 MySQL 机器的)

# 卸载 mariadb

rpm -qa | grep mariadb

#查看是否有下面者三个

mariadb-libs-5.5.65-1.el7.x86_64

mariadb-5.5.65-1.el7.x86_64

mariadb-devel-5.5.65-1.el7.x86_64

# 卸载上面三个

yum remove mariadb

yum remove mariadb-libs

http://repo.mysql.com/

# 安装依赖mysql57-community-release-el7-11.noarch.rpm(这个依赖在/opt/lagou/software/ 目录下ÿ

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1471

1471

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?