最近看论文时,无意间看到BP(backpropagation)算法使用梯度下降手段(gradient-based),便觉得好奇。什么事梯度下降算法,BP又是怎么使用这种方法进行权值调整呢?

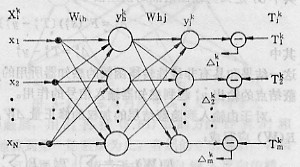

下图给出BP算法模型:

这是一个k阴层神经网络,第k层的输入为xk,那么第k层的节点输入的值为:

那么其输出是:

同样,第k层节点要传到输出层,输出层节点输出值为:

误差函数为:

梯度下降法就是为了最小化上述函数,假设有个初值w0,为了寻找是的E(W)更小的w1,我们选择函数的负梯度方向进行更新,w1=w0+a*d。这里的d为负梯度方向,a为步长,对应到bp算法中的更新速率参数。所以权值进行如下调整:

8255

8255

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?