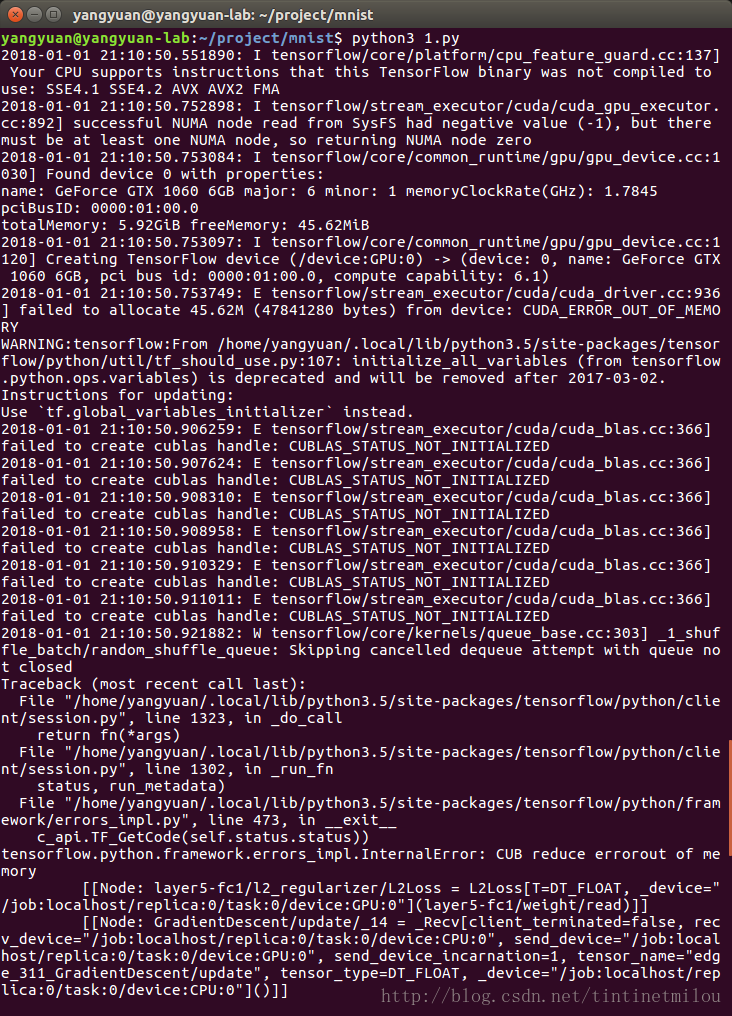

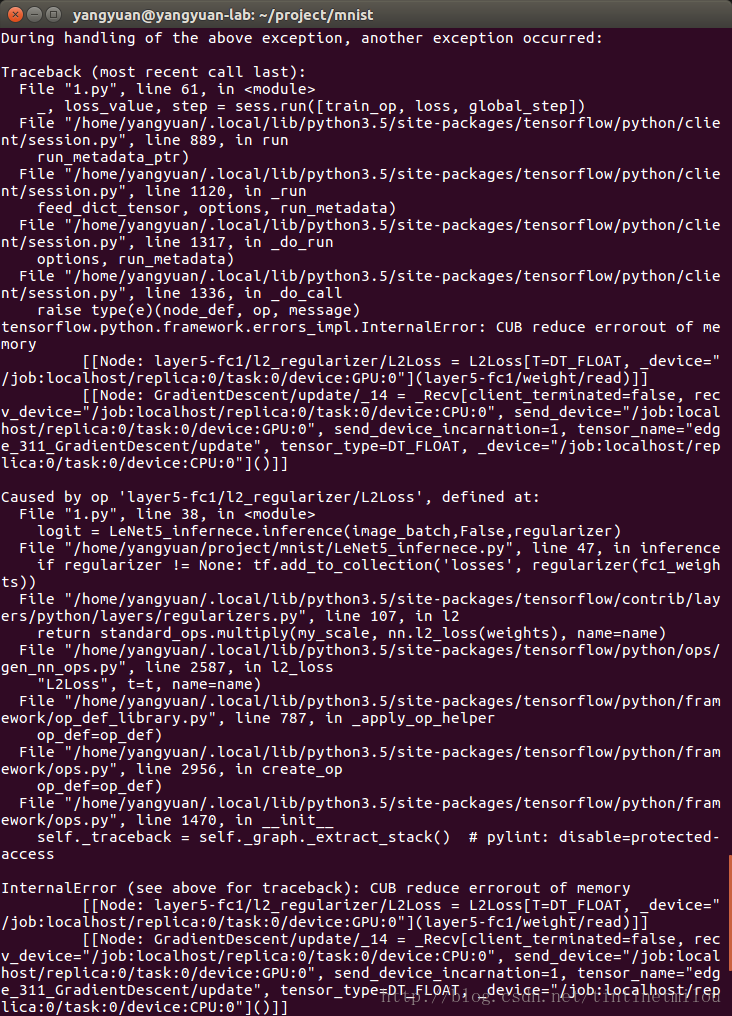

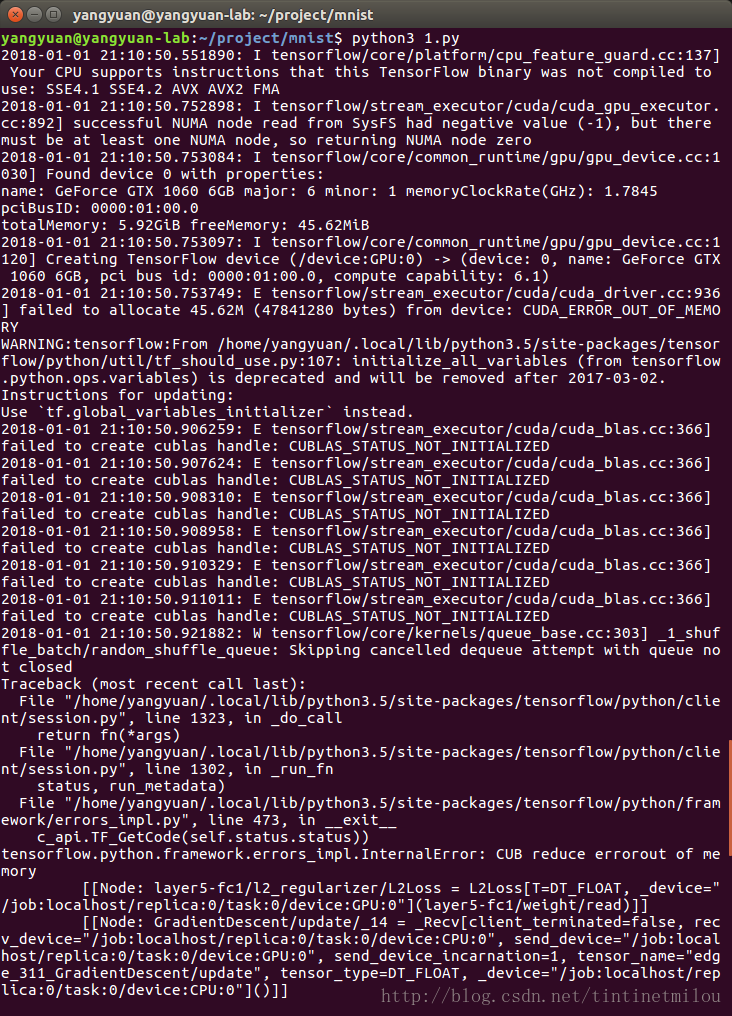

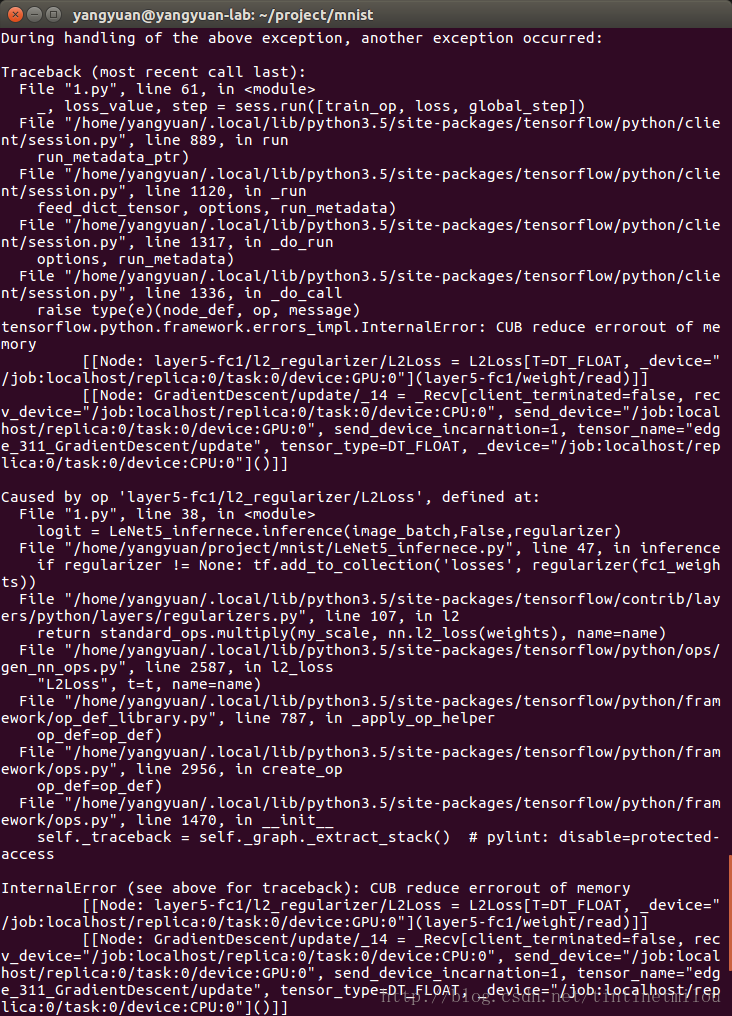

今天用GPU运行一个tensorflow

程序,因故意外停止后就再也不能运行程序了。

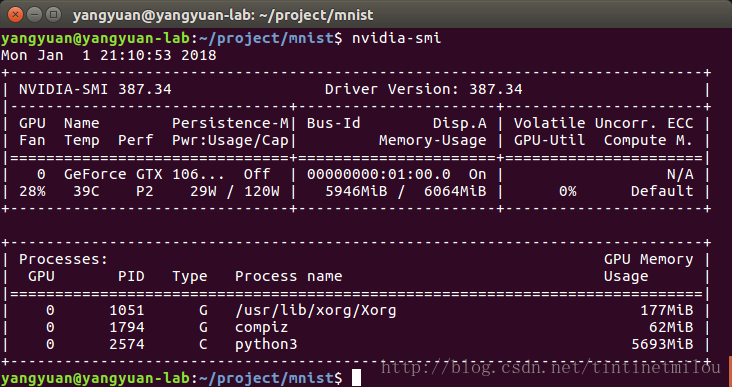

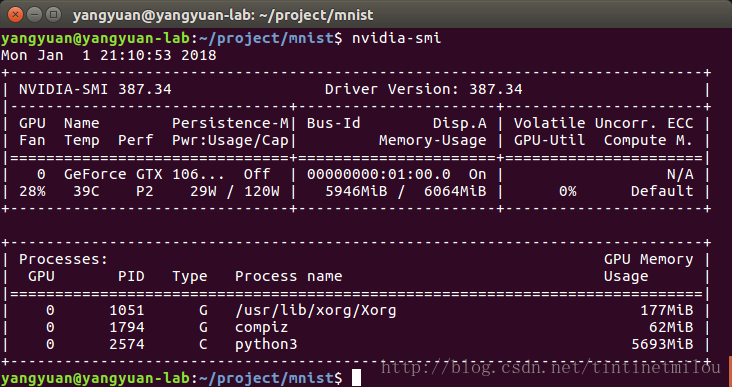

看警告怀疑是显存没有被释放。用nvidia-smi命令来查看一下,果不其然:

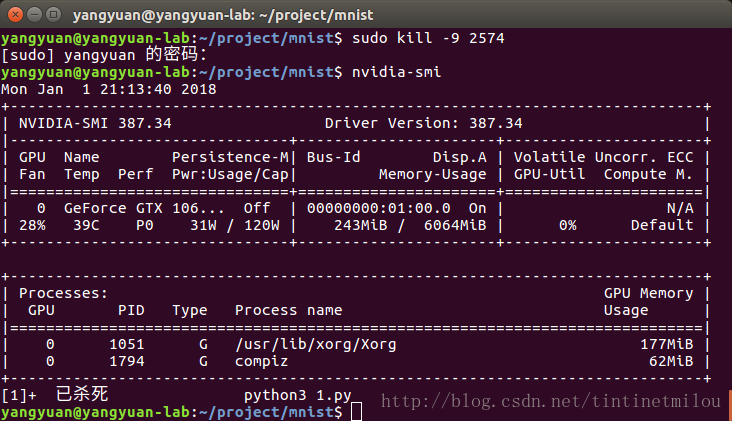

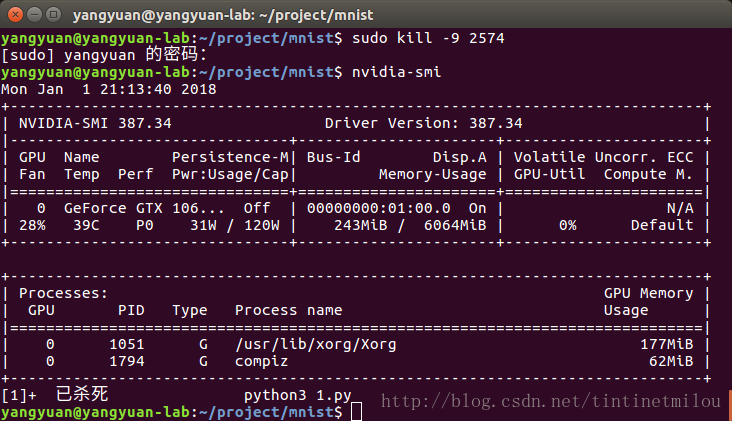

用命令根据PID关了对应的进程就好了

sudo kill -9 PID本例中用sudo kill -9 2574,就可以了,再次用nvidia-smi查看,发现对应进程已经被杀死,相关显存被成功释放。

今天用GPU运行一个tensorflow

程序,因故意外停止后就再也不能运行程序了。

sudo kill -9 PID本例中用sudo kill -9 2574,就可以了,再次用nvidia-smi查看,发现对应进程已经被杀死,相关显存被成功释放。

652

652

1193

1193

806

806

1178

1178

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?