Spark集群运行环境搭建

集群模式

1、standalone -> 将spark应用运行在spark自带的资源管理器上

2、yarn -> 将spark应用运行在yarn上, 将程序运行在yarn上(国内大多数公司的选择)

3、mesos -> 将spark应用运行在mesos上(国外大多数公司的选择)

(注:本文仅包括前三两种Spark运行环境的搭建)

一、standalone模式

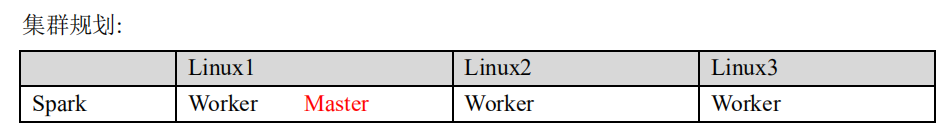

local 本地模式毕竟只是用来进行练习演示的,真实工作中还是要将应用提交到对应的集群中去执行,这里我们来看看只使用 Spark 自身节点运行的集群模式,也就是我们所谓的独立部署(Standalone)模式。Spark 的 Standalone 模式体现了经典的 master-slave 模式。

1.1 解压与配置文件修改

1.1.1 解压

将 spark-3.0.0-bin-hadoop3.2.tgz 文件上传到 Linux 并解压缩在指定位置(文件下载可参考上一篇文章)

tar -zxvf spark-3.0.0-bin-hadoop3.2.tgz -C /opt/module

cd /opt/module

mv spark-3.0.0-bin-hadoop3.2 spark-standalone

1.1.2 修改配置文件

进入解压缩后路径的 conf 目录,

1、slave文件修改

修改 slaves.template 文件名为 slaves

mv slaves.template slaves

将slave文件中localhost改为自己集群的节点

如:

hadoop100

hadoop101

hadoop102

2、spark-env.sh.template 文件修改

修改 spark-env.sh.template 文件名为 spark-env.sh

mv spark-env.sh.template spark-env.sh

修改 spark-env.sh 文件,添加 JAVA_HOME 环境变量和集群对应的 master 节点

export JAVA_HOME=/opt/module/jdk1.8.0_144

SPARK_MASTER_HOST=linux1(主节点)

SPARK_MASTER_PORT=7077

1.1.3 文件分发

scp -r /opt/modules/spark-standalone 用户名@主机名:/opt/modules/

scp -r /opt/modules/spark-standalone root@hadoop106:/opt/modules/

1.2 集群启动与应用提交

1.2.1 启动集群

进入解压后的spark-standalone目录

sbin/start-all.sh(启动所有集群)

sbin/stop-all.sh(关闭所有集群)

1.2.2 查看 Master 资源监控 Web UI 界面

1.2.3 提交应用

使用spark测试用例,求π值:

bin/spark-submit \

--class org.apache.spark.examples.SparkPi \

--master spark://hadoop104:7077 \

./examples/jars/spark-examples_2.12-3.0.0.jar \

10

参数解析

- –class 表示要执行程序的主类

- –master spark://linux1:7077 独立部署模式,连接到 Spark 集群

- spark-examples_2.12-3.0.0.jar 运行类所在的 jar 包

- 数字 10 表示程序的入口参数,用于设定当前应用的任务数量

1.3 配置历史服务

由于 spark-shell 停止掉后,集群监控 linux1:4040 页面就看不到历史任务的运行情况,所以开发时都配置历史服务器记录任务运行情况。

1.3.1 配置文件修改

1、修改 spark-defaults.conf.template文件

重命名文件

mv spark-defaults.conf.template spark-defaults.conf

在文件末尾添加配置:开启日志存储并配置日志存储路径

spark.eventLog.enabled true

spark.eventLog.dir hdfs://hadoop104:8020/directory

注意:因为日志文件需要将日志数据存储在HDFS中,所以需要启动 hadoop 集群,并且HDFS 上的 directory 目录需要提前存在。

# 在HDFS中创建directory文件

sbin/start-dfs.sh(开启HDFS)

hadoop fs -mkdir /directory(创建directory文件夹)

hadoop fs -ll /

2、修改 spark-env.sh 文件, 添加日志配置

在spark-env.sh 文件后添加配置

export SPARK_HISTORY_OPTS="

-Dspark.history.ui.port=18080

-Dspark.history.fs.logDirectory=hdfs://linux1:8020/directory

-Dspark.history.retainedApplications=30"

⚫ 参数 1 含义:WEB UI 访问的端口号为 18080

⚫ 参数 2 含义:指定历史服务器日志存储路径

⚫ 参数 3 含义:指定保存 Application 历史记录的个数,如果超过这个值,旧的应用程序信息将被删除,这个是内存中的应用数,而不是页面上显示的应用数。

3、分发配置文件

scp -r /opt/modules/spark-standalone/conf 用户名@主机名:/opt/modules/spark-standalone

1.3.2 重新启动并重新执行测试任务

重新启动集群并启动历史服务

sbin/start-all.sh

sbin/start-history-server.sh

bin/spark-submit \

--class org.apache.spark.examples.SparkPi \

--master spark://hadoop104:7077 \

./examples/jars/spark-examples_2.12-3.0.0.jar \

10

1.3.3 查看历史服务

1.4 配置高可用

所谓的高可用是因为当前集群中的 Master 节点只有一个,所以会存在单点故障问题。所以为了解决单点故障问题,需要在集群中配置多个 Master 节点,一旦处于活动状态的 Master发生故障时,由备用 Master 提供服务,保证作业可以继续执行。这里的高可用一般采用Zookeeper 设置

1.4.1 启动zookeeper

/opt/modules/zookeeper-3.4.5-cdh5.3.6/bin/zkServer.sh start

1.4.2 配置文件修改

1、修改spark-env.sh配置文件

#注释如下内容:

#SPARK_MASTER_HOST=linux1

#SPARK_MASTER_PORT=7077

添加如下内容:

#Master 监控页面默认访问端口为 8080,但是可能会和 Zookeeper 冲突,所以改成 8989,也可以自定义,访问 UI 监控页面时请注意

SPARK_MASTER_WEBUI_PORT=8989

export SPARK_DAEMON_JAVA_OPTS="

-Dspark.deploy.recoveryMode=ZOOKEEPER

-Dspark.deploy.zookeeper.url=linux1,linux2,linux3

-Dspark.deploy.zookeeper.dir=/spark"

2、分发配置文件

scp -r /opt/modules/spark-standalone/conf 用户名@主机名:/opt/modules/spark-standalone

1.4.3 集群启动与应用提交

1、集群启动

主节点:sbin/start-all.sh

一个其它节点(高可用):sbin/start-master.sh

此时该节点 Master 状态处于备用状态

2、任务提交

bin/spark-submit \

--class org.apache.spark.examples.SparkPi \

--master spark://hadoop104:7077,hadoop105:7077 \

./examples/jars/spark-examples_2.12-3.0.0.jar \

10

二、Yarn模式

独立部署(Standalone)模式由 Spark 自身提供计算资源,无需其他框架提供资源。这种方式降低了和其他第三方资源框架的耦合性,独立性非常强。但是也要记住,Spark 主要是计算框架,而不是资源调度框架,所以本身提供的资源调度并不是它的强项,所以还是和其他专业的资源调度框架集成会更靠谱一些。特别是因为在国内工作中,Yarn 使用的非常多。

2.1 解压与配置文件修改

2.1.1 解压与改名

tar -zxvf spark-3.0.0-bin-hadoop3.2.tgz -C /opt/module

cd /opt/module

mv spark-3.0.0-bin-hadoop3.2 spark-yarn

2.1.2 配置文件修改

1、修改 hadoop 配置文件/opt/module/hadoop/etc/hadoop/yarn-site.xml, 并分发

<!--是否启动一个线程检查每个任务正使用的物理内存量,如果任务超出分配值,则直接将其杀掉,默认

是 true -->

<property>

<name>yarn.nodemanager.pmem-check-enabled</name>

<value>false</value>

</property>

<!--是否启动一个线程检查每个任务正使用的虚拟内存量,如果任务超出分配值,则直接将其杀掉,默认

是 true -->

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

2、修改 conf/spark-env.sh,添加 JAVA_HOME 和 YARN_CONF_DIR 配置

mv spark-env.sh.template spark-env.sh

export JAVA_HOME=/opt/module/jdk1.8.0_144

YARN_CONF_DIR=/opt/module/hadoop/etc/hadoop

2.2 启动集群与任务提交

2.2.1 hadoop集群启动

配一份启动集群脚本

#!/bin/bash

case $1 in

"start"){

echo "**********$1 all zkServer**********"

ssh hadoop104 "/opt/modules/zookeeper-3.4.5-cdh5.3.6/bin/allzkServer.sh start";

echo "**********$1 HDFS**********"

echo "----------$1 hadoop104 namenode----------"

ssh hadoop104 "/opt/modules/hadoop-2.7.2/sbin/hadoop-daemon.sh start namenode"

echo "----------$1 hadoop106 Secondarynamenode----------"

ssh hadoop106 "/opt/modules/hadoop-2.7.2/sbin/hadoop-daemon.sh start secondarynamenode"

echo "**********$1 datanode**********"

for i in hadoop104 hadoop105 hadoop106;

do

echo "----------$1 $i datanode----------"

ssh $i "/opt/modules/hadoop-2.7.2/sbin/hadoop-daemon.sh start datanode"

done

echo "**********$1 YARN**********"

echo "----------$1 hadoop105 resourcemanager----------"

ssh hadoop105 "/opt/modules/hadoop-2.7.2/sbin/yarn-daemon.sh start resourcemanager"

echo "**********$1 nodemanager**********"

for i in hadoop104 hadoop105 hadoop106;

do

echo "----------$1 $i nodemanager----------"

ssh $i "/opt/modules/hadoop-2.7.2/sbin/yarn-daemon.sh start nodemanager"

done

echo "**********$1 historyserver**********"

ssh hadoop106 "/opt/modules/hadoop-2.7.2/sbin/mr-jobhistory-daemon.sh start historyserver"

};;

# -------------------------------------------------------------------------------------------------------------------

# -------------------------------------------------------------------------------------------------------------------

"stop"){

echo "**********$1 historyserver**********"

ssh hadoop106 "/opt/modules/hadoop-2.7.2/sbin/mr-jobhistory-daemon.sh stop historyserver"

echo "**********$1 YARN**********"

echo "----------$1 hadoop105 resourcemanager----------"

ssh hadoop105 "/opt/modules/hadoop-2.7.2/sbin/yarn-daemon.sh stop resourcemanager"

echo "**********$1 nodemanager**********"

for i in hadoop104 hadoop105 hadoop106;

do

echo "----------$1 $i nodemanager----------"

ssh $i "/opt/modules/hadoop-2.7.2/sbin/yarn-daemon.sh stop nodemanager"

done

echo "**********$1 HDFS**********"

echo "----------$1 hadoop104 namenode----------"

ssh hadoop104 "/opt/modules/hadoop-2.7.2/sbin/hadoop-daemon.sh stop namenode"

echo "----------$1 hadoop105 Secondarynamenode----------"

ssh hadoop106 "/opt/modules/hadoop-2.7.2/sbin/hadoop-daemon.sh stop secondarynamenode"

echo "**********$1 datanode**********"

for i in hadoop104 hadoop105 hadoop106;

do

echo "----------$1 $i datanode----------"

ssh $i "/opt/modules/hadoop-2.7.2/sbin/hadoop-daemon.sh stop datanode"

done

echo "**********$1 all zkServer**********"

ssh hadoop104 "/opt/modules/zookeeper-3.4.5-cdh5.3.6/bin/allzkServer.sh stop";

};;

esac

启动spark

sbin/start-all.sh

2.2.2 提交应用

bin/spark-submit \

--class org.apache.spark.examples.SparkPi \

--master yarn \

--deploy-mode cluster \

./examples/jars/spark-examples_2.12-3.0.0.jar \

10

查看历史服务

还未配置历史服务,不能查看history

2.2.3 配置历史服务

与之前standalone配置历史服务一样

端口号

➢ Spark 查看当前 Spark-shell 运行任务情况端口号:4040(计算)

➢ Spark Master 内部通信服务端口号:7077

➢ Standalone 模式下,Spark Master Web 端口号:8080(资源)

➢ Spark 历史服务器端口号:18080

➢ Hadoop YARN 任务运行情况查看端口号:8088

1443

1443

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?