概要

本篇博客是Spark 任务调度概述详细流程中的第七部分,介绍Driver发送task到Executor的过程。

执行用户编写代码

Spark 任务调度之Register App中介绍了Driver中初始化SparkContext对象及注册APP的流程,SparkContext初始化完毕后,执行用户编写代码,仍以SparkPi为例,如下

如上图,SparkPi中调用RDD的reduce,reduce中

调用SparkContext.runJob方法提交任务,SparkContext.runJob方法调用DAGScheduler.runJob方法,如下

DAGScheduler生成task

DAGScheduler中,根据rdd的Dependency生成stage,stage分为ShuffleMapStage和ResultStage两种类型,根据stage类型生成对应的task,分别是ShuffleMapTask、ResultTask,最后调用TaskScheduler提交任务,如下图。

这里我们只关注流程,DAGScheduler的具体细节后续介绍。

TaskScheduler提交task

TaskScheduler中使用TaskSetManager管理TaskSet,submitTasks方法最终调用CoarseGrainedSchedulerBackend的launchTasks方法将task发送到Executor,如下

executorDataMap中保存了Executor的连接方式,关于Executor如何注册到executorDataMap中,参考Spark 任务调度之创建Executor。

Executor接收Task

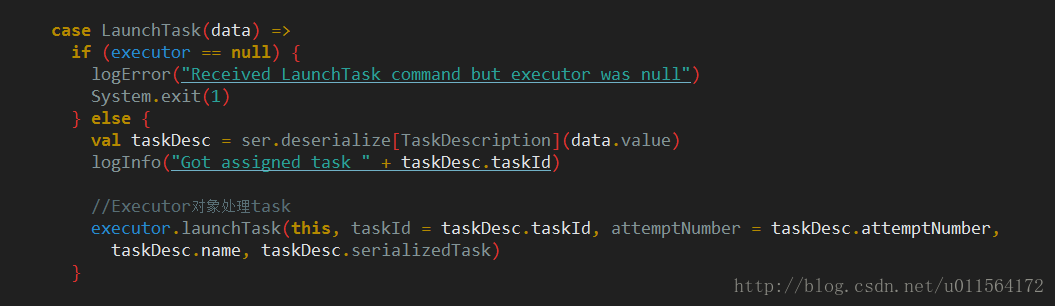

Worker节点的CoarseGrainedExecutorBackend进程接收Driver发送的task,交给Executor对象处理,如下

Executor的创建过程请参考Spark 任务调度之创建Executor。

至此从RDD的action开始,至Executor对象接收任务的流程就结束了。

总结

介绍了从RDD的action开始,到Executor接收到task的流程,其中省略了DAG相关的部分,后续单独介绍,整理流程大致如下

2498

2498

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?