1.梯度下降

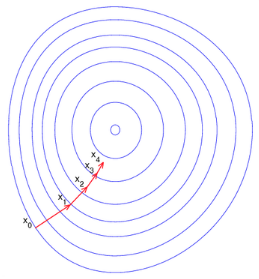

神经网络最基本的算法是反向传播算法加上梯度下降算法。通过梯度下降算法使得网络参数不断收敛到全局(或局部)的最小值,但是由于神经网络层数太多,需要通过反向传播算法把误差一层一层地从输出传到输入,逐渐地更新网络参数。由于梯度方向是函数值变大的最快的方向,因此负梯度方向则是函数值变小的最快的方向。沿着负梯度方向一步一步迭代,便能快速收敛到函数最小值。这就是梯度下降法的基本思路。

梯度下降法的迭代公式如下:

![]()

其中:w是待训练的网络参数,α是学习率,是一个常数,dw是梯度。

2.LSGD

随机梯度下降是梯度下降的一个小变形,就是

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?