梯度下降法

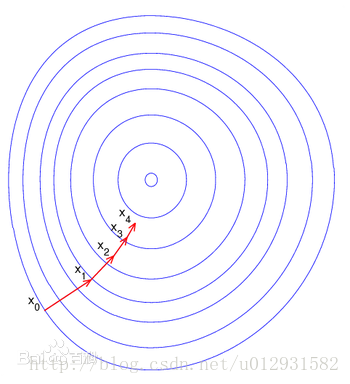

如果学过最优化,那么就知道梯度下降法是最简单的一种函数求极小的方法,也成为最速下降法,过程如下,首先选取一个初始位置,计算当前位置下的函数的梯度,然后按照负梯度方向走一个步长的距离,重新在当前点计算梯度并走一个负梯度方向的步长,迭代当前过程直到收敛. 过程可以用下图表示:

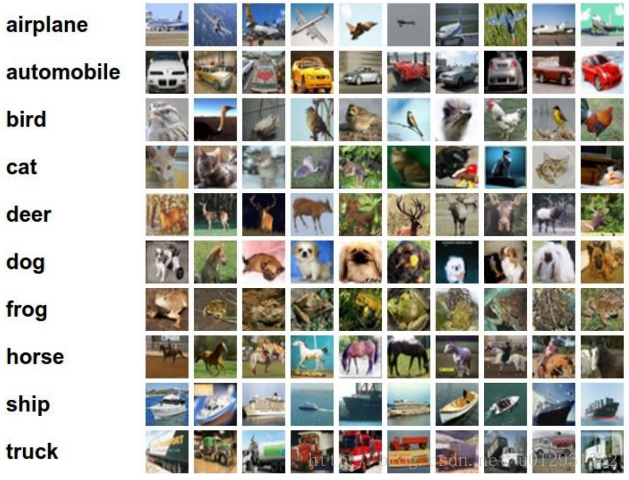

还是举一个图片分类的例子,当前一共有10类的图片,每一张图片都有相同的大小32*32*3=3072维.数据集如下所示:

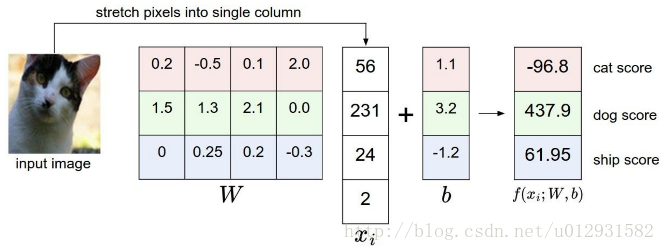

分类过程如下图所示,其中权值矩阵是一个10*3072大小的矩阵, xi 是一个3072*1的向量,b为10*1的向量,分别对应这10个类别的偏置,然后通过

f(xi;W,b)=Wxi+b

这样一个打分函数计算出当前图片对应10个类的分数,选取分数最高的一类作为最后的分类结果,过程如下图所示:

线性分类器都是这样一个计算过程, 只不过不同的线性分类器对应这不同的损失函数,损失函数我们在上一节已经介绍过了,

Svm Loss: Li=∑j≠yimax(0,wTjxi−wTyixi+Δ))

Total Loss: L=1N∑Li+λ∑∑Wkj2

Softmax Loss: Li=−log(ewTyixi∑kewjxi)

Total Loss: L=1N

这篇博客介绍了梯度下降法在求解线性分类器,如SVM和Softmax分类器中的应用。讨论了数值梯度和分析梯度的计算,以及梯度检验的重要性。还提到了在大型数据集上使用mini-batch梯度下降的优化策略。

这篇博客介绍了梯度下降法在求解线性分类器,如SVM和Softmax分类器中的应用。讨论了数值梯度和分析梯度的计算,以及梯度检验的重要性。还提到了在大型数据集上使用mini-batch梯度下降的优化策略。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1430

1430

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?