NVIDIA Maxine AI 开发者平台是一套 NVIDIA NIM 微服务、云加速微服务和 SDK,可以提供用于增强实时视频和音频的先进功能。NVIDIA 合作伙伴使用 Maxine 功能打造更好的虚拟交互体验,并改善与其应用的人类连接。

在虚拟环境中很少进行和保持眼神交流,因为在举行会议或制作视频时,通常很难将目光与摄像头对齐;分心、脚本、侧面注释和其他因素增加了保持眼神交流的挑战。

Maxine 眼神交流通过将用户的目光与摄像头对齐来模拟眼神交流,并增加互动和联系,来解决此问题。有关更多信息,请参阅 NVIDIA Maxine 提升云端视频会议效果。

Maxine 的灵活选项

将 Maxine 功能集成到应用程序中,有几个选项,稍后将在本文中进行概述。Texel 是一个 AI 平台,提供云原生 API,可帮助您扩展和优化图像和视频处理的工作流,使使用云的小型开发者能够更轻松、更经济地进行集成。

联合创始人兼 Texel 首席执行官 Rahul Sheth 和 Texel 首席技术官 Eli Semory 是规模化的推动者。Sheth 表示:“NVIDIA 的 Maxine 眼神交流 SDK 是一种先进的模型,但小型商店和开发者在开箱即用的大规模采用该功能方面可能会遇到挑战。我们的视频管线 API 可让用户以高度优化且经济高效的方式轻松使用任意数量的视频模型。”

与 NVIDIA 的合作为 Texel 的客户节省了宝贵的开发时间,并使这项技术能够被更多的开发者和用户所使用。

视频 1.使用 Texel API 自动进行眼神交流

在视频 1 中,了解 AI 如何通过将眼睛自然重定向到摄像头,以增强互动和输出,从而增强视频通信。

集成的优势

Maxine 支持跨任何平台进行灵活、快速的部署和更新。

NVIDIA NIM 微服务

以下是使用 NVIDIA NIM 微服务将 Maxine 功能集成到您的应用程序中的优点:

- 高效地扩展应用程序,确保实现出色的性能和资源利用率。

- 轻松与 Kubernetes 平台集成。

- 支持大规模部署 NVIDIA Triton。

- 提供一键式部署选项,例如 NVIDIA Triton 推理服务器。

NVIDIA SDK

以下是使用 NVIDIA SDK 将 Maxine 功能集成到您的应用程序中的优势:

- 包括对可扩展 AI 模型部署的 NVIDIA Triton 推理服务器支持。

- 支持跨不同云环境的无缝扩展。

- 支持多流扩展,同时提高吞吐量。

- 在每个工作负载中标准化模型部署和执行,以简化AI基础设施。

- 提供并发模型执行,最大限度地提高GPU利用率和吞吐量。

- 提供动态批处理以提高推理性能。

- 支持复杂AI工作流的模型集成和业务逻辑脚本。

- 支持云、数据中心和边缘部署。

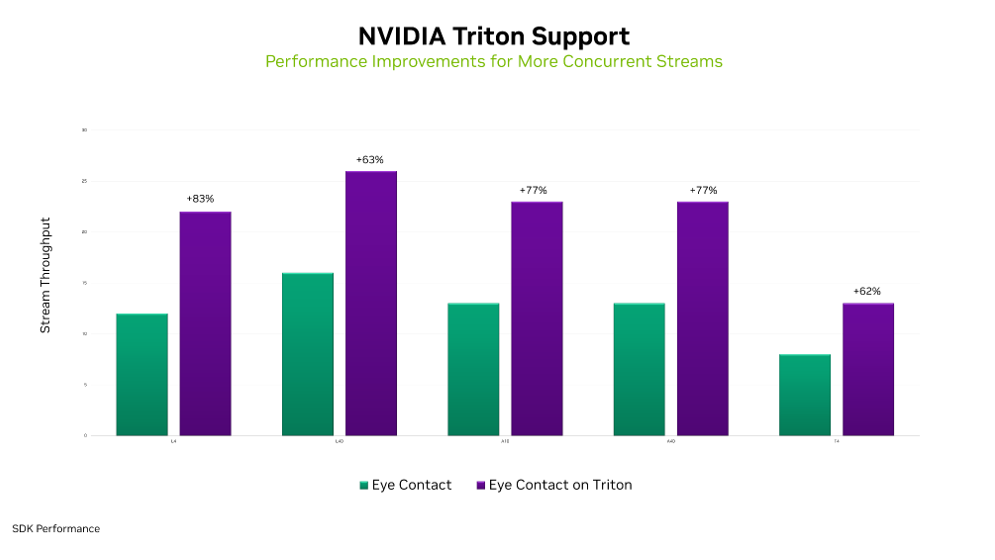

图 1. NVIDIA Triton 支持可提高并发流的吞吐量。

使用 Triton 推理服务器上的 Maxine SDK,可利用多框架支持、高级功能和强大的模型管理功能,为 AI 模型部署和推理提供全面、优化且可扩展的解决方案。

用于简化扩展的 Texel

借助 Maxine 进行扩展的关键策略之一是集成和优化实现者(如 Texel),从而使服务满足数百万用户的需求。

- 简化 API 集成:控制您想要激活的功能,而无需管理复杂的后端过程。这简化了 Maxine 功能与应用程序的集成。

- 端到端流水线优化:专注于使用功能而非基础设施。从输入到推理再到输出,整个流水线均经过优化,可简化数据流并在后台进行扩展。

- 自定义模型优化:引入您自己的自定义模型进行优化,从而减少推理时间和 NVIDIA GPU 内存使用率。这有助于更轻松地扩展基于 Maxine 构建的自定义 AI 解决方案。

- 硬件抽象:使用最新的 NVIDIA GPUs,而无需成为硬件专家,从而降低采用高级硬件加速的门槛。

- 高效的资源利用:在尽可能少的GPU上运行,从而可能降低成本并使扩展更加经济地。

- 实时性能:构建响应更灵敏的应用程序,以便在实时编辑图像和视频时使用 AI。

- 灵活部署:为最适合您需求的扩展方法,选择托管或本地部署选项。

Texel 团队在大规模运行大型 GPU 车队 (例如,在 Snapchat) 方面的背景表明,他们的方法是使 NVIDIA 加速的 AI 更易于访问和扩展。借助灵活的集成选项和 Texel 的帮助,您可以有效解决扩展的复杂性,并处理数百万用户的需求。

616

616

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?